Astrid, M., M. Zaheer, Jae-Yeong Lee and Seung-Ik Lee. “Learning Not to Reconstruct Anomalies.” BMVC (2021).

Paper URL:[PDF] Learning Not to Reconstruct Anomalies | Semantic Scholar

与下面这一篇 是同一个团队,并且实现方法非常类似【视频异常检测-论文阅读】Synthetic Temporal Anomaly Guided End-to-End Video Anomaly Detection_不喝可乐不快乐的博客-CSDN博客

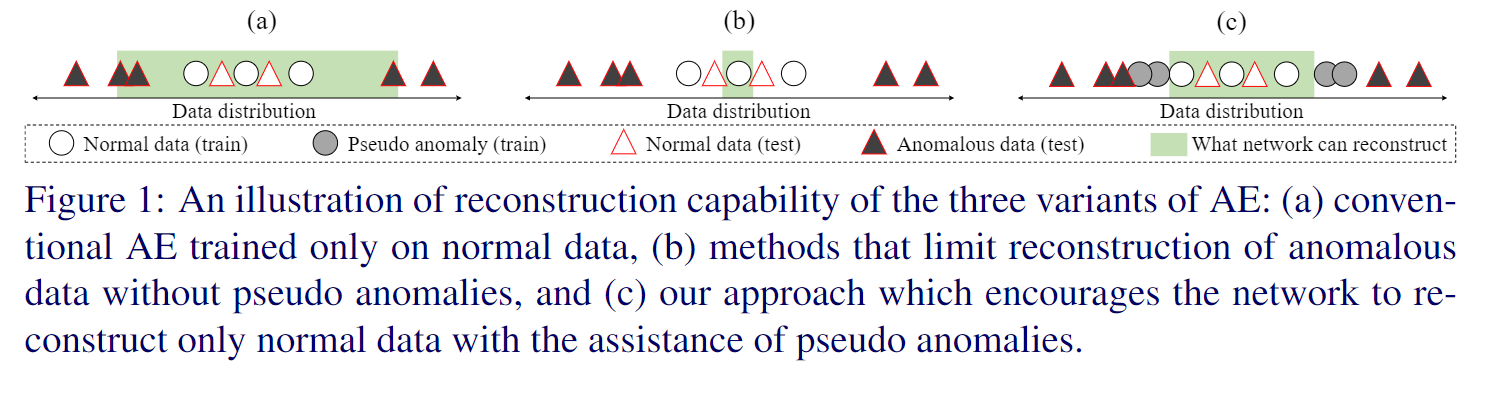

这篇文章主要针对 解决视频异常检测问题 中以 one-class classification (OCC) 的方式(经常使用的是自动把编码器(Atuoencoder))存在这样一个问题: 即使只有正常的数据训练,AEs通常也可以较好的重建异常,这会降低异常检测性能。

ps: (论文中的一个解释)

这很可能是一个结果,因为只要边界在训练集中包含正常数据,AE仅根据正常数据进行训练的AE的重建边界就不会受到约束

It is a likely outcome as the reconstruction boundary of the AE trained only on normal data would be unconstrained as long as the boundary includes the normal data in the training set.

为了缓解这一问题,一些研究人员[9,35]提出在AE的编码器和解码器之间的潜在空间上采用(memory mechanism)记忆机制,以限制异常输入情况下的重建能力。

【9】Gong, Dong et al. “Memorizing Normality to Detect Anomaly: Memory-Augmented Deep Autoencoder for Unsupervised Anomaly Detection.” 2019 IEEE/CVF International Conference on Computer Vision (ICCV) (2019): 1705-1714.

【35】Park, Hyunjong et al. “Learning Memory-Guided Normality for Anomaly Detection.” 2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR) (2020): 14360-14369.

这个想法是为了记住从训练数据中学到的正常表征。这样,网络只能使用已存储的规范表示进行重构,从而降低了重新生成异常数据的能力。然而,这样的网络是高度依赖于内存大小,小型内存也可能限制其正常的数据重建能力。

如图6显示,尽管异常区域与 baseline 相比具有更多失真,但一些正常部分也失真,这可能导致正常和异常数据之间的区分性有限。

图1 展示了三种不同的方式,AE的重建能力

为了缓解上面提到的问题,我们提出了一种新的方法来训练AEs,目标是只重建正常数据,而不管输入(即正常或异常)。

- 一种基于伪异常的新方法,该方法只鼓励正常数据重建,以在OCC设置中训练AEs

- 提出两种类型的伪异常,基于 patch and skip frame,以模拟异常

方法

下图是 网络的整体模型

Conventional Autoencoders in OCC Setting

输入X 通过AE 得到重建结果 ,X的输入尺寸为T × C × H × W,分别为输入序列的帧数、通道数、帧高、帧宽,![]() 和

和 ![]() 分别是我们模型的编码器和解码器。

分别是我们模型的编码器和解码器。

最小重建损失训练

Learning Not to Reconstruct Anomalies

我们提出了一种训练机制,目的是鼓励AE在不考虑输入的情况下只重建正常数据。这意味着即使数据包含异常,网络也将学习生成正常重建。

下面公式 表示生成 伪异常,N --》normal,P--》pseudo anomalies, E指生成伪异常的方式

![]()

对于伪异常的输入,进行的损失计算:

那么总的损失就分为:(训练时以概率p 生成伪异常, 1-p 为正常)

可以注意到,

和

都鼓励网络重建正常数据。具体地说,通过最小化关于

的

,网络试图消除伪异常生成器引入的扰动.

Generating Pseudo Anomalies

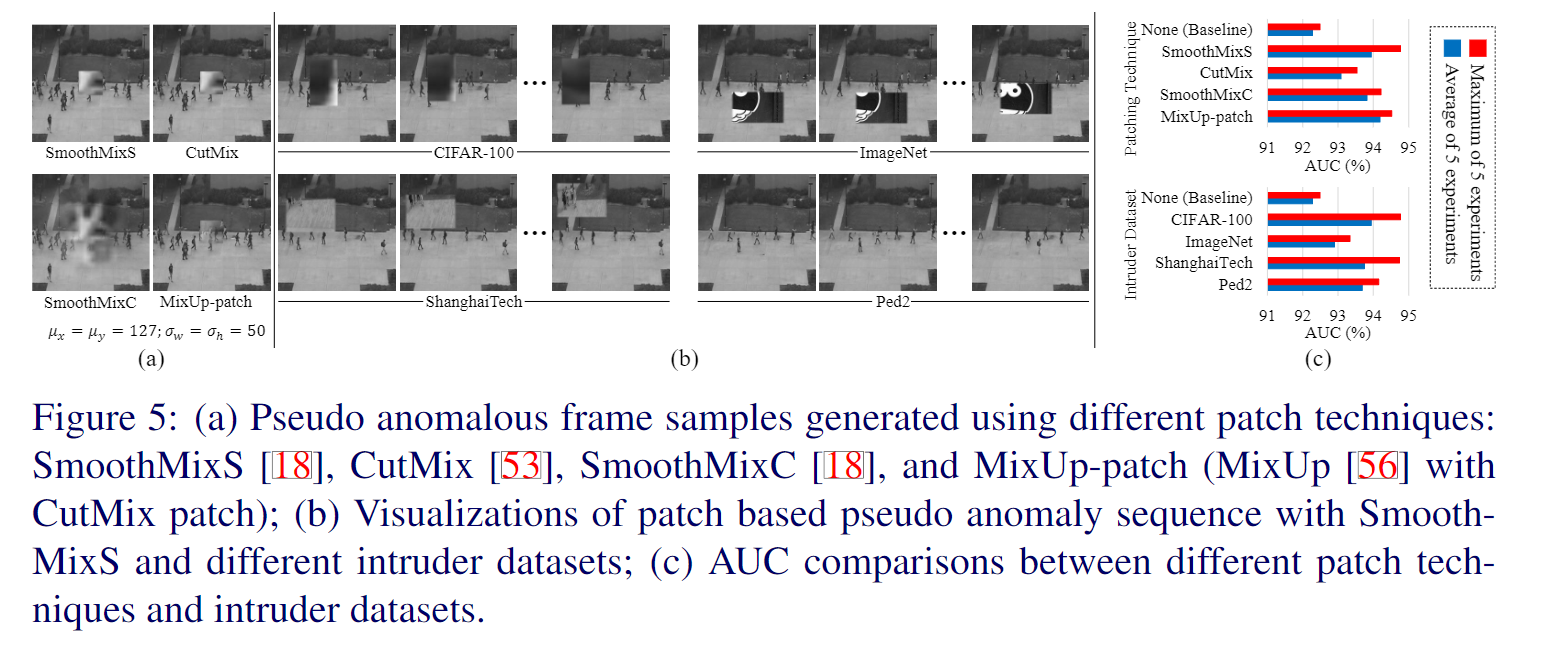

Patch Based Pseudo Anomalies

使用别的数据集的图像 以一定大小 覆盖在 原本的正常帧上 形成伪异常。

![]()

宽高 分别 ![]()

![]()

![]()

中心坐标 图像尺寸内随机选择

默认情况下,使用SmoothMix 放置每个面片,以平滑边界,防止网络锁定面片的边缘。

为了结合伪异常中的移动,序列中特定帧中的给定块的位置基于先前位置而改变:

![]()

后面 部分的 变化部分 在(![]() ) 一个超参数

) 一个超参数

Skip Frame Based Pseudo Anomalies

对于一个正常视频片段,对其中第一帧后面的每一帧 按照 +s 的长度去下一帧 形成跳跃帧 以至于生成异常片段

如下两公式

异常分数

使用PSNR(峰值信噪比)判断重建帧的质量,

对于分数 使用最大最小正则化

较高的值表示较高的重建误差

实验

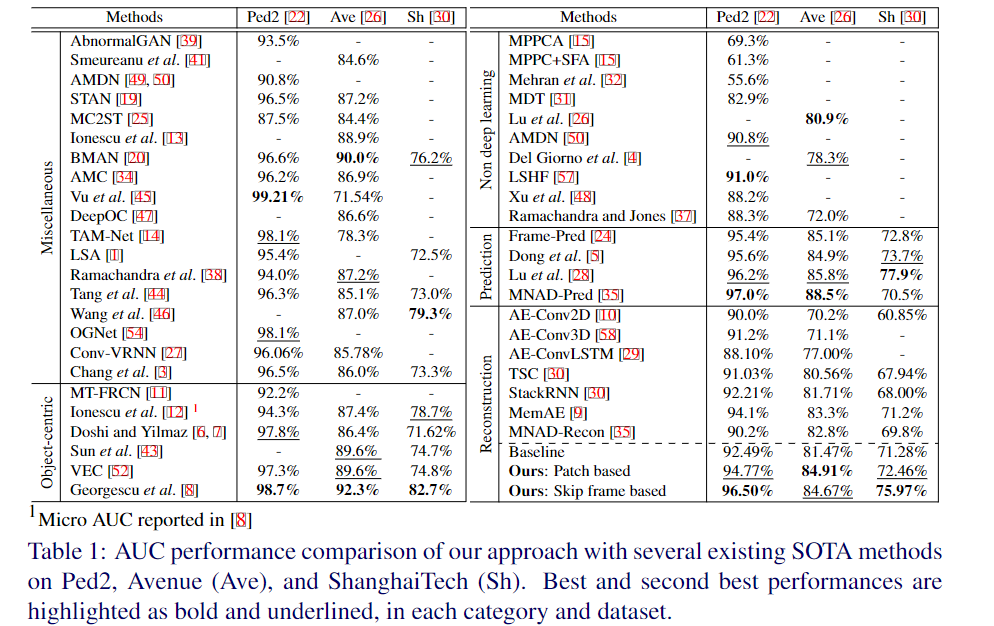

与SOTA 的对比

超参数的对比

1586

1586

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?