内容来自Andrew老师课程Machine Learning的第二章内容的Vectorization部分。

一、Vectorization(向量化)

后半部分内容摘自:原文链接

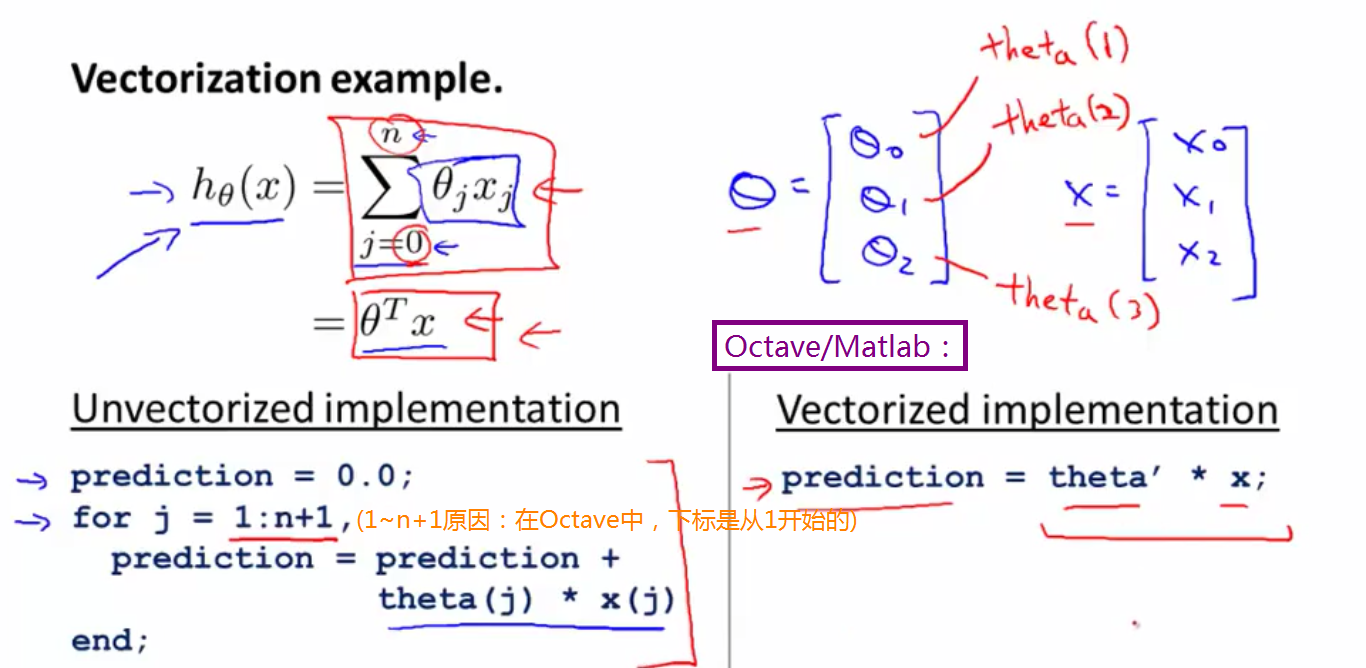

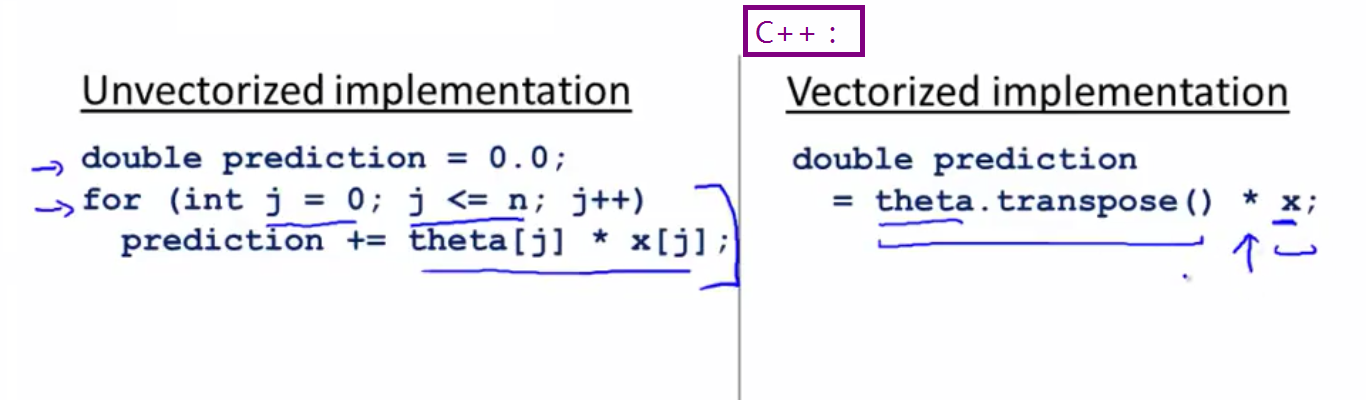

1、向量化示例,以h(x)为例,说明特征变量向量化:

2、将代价函数

含有多个特征变量的假设函数为:

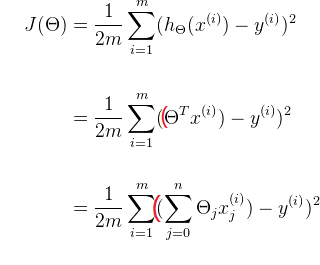

含有多个特征变量的代价函数为:

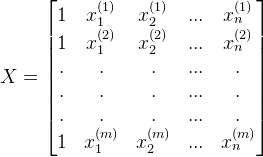

先看h(x)和theta:

将其代入h(x),则h(x)的向量表达式为:

又

将y和h(x)向量代入代价函数J,则

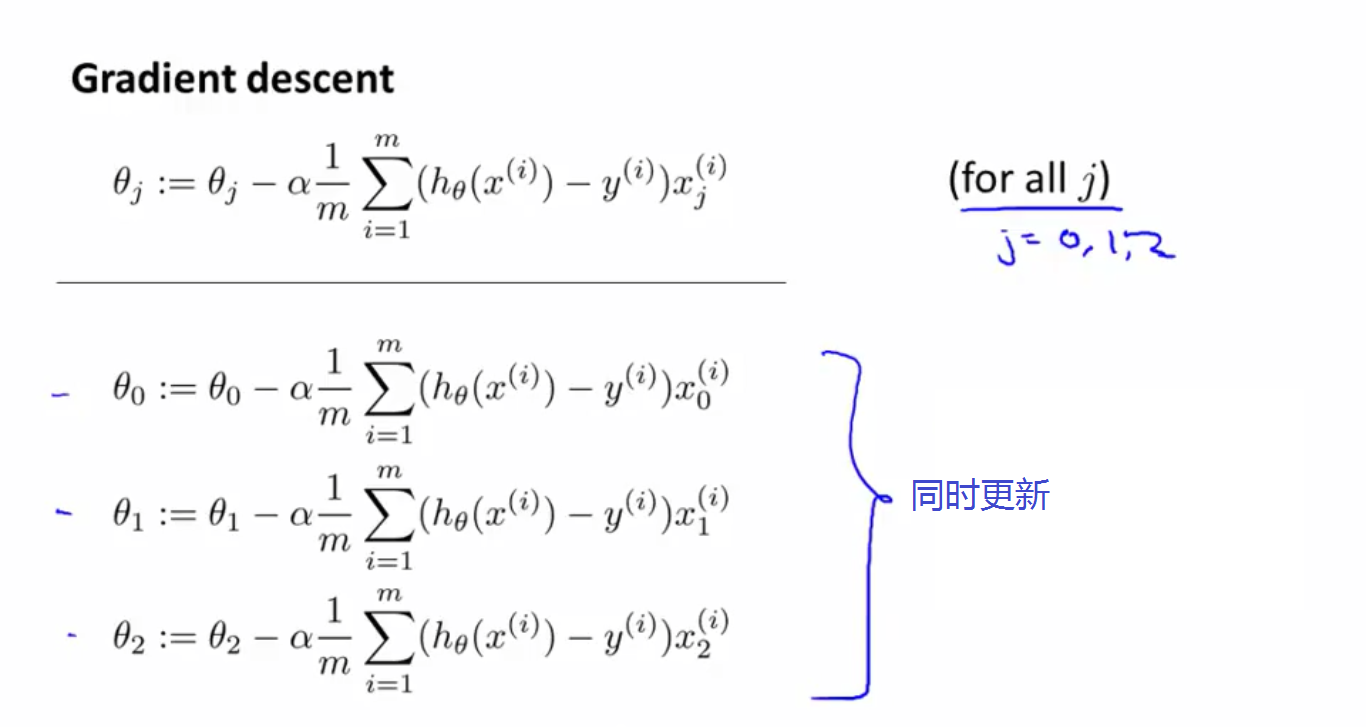

3、梯度下降算法:

将上述公式向量化:

将上述h(x)表达式和y表达式代入delta表达式,则

即

多个特征向量化,可以加快运算速度,尤其是对于特征量大的数据集效果更加明显。

1780

1780

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?