1. 使用modelscope魔塔进行微调和部署

1.1 环境

使用魔塔的GPU环境,新人用户可以有36小时的免费限额(GPU为24G)。

魔塔个人中心-》我的Notebook

1.2 微调

使用sft微调

modelscope有开源的大模型训练推理工具箱,支持LLaMA、千问、ChatGLM、BaiChuan等多种模型及LoRA等多种训练方式。

github地址:

https://github.com/modelscope/swift![]() https://github.com/modelscope/swift

https://github.com/modelscope/swift

github有时网速会受限,故我们使用 gitcode

https://gitcode.com/modelscope/swift/overview![]() https://gitcode.com/modelscope/swift/overview

https://gitcode.com/modelscope/swift/overview

1.2.1 安装swift

安装swift有如下三种方式

1.2.1.1 使用pip install 命令安装swift

# 全量能力

pip install ms-swift[all] -U

# 仅使用LLM

pip install ms-swift[llm] -U

# 仅使用AIGC

pip install ms-swift[aigc] -U

# 仅使用adapters

pip install ms-swift -U1.2.1.2 使用源代码安装swift

git clone https://github.com/modelscope/swift.git

cd swift

pip install -e .[llm]这种方式方便运行训练和推理脚本,需要注意的是此时,torch>=1.13。本文实验中采用源代码的方式进行安装。

1.2.2 微调

- 安装好swift后,使用如下命令进行微调:

CUDA_VISIBLE_DEVICES=0,1,2,3 swift sft --model_type qwen2-72b-instruct --dataset /root/autodl-tmp/data --num_train_epochs 5 --sft_type lora --output_dir output/qwen2-72b --per_device_eval_batch_size 8 --per_device_train_batch_size 8

--dataset参数是微调数据的数据集的名字或数据集存放的目录,采用lora微调方式

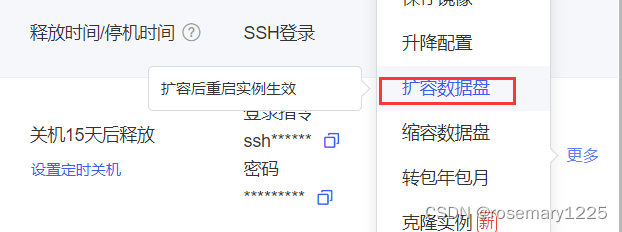

使用该命令时,swift脚本会去modelscope下载模型文件到家目录下的.cache目录中,如果使用autodl等算力平台的资源,系统盘一般只有50G,需要扩展硬盘,如下操作:

硬盘即使扩容,扩容的是autodl-tmp文件夹,需要将模型的下载保存目录修改到扩容的文件夹下。可通过如下命令改变模型的保存路径:

export MODELSCOPE_CACHE=/root/autodl-tmp/modelscope

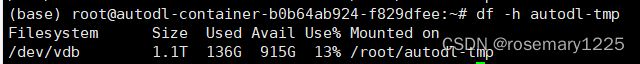

要保证模型存放的目录可以存放下模型,可以使用"df -h autodl-tmp"查看目录的使用情况(包括占用量和剩余量):

- 使用四张L20微调qwen2-72b(batch_size=4),显卡使用情况如下:

1.2.3 模型部署

用vllm部署模型,加快模型的推理速度。可以使用如下命令部署模型

CUDA_VISIBLE_DEVICES=1,2,3,4,5,6,7 swift deploy --ckpt_dir /home/user/workspace/swift/swift/output/qwen2-7b-instruct/v0-20240613-160202/checkpoint-140 --infer_backend vllm --max_model_len 4096 --merge_lora true

--merge_lora true :将lora微调后的参数与预训练的基模型进行合并。

附

question:

如果有知识库的知识,采用sft微调的方式,还是用langchain一类的工具调用本地知识库的方式好呢?

answer:

sft对某些私域知识的支持并不是很好,尤其是对于一个动态的知识库,sft的支持不如langchain。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?