BGR v.s RGB, NCHW v.s NHWC

在Opencv中:imread,imwrite and imshow 都是用的 BGR存储数据,储存类型用HWC储存

在PIL(python)库中,使用的是BGR存储数据,同时用的是HWC储存

在pytorch中,用PIL作为默认储存图片,但是会将BGR转化成RGB,储存方式是CHW

pytroch中的 torch.utils.data.DataLoader读取得到的数据是NCHW存储,并且用的RGB方式。

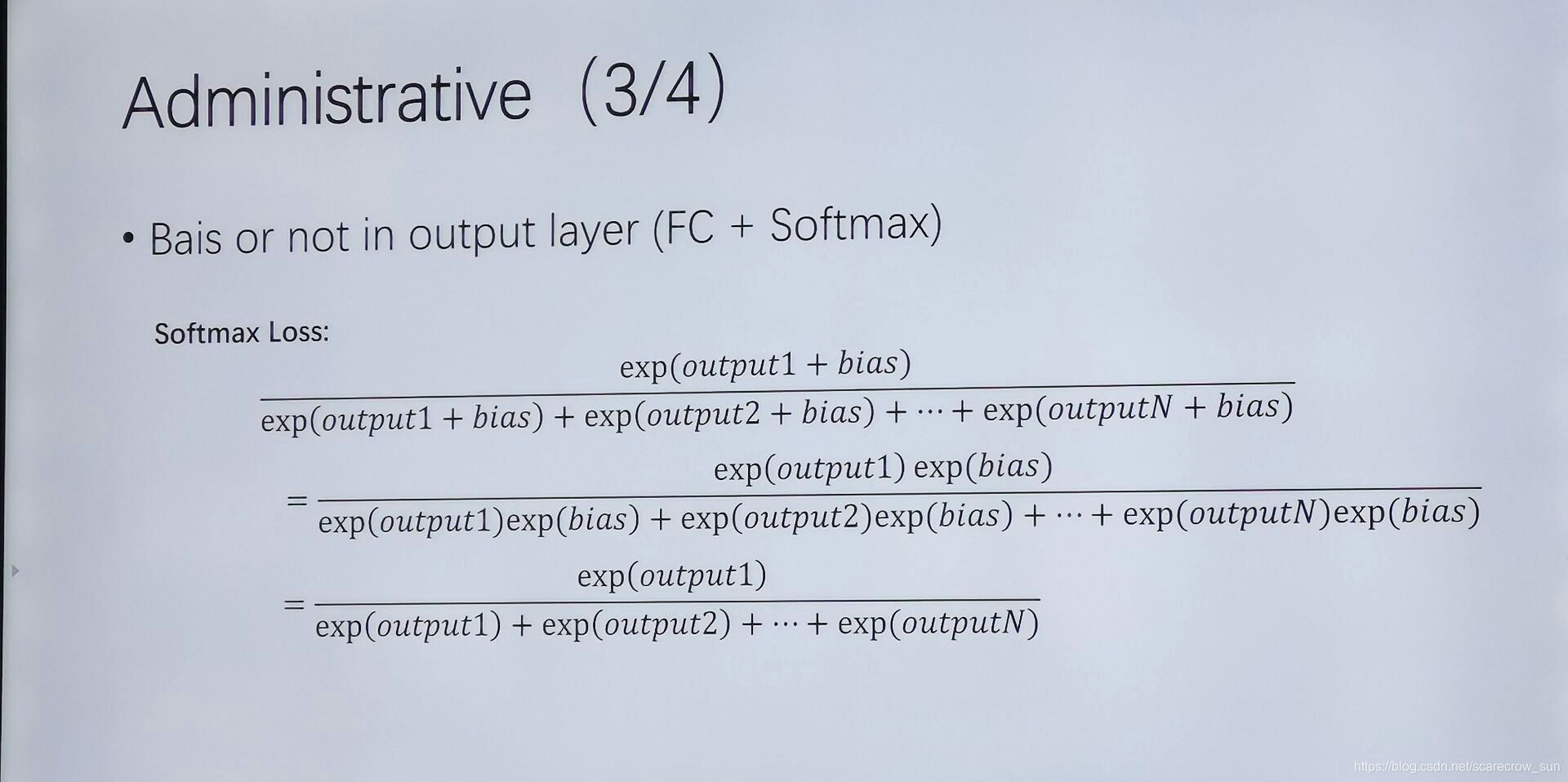

resnet50中最后一层是否要加bias偏置

在输出pytorch库中的resnet50的模型的时候,发现最后一层的全连接层中有一个bias偏置。

老师讲解的时候,在全连接层和Softmax时候,公式如下,最后可以发现bias全部被约去了,所以在最后一层是否加偏置bias都不影响最终结果的计算。

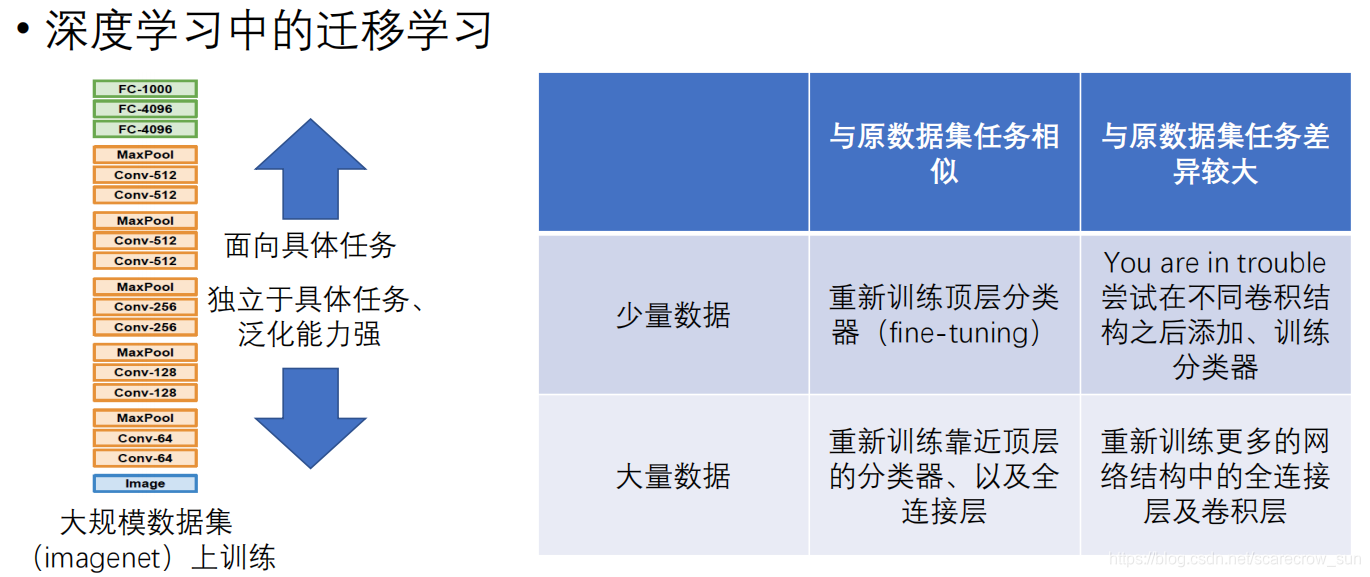

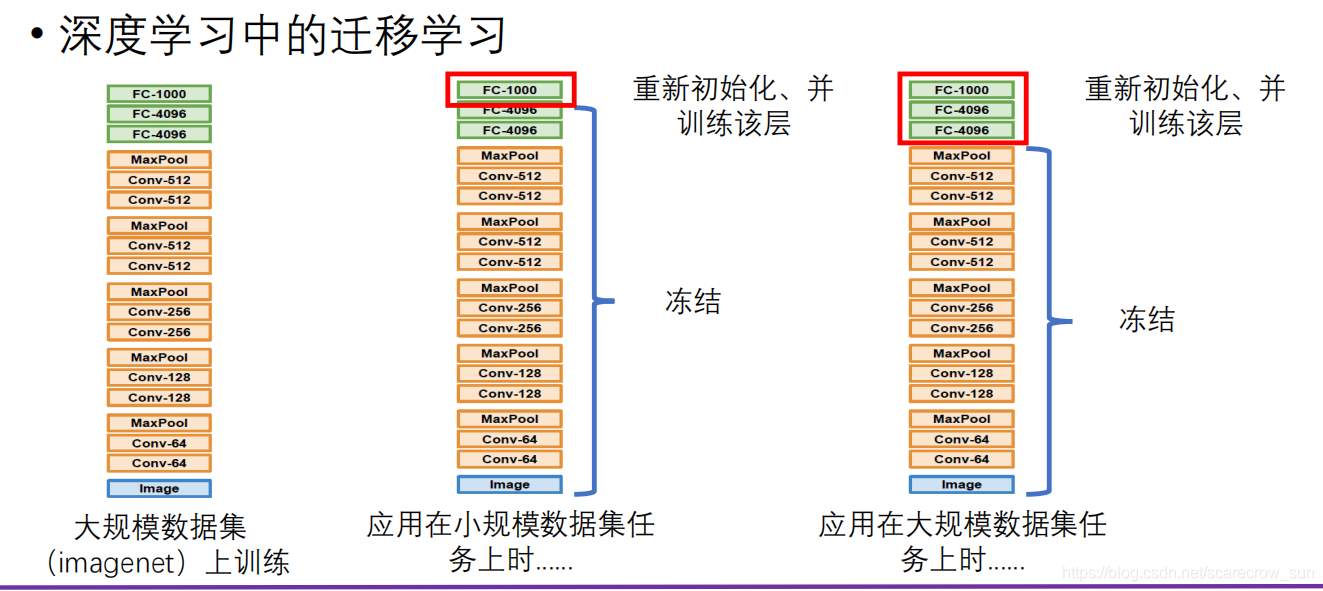

针对卷积网络模型的调参思路

从深度学习发展至今,其实没有一个明确的调参思路,不然现如今也不会有如此多的研究生苦于给深度学习模型调参,调参是一个漫长且痛苦的过程,但针对调参,是有一个大概的思路及其方向的。

一般来说有两个原则

- 越深一些的层,比较强调图像之间的共同特征,泛化能力强一些。

- 越浅一些的层,则比较面对于具体一些的任务,针对不同的任务之间的不同的特征,一般是浅层。

迁移学习应用到其他的地方的时候,一般有以下几个思路训练模型

5万+

5万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?