上一次说到代价函数,代价函数的作用就是找到最优的参数使假设函数与实际值相差最小。而梯度下降法(Gradient Descent)就是找到最优参数的方法之一。

一,算法思想

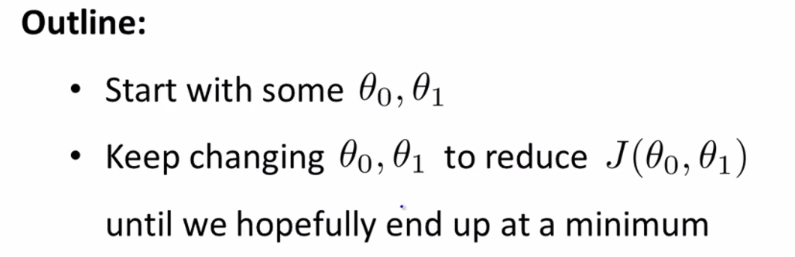

- 1.从参数的某一个(组)值开始,比如从θ0=0和θ1=0开始。

- 2.保持该(组)值持续减小,如果是一组值就要保证他们***同步更新***,直到找到我们希望找到的最小值。

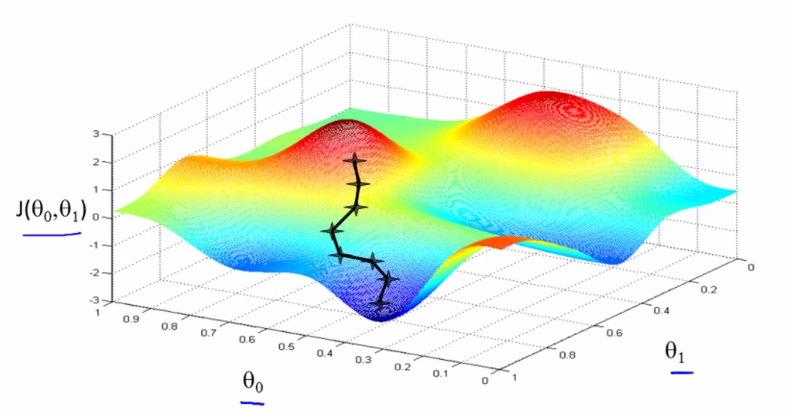

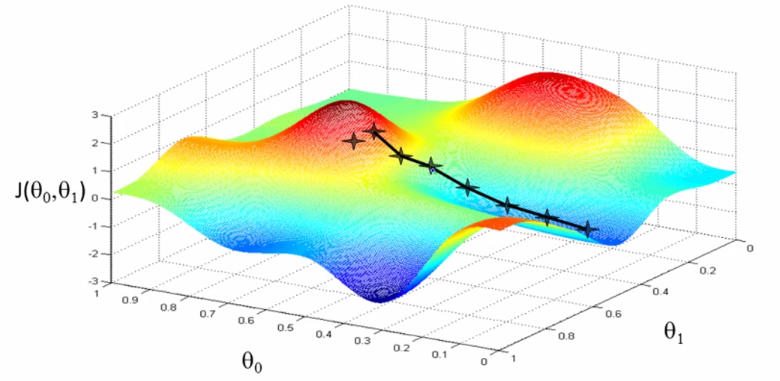

过程如图,就像下山一样,从一点开始,找到最快的方法下山到最低点,在你不会摔倒的情况下,你会怎么选择下山路径呢,肯定是选择梯度最大(也就是坡度最大)的路径。这就是梯度下降法的精髓。

而梯度下降法还有一个特点就是可能因为起点不同而找到完全不同的最低点。

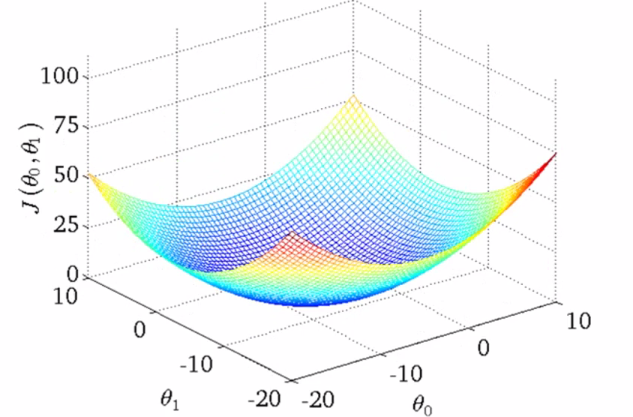

事实证明,用于线性回归的代价函数都是凸函数,就像图中一样:

所以不会出现这样不同的局部最低点,都会收敛于一个最低点。

二,更新规则

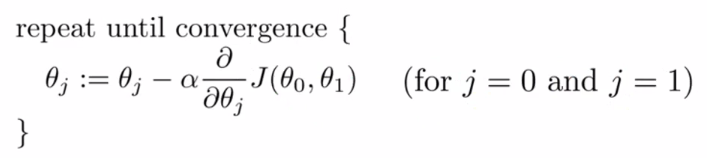

在梯度下降法中,为了使代价函数更加容易找到最小值,我们使用以下更新规则:

α为学习速率,学习速率需要控制,不能过大也不能过小。太小了很好理解,这就会使得更新次数过大,找到最低点时间过长;而太大

本文详细介绍了梯度下降法的算法思想、更新规则,特别是批量梯度下降法在多特征线性回归中的应用。通过解释如何找到代价函数的最小值,以及同步更新的重要性,帮助理解这一机器学习中关键的优化方法。

本文详细介绍了梯度下降法的算法思想、更新规则,特别是批量梯度下降法在多特征线性回归中的应用。通过解释如何找到代价函数的最小值,以及同步更新的重要性,帮助理解这一机器学习中关键的优化方法。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3803

3803

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?