最近Kimi和DeepSeek V2火爆中国科技圈,你有没有想过自己动手尝试使用它们做点有趣的事情?例如翻译文章、总结Youtube视频、总结文章、提取知识、制作思维导图等等?并且把这些知识保存到自己的知识库里?

话不多说,我们直接进入正题。

首先,你需要下载MiX Copilot。MiX Copilot是一个高效的AI工作台,旨在提升您的工作和思考效率。它集成了多LLM和Agent交互框架,能够自动爬取网页数据、RSS、arXiv论文和Youtube视频,让你轻松接入最新信息和学术资源。借助强大的AI分析和翻译功能,MiX Copilot帮你在信息海洋中快速找到珍贵资料,跨越语言障碍。更有多Tab机制和丰富的自定义选项,支持并行任务处理和个性化设置,让你的工作流更加流畅高效。下载链接是:https://www.mix-copilot.com/,也可以看下方的保姆级教程。

第二,设置对应的API

获取对应API Key。

Kimi的链接是https://platform.moonshot.cn/console/api-keys

DeepSeek-V2的链接是https://platform.deepseek.com/api_keys

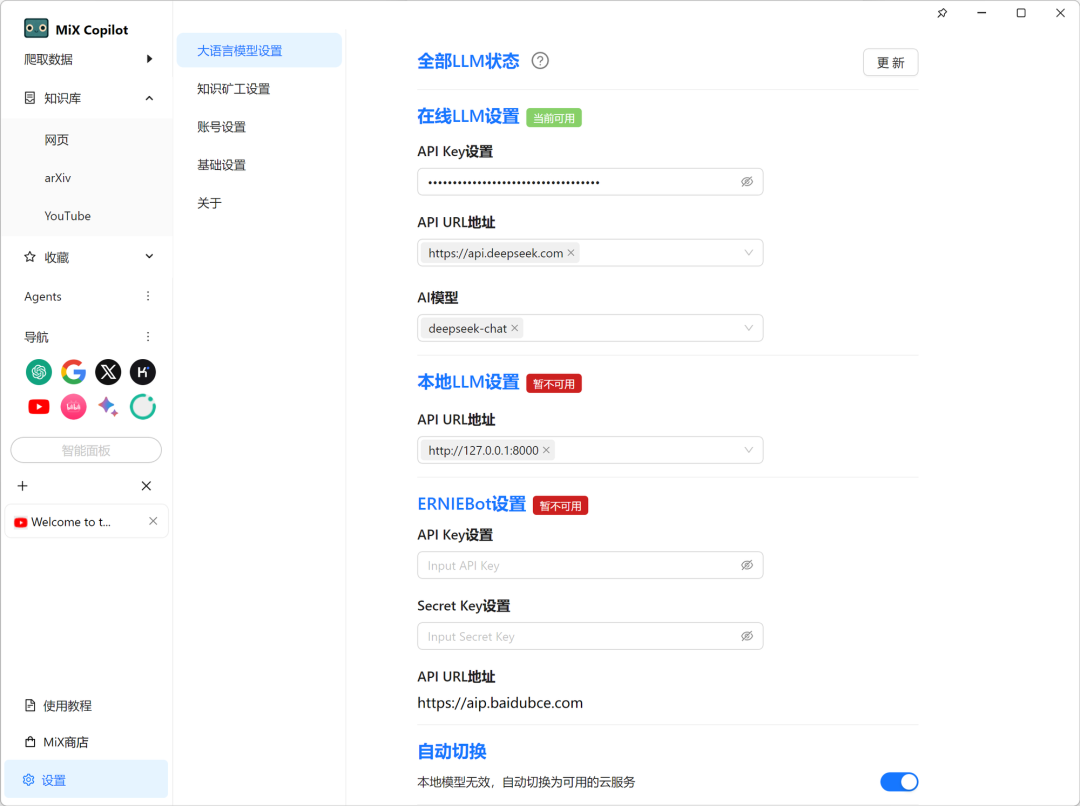

2. 打开MiX Copilot设置→LLM设置页面

3. 在API EndPoint URL填写Kimi链接:https://api.moonshot.cn ,或者DeepSeek-V2链接:https://api.deepseek.com

4. 填写API Key(很长的字符串,例如fk198550-qSymly…)

5. 在AI模型填写模型,kimi的模型分别是moonshot-v1-8k、moonshot-v1-32k、moonshot-v1-128k,DeepSeek-V2的模型是deepseek-chat

6. 点击“更新”,出现“当前可用”说明连接成功。

PS. DeepSeek-V2是100w Tokens/元,具有32k上下文长度,注册立即获得500w Tokens,非常值!

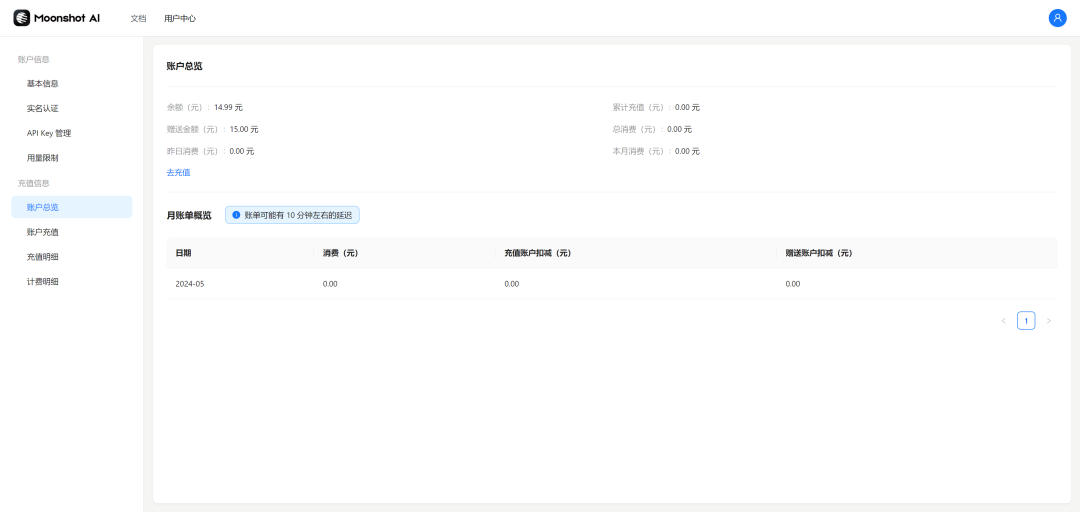

而Kimi注册即送15元代金券

模型的价格如下:

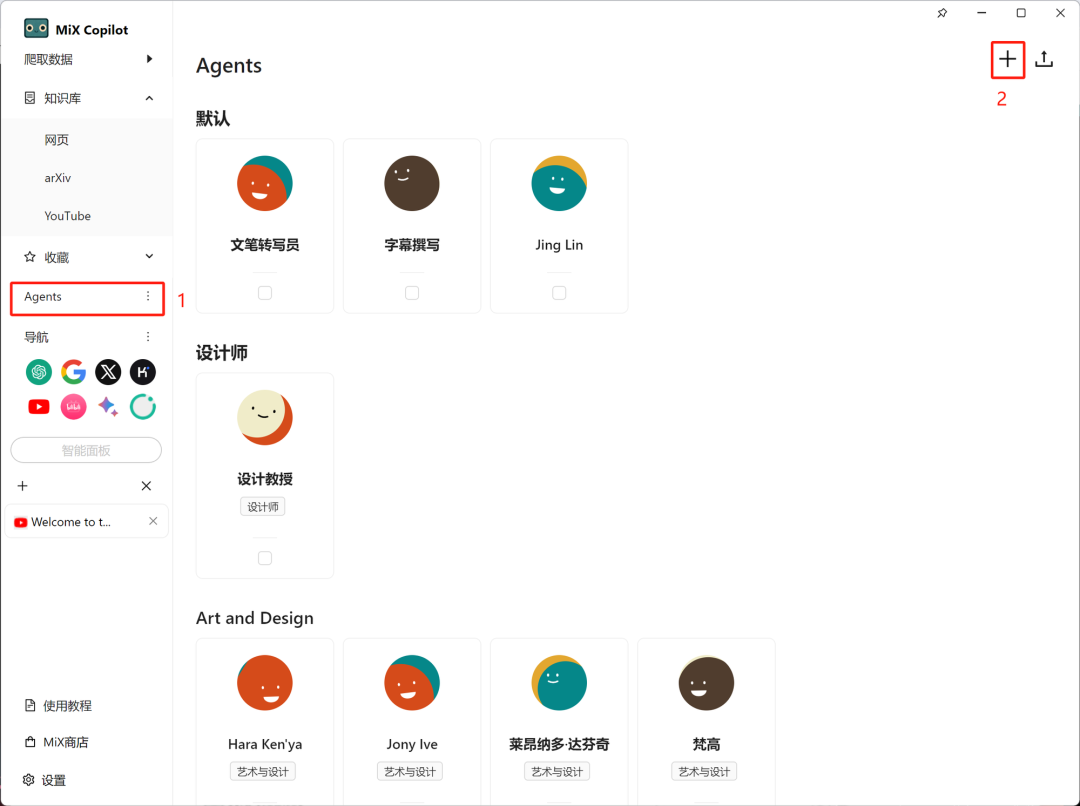

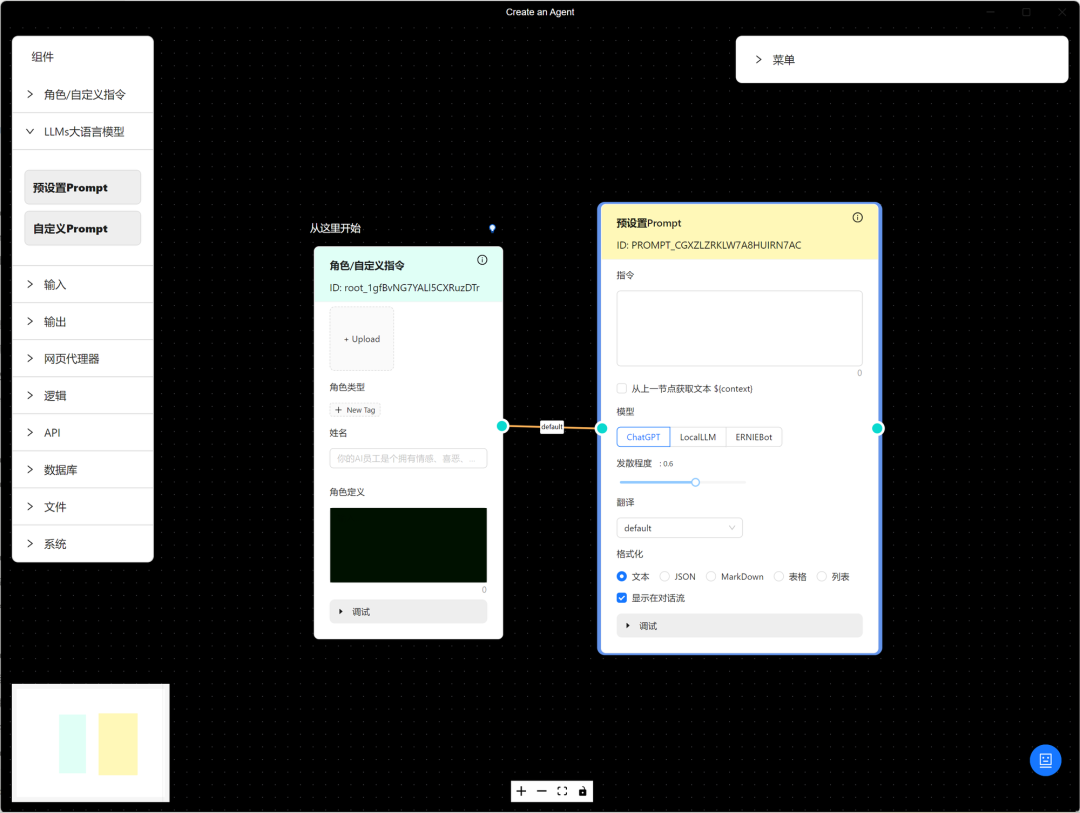

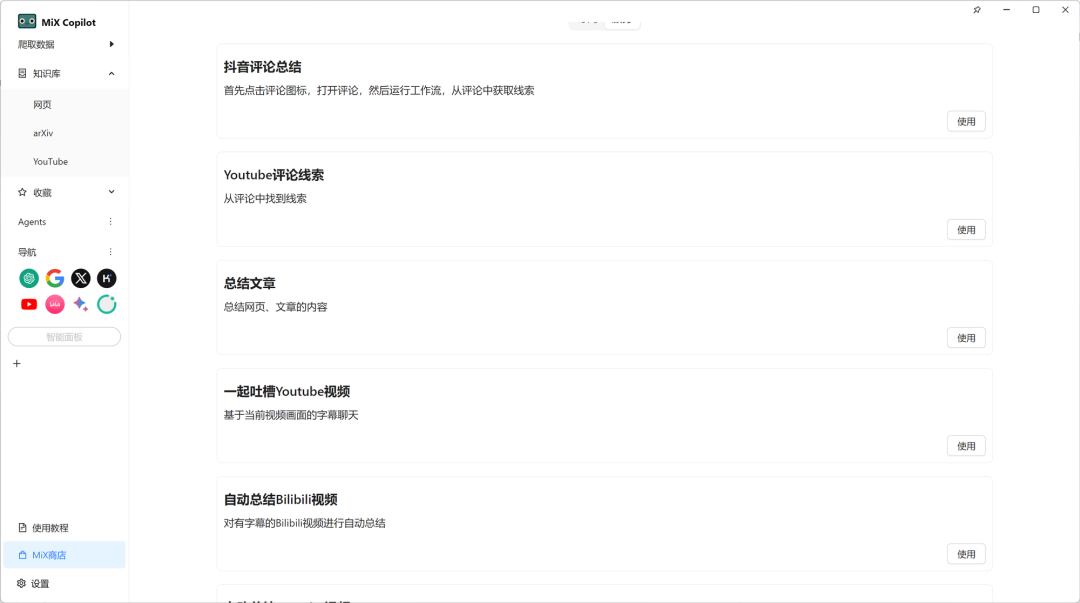

第三,制作Agent,可以点击Agents→创建Agent

最后,如果你想使用我们已经制作好的Agent,可以看下方教程申请试用一个月。

(保姆级)MiX Copilot 3.5 下载、安装和申请试用教程

申请试用名额

备注:社群

398

398

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?