- VC dimension

- Model selection

- cross validation

- feature selection

- Bayesian statistics

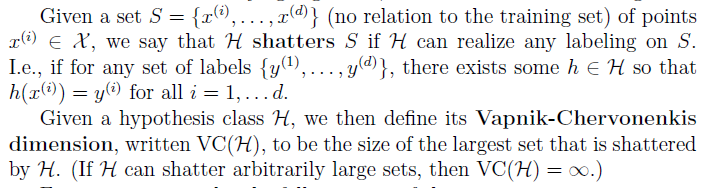

1.VC dimension

概念:

所需要的训练样本的个数m近似线性于H的参数个数。

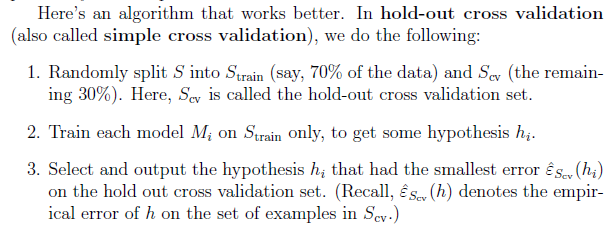

2.Model selection

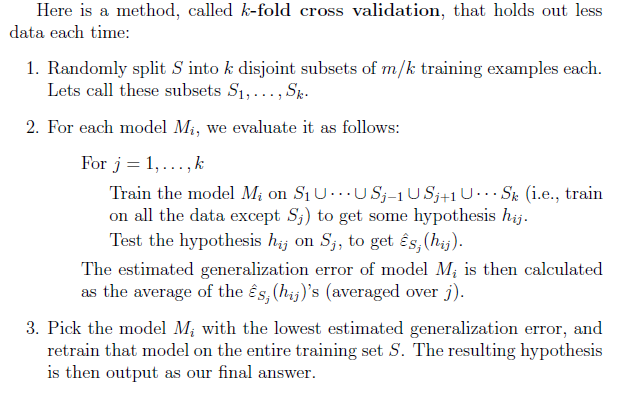

2.1cross validation

当k=m时,称作leave-one-out cross validation.

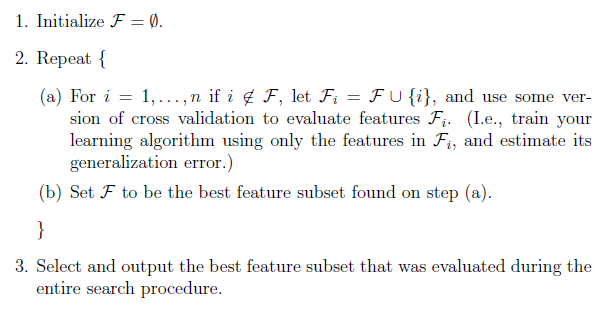

2.2feature selection

实际上,输入变量太多n远大于m时,容易出现过拟合现象,可以通过筛选有用输入特征的方法减少输入特征。可以使用forward search方法:

结束条件可以设置为需要保留的特征个数。类似的,其实条件为F={1,2,…,n}时,逐个减少特征的方法叫做backward search。

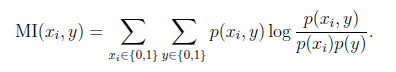

上述方法计算量大,另外一种启发式算法Filter feature selection计算量小。该方法可以通过计算互信息量mutual information,通过比较该值的大小来筛选有用特征。

根据互信息量大小对特征进行排序后,通常可以使用cross validation确定具体需要的特征个数k。

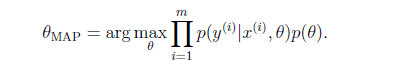

3.Bayesian statistics and regularization

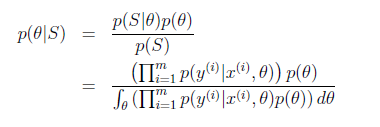

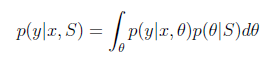

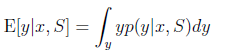

在贝叶斯观点下,参数

θ

是一个随机变量,在该假设下对y进行估计,计算y的期望就是y的估计值:

实际应用中,对

θ

的积分不好计算,因此我们选择特定的

θ

进行代替,那么得到:

可见该假设下的估计与最大可能性估计很相似,不同的是多了

p(θ)

,正是由于这一项的差异,当我们假设

θ

服从0均值高斯分布时,得到的参数norm值更小,因此不会像最大可能性方法一样容易过拟合。

682

682

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?