【备注】从langchain-chatchat v0.3开始,所有的模型配置,均由推理模型(如:xinference )进行加载和启动。

xinference 中配置并启动模型

1、查看支持的模型

xinference registrations --model-type LLM2、执行transformer推理

xinference launch --model-name custom-glm4-chat --model-format pytorch --model-engine Transformers【备注】可以用-u自定模型的uid名字

xinference launch --model-name custom-glm4-chat -u glm4-chat --model-format pytorch --model-engine Transformers4、启动xinference 的命令行方式对话

xinference chat --model-uid glm4-chat3、配置embedding

执行如下命令加载并执行embedding模型

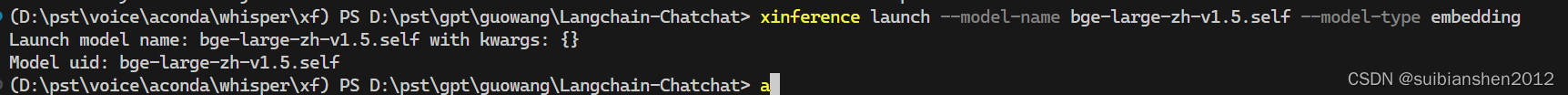

xinference launch --model-name bge-large-zh-v1.5 --model-type embeddingxf配置参考: bge-large-zh-v1.5 — Xinference

embedding模型下载:bge-large-zh-v1.5 · 模型库 (modelscope.cn)

出现如下提示,表示执行成功

【备注】可以用-u指定模型的uid名字

xinference launch --model-name bge-large-zh-v1.5.self -u bge-large-zh-v1.5 --model-type embedding

1947

1947

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?