《Going Deeper with Convolutions》论文解读

本文提出了GoogLeNet的网络结构,在ILSVRC2014取得了最好的成绩。本文和Network In Network一样,对网络中的传统卷积层进行了修改,提出了被称为Inception的结构。

Motivation

提高深度神经网络性能的关键在于增加深度和宽度。但是大的网络存在3个主要问题:发生过拟合,计算资源不足,稀疏的数据结构带来计算性能低下。

Inception

本文修改了传统的卷积层,提出了被称为Inception的结构。

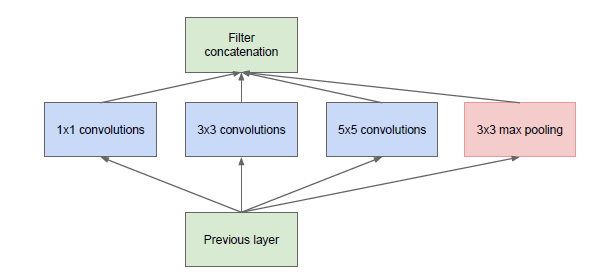

Inception module的提出主要考虑多个不同size的卷积核能够hold图像当中不同cluster的信息,为方便计算,paper中分别使用1*1,3*3,5*5,同时加入3*3 max pooling模块。

文章指出这种naive的结构存在着问题:每一层Inception module的输出的filters将是分支所有filters数量的和,经过多层之后,最终model的数量将会变得巨大,naive的inception会对计算资源有更大的依赖。

根据Network-in-Network模型,1*1的卷积能够有效进行降维,所以文章提出了Inception module with dimension reduction,在不损失模型特征表示能力的前提下,尽量减少filters的数量,达到减少model复杂度的目的:

本文详细解读了GoogLeNet网络结构,重点介绍了Inception模块的设计原理,通过1*1卷积进行维度降低,解决大网络带来的计算资源需求。GoogLeNet在ILSVRC2014比赛中表现出色,取得6.67%的误差率,展示了深度学习中增加网络深度和宽度的有效性。

本文详细解读了GoogLeNet网络结构,重点介绍了Inception模块的设计原理,通过1*1卷积进行维度降低,解决大网络带来的计算资源需求。GoogLeNet在ILSVRC2014比赛中表现出色,取得6.67%的误差率,展示了深度学习中增加网络深度和宽度的有效性。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?