ollama是大模型部署方案,对应docker,本质也是基于docker的容器化技术。

从前面的文章可以看到,部署大模型做的准备工作是比较繁琐的,包括各个环节的版本对应。ollama提供了一个很好的解决方案。

ollama主要针对主流的LLaMA架构的开源大模型设计,并且已被LangChain、Taskweaver等在内的多个热门项目高度集成。同时ollama提供了openAI兼容的api,可以最大限度的减少理解和开发成本。

一、下载安装ollama

1.1 安装

官方地址:https://ollama.com/

开源地址:https://github.com/ollama/ollama

下载后双击安装:

一路下一步即可。

1.2 检验

ollama安装后默认已经启动,我们可以通过访问其提供的api服务来进行检验。

参考官方文档:ollama的api · ollama/ollama · GitHub

这里运行ollama的机器为windows系统, ip为192.168.3.154。

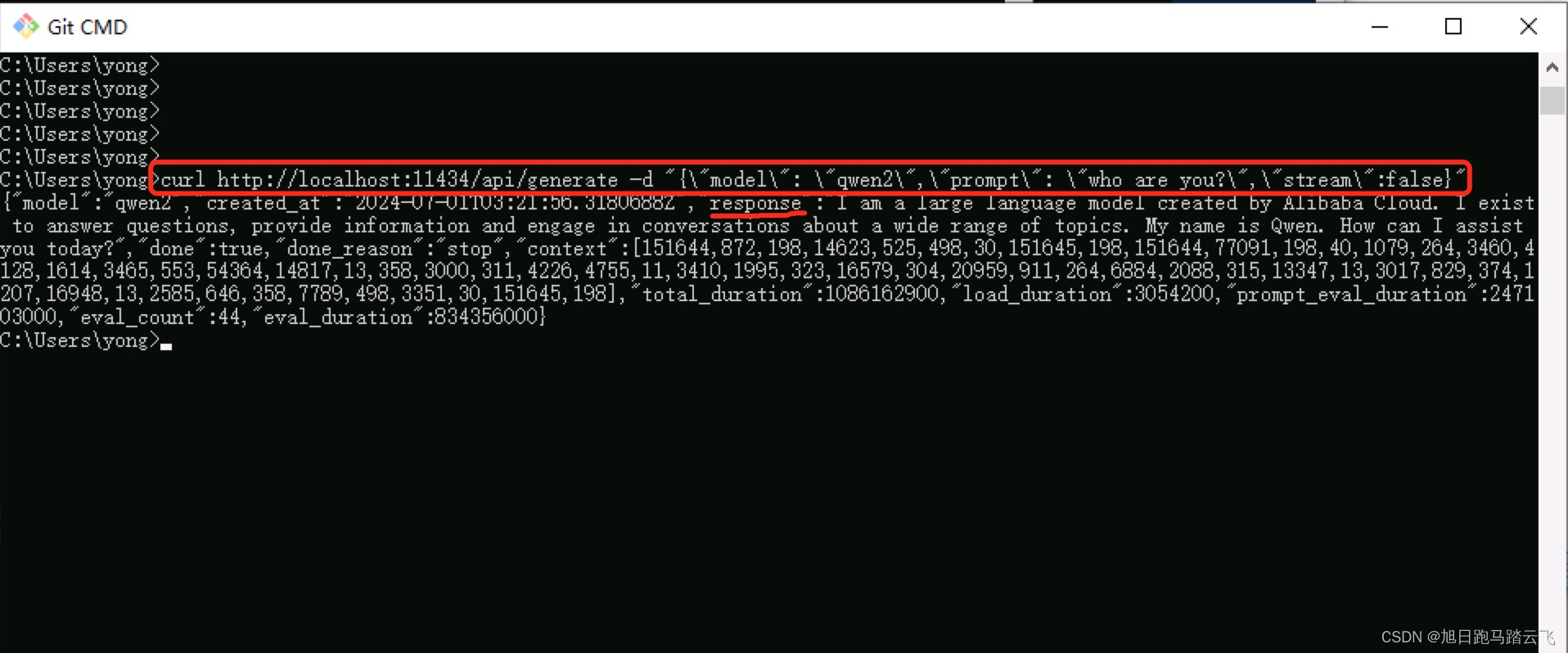

1.2.1 通过localhost检验

运行命令:

> curl http://localhost:11434/api/generate -d "{\"model\": \"qwen2\",\"prompt\": \"who are you?\",\"stream\":false}"查看结果:

这里注意两点:

1、不要使用PowerShell(里面的curl参数不一样),使用 cmd 或者 git Cmd 。

2、注意参数的引号,通过斜杠 \ 来转义。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?