深度学习优化函数详解系列目录

深度学习优化函数详解(0)– 线性回归问题

深度学习优化函数详解(1)– Gradient Descent 梯度下降法

深度学习优化函数详解(2)– SGD 随机梯度下降

深度学习优化函数详解(3)– mini-batch SGD 小批量随机梯度下降

深度学习优化函数详解(4)– momentum 动量法

深度学习优化函数详解(5)– Nesterov accelerated gradient (NAG)

深度学习优化函数详解(6)– adagrad

深度学习优化函数详解(7)– adadelta

深度学习优化函数详解(8)– adam

后面两篇文章代码已经写完了,文章一直懒得写,等有空再补上吧。。。

本系列的全部代码在这里:https://github.com/tsycnh/mlbasic 喜欢的同学记得给个star哦~

序

在做一些深度学习的算法的时候,都会用到优化函数,在各种成熟的框架中,基本就是一行代码的事,甚至连默认参数都给你设置好了,基本不用动什么东西,最后也会有比较好的优化结果。但是对于优化函数这么核心,这么基本的东西总是模棱两可实在不应该。于是想自己把一些常用的优化函数从原理上搞清楚,所以才有了这个系列的文章。每一篇文章都有配套的python代码,文末会给出地址。

线性回归问题(Linear Regression)

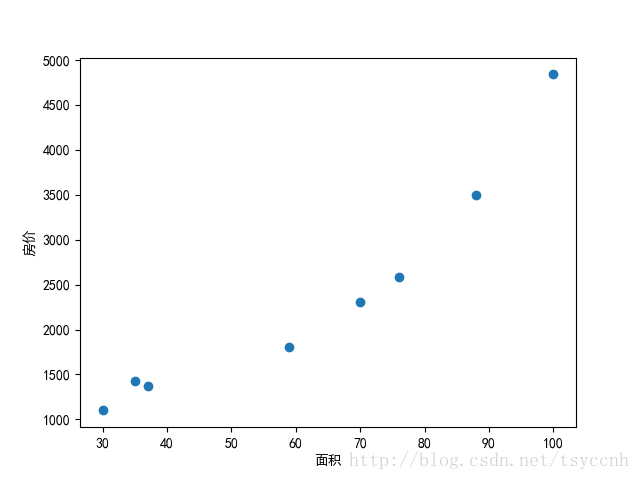

假设我们有一组数据,是一些房子的面积和价格。如下

| 面积 | 30 | 35 | 37 | 59 | 70 | 76 | 88 | 100 |

|---|---|---|---|---|---|---|---|---|

| 价格 | 1100 | 1423 | 1377 | 1800 | 2304 | 2588 | 3495 | 4839 |

用这些数据我们可以在坐标系中绘制出一系列散点

我们所想要解决的问题,就是给出任意的一个面积,预测对应的房价。 所以这是一个预测问题。也就是回归问题。

这里我们用最简单的线形模型来做房价预测。那么这个问题也可以称之为线性回归问题。

线形模型简单来说就是直角坐标系中的一根线,用

本文深入探讨了线性回归问题在深度学习中的应用,介绍了如何使用优化函数逐步减小损失,以更准确地预测房价。文章讨论了均方差作为损失函数,并预告了后续将详细讲解的多种优化算法,包括Gradient Descent、SGD等。配套Python代码可在GitHub找到。

本文深入探讨了线性回归问题在深度学习中的应用,介绍了如何使用优化函数逐步减小损失,以更准确地预测房价。文章讨论了均方差作为损失函数,并预告了后续将详细讲解的多种优化算法,包括Gradient Descent、SGD等。配套Python代码可在GitHub找到。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1617

1617

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?