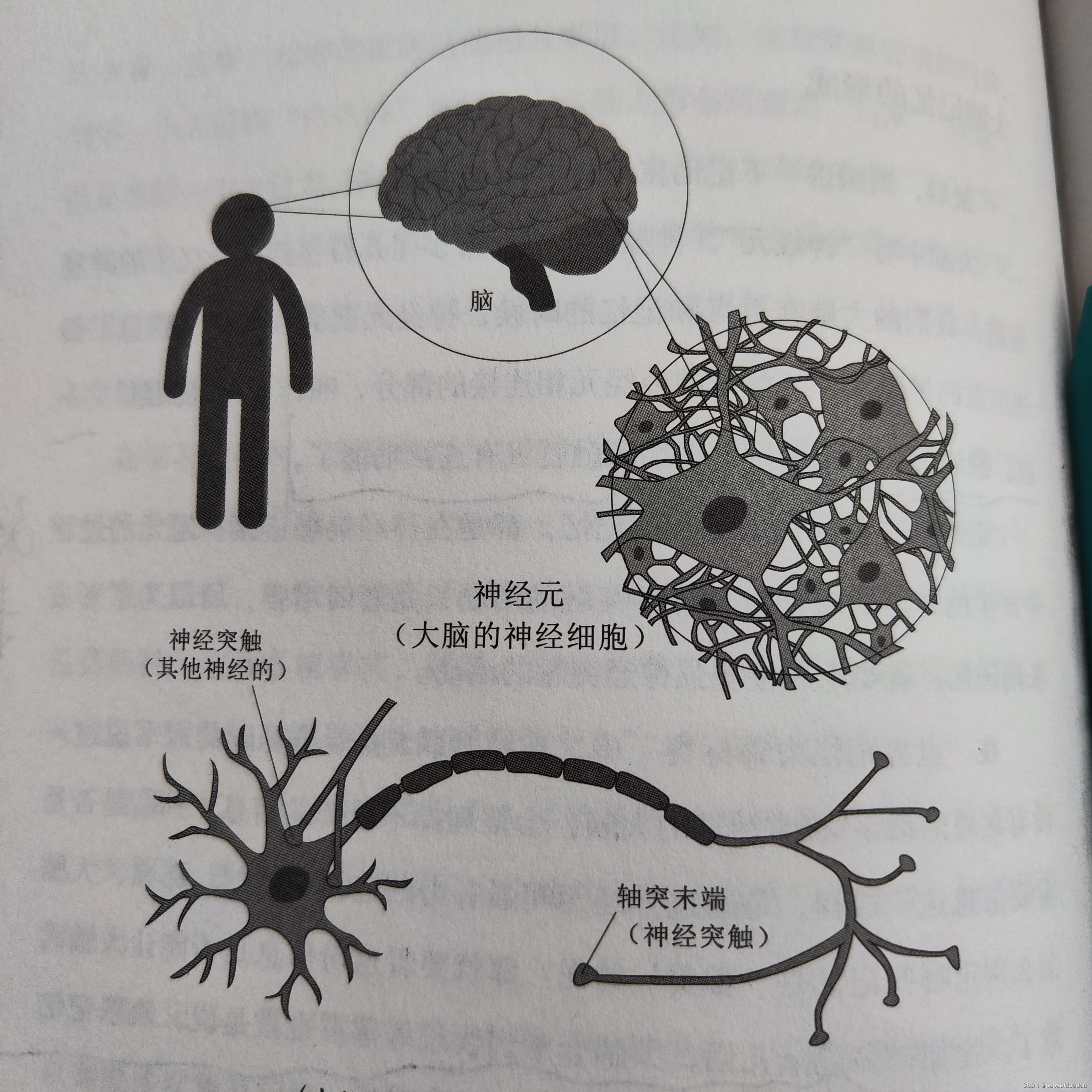

从仿生学的角度看,神经网络结构和大脑非常相似,大脑中的神经元有几百亿到几千亿个,我们的大脑在思考和记忆的时候,神经元就会互相传递信息,传递信息的神经元,与旁边的神经元相互连接的部分,叫做“神经突触”,大脑老化后,神经突触就没有连接功能了。

无论是短期记忆还是长期记忆,都是在神经突触连接神经元的过程中产生的,但是短期记忆神经突触的活动只是暂时增强,所以为了形成长期记忆,就要永久性增强神经突触的活动。

神经网络也是将各个独立的数据节点通过权重线连接在一起,充当数据节点之间突触的功能,在全连接网络中,每一个下级节点和上级的所有节点均有连接,以下图为例,一张图片上的所有像素点会被展开成一个1维向量输入网络,28 x 28的输入数据被展开成为784 x 1 的数据作为输入,其结构,简单示意图如下:

神经网络的关键是中间的连线,而不是节点,工作时,上一层的激活值将决定下一层的激活值,所以,神经网络的核心在于,一层激活值是通过怎样的运算,算出下一层激活值的,某种程度上是模仿的生物大脑的工作机制。某些神经元的激发,会触发另一些神经元的激发。当被训练好之后,就可以识别固定的模式了。

简单来说,第一层的输入图形会导致第二层的某种图形模式,然后继续触发第三层,第四层。。。,直到最后一层。有点类似于链式反应,不过链式反应无法控制,速率越来越快,但神经网络最终都会收敛到一个或者几个有意义的结果输出。

神经网络比较数学化的描述:

单个神经元的原理如下:

数学原理如下:

![]()

f一般取sigmoid函数&#

神经网络的结构,简单示意图如下:神经网络的关键是中间的连线,而不是节点.数学原理如下:Size 28*28的图片含有像素点784各,构成输入向量假设第一层的第i个节点对第二层的j的节点的权重为: 则 传递矩阵为:W矩阵第一维代表后层的节点,第二维标识前层的节点....

神经网络的结构,简单示意图如下:神经网络的关键是中间的连线,而不是节点.数学原理如下:Size 28*28的图片含有像素点784各,构成输入向量假设第一层的第i个节点对第二层的j的节点的权重为: 则 传递矩阵为:W矩阵第一维代表后层的节点,第二维标识前层的节点....

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1592

1592

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?