效果图

无图无真相,以下是运行截图,

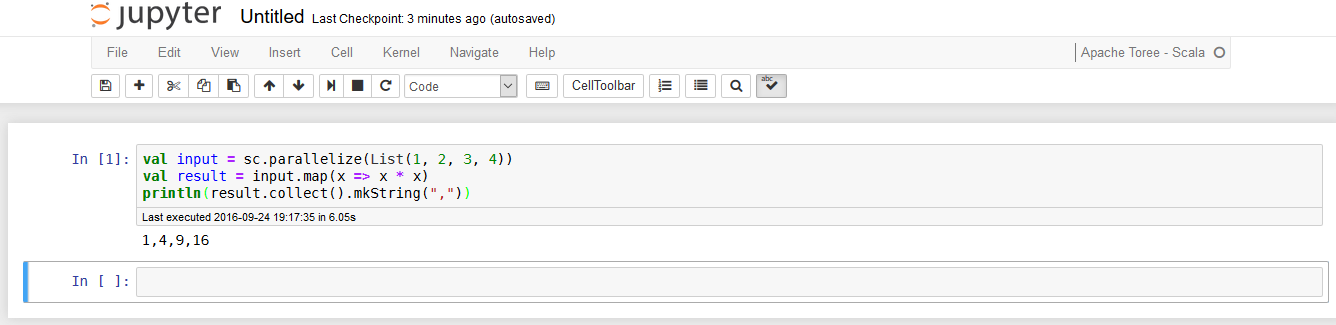

Jupyter运行界面:

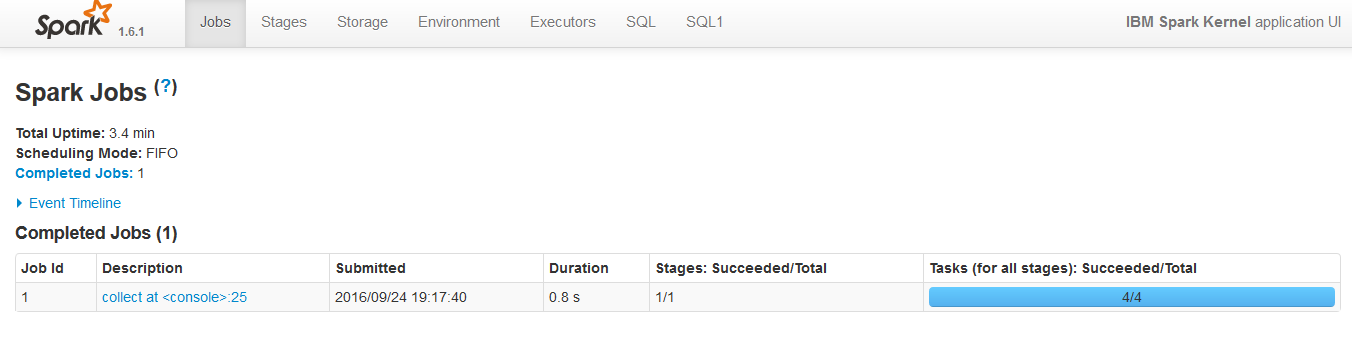

作业监控界面:

简介

为Jupyter配置Spark开发环境,可以安装全家桶–Spark Kernel或Toree,也可按需安装相关组件。

考虑到一般人更喜欢一步到位,并且Toree将会代替Spark Kernel,故直接且仅需安装Toree即可,不过下面还是给出了所有的安装方法。

Spark Kernel的安装

参照Spark Kernel支持的语言,安装好Spark Kernel后,其默认可以支持Scala,Python,R,SQL,对应的Spark实现分别是Scala with Spark,Python with PySpark,R With SparkR,

本文介绍了如何为Jupyter配置Spark开发环境,包括安装Spark Kernel和Toree两个项目,以及单独安装Scala Kernel和PySpark的步骤。通过这些配置,用户可以在Jupyter中支持Scala、Python、R和SQL等语言进行Spark开发,并使用Jupyter监控Spark作业。

本文介绍了如何为Jupyter配置Spark开发环境,包括安装Spark Kernel和Toree两个项目,以及单独安装Scala Kernel和PySpark的步骤。通过这些配置,用户可以在Jupyter中支持Scala、Python、R和SQL等语言进行Spark开发,并使用Jupyter监控Spark作业。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1557

1557

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?