函数:class torch.nn.Linear(in_features,out_features,bias = True)

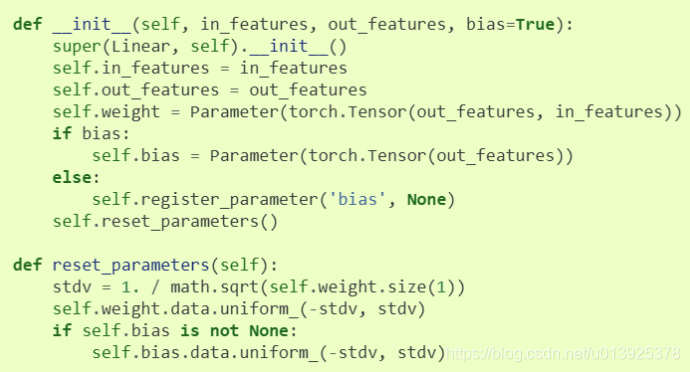

源码:

从init函数中可以看出Linear中包含四个属性:

1)in_features: 上层神经元个数【每个输入样本的大小】

2)out_features: 本层神经元个数【每个输出样本的大小】

3)weight:权重,形状[out_features , in_features]

4)bias: 偏置,形状[out_features]。网络层是否有偏置,默认存在,且维度为[out_features ];若bias=False,则该网络层无偏置,图层不会学习附加偏差。

示例说明:

import torch

x = torch.randn(128, 20) # 输入的维度是(128,20)

m = torch.nn.Linear(20, 30) # 20,30是指维度

output = m(x)

print('m.weight.shape:\n ', m.weight.shape)

print('m.bias.shape:\n', m.bias.shape)

print('output.shape:\n', output.shape)

# ans = torch.mm(input,torch.t(m.weight))+m.bias 等价于下面

ans = torch.mm(x, m.weight.t()) + m.bias

print('ans.shape:\n', ans.shape)

print(torch.equal(ans, output))

输出:

m.weight.shape:

torch.Size([30, 20])

m.bias.shape:

torch.Size([30])

output.shape:

torch.Size([128, 30])

ans.shape:

torch.Size([128, 30])

True

output.size()=矩阵size(128,20)*矩阵size(20,30)=(128,30)。

本文详细解析了PyTorch中Linear层的工作原理,包括其参数设置、权重和偏置的作用,以及如何通过实例演示Linear层的前向传播过程。

本文详细解析了PyTorch中Linear层的工作原理,包括其参数设置、权重和偏置的作用,以及如何通过实例演示Linear层的前向传播过程。

591

591

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?