作者:禅与计算机程序设计艺术

1.简介

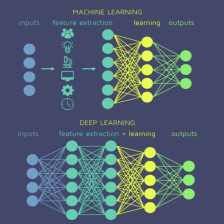

近年来,神经网络的发展极其迅速,已经在图像处理、自然语言处理、声音识别等领域实现了各种突破性的成果。其中最具代表性的就是Transformer模型,它在很多任务上都获得了卓越的效果。本文将详细介绍一下Transformer模型,并用可视化的方式帮助读者理解它的工作原理。希望能够给大家带来启发。

2. 基本概念术语说明

首先,了解一些基本的概念和术语,对于我们理解Transformer模型非常重要。

2.1 Transformer模型概述

Transformer模型的主要特点包括:

- self-attention机制: 每个位置都可以看到所有的输入信息;

- 层次化的多头注意力机制:利用多个不同子空间的注意力机制提升性能;

- 位置编码:通过引入位置编码使得每个位置都有一个相对固定的表示形式;

- 残差连接和正则化方法:为了防止梯度消失或爆炸,加入残差连接和正则化方法;

- 堆叠多个Encoder层和Decoder层:模型可以通过堆叠多层实现更复杂的特征提取和推断过程。

2.2 Self-Attention机制

self-attention是一种 attention mechanism,每一个位置只关注自身的信息。在 transformer 中,每一步中 decoder 都会使用 encoder 输出的 hidden state 和当前位置之前的所有输出进行自注意力计算,得到当前位置的输入信息。因此,self-attenti

订阅专栏 解锁全文

订阅专栏 解锁全文

6644

6644

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?