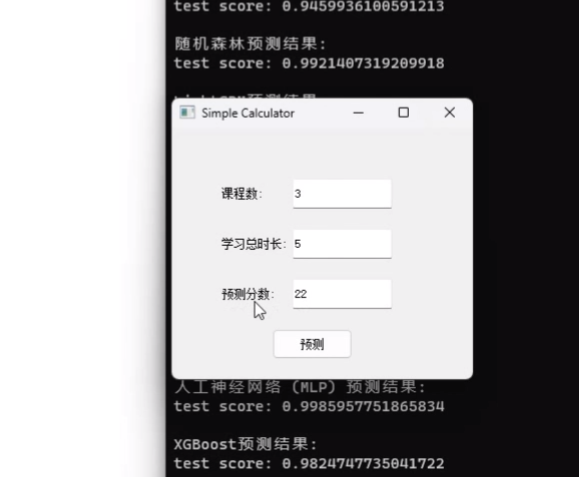

本期给大家介绍的是113基于机器学习预测学生考试成绩,效果图如下:

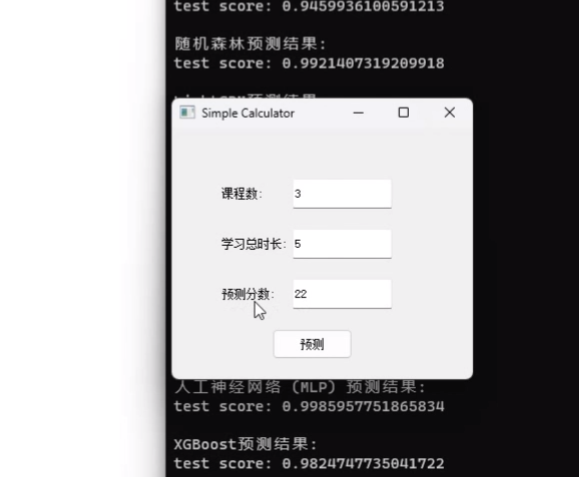

这是调用训练好的模型来识别的,运行python 03pyqt.py的可视化界面,通过输入学生的课程数和学习总时长来预测最后的分数。

代码下载和视频演示地址:

113基于机器学习预测学生考试成绩_哔哩哔哩_bilibili

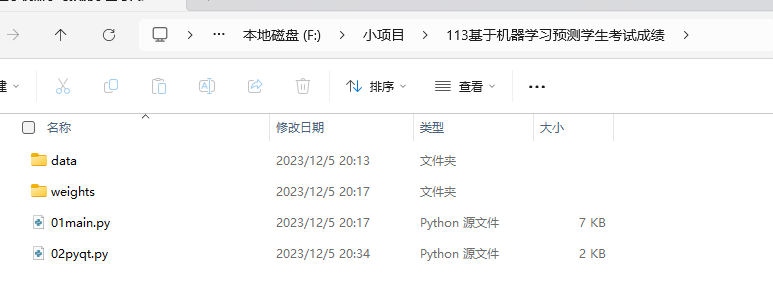

代码整体是非常简便的,总共两个py部分和一个数据集在data文件夹下。

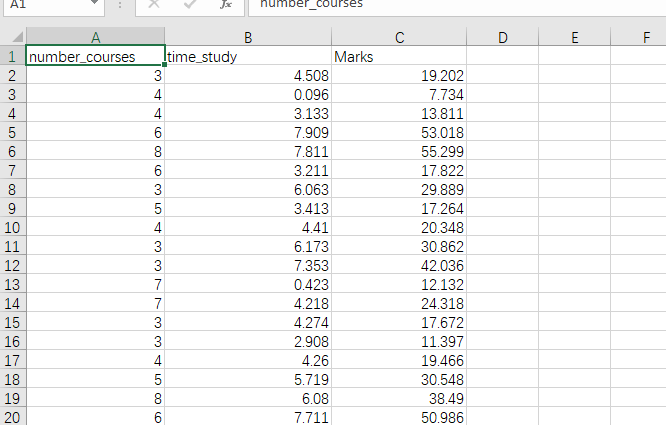

Data数据如下,前两列是学生的上课数量和学习时长,后一列是学习分数。

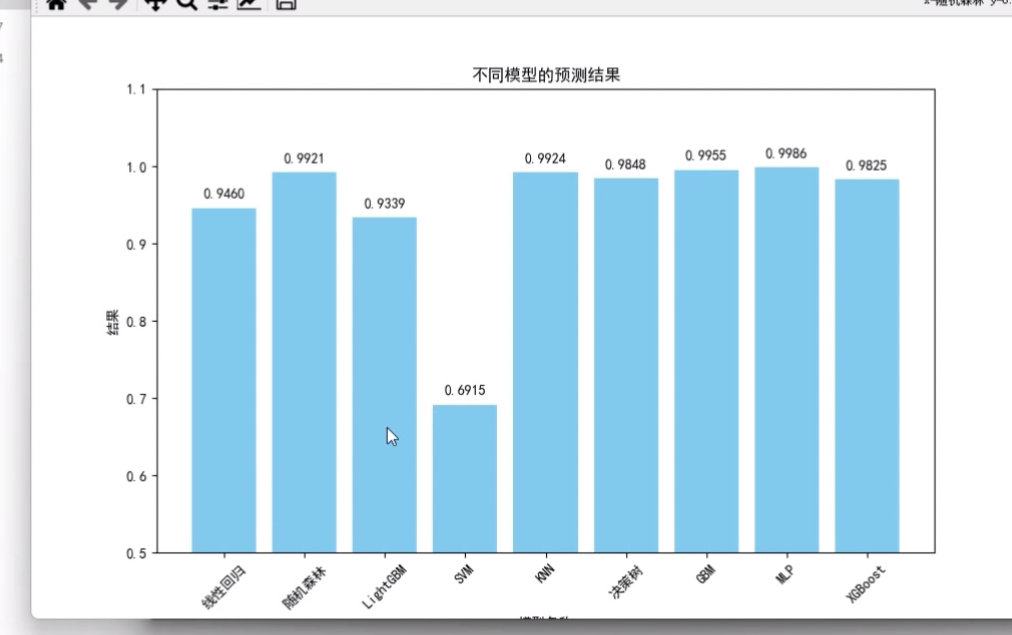

运行01main.py中一共包含了8种机器学习模型,包含线性回归、随机森林、LightGBM、SVM、KNN、决策树、GBM、MLP、XGBoost等。训练结束后会弹出结果柱状图,其中MLP多层感知机(也叫ANN人工神经网络)的效果最佳,验证集上准确率达到99.86%。

最后运行02pyqt.py是个可视化的界面,加载训练好的MLP模型,在界面上输入课程数和学习总时长即可预测最后的分数。

Data.csv数据集可以替换自己的数据集来进行训练识别,代码里面有注

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2430

2430

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?