TensorRTx

https://github.com/wang-xinyu/tensorrtx

TensorRTx旨在通过tensorrt网络定义API实现流行的深度学习网络。正如我们所知,tensorrt有内置的解析器,包括caffeparser、uffparser、onnxparser等。但是当我们使用这些解析器时,我们经常会遇到一些“不支持的操作或层”问题,特别是一些最先进的模型正在使用新类型的层。

那么我们为什么不跳过所有的解析器呢?我们只是使用TensorRT网络定义API来构建整个网络,它并没有那么复杂。

我写这个项目是为了熟悉tensorrt API,也是为了与社区分享和学习。

所有模型首先在pytorch/mxnet/tensorflown中实现,并导出一个权重文件xxx.wts,然后使用tensorrt加载权重、定义网络和进行推理。一些pytorch实现可以在我的repo Pytorchx(https://github.com/wang-xinyu/pytorchx)中找到,其余的来自polular开源实现。

教程

-[安装依赖项。](./tutorials/Install.md)

-[快速入门指南,以lenet5为演示。](/tutorials/getting_started.md)

-[wts文件内容格式](./tutorials/getting_started.md#the-wts-content-format)

-[常见问题(FAQ)](/tutorials/FAQ.md)

-[从TensorRT 4迁移到7](/tutorials/migrating_from_tensorrt_4_to_7.md)

-[如何实现多GPU处理,以YOLOv4为例](./tutorials/multi_GPU_processing.md)

-[检查您的GPU是否支持FP16/INT8](./tutorials/Check\u FP16\u INT8\u support.md)

-[如何在Windows上编译和运行](./tutorials/Run_on_Windows.md)

-[使用Triton推断服务器部署YOLOv4]-(https://github.com/isarsoft/yolov4-triton-tensorrt)

-[从pytorch逐步到trt,以hrnet为例(中文)](./tutorials/from_pytorch_to_trt_stepbystep_hrnet.md)

cuda10.0 / cudnn7.6.5 / tensorrt7.0.0

如何运行

每个文件夹中都有一个自述文件,它解释了如何在其中运行模型。

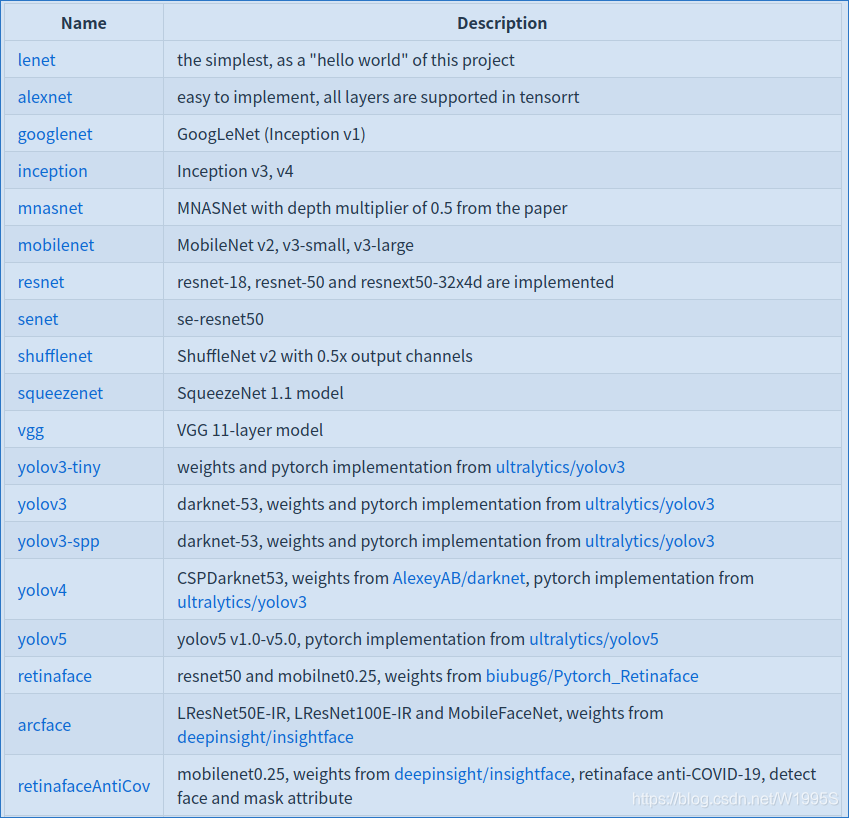

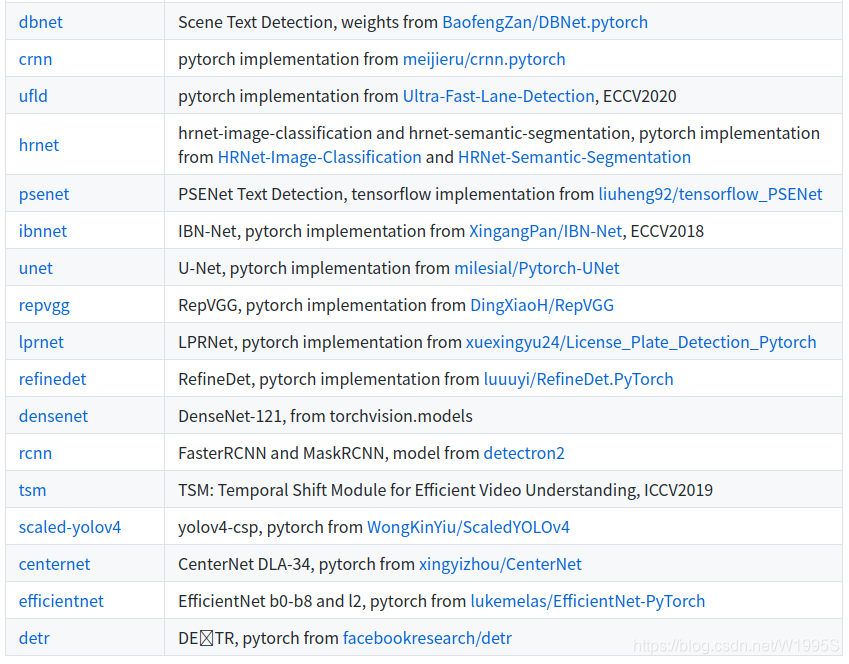

模型

实现了以下模型。

model zoo

可以从model zoo下载.wts文件以进行快速评估。但建议从pytorch/mxnet/tensorflow模型转换.wts,以便重新训练您自己的模型。

https://pan.baidu.com/s/19s6hO8esU7-TtZEXN7G3OA#list/path=%2F

pwd: uvv2

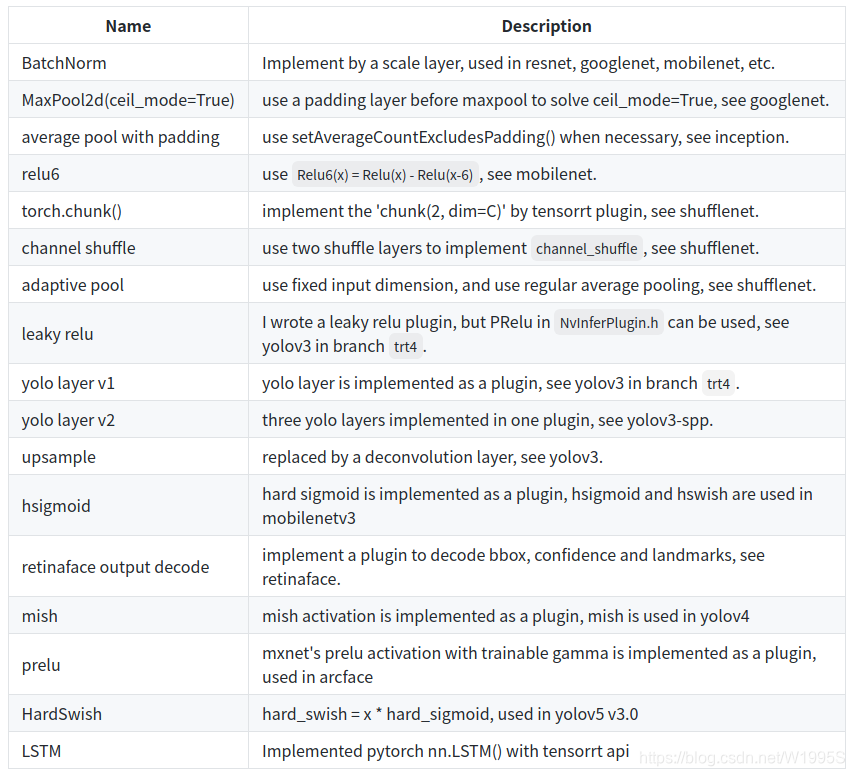

棘手的操作

这些模型中遇到的一些棘手的操作已经解决,但可能有更好的解决方案。

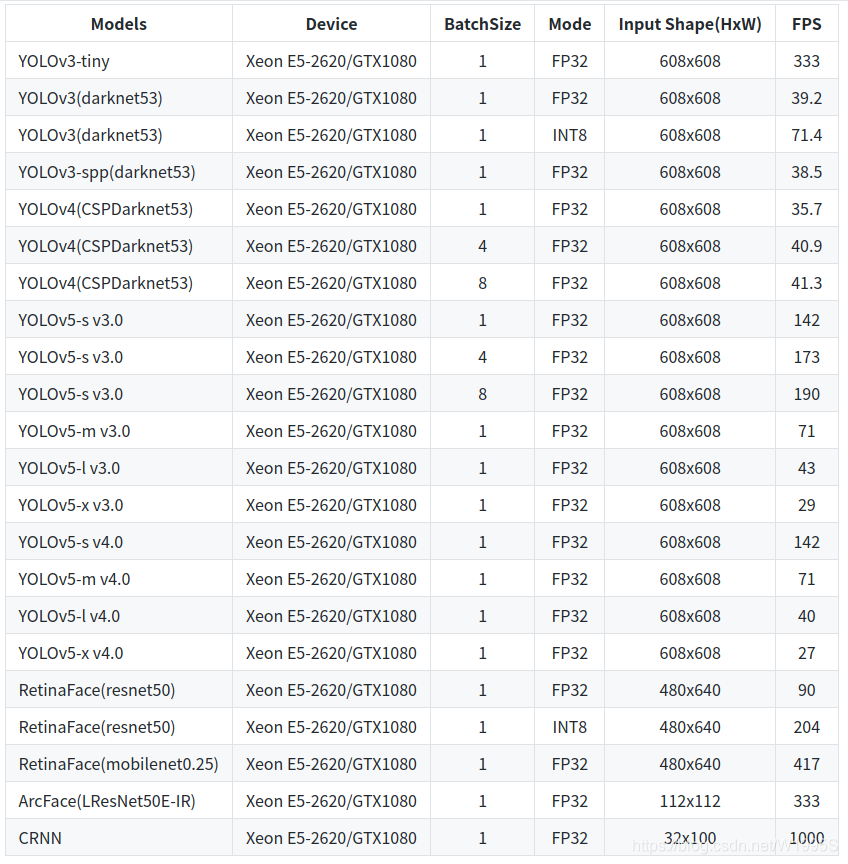

Speed Benchmark

2833

2833

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?