文章大纲

简介

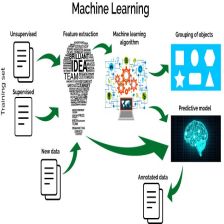

目前混合编程的需求越来越多,有的时候需要大数据处理一批数据,但是数据处理的时候只有python 编写的 基于pandas 的数据处理代码,怎么办呢,我们需要想办法把之前的数据处理代码复用起来。

spark 3.2 版本 尝试将 pandas dataframe 的api 和spark 的api 统一起来。

比如 :koalas 这个项目:在spark 3.1 之前,使用他来统一两者的api,在3.2 版本开始,PySpark 则可以直接使用。

https://github.com/databricks/koalas

spark 环境下载

目前spark 两个主要版本2.x 和3.x,2.x 一般使用spark 2.4.8 版本,其实就是2.4.x 的版本,3.x 主要为spark 3.2 版本。

目前官网升级后,下载地址不好找了,我特别贴出来。

历史包列表:

https://archive.apache.org/dist/spark/

<

订阅专栏 解锁全文

订阅专栏 解锁全文

386

386

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?