点击上方蓝字 关注我吧

点击上方蓝字 关注我吧

前言

先问你几个问题,检查下你对损失函数的了解程度,看你能顺利答出来不

- 你了解交叉熵和相对熵的区别和联系吗?

- 为什么分类问题的损失函数一般用交叉熵而不用相对熵?

- 为什么分类问题的损失函数一般用交叉熵而不用MSE?

这几个问题都很基础,所以面试中常被问到。不过我们平时学算法原理的时候,一般只了解用到了什么损失函数,不怎么会思考为什么用这个损失函数,所以突然被问到的话有可能不能很好分析出具体的原因。本篇梳理了常见的应用于分类、回归任务中的损失函数,同时附上以上三个问题的参考分析。

二分类

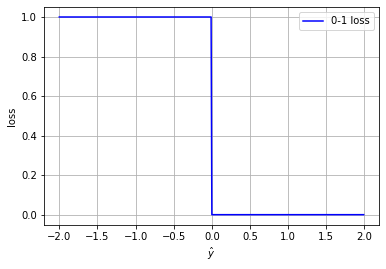

0-1 loss

记录了分类错误的次数,当样本的真实标签值与预测标签值不相等时,损失为1,反之则损失为0,即预测值等于真实值时没有损失。

使用0-1 loss的常见算法有感知机。

0-1 loss 对离群点很鲁棒,但是是非凸的,不连续且不可导,比较难以优化

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3281

3281

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?