作者 | 谢文睿

来源 | ID:Datawhale

原文 | 深度学习中的优化算法串讲

本文对深度学习中的优化算法进行了梳理。首先,介绍整个优化算法的基本框架;然后将目前用的主流优化算法进行讲解,带领大家了解优化算法从SGD到Adam及Nadam的转变。

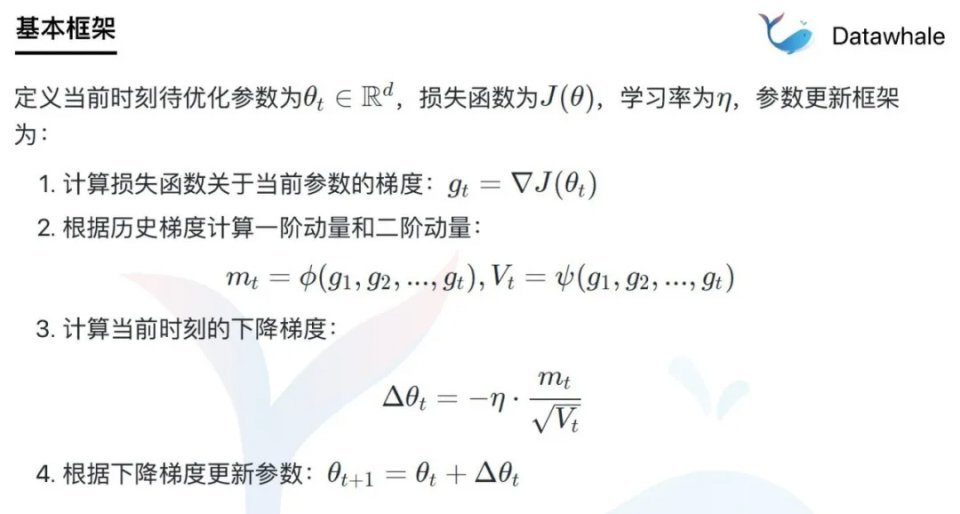

基本框架

为什么这些算法是能串讲的呢?因为这些算法都是相通的。为什么是相通的呢?因为所有的优化算法均基于下面优化算法的基本框架。

其中,一阶动量和二阶动量分别是历史梯度的一阶函数和二阶函数。

SGD随机梯度下降算法

首先,讲一下最基础的SGD算法:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

460

460

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?