本文是在Atlas Duo 300I 推理卡上部署LLM推理服务的一次尝试,完整的安装文档参考Ascend 官方。安装过程中遇到问题可以在社区提问,目前该推理卡对新模型的支持不是太好,且实测下来性能不及3090(吐槽:显存虚报,标记48GB实际只有44GB;算力140TFLOAPS,但推理速度来看远低于3090)。如果用于大模型训练或推理,直接使用910。

安装的流程为:

step1:安装驱动和固件

step2:下载mindIE镜像并启动容器

step3:安装CANN等软件

step4:使用mindie-service部署大模型推理服务

由于物理安装比较麻烦,官方提供了镜像,镜像申请后按照相关步骤下载即可,包含cann、mindie和TATB-Models,这样安装起来比较方便。

1. 安装驱动和固件

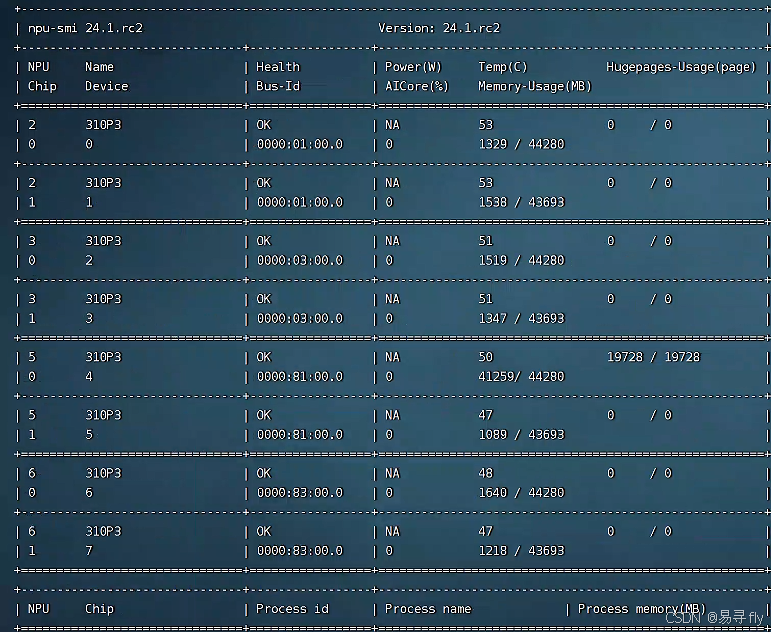

参考文档选择安装场景-软件安装-CANN商用版8.0.RC2.2开发文档-昇腾社区进行安装,由于我的机器已经安装好,就不进行说明。如果使用npu-smi info出现卡的信息,则证明安装正常。

2. 下载镜像

进入mindie 镜像页,登录后申请下载,我是24h内就通过了,通过后下载对应版本的镜像包即可。

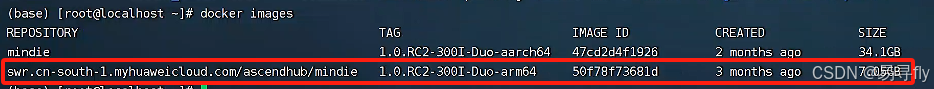

下载后镜像如下图所示,加载后约7GB。

使用如下命令启动容器,注意根据自己的实际情况修改相关目录

docker run -itd --ipc=host --net=host \

--name=llm_infer \

--device=/dev/davinci_manager \

--device=/dev/devmm_svm \

--device&

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

436

436

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?