1. softmax简介

softmax一般用于多分类任务中,将输出总和归一化,从而成为预测类别的概率分布,通常后面可以接交叉熵损失函数(CrossEntropyLoss)。对于一个向量例如[x1,x2,x3,x4,x5],做Softmax运算:

sum = e ** (x1) + e ** (x2) + e ** (x3) + e ** (x4) + e ** (x5)

softmax(x1) = e ** (x1) / sum

softmax(x2) = e ** (x2) / sum

softmax(x3) = e ** (x3) / sum

softmax(x4) = e ** (x4) / sum

softmax(x5) = e ** (x5) / sum

我们可以看到经过softmax之后,输出值加和为1,且每个值都处于0~1之间,这样就符合概率的定义了。

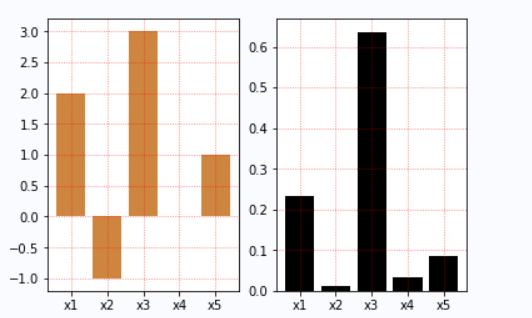

下图展示了softmax函数对[2,-1,3,0,1]做的变换。

2. softmax是激活函数

softmax通常来讲是激活函数,但是softmax函数要与交叉熵损失函数一起使用来避免数值溢出的问题。所以,在我们的深度学习框架中,在网络构造时通常是看不见softmax函数的,而在我们使用交叉熵损失函数时(CrossEntropyLoss)其内部会自动加上Sofrmax层。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?