上一篇文章

JermmyXu:神经网络量化入门--量化感知训练zhuanlan.zhihu.com

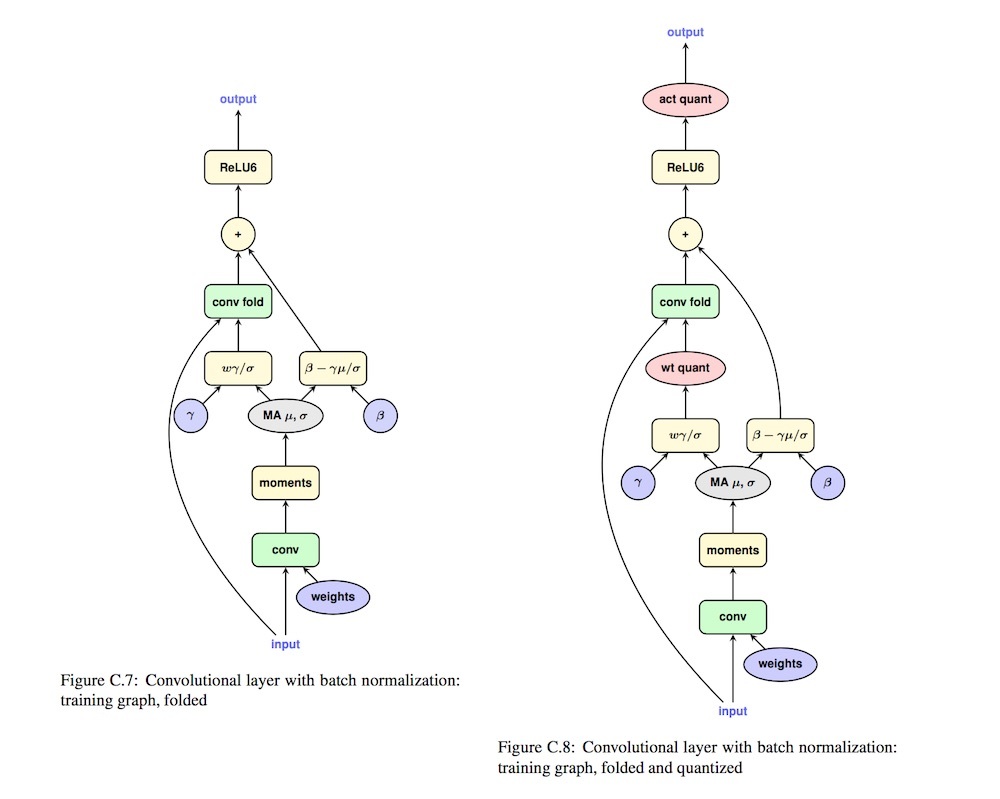

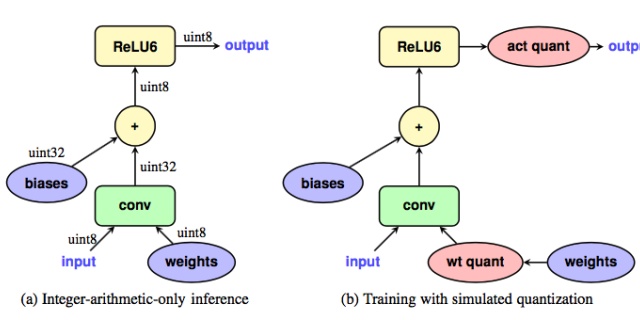

介绍了量化训练的基本流程,本文介绍量化中如何把 BatchNorm 和 ReLU 合并到 Conv 中。

Folding BatchNorm

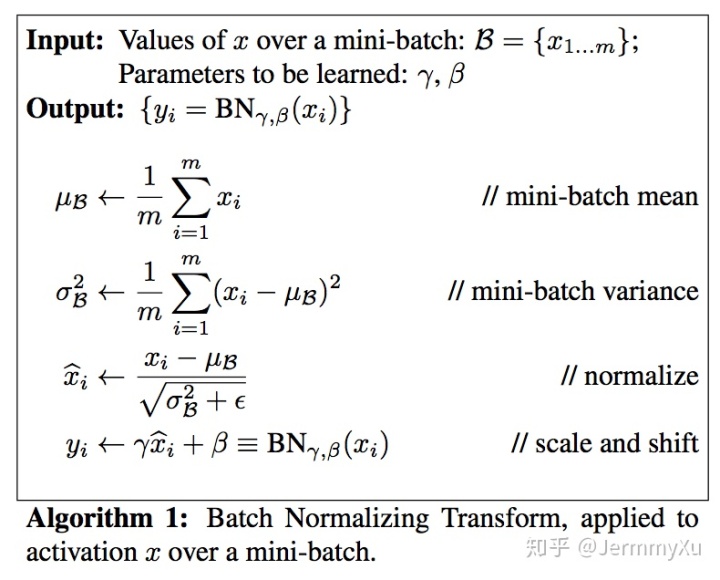

BatchNorm 是 Google 提出的一种加速神经网络训练的技术,在很多网络中基本是标配。

回忆一下,BatchNorm 其实就是在每一层输出的时候做了一遍归一化操作:

其中

一般卷积层与BN合并

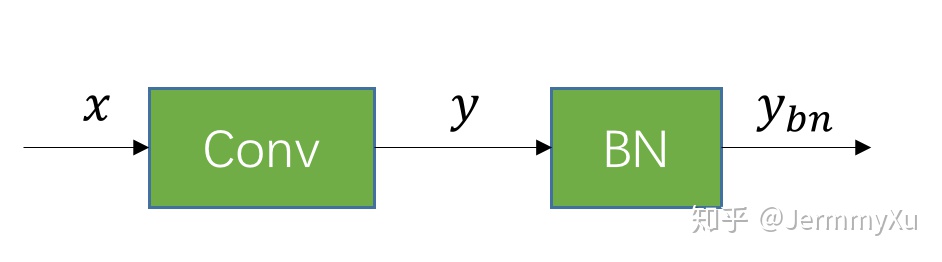

Folding BatchNorm 不是量化才有的操作,在一般的网络中,为了加速网络推理,我们也可以把 BN 合并到 Conv 中。

合并的过程是这样的,假设有一个已经训练好的 Conv 和 BN:

假设 Conv 的 weight 和 bias 分别是

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

294

294

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?