10.0 总结

❤️线性变换的两种理解方式

- 将基向量变化后的位置视为矩阵的列,也就是新的基向量【依赖于坐标系】

- 利用特征向量和特征值理解线性变换,不依赖于坐标系的选择

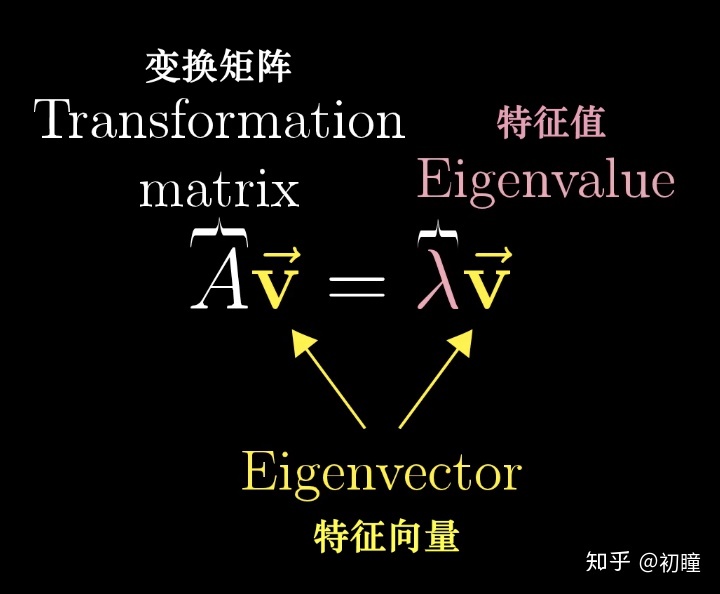

❤️特征值与特征向量

特征向量:一个向量经过线性变换,仍留在它所张成的空间中

特征值:描述特征向量经过线性变换后的缩放程度

❤️求解特征向量就是寻找非零向量

❤️求解特征值就是寻找一个

❤️当特征向量的数量足够多时,这些特征向量就可以构成特征基。利用特征基可以简化矩阵的幂次计算。

为了方便理解,将总结前后copy了一份,与10.5章节的内容保持一致。

10.1 特征值与特征向量的意义

总结:

特征向量:一个向量经过线性变换,仍留在它所张成的空间中

特征值:描述特征向量经过线性变换后的缩放程度

正文:

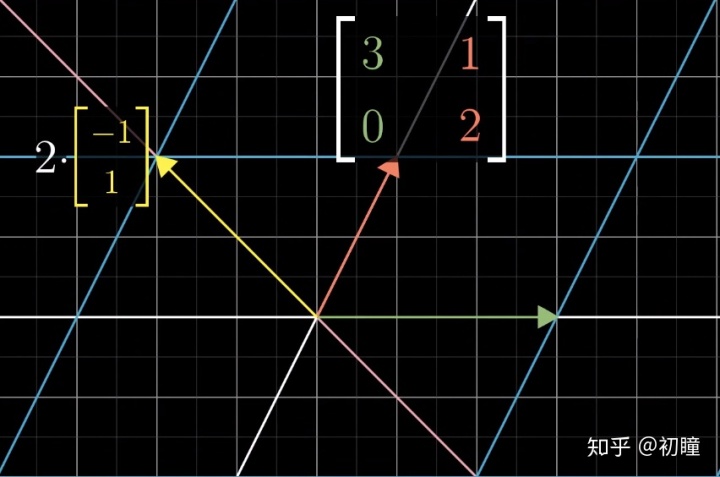

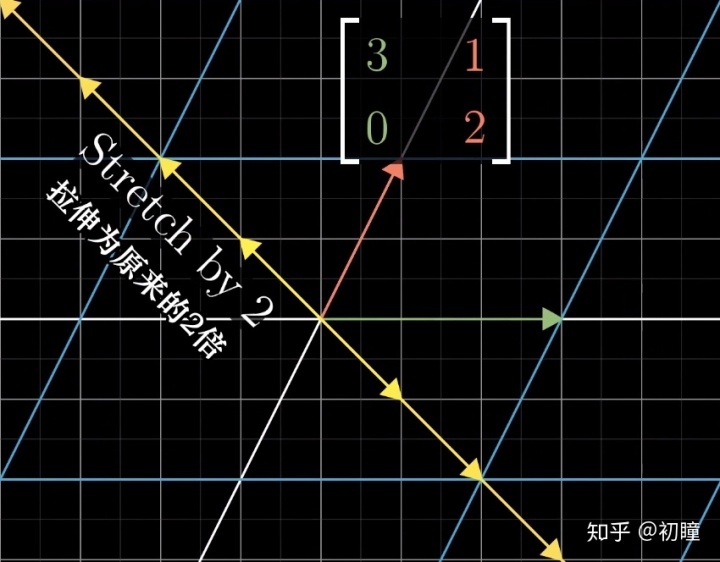

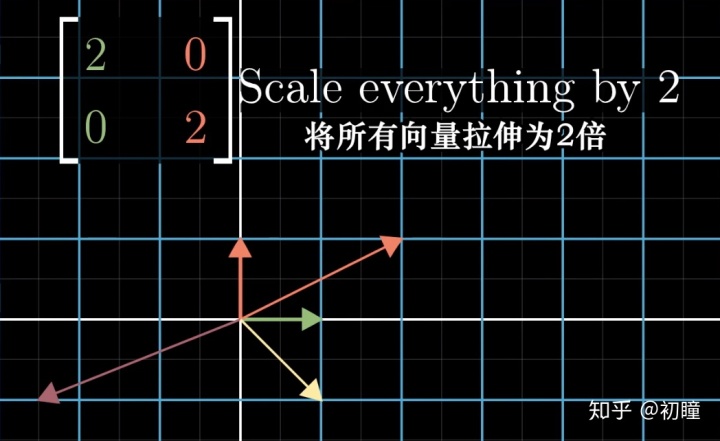

大部分的向量经过线性变换都离开了它所张成的空间。 如图中黄色的向量经过线性变换

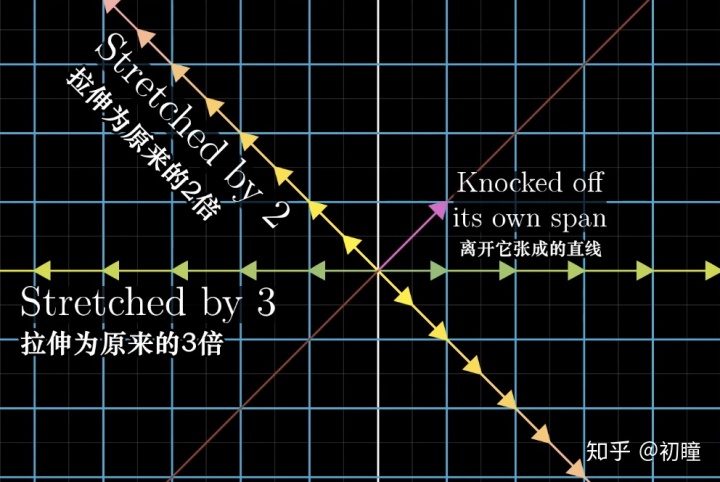

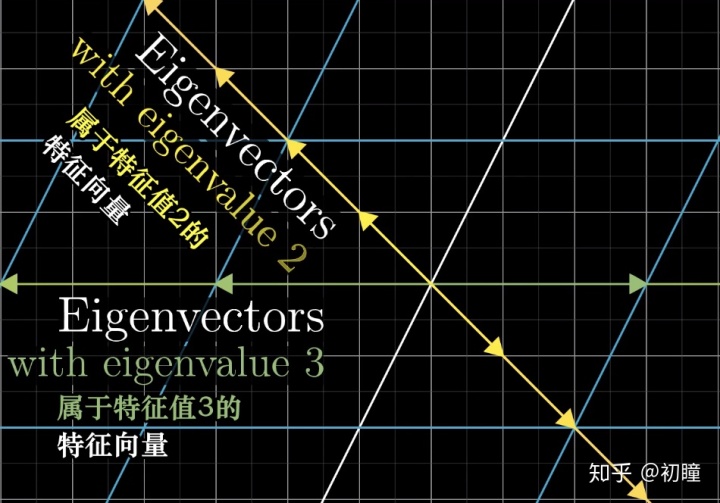

但是也有一部分向量留在了它所张成的空间,这样线性变换起到的作用就是压缩或者拉升如:

特别的, 对于

线性变换暗示一点,对于处在它所在的对角线上的任何向量也仅被拉伸了2倍。

他们的共同点就是线性变换后留在了原来向量所张成的线性空间里边, 对于其他的向量则离开他原来张成的向量空间

因此将这些特殊的向量称为“特征向量” , 每个特征向量都有一个对应的值,称为“特征值”,目的是衡量特征向量经过变换后的压缩或者拉伸因子。

特征值可以为负,

10.2 三维空间中的特征值与特征向量

对于三维空间中的旋转,如果能够找到对应的特征向量,也即能够留在它所张成的空间中的向量,那么就意味着我们找到了旋转轴。特别地,这就意味着将一个三维旋转看成绕这个特征向量旋转一定角度,要比考虑相应的矩阵变换要直观。

此时对应的特征值为1,因为旋转并不改变任何一个向量 ,所以向量的长度保持不变。

10.3 计算特征值与特征向量

10.3.1 理解线性变换的另外一种方式

理解线性变换作用,如果采用矩阵的列可以看做变换后的基向量,这就依赖于特定的坐标系。为了减少对坐标系的依赖,更好的办法就是求出对应的特征向量与特征值。

10.3.2 计算特征值与特征向量

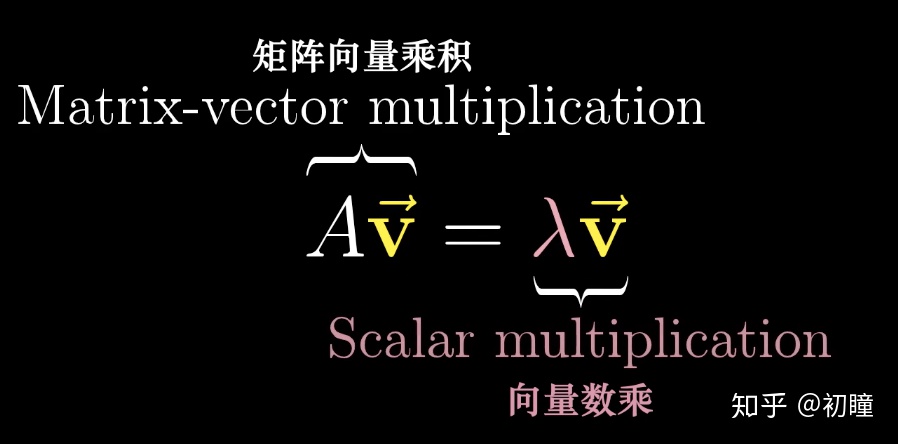

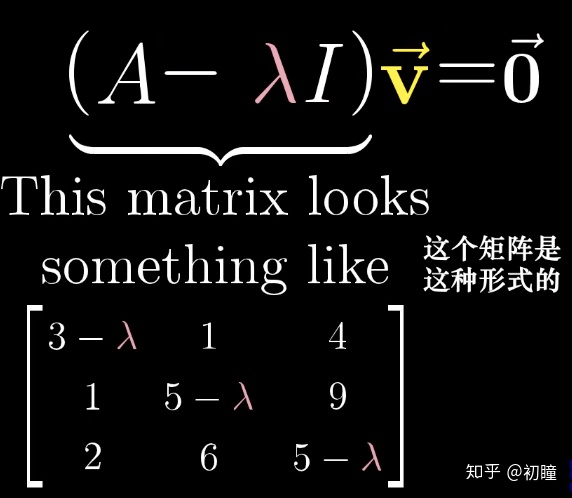

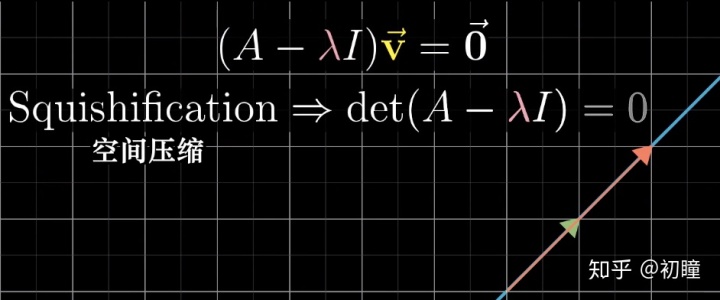

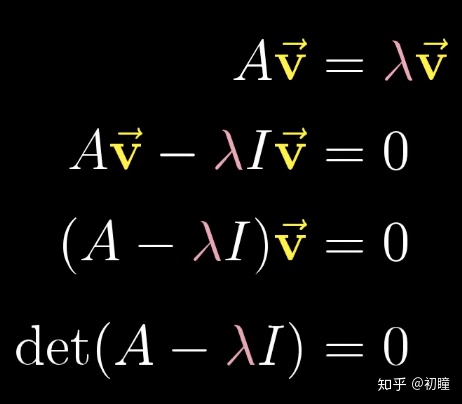

可以看得出,线性变换的理解与矩阵乘法的理解是一致的。 矩阵乘法的作用效果就是将任意向量乘以

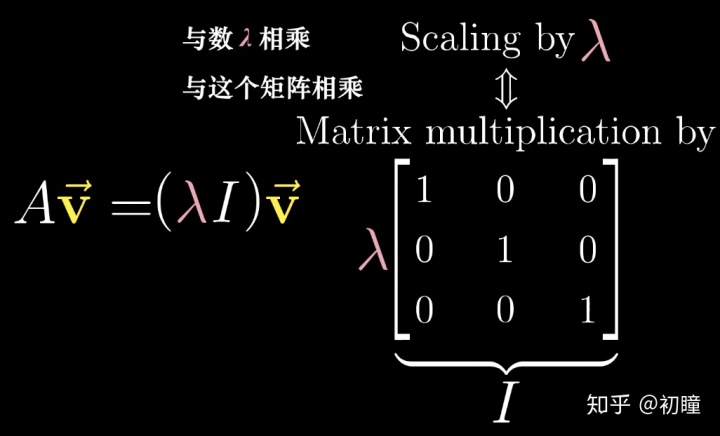

下一步就是:将等式左右两侧都转化为矩阵向量乘积的形式

这样就是寻找一个向量

显然,

对于行列式

总结一下就是:

10.3.3并非所有的矩阵都存在特征向量

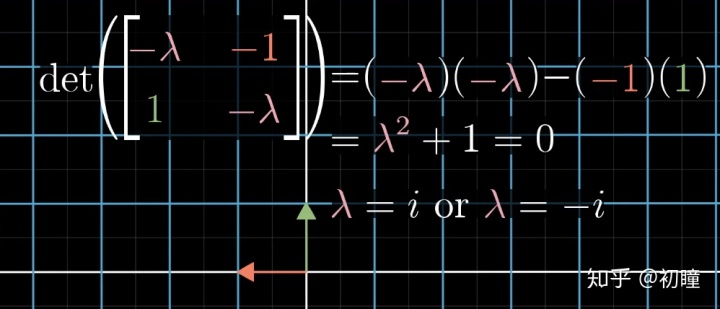

二维线性变换不一定有特征向量。(没有实数解表明他没有特征向量) 如:逆时针旋转90度变换,向量离开了原始张成的特征空间。

而我们尝试求解其特征值:

与相乘在复平面中表示为90度旋转,这和

是这个二维实向量旋转变换的特征值有所关联。值得注意的一点就是,特征值出现负数的情况一般对应于变换中的某一种旋转。

10.4特征基与对角化

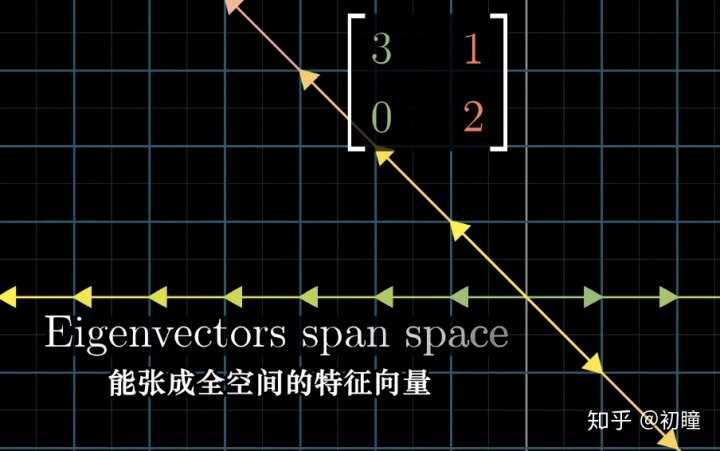

属于单个特征值的特征向量有可能不在直线上,如果特征向量的数量足够多,就能够张成空间。

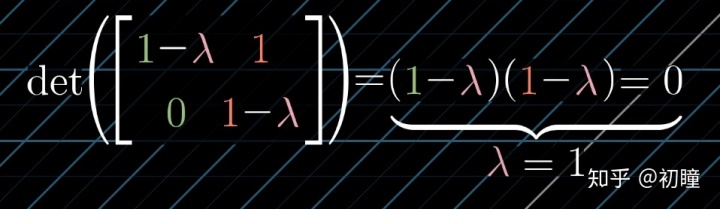

(1)特征向量不能张成空间

可以看到几何上得出的特征值与数值计算得出的向量值是一致的。对于单个特征值,却存在无数的特征向量。但是这些向量张不成二维空间。

(2)特征向量可以张成空间

矩阵

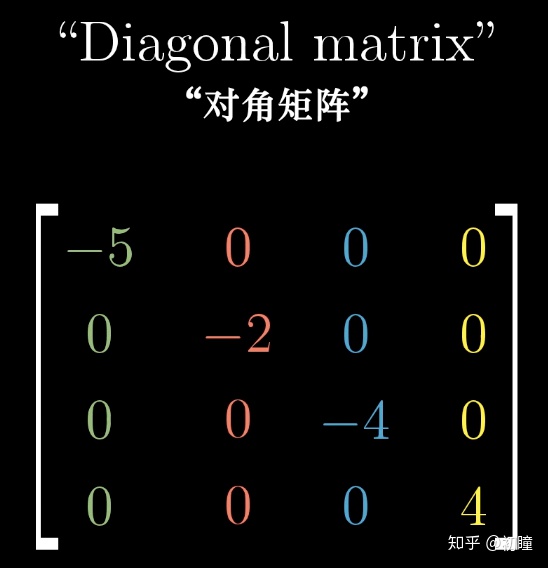

(3)对角阵

对于对角矩阵,除对角元以外其他元素均为0的矩阵被称为对角矩阵

对于对角矩阵,所有基向量都是特征向量,对角元素就是所属的特征值。

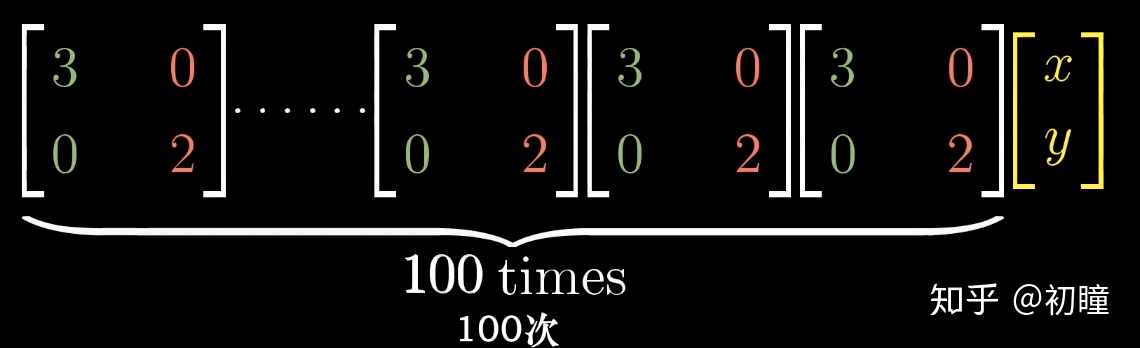

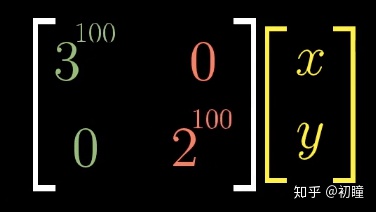

对角阵的幂次:

非对角阵,计算100次,噩梦一场。

不是所有矩阵都能对角化,如剪切变换,它的特征向量不够多,不能够张成全空间。事实上,如果你能找到对应的特征基,矩阵运算就会变得特别轻松。

(4) 特征基

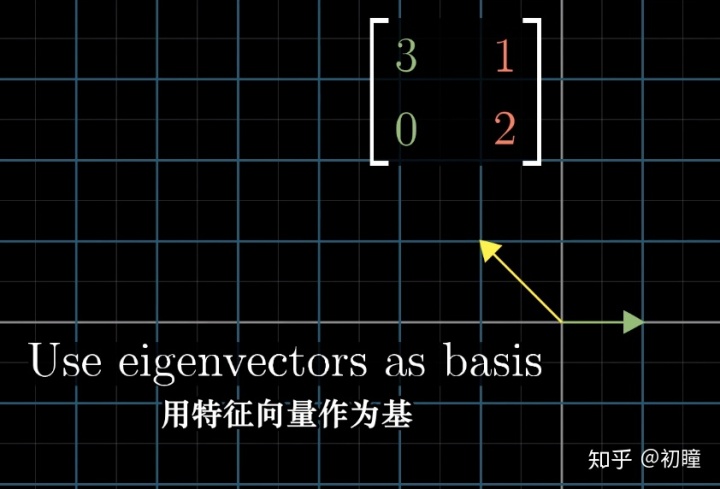

基向量恰巧是特征向量,将会发生什么?利用特征向量可以将矩阵进行对角化。 对于有的变换有许多特征向量,多到能选出一个张成全空间的集合。

这样就能变换你的坐标系,其中这些特征向量就是基向量。

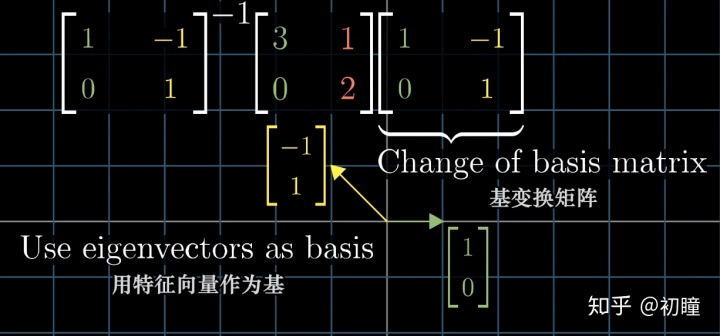

取出你想用做新基的向量(特征向量

这样所得的矩阵代表同一个变换,只不过是从新基向量所构成的坐标系的角度来看的。

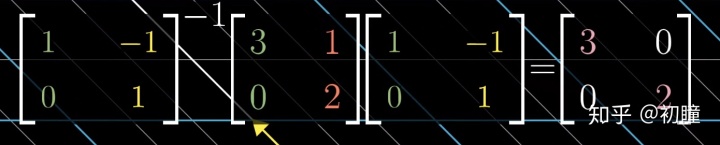

用线性无关的特征向量来完成这件事情的意义在于:最终变换的矩阵必然是对角阵,且对角元就是对应的特征向量。这是因为它处坐标系的基向量在变换中仅仅进行了缩放

(5) 利用特征基计算矩阵的幂次

特征值对应的所有的特征向量构成的集合被称为一个“特征基”

计算

10.5 总结

❤️线性变换的两种理解方式

- 将基向量变化后的位置视为矩阵的列,也就是新的基向量【依赖于坐标系】

- 利用特征向量和特征值理解线性变换,不依赖于坐标系的选择

❤️特征值与特征向量

特征向量:一个向量经过线性变换,仍留在它所张成的空间中

特征值:描述特征向量经过线性变换后的缩放程度

❤️求解特征向量就是寻找非零向量

❤️求解特征值就是寻找一个

❤️当特征向量的数量足够多时,这些特征向量就可以构成特征基。利用特征基可以简化矩阵的幂次计算。

为了方便理解,将总结前后copy了一份,与10.0章节的内容保持一致。https://www.bilibili.com/video/av6540378/?spm_id_from=333.788.videocard.0www.bilibili.com

题图来源于:https://www.ics.uci.edu/~xhx/img/courses/linearalgebra.png

内容及图片来源:

2007

2007

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?