作者:哈尔滨工业大学在读博士 谢浩哲 公众号:将门创投(thejiangmen)

ECCV 2020系列文章专题 第·2·期

本文将分享来自哈尔滨工业大学的在读博士谢浩哲等人在ECCV的工作。为了解决多层感知机无法很好地获得点云的几何结构和上下文信息的问题,他们提出了Gridding Residual Network(GRNet),将无序的点云规则化至3D Grid,并且在ShapeNet、Completion3D和KITTI上的实验结果超越了state-of-the-art方法。

福利来啦!

每一期,作者都会抛出一个跟其paper有关的互动话题,我们将从留言区抽取回答最走心/最干货/最有想法的 3 名幸运同学,分别送出大红包 一个,中奖名单将会在一周后于本文留言区公布,快来参与吧!

#本期互动话题#

你觉得点云补全的实际应用有哪些?

目前的工作距离应用还有多远?

快去评论区留言吧!

作者:哈尔滨工业大学在读博士 谢浩哲

Paper: https://arxiv.org/pdf/2006.03761

Project Page: https://haozhexie.com/project/grnet

GitHub: https://github.com/hzxie/GRNet

引 言

由于传感器本身的分辨率限制或物体的遮挡,现实场景中采集的点云往往不完整,而完整的点云对于点云理解有很大帮助。因此,点云补全在现实应用中有着非常重要的意义。

早期的工作(如3D-EPN [1])将该问题转换为体素的补全问题,然而转换为体素时会引入量化误差,从而丢失物体的细节。近几年的方法(如PCN[2]、TopNet [3]和Cascade Point Completion [4]等)直接使用多层感知机回归点云的坐标值。但由于点云的无序性,多层感知机无法很好地获得点云的几何结构和相邻点的上下文信息。

反观近几年点云分割的方法(如SPLATNet [5]和InterpConv [6]),它们在Permutohedral Lattice和3D Grid中进行卷积操作,从而考虑点云的空间结构和上下文信息。然而这两个方法假定点云中点的坐标和数量在输入输出时保持不变,因此无法直接用于点云补全。

为了解决上述问题,本文提出了Gridding Residual Network(GRNet)将无序的点云规则化至3D Grid,从而在点云补全中考虑了点云的空间结构和上下文信息,最终在点云补全任务中取得了更好的效果。

一、工作亮点

点云补全在计算机视觉和机器人领域都有着重要的应⽤前景。现有的工作(如PCN、TopNet和Cascade Point Completion等)直接将多层感知机(Multi-layer Perceptrons,MLP)应用于点云,然而多层感知机无法很好地获得点云的几何结构和上下文信息。

为了解决这个问题,本文提出了Gridding Residual Network(GRNet)将无序的点云规则化至3D Grid,并提出了Gridding, Gridding Reverse和Cubic Feature Sampling更好地感知点云的几何结构和上下文信息。

此外,相比于Chamfer Distance,基于Gridding的Gridding Loss可以帮助网络更好地恢复点云的细节。本文所提出的GRNet在ShapeNet、Completion3D和KITTI上的实验结果超越了state-ofthe-art方法

二、解决方案

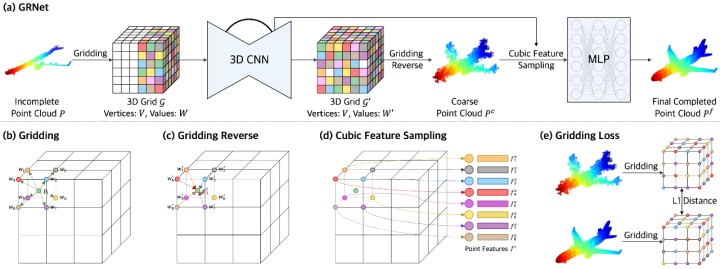

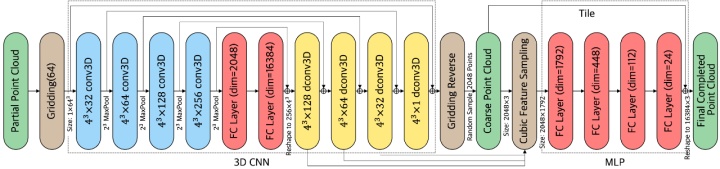

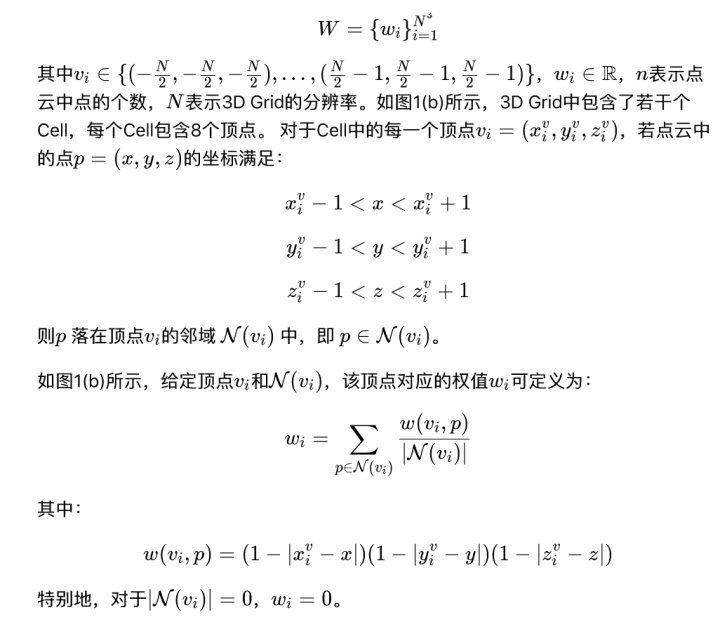

本文所提出的GRNet包含了5个元素:Gridding,3D CNN,Gridding Reverse,Cubic Feature Sampling和MLP,如图1(a)所示。

2.1 Gridding

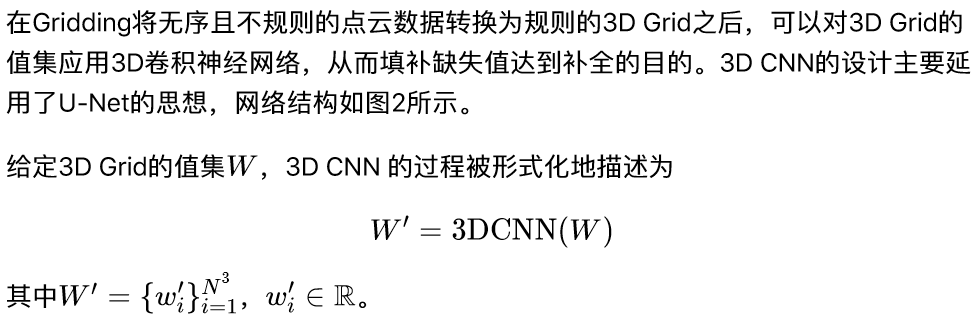

2.2 3D CNN

2.3 Gridding Reverse

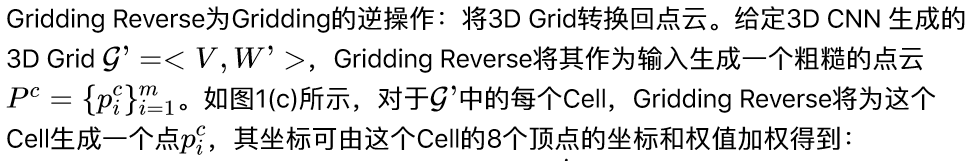

2.4 Cubic Feature Sampling

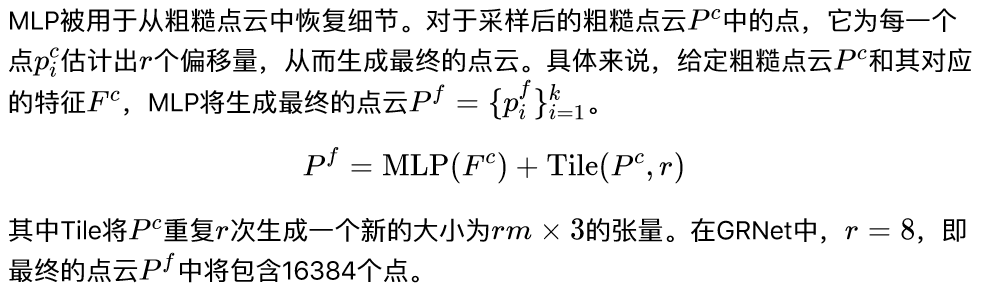

2.5 MLP

2.6 Gridding Loss

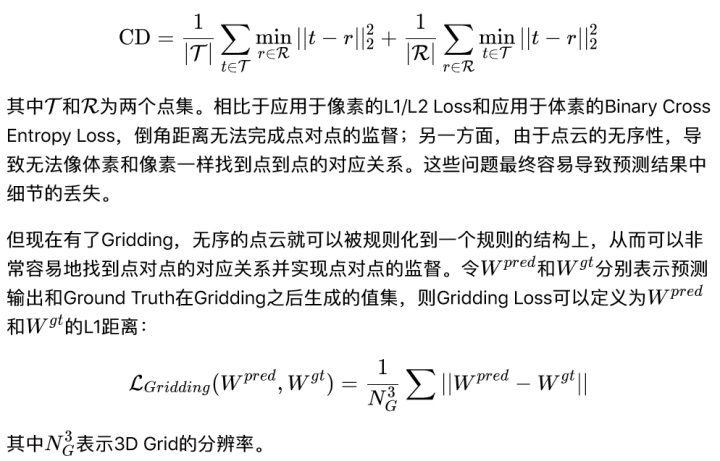

现有的点云重建/补全的方法主要使用倒角距离(Chamfer Distance)作为损失函数训练网络。倒角距离的优化目标是最小化两个点集的最小距离之和:

三、实验结果

3.1 ShapeNet

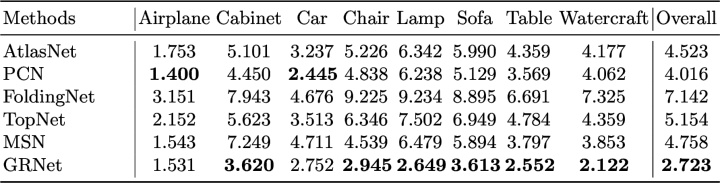

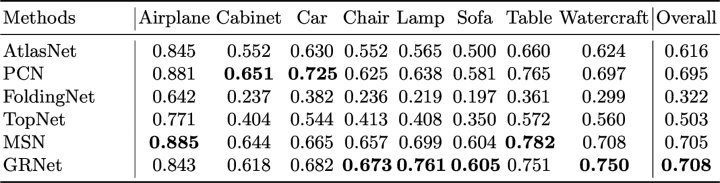

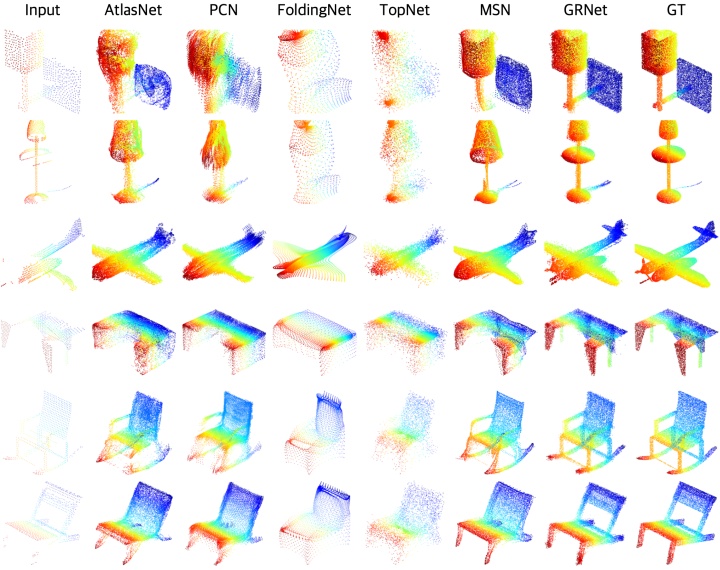

对于ShapeNet,本文使用了PCN [2]所生成的数据集,并使用了Chamfer Distance和F-Score@1%度量GRNet的结果,如表1-2和图3所示。

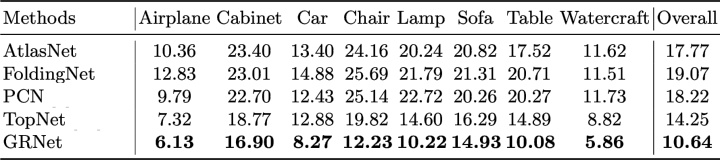

3.2 Completion 3D

除了ShapeNet,本文还在Completion 3D Benchmark上提交了结果,如表3所示。截止撰稿时,GRNet在Benchmark位居第一。

3.3 KITTI

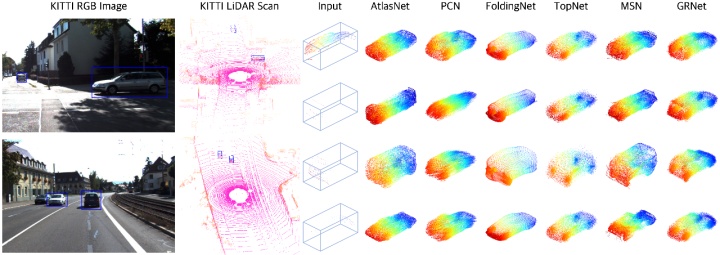

图4展示了GRNet和其他对比方法在KITTI数据集上的结果。输入点云来自于雷达扫描的数据,并使用3D Detection的Bounding Box对其进行裁剪和标准化,使其具有相同的位姿和尺度。

作者介绍

谢浩哲 | 哈尔滨工业大学 计算机科学与技术学院在读博士

谢浩哲,目前在哈尔滨工业大学计算机科学与技术学院攻读博士学位。他的研究方向主要包含3D重建和计算机视觉。目前在CVPR/ICCV/ECCV/IJCV等计算机视觉顶级会议和期刊上发表多篇论文。

个人主页:https://haozhexie.com/about

最后,别忘了

#本期互动话题#

你觉得点云补全的实际应用有哪些?

目前的工作距离应用还有多远?

我们将从中选出 3 位送出大红包一个~更有机会与论文一作深入交流切磋哦!

参考文献

[1] Dai et al. Shape Completion using 3D-Encoder-Predictor CNNs and Shape Synthesis. CVPR 2017.

[2] Yuan et al. PCN: Point Completion Network. 3DV 2018.

[3] Tchapmi et al. TopNet: Structural Point Cloud Decoder. CVPR 2019.

[4] Wang et al. Cascaded Refinement Network for Point Cloud Completion. CVPR 2020.

[5] Su et al. SPLATNet: Sparse Lattice Networks for Point Cloud Processing. CVPR 2018.

[6] Mao et al. Interpolated Convolutional Networks for 3D Point Cloud Understanding. ICCV 2019.

将门ECCV 2020专题活动

// 1 ECCV 2020 | 云端参会攻略之Oral篇,前排占位、强势围观!

// 2 ECCV 2020 | 精彩教程大揭秘,云端参会也easy!

// 3 ECCV 2020 Oral | 当AI遇见三维时装: 来会会现今最大的三维服装数据集

为了让更多小伙伴的优秀工作拥有更大的展示舞台,本周开始,我们将不间断分享来自将门技术社区的群友们在本次ECCV中的优质工作,共计20期。欢迎中paper的小伙伴前往将门创投(thejiangmen)后台回复“ECCV”获取投稿方式!坑位有限,先到先得~

将门 ECCV 2020 鲜声夺人云际会【预报名开启】

关注将门创投(thejiangmen)获取报名方式

@将门创投· 让创新获得认可

如果喜欢,别忘了赞同、关注、分享三连哦!笔芯❤

2315

2315

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?