深度学习

分享环境搭建、学习工具、深度学习原理等

玖零猴

嵌入式·ROS·CV·ML·DL·医学影像分割

展开

-

深入理解ResNet 到 IResNet

论文链接: https:// arxiv.org/abs/2004.0498 9 代码链接: https:// github.com/iduta/iresne t ...原创 2020-04-28 12:41:08 · 3725 阅读 · 0 评论 -

TTA(Test-Time Augmentation) 之Pytorch

TTA(Test-Time Augmentation) ,即测试时的数据增强 实现步骤如下: 将1个batch的数据通过flips, rotation, scale, etc.等操作生成batches 将各个batch分别输入网络 每个batch的masks/labels反向转换 通过mean...原创 2020-04-19 06:59:43 · 4396 阅读 · 5 评论 -

Matlab画激活函数sigmoid, tanh,Relu等

x = linspace(-10.0,10.0);relu = max(x,0);sigmoid = 1./(1.0+exp(-1.0*x));tanh = 2./(1.0 + exp(-2.0 * x)) - 1;plot(x,relu,'r');hold on;plot(x,sigmoid,'b');hold on;plot(...原创 2020-04-11 05:17:42 · 10274 阅读 · 0 评论 -

[论文解读]深度学习基础模型NIN(Network in Network)+Pytorch

论文(2014年): 链接 Pytorch代码: 链接 《Network In Network》是一篇比较老的文章了(2014年ICLR的一篇paper),是当时比较牛逼的一篇论文,同时在现在看来也是一篇非常经典并且影响深远的论文,后续很多创新都有这篇文章的影子。通常里程碑式的经典是不...原创 2020-04-05 14:17:11 · 883 阅读 · 1 评论 -

感受野(Receptive Field)的理解与计算

一、定义 在卷积神经网络中,感受野(Receptive Field)是指特征图上的某个点能看到的输入图像的区域,即特征图上的点是由输入图像中感受野大小区域的计算得到的 图来自[1] 神经元感受野的值越大表示其能接触到的原始图像范围就越大,也意味着它可能蕴含更为全局,语义层次更高的特征;相反...原创 2020-03-16 03:45:18 · 874 阅读 · 1 评论 -

吃透空洞卷积(Dilated Convolutions)

一、空洞卷积的提出 空洞卷积中文名也叫膨胀卷积或者扩张卷积,英文名也叫Atrous Convolution 空洞卷积最初的提出是为了解决图像分割的问题而提出的,常见的图像分割算法通常使用池化层和卷积层来增加感受野(Receptive Filed),同时也缩小了特征图尺寸(resolution),然后再利用上采样还原图像尺寸,特征图缩小再放大的过程造成了精度上的损失,...原创 2020-03-17 03:45:49 · 9512 阅读 · 11 评论 -

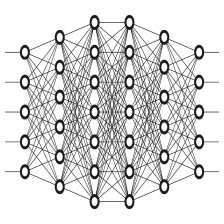

卷积神经网络CNN(卷积池化、感受野、共享权重和偏置、特征图)

一、前言 在卷积神经网络(Convolutional Neural Network,CNN)出现之前,神经网络中相邻的所有神经元之间都有连接,这称为全连接(fully-connected),如图1所示 图1 全连接(fully-connected) 这种全连接方式会带来一个问题,如图2所示...原创 2020-03-24 08:56:07 · 12543 阅读 · 3 评论 -

常用分割评价指标Dice、Hausdorff_95、IOU、PPV等 + Python实现

What is 脑肿瘤为例 蓝色部分表示真实脑肿瘤区域(GroundTruth), 蓝色的其它部分为正常脑区域 红色部分表示预测的脑肿瘤区域, 红色的其它部分为预测的正常脑区域 What is 假设正样本为脑肿瘤,负样本为正常脑组织,则有如下: T...原创 2020-03-27 06:12:24 · 19748 阅读 · 6 评论 -

[概念]凯明之作Resnet + 心路历程[超详] + 解决退化问题 + 让网络变得更深成为现实

在 AlexNet [3] 取得 LSVRC 2012 分类竞赛冠军之后,引爆了深度学习网络。而何恺明在2015年的深度残差网络(Deep Residual Network, 简写为 ResNet)[2] 可以说是过去几年中计算机视觉和深度学习领域最具开创性的工作。ResNet 使训练数百甚至数千层成为可能,且在这种情况下仍能展现出优越的性能。一、心路历程自 AlexNet...原创 2020-03-14 14:31:28 · 2169 阅读 · 0 评论 -

[概念]深度学习5种标准化层BN、GN、LN、IN、SN + 谷歌提出新的标准化层:FRN

为什么要做归一化处理?神经网络学习过程的本质就是为了学习数据分布,如果我们没有做归一化处理,那么每一批次训练数据的分布不一样,从大的方向上看,神经网络则需要在这多个分布中找到平衡点,从小的方向上看,由于每层网络输入数据分布在不断变化,这也会导致每层网络在找平衡点,显然,神经网络就很难收敛了。当然,如果我们只是对输入的数据进行归一化处理(比如将输入的图像除以255,将其归到0到1之间),只能保证...原创 2020-03-12 13:18:37 · 3962 阅读 · 2 评论 -

[论文翻译]测试时数据增强(TTA):Automatic Brain Tumor Segmentation using Convolutional Neural Networks with TTA

论文下载: 地址Automatic Brain Tumor Segmentation using Convolutional Neural Networks with Test-Time Augmentation使用带有TTA的卷积神经网络实现胶质瘤的自动分割Abstract. Automatic brain tumor segmentation plays an impo...原创 2020-03-11 16:00:34 · 2993 阅读 · 0 评论 -

[论文翻译]数据集的domian问题:Intramodality Domain Adaptation Using Self Ensembling and Adversarial Training

论文pdf下载: 链接Intramodality Domain Adaptation Using Self Ensembling and Adversarial Training使用自集成和对抗性训练的模式域内适应Abstract. Advances in deep learning techniques have led to compellingachievement...原创 2020-03-05 15:16:19 · 1796 阅读 · 0 评论 -

[函数]sklearn的train_test_split

train_test_split函数用于将矩阵随机划分为训练子集和测试子集,并返回划分好的训练集测试集样本和训练集测试集标签。格式:X_train,X_test, y_train, y_test =cross_validation.train_test_split(train_data,train_target,test_size=0.3, random_state=0)参数解释...原创 2020-03-04 15:37:24 · 493 阅读 · 0 评论 -

[过拟合]早停法 (Early Stopping)

1、过拟合过拟合(overfitting)指的是只能拟合训练数据, 但不能很好地拟合不包含在训练数据中的其他数据的状态[来自 斋藤康溢]解决过拟合问题有两个方向:降低参数空间的维度或者降低每个维度上的有效规模(effective size)。降低每个参数维度的有效规模的方法主要是正则化,如权重衰变(weight decay)和早停法(early stopping)等。 降低参数数量...原创 2020-03-04 12:24:01 · 18316 阅读 · 0 评论 -

[代码实现]UNet++之pytorch + 环境安装 + Brats2018 + 2D分割

源代码链接:https://github.com/MrGiovanni/UNetPlusPlus1、环境的安装1、CUDA8.0 Tensorflow1.4.0:https://blog.csdn.net/m0_38073193/article/details/822902492、git clone https://github.com/MrGiovanni/UNetP...原创 2020-03-03 10:28:48 · 12742 阅读 · 29 评论 -

[论文解读]UNet++解读 + 它是如何对UNet改进 + 作者的研究态度和方式

UNet++论文: 地址UNet++源代码: 地址参考:作者知乎的总结https://zhuanlan.zhihu.com/p/44958351转载 2020-02-29 17:15:48 · 12305 阅读 · 3 评论 -

[概念]卷积、池化、下采样、反卷积、上采样

卷积(conv)过程导致的图像变小是为了提取特征,特征提取阶段一般说的是卷积了池化(pooling)是为了降低特征的维度,通常我们说的网络深度、尺度就和这个有关池化又分最大池化和平均池化虽然卷积和池化的结果都是图像或者特征图(feature map)变小,但是目的是不一样的通常,池化后还要卷积,卷积提取出来的特征,是属于这一层或者说是这一深度又或者说是这一尺度的特征.有时候特征...原创 2020-02-29 13:10:44 · 1491 阅读 · 0 评论 -

[论文翻译]UNet++: A Nested U-Net Architecture for Medical Image Segmentation

UNet++论文: 地址UNet++: A Nested U-Net Architecture for Medical Image SegmentationUNet++:一个用于医学图像分割的嵌套的U-Net网络结构Zongwei Zhou, Md Mahfuzur Rahman Siddiquee,Nima Tajbakhsh, and Jianming Liang...原创 2020-02-28 17:23:05 · 7679 阅读 · 0 评论 -

[概念]神经网络的种类(前馈神经网络,反馈神经网络,图网络)

随着神经网络的不断发展,越来越多的人工神经网络模型也被创造出来了,其中,具有代表性的就是前馈型神经网络模型、反馈型神经网络模型以及图网络.1.前馈型神经网络模型 前馈神经网络(FeedforwardNeuralNetwork ,FNN),简称前馈网络。 把每个神经元按接收信息的先后分为不同的组,每一组可以看做是一个神经层。每一层中的神经元接收前一层...转载 2020-02-26 16:05:51 · 12613 阅读 · 0 评论 -

[过拟合]从诞生到现在Dropout的重大事迹 + 原理和使用

一、背景在机器学习中,过拟合是一个非常常见的问题.过拟合(overfitting)指的是只能拟合训练数据, 但不能很好地拟合不包含在训练数据中的其他数据的状态[来自 斋藤康溢]但是机器学习的目标本来就是提高泛化能力,在数据不包含在训练数据中,也希望模型能够准确地去预测.因此,抑制过拟合是十分重要的.而正则化是为了防止过拟合的,进而增强泛化能力 (正则化是一种为了减小测试误差的行为(有时...原创 2020-02-27 18:12:10 · 1756 阅读 · 0 评论 -

[概念]卷积的三种模式:valid、same、full

卷积conv: valid 滑动步长为S,图片大小为N1xN1,卷积核大小为N2xN2,卷积后图像大小:(N1-N2)/S+1 x (N1-N2)/S+1 same 滑动步长为1,图片大小为N1xN1,卷积核大小为N2xN2,卷积后图像大小:N1xN1 full 滑动步长为1,图片大小为N1xN1,卷积核大小为N2xN2,卷积后图像大小:(N1+...原创 2020-02-23 22:50:54 · 10340 阅读 · 0 评论 -

[论文解读]U-Net+与FCN的区别+医学表现+网络详解+创新

前半部分作用是特征提取,后半部分是上采样,在一些文献中也把这样的结构叫做编码器-解码器结构,由于此网络整体结构类似于大写的英文字母U,故得名U-net。...原创 2020-05-20 17:12:53 · 16620 阅读 · 5 评论 -

[概念]图像分割的历史 + UNet-Family

2000年之前,数字图像处理时我们采用方法基于几类:阈值分割、区域分割、边缘分割、纹理特征、聚类等。2000年到2010年期间, 主要方法有四类:基于图论、聚类、分类以及聚类和分类结合。2010年至今,神经网络模型的崛起和深度学习的发展,主要涉及到几种模型:截至到2017年底,我们已经分化出了数以百计的模型结构。当然,经过从技术和原理上考究,我们发现了一个特点,那就是当前最成功的...转载 2020-02-22 15:37:20 · 9682 阅读 · 0 评论 -

[论文解读]FCN+与CNN的区别+三大技术+网络结构

论文下载地址 :https://arxiv.org/pdf/1411.4038.pdf原作代码 :https://github.com/shelhamer/fcn.berkeleyvision.org备注: 此文的FCN特指<<Fully Convolutional Networks for Semantic Segmentation>>论文中提出的结构,而非广义的...原创 2020-02-21 20:05:53 · 6899 阅读 · 0 评论 -

[概念]TF学习笔记day04+神经网络的激活函数

一、定义在现实世界中,绝大部分问题都是无法线性分割的, 因此在设计神经网络时,激活函数必须是非线性函数线性函数是一条笔直的直线,而非线形函数不是线性函数之和是线性函数,线性函数的线性函数也是线性函数。因此,使用线性函数,不能表示复杂数据集中存在的非线性。每个神经元都必须有激活函数,即在它们的输出在加权和以及偏置的基础上还做了一个非线形变换(通过激活函数)二、分类目前Tensorflow...转载 2020-02-19 10:41:56 · 3041 阅读 · 0 评论 -

[论文解读]CNN 卷积的魅力+特征图+感受野+共享权重和偏置

一、基础知识1.1卷积神经网络(CNN)CNN新出现了卷积层(Convolution层)和池化层(Pooling层), 这两种不同类型的层通常是交替的, 最后通常由一个或多个全连接层组成卷积网络的核心思想是将:局部感受野、权值共享(或者权值复制)以及时间或空间亚采样(池化)这三种结构思想结合起来获得了某种程度的位移、尺度、形变不变性.诺贝尔奖获得者神经生理学家Hubel和Wie-sel早在...原创 2020-02-19 11:12:24 · 9806 阅读 · 2 评论

分享

分享