使用Embedding API及搭建本地知识库

1. 基于智谱AI调用Embedding API实现词向量编码

首先,生成.env 文件,填写好智谱AI的API-key

参考:大模型入门到实战——基于智谱API key 调用大模型文本生成

读取本地/项目的环境变量。

find_dotenv() 寻找并定位 .env 文件的路径

load_dotenv() 读取该 .env 文件,并将其中的环境变量加载到当前的运行环境中

如果你设置的是全局的环境变量,这行代码则没有任何作用。

同样的我们也可以从response中获取embedding的类型和embedding。response为zhipuai.types.embeddings.EmbeddingsResponded类型,我们可以调用object、data、model、usage来查看response的embedding类型、embedding、embedding model及使用情况。

2. 数据读取

2.1 使用 LangChain 的 PyMuPDFLoader 读取 PDF 文档

在构建知识库时,处理 PDF 文档是一项常见的任务。LangChain 提供了一个高效的工具——PyMuPDFLoader,用于读取和解析 PDF 文件。PyMuPDFLoader 是目前 PDF 解析器中速度最快的一种,能够快速处理大规模的 PDF 文件,并提取其中的内容和元数据。使用 LangChain 的 PyMuPDFLoader,可以快速、高效地解析 PDF 文档,并提取出详细的文本内容和元数据。这使得在知识库建设中,处理 PDF 文件变得更加简单和高效。

1. PyMuPDFLoader 的特点

- 高效性:PyMuPDFLoader 能够快速解析 PDF 文件,并从中提取文本和元数据。

- 详细的元数据:它不仅提取文本内容,还能够获取 PDF 文档和每一页的详细元数据,例如作者、标题、页数等。

- 逐页返回文档:在解析过程中,PyMuPDFLoader 将每一页的内容作为单独的文档返回,便于进一步处理和分析。

安装

2. PyMuPDFLoader 的用法

下面是使用 PyMuPDFLoader 读取 PDF 文件的基本步骤:

- 导入模块:首先,从

langchain.document_loaders导入PyMuPDFLoader类。 - 初始化加载器:创建一个

PyMuPDFLoader实例,并传入要解析的 PDF 文件的路径。 - 加载文档:使用

load()方法加载 PDF 文档。此方法将返回一个文档列表,每个文档对应 PDF 文件中的一页。 - 查看文档内容:通过遍历文档列表,可以访问每一页的内容和元数据。

- 注意事项

- 确保 PDF 文件路径正确且文件存在。

- 列表索引从 0 开始,因此

pdf_pages[1]代表第二页。

实际例子:

3. 应用场景

PyMuPDFLoader 特别适用于需要从大型 PDF 文档中提取特定内容或处理包含复杂结构的 PDF 文件的场景。它能够帮助用户有效地构建和管理基于 PDF 文档的知识库。

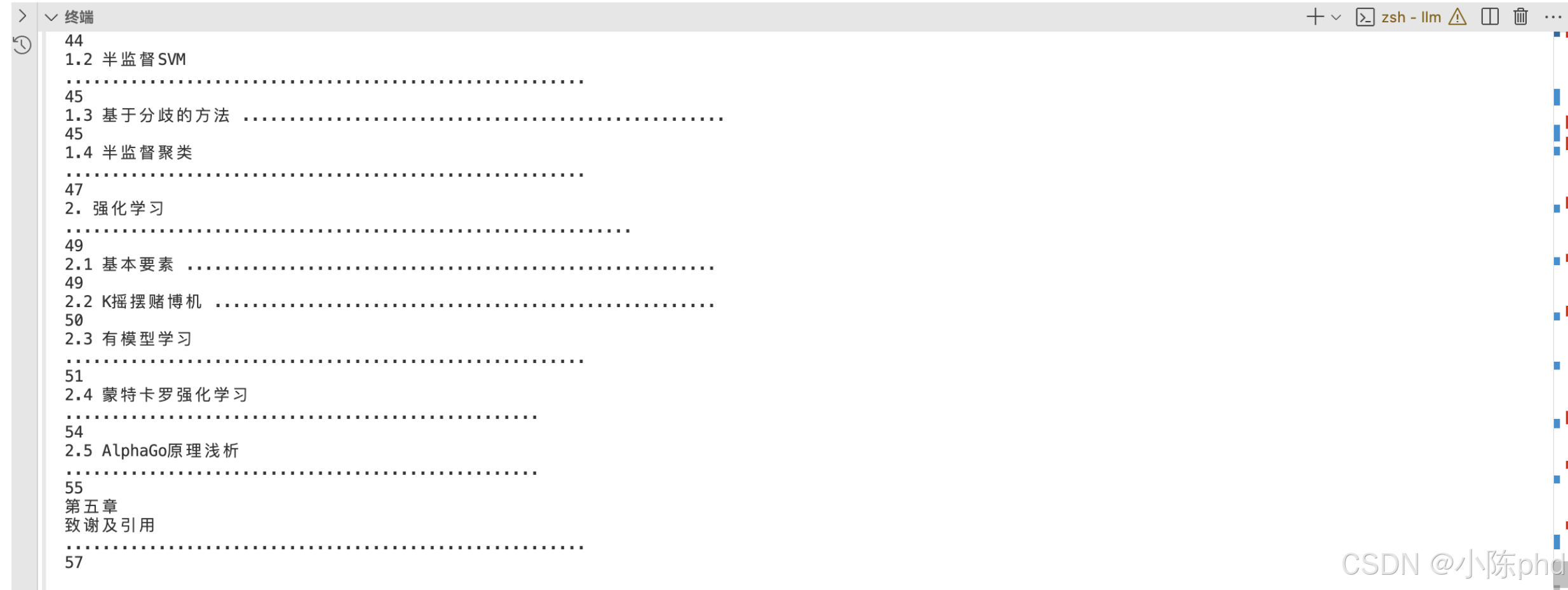

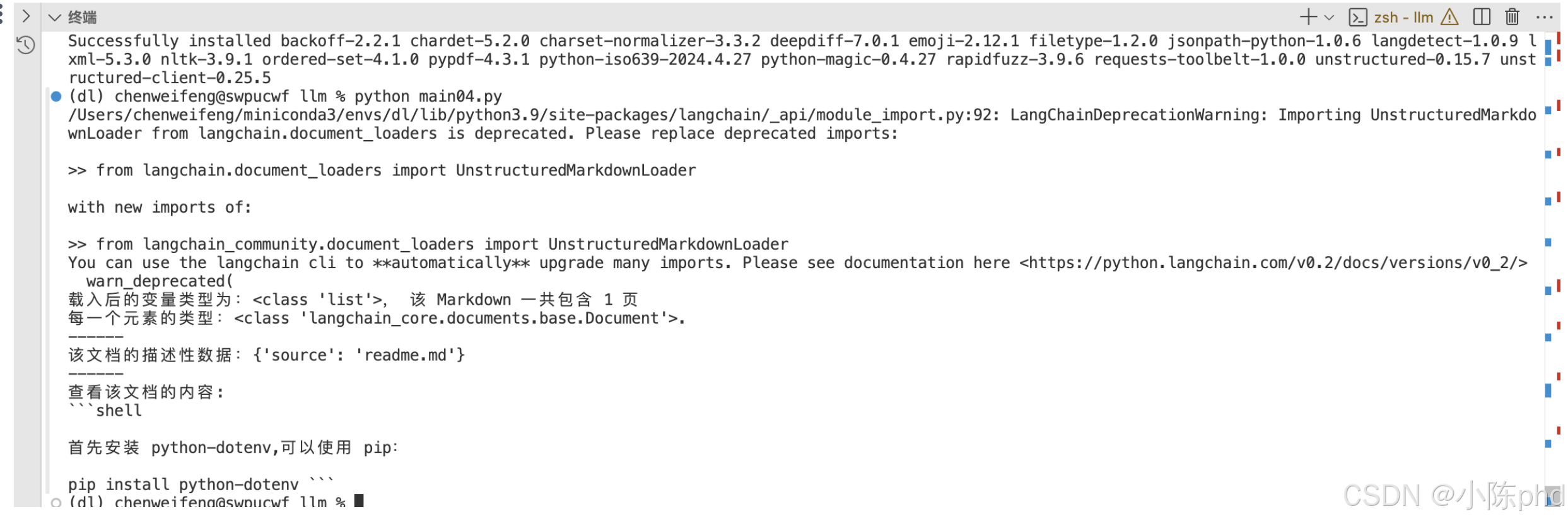

2.2 读取markdown文档

以几乎完全一致的方式读入 markdown 文档:

读取的对象和 PDF 文档读取出来是完全一致的:

3. 数据清洗

在构建知识库时,数据清洗是一个非常重要的步骤,其目的是为了确保知识库中的数据是有序的、优质的和精简的。以下是为什么在知识库搭建过程中需要清洗数据的一些原因:

3.1 特点

1. 提高数据的可读性

原始数据可能包含许多格式化问题,比如在读取 PDF 文件时常见的换行符(\n)问题。这些换行符在文档中可能是由于排版原因而存在,但在知识库中可能会破坏内容的连贯性,影响可读性。通过清洗数据,可以去除这些不必要的换行符,使文本更加流畅和易读。

2. 减少噪音数据

噪音数据是指那些对信息的理解没有帮助,甚至可能产生误导的无用数据。例如,文档中多余的空行、格式化字符、无意义的符号等,都会影响文本的质量和理解。清洗数据的过程可以帮助去除这些噪音,保留有用的关键信息。

3. 保证数据的一致性

知识库中的数据应该具有一致的格式和结构,以便于后续的查询和分析。如果数据格式不一致,例如同一类型的信息在不同文档中以不同的方式呈现,会导致查询复杂化,甚至产生错误的结果。清洗数据有助于确保格式的一致性。

4. 优化存储和处理效率

冗余和无用的数据不仅占用存储空间,还会增加处理复杂度,导致资源浪费。通过数据清洗,可以删除多余的信息,精简数据结构,从而提高存储和处理的效率。

5. 提升模型的精度

如果知识库数据是用于训练机器学习或自然语言处理模型的,那么数据的质量直接影响模型的性能。清洗数据可以确保模型的训练集更准确,从而提升模型的精度和有效性。

6. 保持数据的相关性

在一些情况下,原始文档中可能包含过时或不相关的信息,这些信息可能对当前的知识库没有价值。清洗数据的过程可以帮助筛选出最新的、最相关的信息,确保知识库内容的高质量。

3.2 代码示例:使用正则表达式清洗数据

以下是一个简单的 Python 代码示例,展示如何使用正则表达式来删除文本中的多余换行符:

消除掉空格,•等字符

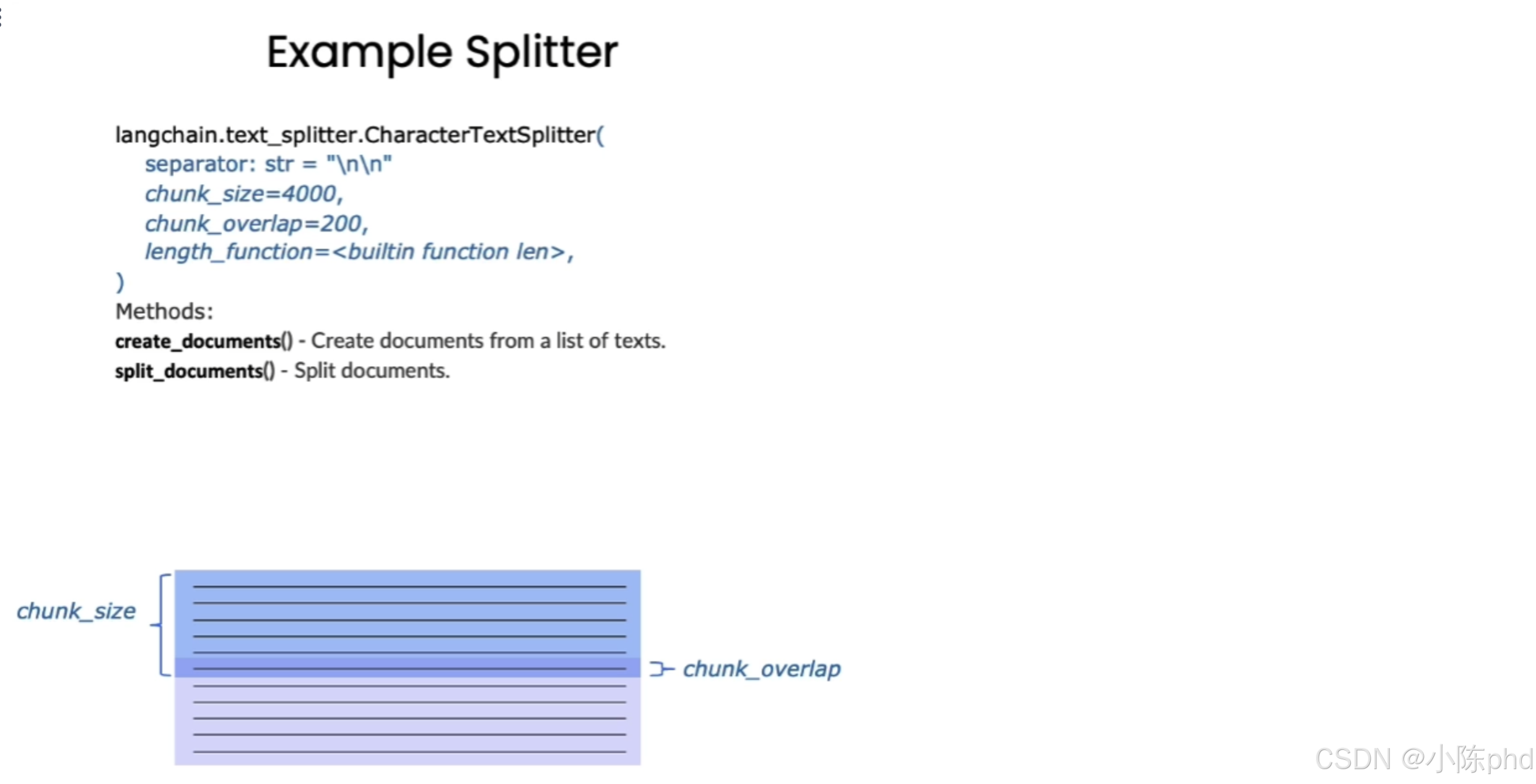

、在构建向量知识库时,由于文档长度可能超过模型支持的上下文长度,因此需要将文档分割成较小的片段(chunk),以便模型能够有效处理和检索。这是通过 chunk_size 和 chunk_overlap 两个参数来控制分割过程的。通过设置合理的 chunk_size 和 chunk_overlap,可以有效地分割文档,使得模型能够在处理长文档时,依然保持对上下文的理解能力,并且在检索时返回高质量的结果。这种方法在构建高效的向量知识库中非常重要。在检索时,我们会以 chunk 作为检索的元单位,也就是每一次检索到 k 个 chunk 作为模型可以参考来回答用户问题的知识。

4.1 chunk_size(块大小)

chunk_size 指每个块包含的字符或 Token (如单词、句子等)的数量

chunk_size 是指每个文档片段的最大长度(通常以字符或标记数来计量)。这个参数决定了每个 chunk 的大小。较大的 chunk_size 可以包含更多的上下文信息,但也有可能超出模型的处理能力;而较小的 chunk_size 则更容易被模型处理,但可能会丢失一些上下文。

4.2 chunk_overlap(块重叠大小)

- chunk_overlap 指两个块之间共享的字符数量,用于保持上下文的连贯性,避免分割丢失上下文信息

chunk_overlap 定义了相邻 chunk 之间的重叠部分的大小。这是为了确保每个 chunk 在分割后,依然保留部分上下文信息,从而在模型处理时,不会因为分割而导致语义的断裂。例如,如果一个句子被分割成两个 chunk,通过 chunk_overlap 保持部分重叠,可以确保两个 chunk 都包含完整的句子信息。

4.3 分割方式的选择

- 按长度分割:可以简单地按

chunk_size指定的长度进行分割,然后按chunk_overlap进行重叠处理。这种方法适用于内容比较平铺直叙的文档。 - 按固定规则分割:有时,我们可以根据自然段落、句子或其他语义单位来分割,这种方法需要更复杂的分割逻辑,但能够更好地保持文本的语义完整性。

4.4 实际使用示例

在实际操作中,我们可以通过 LangChain 提供的文本分割器来实现这些功能。

- RecursiveCharacterTextSplitter(): 按字符串分割文本,递归地尝试按不同的分隔符进行分割文本。

- CharacterTextSplitter(): 按字符来分割文本。

- MarkdownHeaderTextSplitter(): 基于指定的标题来分割markdown 文件。

- TokenTextSplitter(): 按token来分割文本。

- SentenceTransformersTokenTextSplitter(): 按token来分割文本

- Language(): 用于 CPP、Python、Ruby、Markdown 等。

- NLTKTextSplitter(): 使用 NLTK(自然语言工具包)按句子分割文本。

- SpacyTextSplitter(): 使用 Spacy按句子的切割文本。

以下是一个基本的代码示例:

4.5 检索时的应用

在检索时,模型会以 chunk 作为基本的检索单位,返回与查询最相关的 k 个 chunk。这些 chunk 作为模型回答问题的参考知识,k 的值可以根据具体需求和模型的容量进行调整,以平衡性能和答案的准确性。

参考

https://datawhalechina.github.io/llm-universe/#/C3/3.数据处理

8006

8006

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?