1.正则化的引用

线性模型常用来处理回归和分类任务,为了防止模型处于过拟合状态,需要用L1正则化和L2正则化降低模型的复杂度,很多线性回归模型正则化的文章会提到L1是通过稀疏化参数来降低复杂度,L2是通过减小参数值的大小来降低复杂度

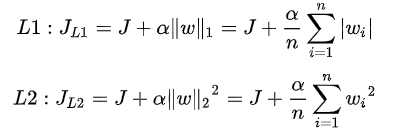

2. L1正则化和L2正则化的公式

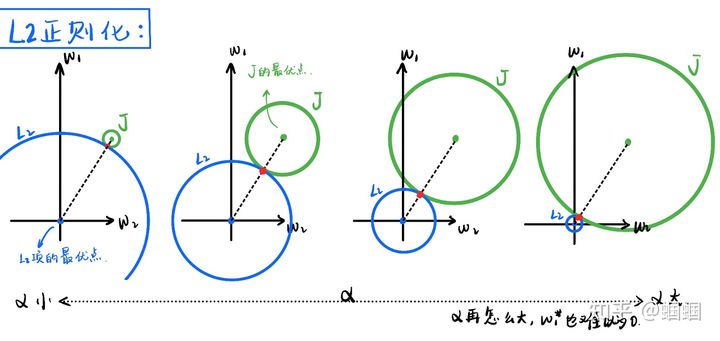

2.1用等高线展示L1,L2几何解释

图中:

- 蓝色的一层层的线,代表正则项的等高线,对于L1它是菱形的,对于L2它是圆形的;

- 绿色的一层层的圆圈,代表原始损失函数的等高线图;

- 黑色的是坐标轴,这里展示的是二维特征的坐标轴。

关键的关键:

- 蓝色的等高线和绿色的等高线,分别代表了两个优化问题。对原始的损失函数J添加了正则像之后,优化问题就变成了两个子优化问题的博弈。

- 当J和正则项之和最小时,上述的博弈取得平衡。而此时平衡点一定是相切点/端点。相切点的具体位置,取决于正则项的惩罚力度,也就是公式里的

。每一个平衡点,对应着一个

。每一个平衡点,对应着一个 的设置。

的设置。

- 可以想象:当惩罚力度大时,蓝色的线希望扯着绿色的线,往靠近坐标轴的方向移动,而惩罚力度小时,绿色的线希望扯着蓝色的线,往远离坐标轴的方向移动。

那么就好理解了,我们可以发现:

- 对于L1正则化,蓝线和绿线的相切点,随着蓝线不断靠近坐标轴,早晚会碰到坐标轴,抵达坐标轴之后,最优点会保持在L1等高线的端点处,依然在坐标轴上,故某个特征的值会变为0。

- 而L2的相切点则只能无限接近坐标轴,惩罚力度再大,都到不了0。

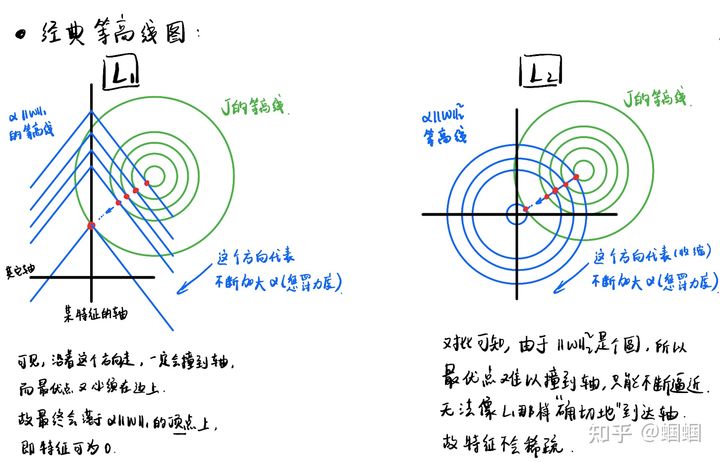

2.2 用等高线分步L1和L2的几何解释

L1图示

图中展示的都是达到最优的时候的两个等高线的关系。图注都写在图片里了,随着![]() 的增大,L1的蓝色的方框不断缩小,拉扯着J的绿色圆圈变大,第三张子图的时候,最优点到达了L1的顶点

的增大,L1的蓝色的方框不断缩小,拉扯着J的绿色圆圈变大,第三张子图的时候,最优点到达了L1的顶点

后面如果继续增大的话,最优点会沿着纵坐标往下滑。所以,当![]() 超过某个阈值的时候,最优解中的w1就会总等于0.

超过某个阈值的时候,最优解中的w1就会总等于0.

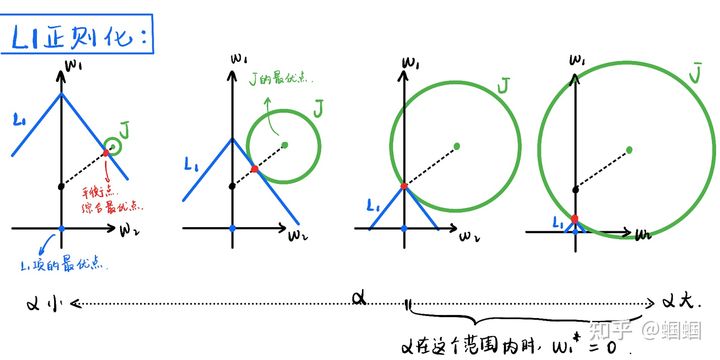

L2图示

L2理解起来久简单多了,两个圆一直都是相切的状态,切点永远到不了原点,也就没法让某个特征等于0。

5157

5157

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?