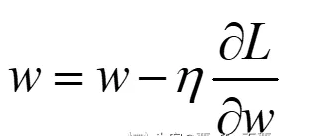

随机梯度下降(SGD):

SGD指的是mini batch gradient descent

简单好理解,但是其存在的缺陷是,只有当自变量是一个维度的时候,它的前进方向才是真正梯度下降的方向。当存在多维变量时,若某一维度的梯度过大,会使得下降方向在该梯度方向的分量过大,偏离了真正的轨道。

优点:针对大数据集,训练速度很快。从训练集样本中随机选取一个batch计算一次梯度,更新一次模型参数。

缺点:

1. 选择恰当的初始学习率很困难。

2. 学习率调整策略受限于预先指定的调整规则。

3. 相同的学习率被应用于各个参数。

4. 高度非凸的误差函数的优化过程,如何避免陷入大量的局部次优解或鞍点,即容易收敛到局部最优

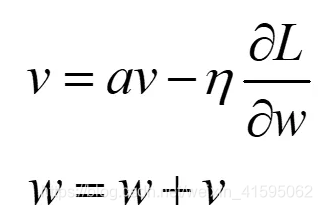

Momentum

其公式意义为,如果一直朝着某个方向前进,那么在这个方向上的梯度会越来越大。当使用SGD时,会出现过度振荡,徘徊前进,而在这个过程中其实那个梯度分量过大的方向的梯度其实在慢慢减小的,原本梯度分量较小的方向在慢慢增大,动量思想

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

591

591

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?