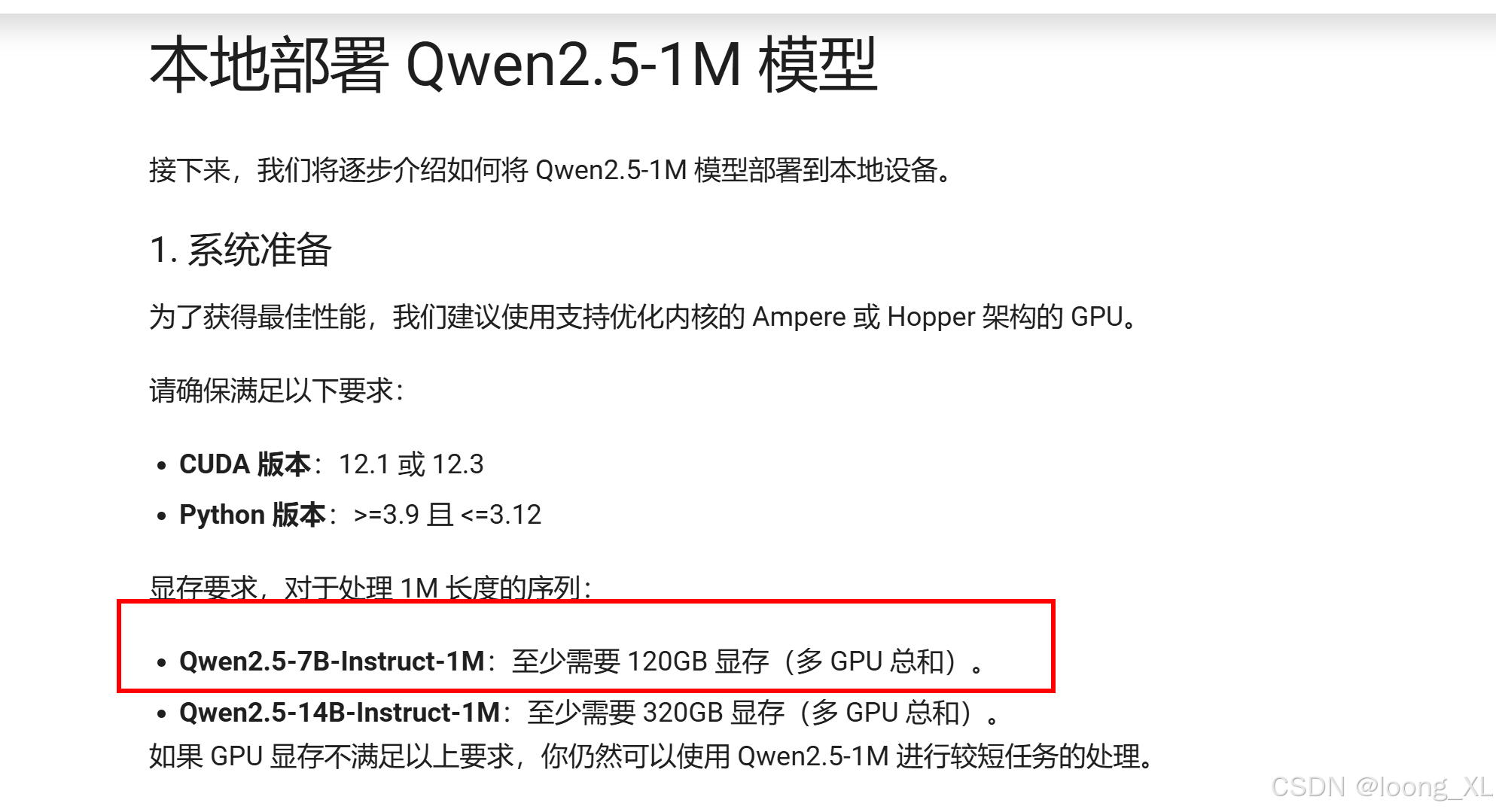

新版本Qwen2.5-1M(本地部署需要120G显存)

https://qwenlm.github.io/zh/blog/qwen2.5-1m/

这里qwen2使用的YARN长度外推

https://qwenlm.github.io/zh/blog/qwen2/

常见外推方法:需要训练和不需要训练

https://kexue.fm/archives/9859

1、model_max_length 32k

参考:

https://huggingface.co/Qwen/Qwen2-7B-Instruct/blob/main/config.json

config配置文件里也可以看到一些模型信息,能输入识别长度max_pos

订阅专栏 解锁全文

订阅专栏 解锁全文

2075

2075

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?