在上一篇文章中,详细介绍了安卓设备的作为笔记本电脑扩展屏的步骤,接下来将详细介绍扩展屏的优化步骤,降低延迟、拒绝卡顿。

安卓设备和电脑是通过网络连接,操作速度受WiFi信号速度影响,如果使用USB网络共享,带宽增大,延迟则会很低。

①首先,用USB数据线连接安卓设备和PC端(用USB3.0的接口)。

②在安卓设备的设置中开启USB网络共享。

这个步骤网上教程很多,都是打开安卓设备的设置中的USB网络共享开关。

然而,华为畅享平板2里并没有这个选项(nova Pro 7 5G里也没有),于是我就在平板的设置里找了个比较像的选项打开了。

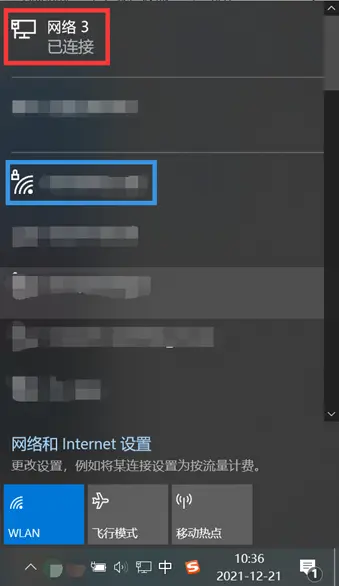

③在PC端选择连接到安卓设备共享的网络。

我对这个步骤的理解是,安卓设备把自己连接到的WiFi分享给PC端。(我不是IT专业的)

蓝框是原来连接的WiFi,红框是安卓设备共享的网络(就是那个WiFi)。

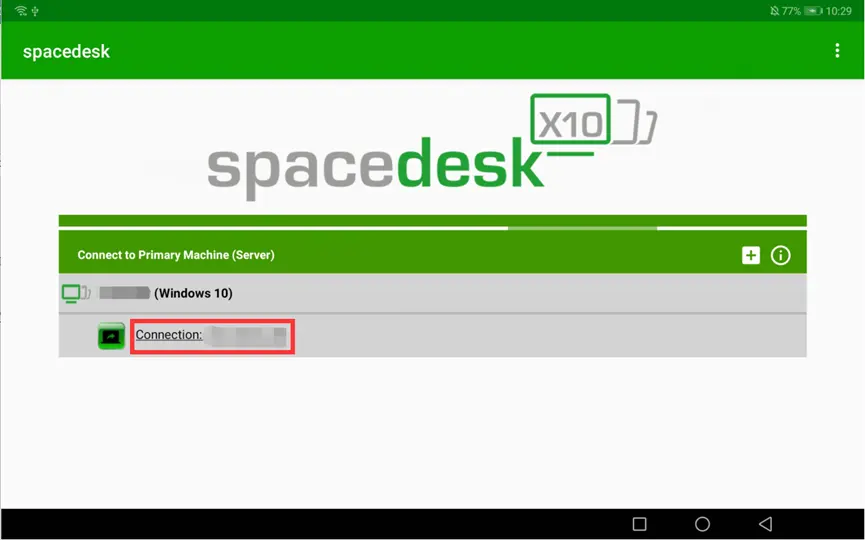

④然后在安卓设备中打开spacedesk软件,可以看到要连接的PC端换了一个IP地址(上一篇文章的图,借用一下),然后点击它,就可以作为扩展屏连接到PC端。

⑤至此,数据传输效率就大大提高了,几乎没有延迟和卡顿。

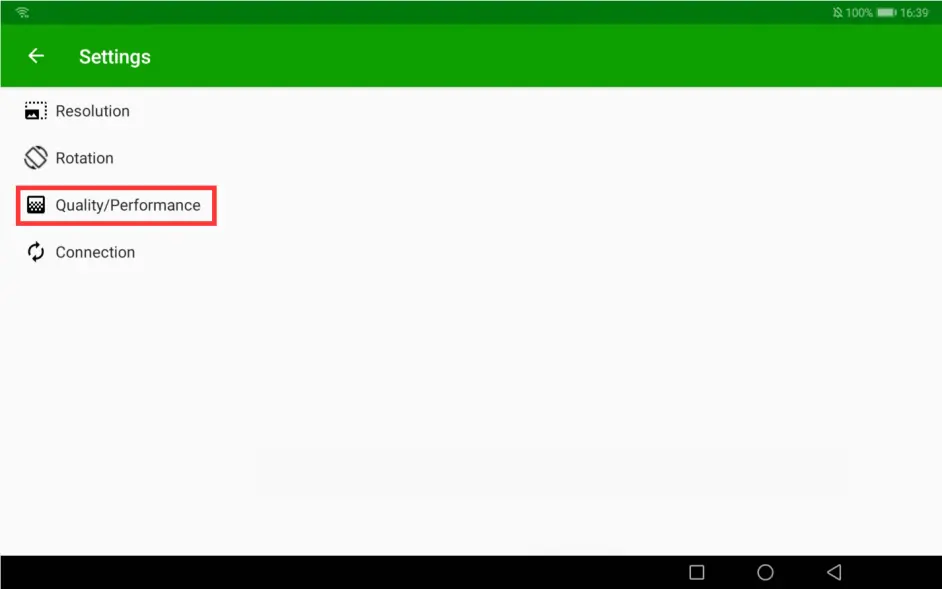

⑥为了更加优化,可以在安卓端选择退出扩展屏的连接,然后点击右上角的三个小点,进入Settings(设置)。

⑦选择第三个选项Quality/Performance。

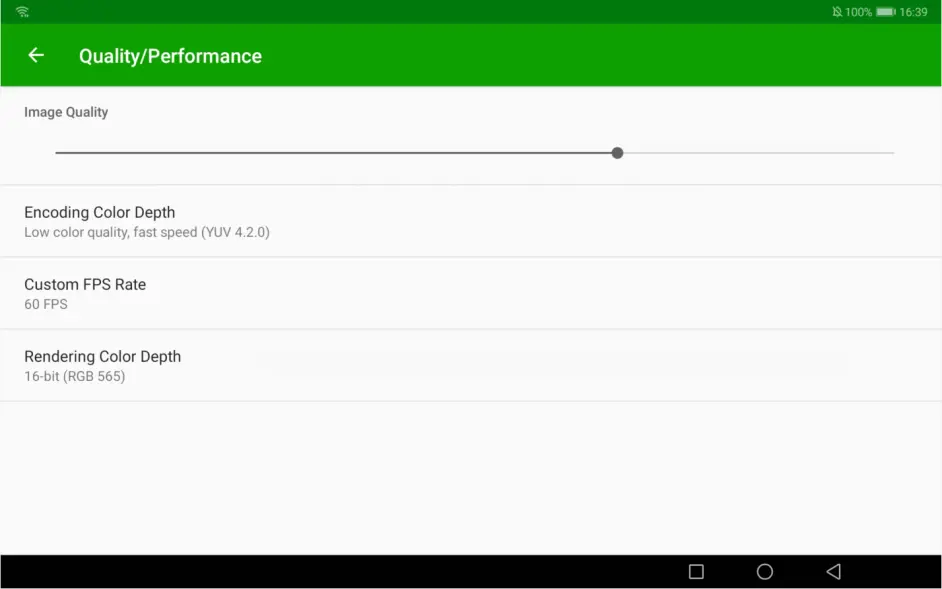

⑧调节这几个项,下图是我调的,是为了尽可能不延迟、不卡顿。

⑨再将安卓设备作为扩展屏与PC端连接,会发现除了鼠标有极小的延迟外(毕竟不论什么数据传输也是要时间的啊),几乎没有卡顿,操作流畅。至此,扩展屏的优化完成。

2642

2642

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?