邱锡鹏 在YOCSEF上海 2020自然语言处理NLP技术前沿进展上的报告

https://www.bilibili.com/list/watchlater?bvid=BV12v411W7GN&oid=246197266&p=5

自然语言表示学习

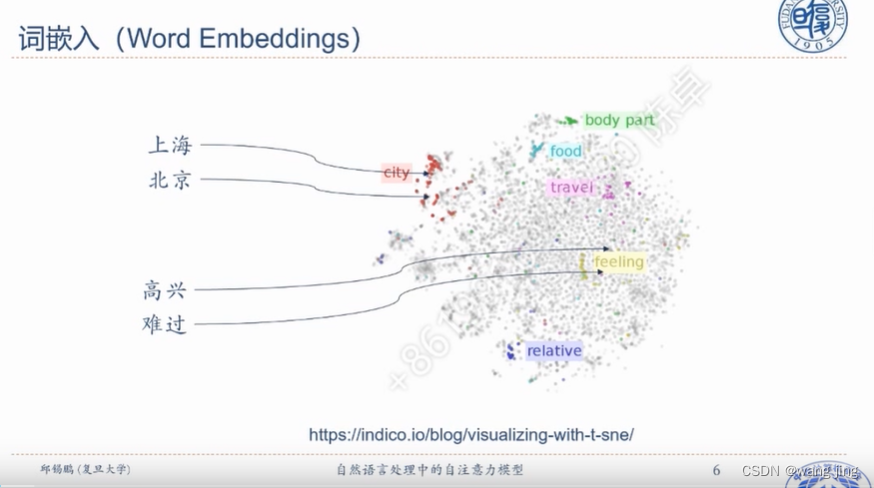

用向量来表示语义,解释性会差一点,但表示能力更强。分布式的意思就是:把语义分布在高维空间每一维上,所有维度加起来表示一个语义。

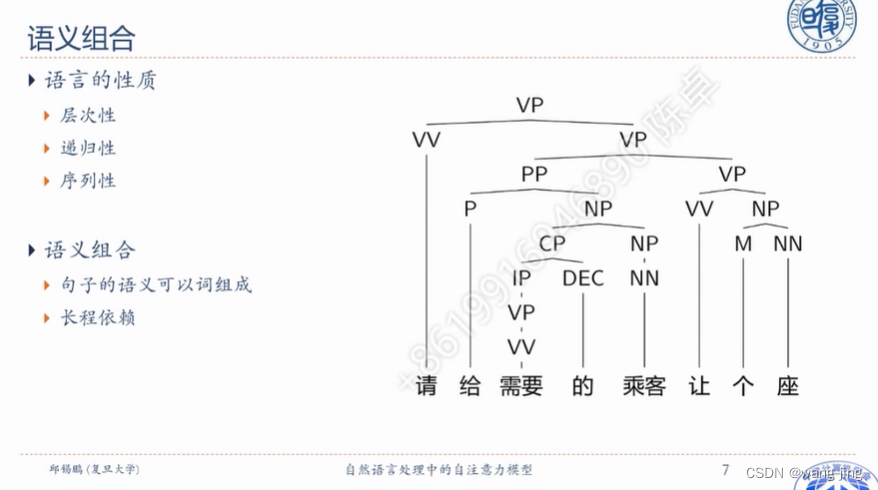

用词的语义表示句子的语义,非组合性的如习语等。可能需要外部知识辅助

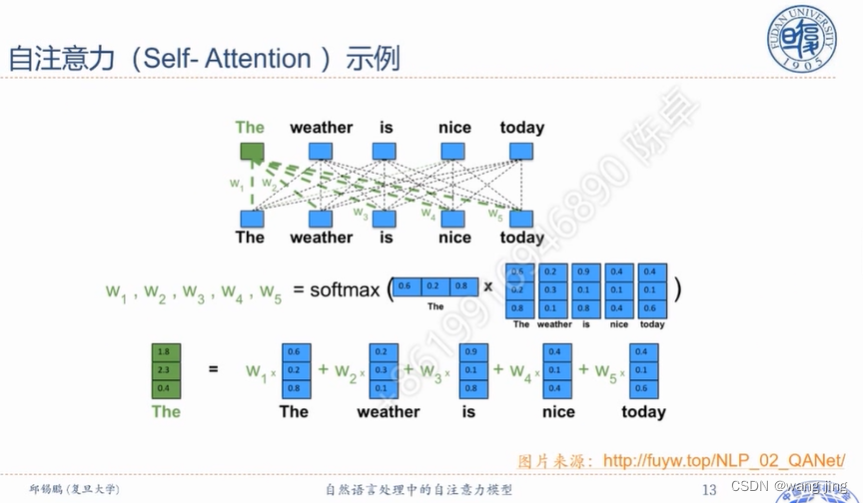

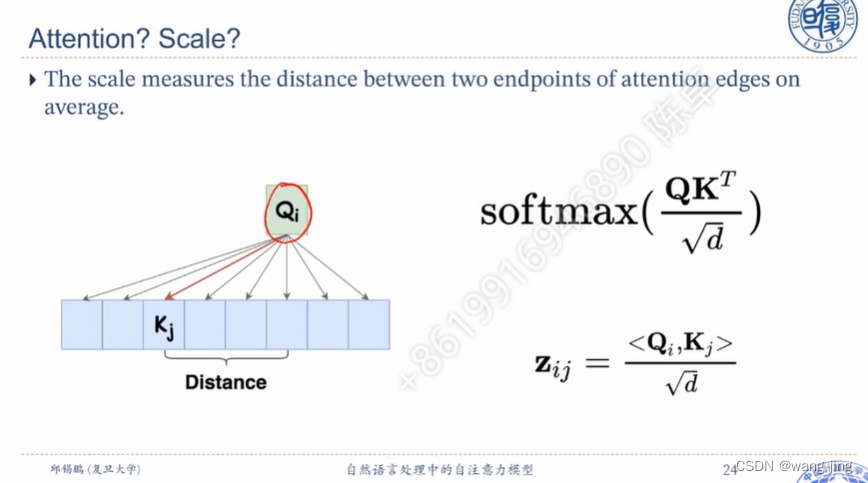

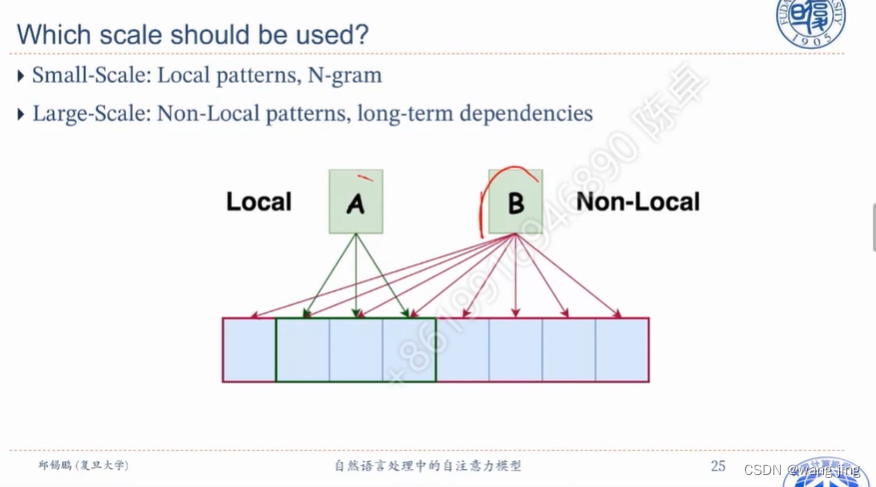

长程依赖问题:如何建模两个非常远的词之间的交互关系

一般情况下模型框架:词的表示(非上下文相关的表示)

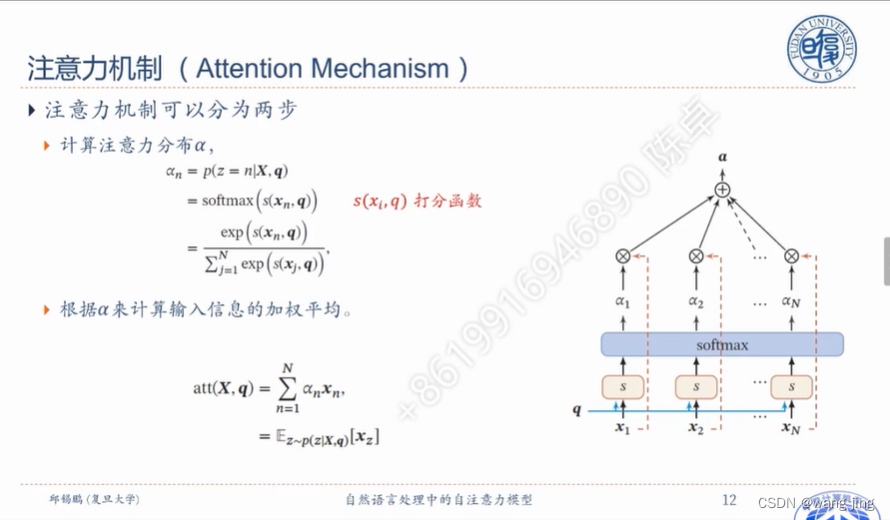

模型驱动(如何定义Contextual Encoder)+数据驱动(通过NLP任务,学习模型中的参数)=自然语言表示学习

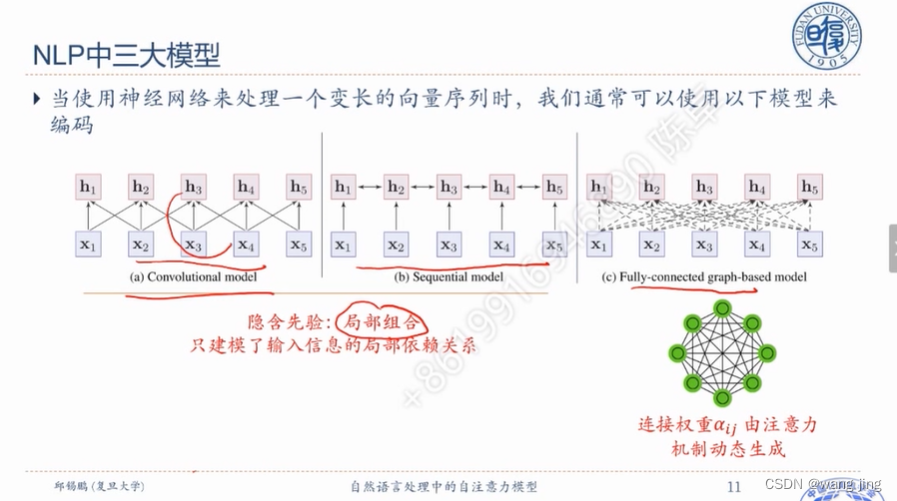

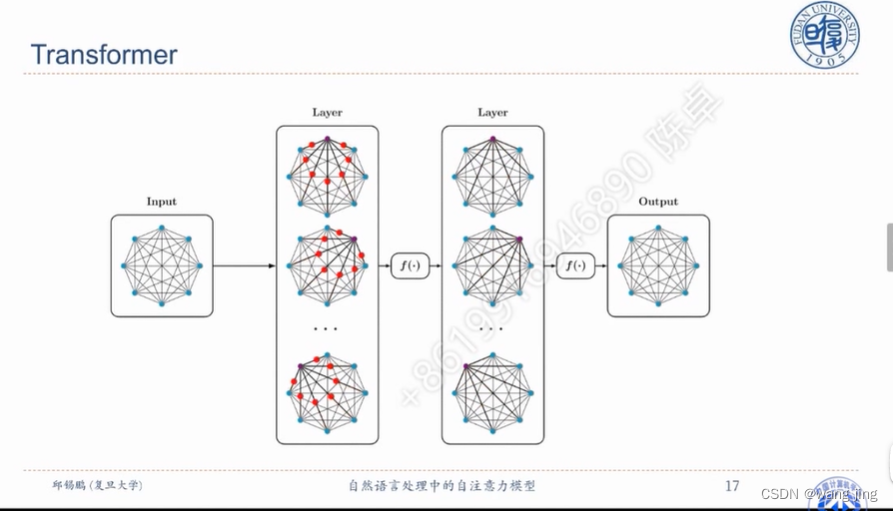

局部组合:浅层模型只能建模局部依赖关系;

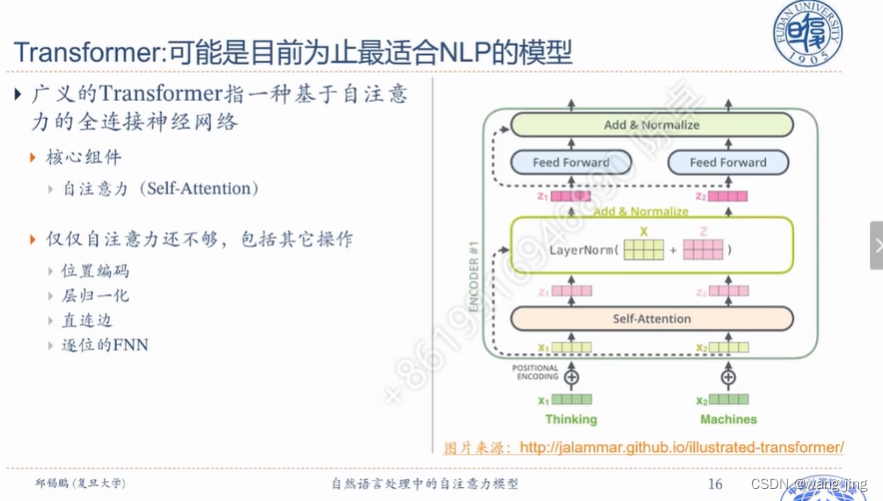

FNN 被认为是非常重要的一个部分

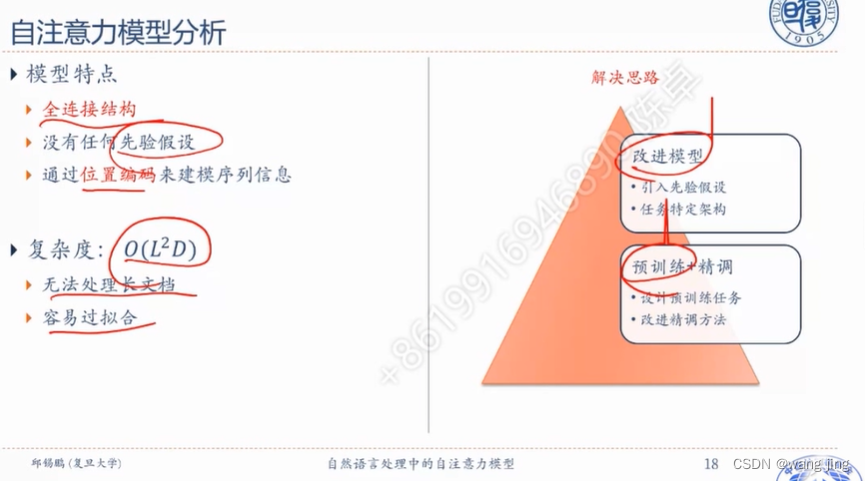

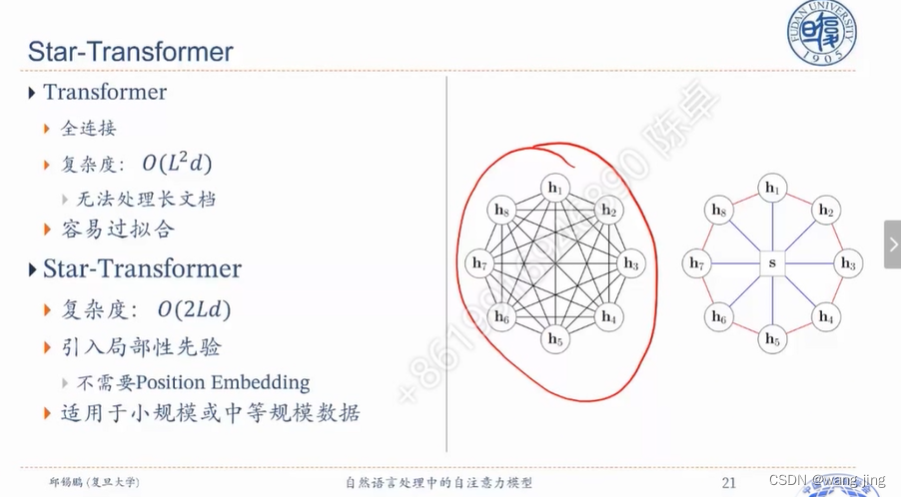

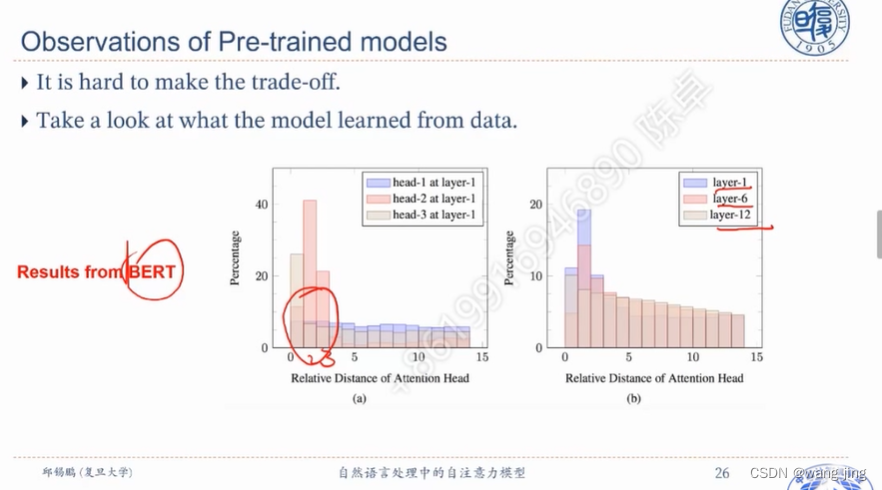

没有任何先验假设:对比于CNN和RNN有局部先验假设,也就是Transformer 的所有knowledge都来自数据,数据非常小时会造成没有足够信息建模关系

全连接结构所以导致容易过拟合

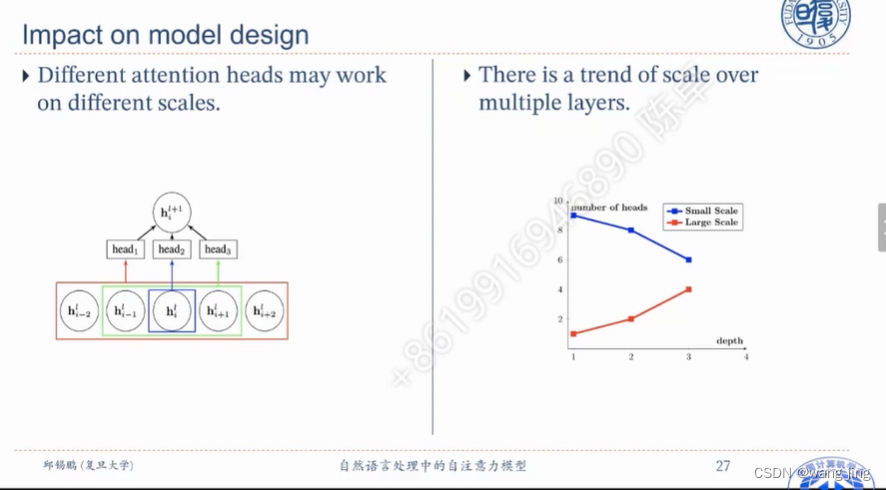

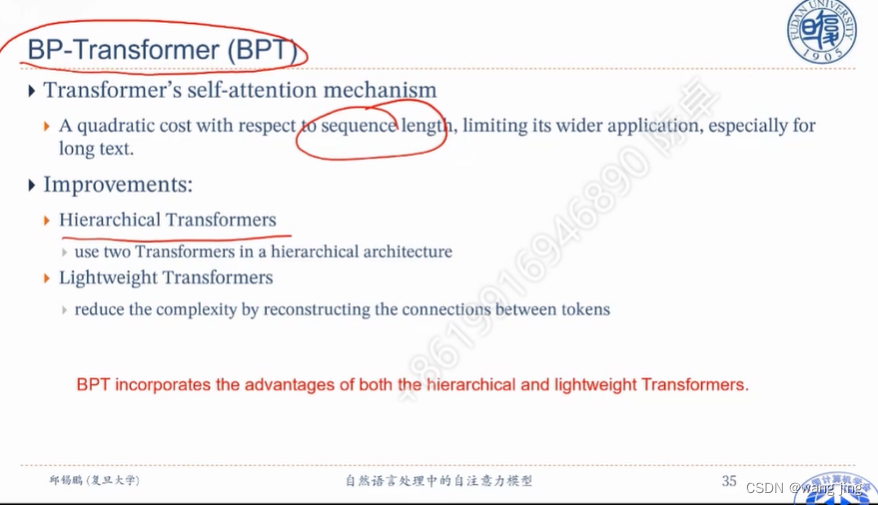

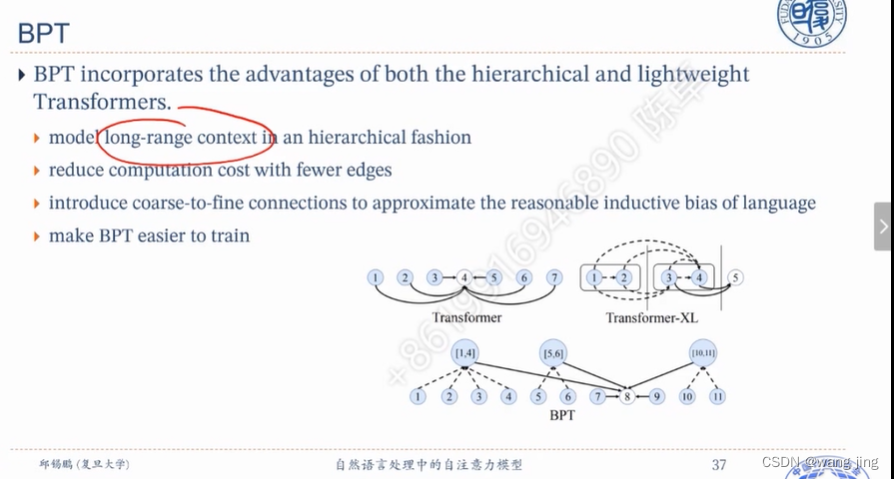

模型改进:引入先验

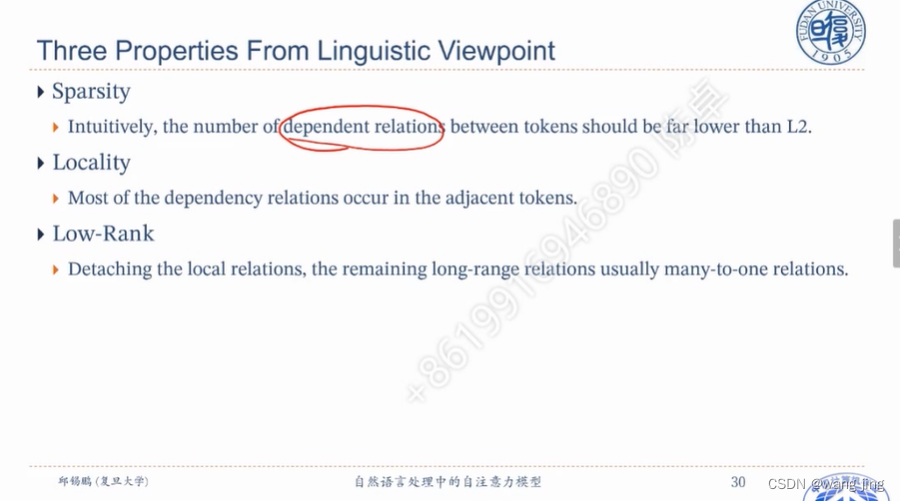

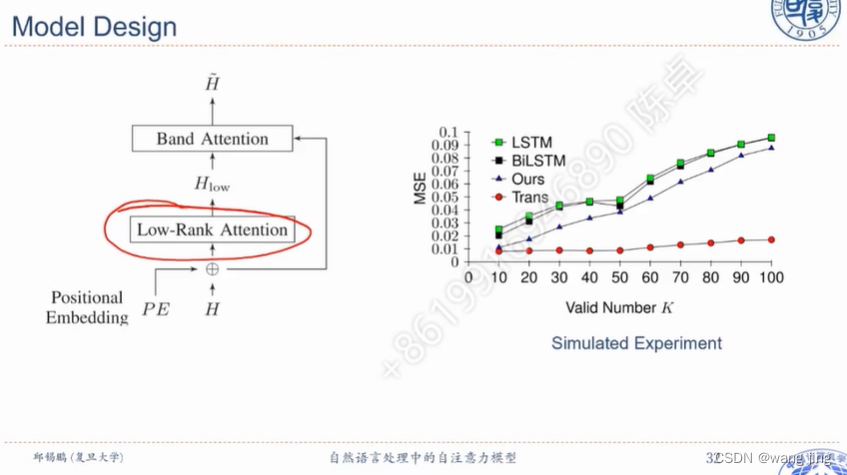

Sparsity稀疏

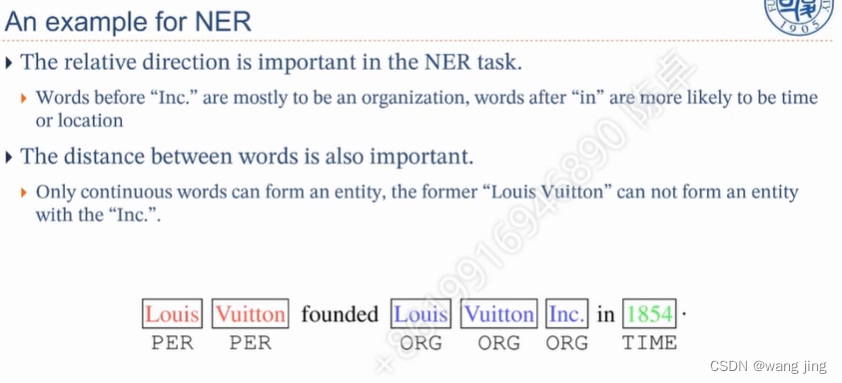

针对特定任务的改进

多标准中文分词

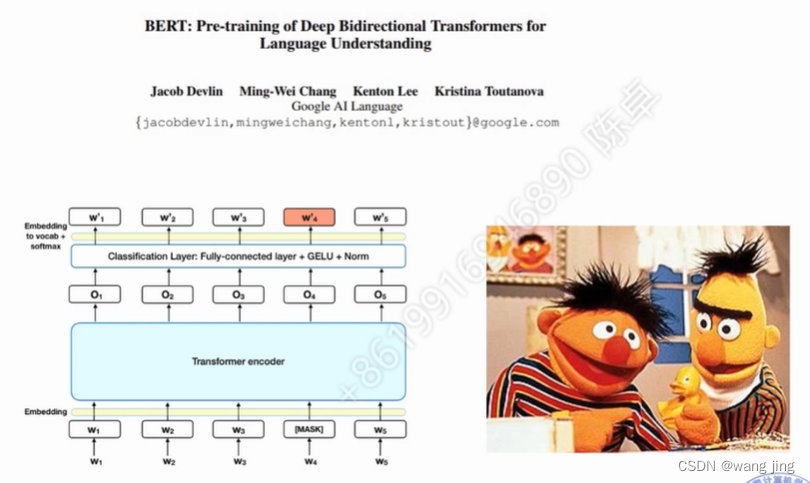

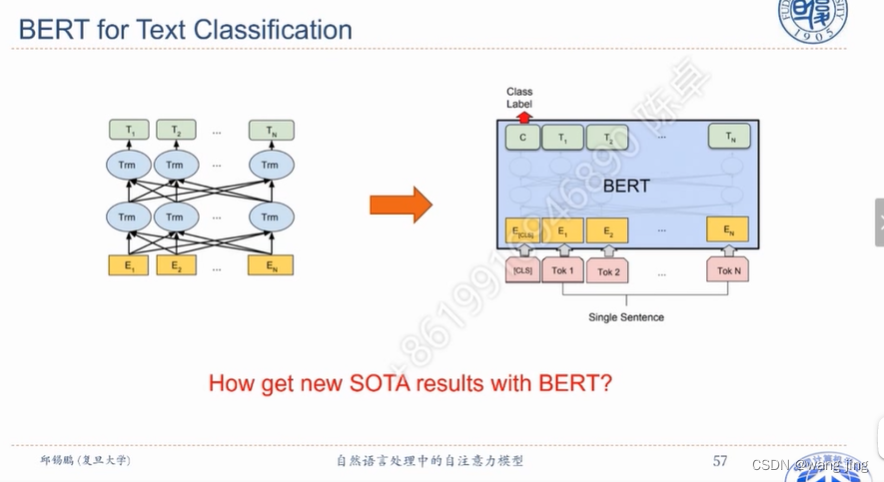

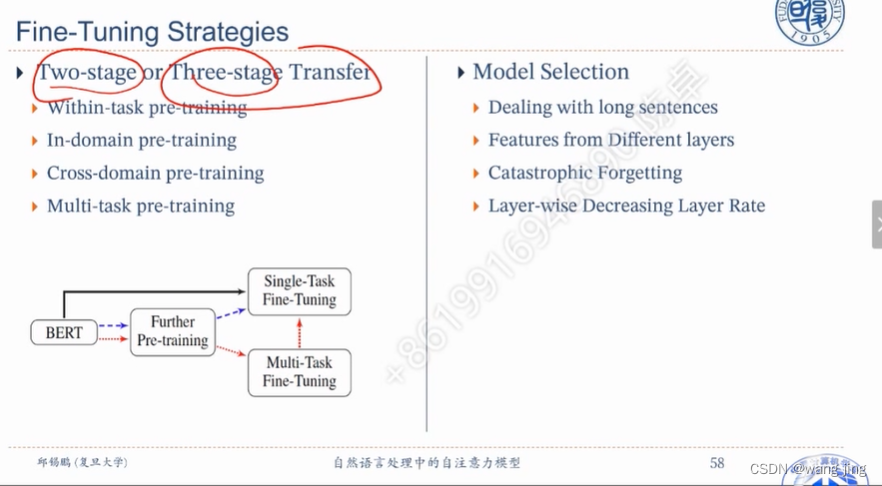

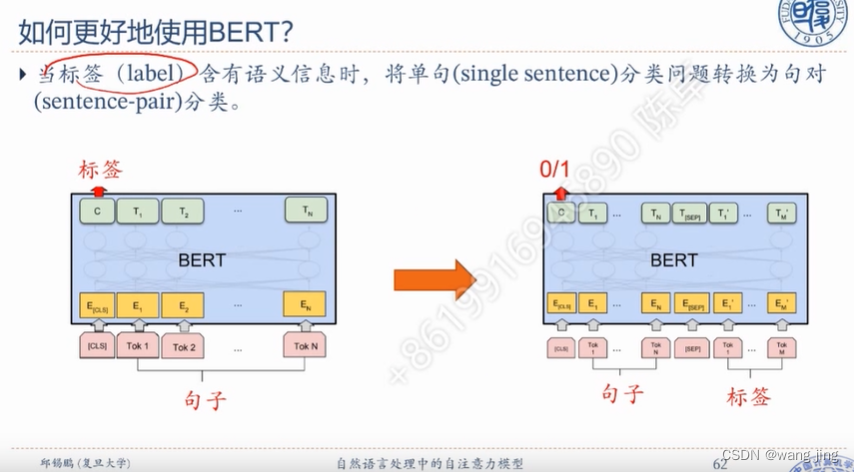

NLP任务的新范式:预训练+精调

4776

4776

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?