域自适应作为迁移学习的一种方法,主要解决源域与目标域之间分布不同的相似任务决策问题,但域自适应问题要求取得目标域的有标注或无标注数据,这与真实场景具有较大的区别。域泛化则是研究这一问题的有效方法,它希望模型能够学到域无关的特征,这种特征可以容易地泛化到新的测试数据域上。

作为一直以来各大顶会的热门方向,今年关于域自适应和域泛化的高质量论文数量也是相当客观,所以我又来做分享了。

这次收集了9篇机器学习顶会ICML域自适应/域泛化相关的 poster 论文,资料已打包,PDF+代码都整理了,文末领取

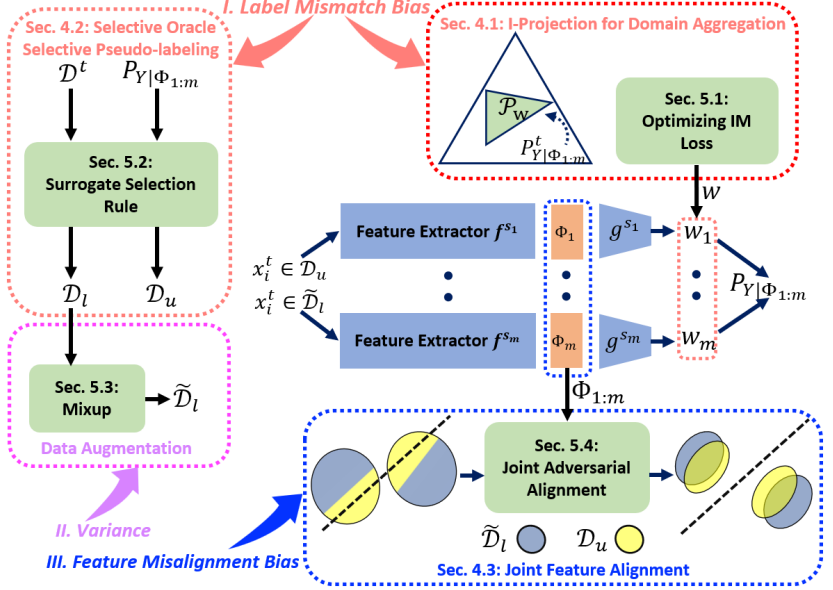

1.On Balancing Bias and Variance in Unsupervised Multi-Source-Free Domain Adaptation

这篇文章研究了无源域 adaptation 的机器学习技术。

由于隐私、存储等限制,不访问源模型训练数据的无源域 adaptation 技术日益重要。现有的多源无源域 adaptation (MSFDA) 方法通常使用源模型生成的伪标签数据训练目标模型,主要关注提升伪标签技术或设计新的训练目标。

本文试图分析MSFDA的基本极限,具体而言,作者开发了目标模型泛化错误的信息理论下界,该下界阐明了一个固有的偏差-方差权衡,然后从3个方面提供平衡该权衡的洞见:域聚合、选择性伪标记、联合特征对齐,这导致了新算法的设计。

在多个数据集上的实验证明,作者所提出的算法具有最先进性能,特别是在一些最具挑战性的数据集上,包括Office-Home和DomainNet。

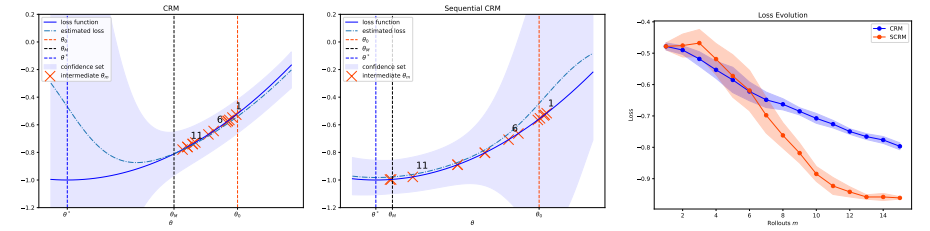

2.Sequential Counterfactual Risk Minimization

这篇文章探索了反事实风险最小化(CRM)在可以多次部署学习策略并获得新数据的场景下的应用。

CRM是处理logged bandit反馈问题的一个框架,其目标是用离线数据改进日志策略。作者将CRM原理和理论扩展到可以多次部署策略并获得新数据的场景,称为“顺序CRM(SCRM)”。

作者提出了一个新的反事实估计器,并确定了一些条件,这些条件可以通过类似于加速优化方法中的重启策略的分析来改进CRM的过剩风险和后悔率。在离散和连续动作设置中对该方法进行了经验评估,证明了多次部署CRM的好处。相比仅进行一次CRM,SCRM可以在一定条件下获得更低的过剩风险和更快的后悔率收敛速度。

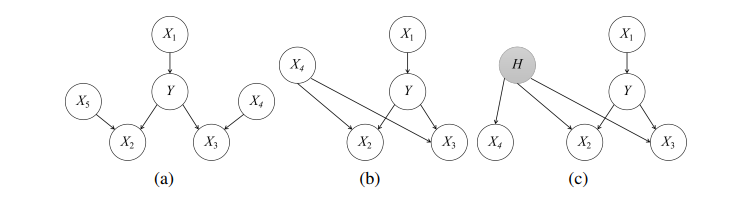

3.Provably Invariant Learning without Domain Information

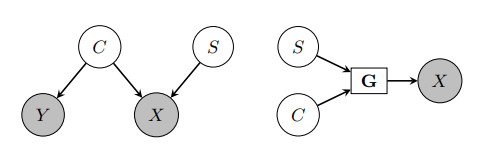

作者研究了无需环境信息的环境无关不变性学习,以提高模型的鲁棒性。

典型的机器学习应用都假设数据满足独立同分布(IID),但这个假设在真实世界中常被违反,导致了分布偏移(OOD)概化问题和模型鲁棒性大幅下降,不变性学习技术被利用来区分输入特征中的偶发性特征和不变性特征,并仅依据不变性特征训练模型。许多不变性学习方法需要训练数据包含域信息,如环境索引或先验知识获得的辅助信息。但是获得这些信息在实践中通常不可能。

本文提出了TIVA,一个无需环境特定信息的环境无关不变性学习方法。在某些轻度数据条件下,可以训练一个基于与目标无关的属性的环境划分策略,然后进行不变性风险最小化。在多个基准测试中,与其他基线方法相比,该方法展示了在OOD下的卓越性能和优异的鲁棒性。

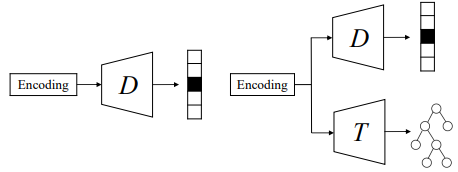

4.Taxonomy-Structured Domain Adaptation

这篇文章研究了具有层次分类结构的域的域自适应问题。

传统的域自适应方法大多局限于分类域,过于简化了现实世界中的细致的域关系。本文针对具有分类法结构的域,将域形式化为具有嵌套分层相似性结构的域,如动物物种和产品目录。

基于经典的对抗框架,作者提出了一个新的分类法专家,与对抗判别器竞争以保留分类法信息。如果给定非信息性的域分类法(如所有叶节点连接到根节点的平坦分类法),则平衡恢复经典对抗域自适应的解决方案;对其他分类法给出非平凡的结果。在合成和真实世界数据集上的实验中,本方法实现了状态最优的性能,并成功实现了自适应。

5.Generalization Analysis for Contrastive Representation Learning

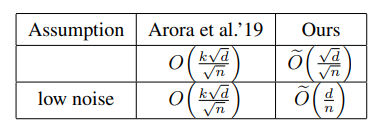

对比学习在各种机器学习任务中都展示了极佳的性能,但现有的泛化分析很有限甚至没有意义。现有的泛化误差界与负样本数k线性相关,但实践中经常需要很大的k来保证对比学习在下游任务中的泛化。

本文建立了与k无关的对比学习泛化误差界,对数项除外,分析利用了经验覆盖数和Rademacher复杂度的结构结果,利用了损失函数的Lipschitz连续性。对于自定界的Lipschitz损失函数,进一步通过乐观界发展了快速率的结果,适用于低噪声条件。本文将结果应用于线性表示和基于深度神经网络的非线性表示,都导出了Rademacher复杂度界来获得更好的泛化界,因此本文的分析改进了对比学习的泛化理论。

6.Moderately Distributional Exploration for Domain Generalization

作者提出了一个称为MODE的方法,用于提高域泛化的性能。

域泛化目的是处理训练域和未知目标域之间的分布变换,生成新域是最有效的方法之一,但其性能提升依赖于生成域和目标域之间的分布差异。分布鲁棒优化通过在一个不确定集中探索域来处理分布差异,这很有前景。但是,不确定集可能非常大,导致域泛化中的低置信度预测。这是因为一个大的不确定集可能引入语义上不同的因素,与训练域不同。为解决这个问题,作者提出进行适度分布探索(MODE)用于域泛化。

具体而言,MODE在一个与训练域共享相同语义因素的不确定子集中进行分布探索。实验证明,MODE可以赋予模型在未知目标域上有可证明的泛化性能。

7.Distribution Free Domain Generalization

这篇文章提出了一种称为DFDG的分布自由域泛化方法,以提高对分布偏移数据的预测准确性。

在域泛化中,源域的训练数据分布往往与目标域的数据分布不同,而目标域的数据在训练中不可用。DFDG通过进行标准化来避免少数域在训练中占主导地位。DFDG的实质是用成对两样本测试统计量重新表述跨域/类的偏差,并平等地加权它们的重要性或协方差结构,以避免主导域/类,为多类分类问题建立了理论泛化界。

DFDG在实验研究中展示了优越的性能,且超参数更少,意味着更快更简单的实现。

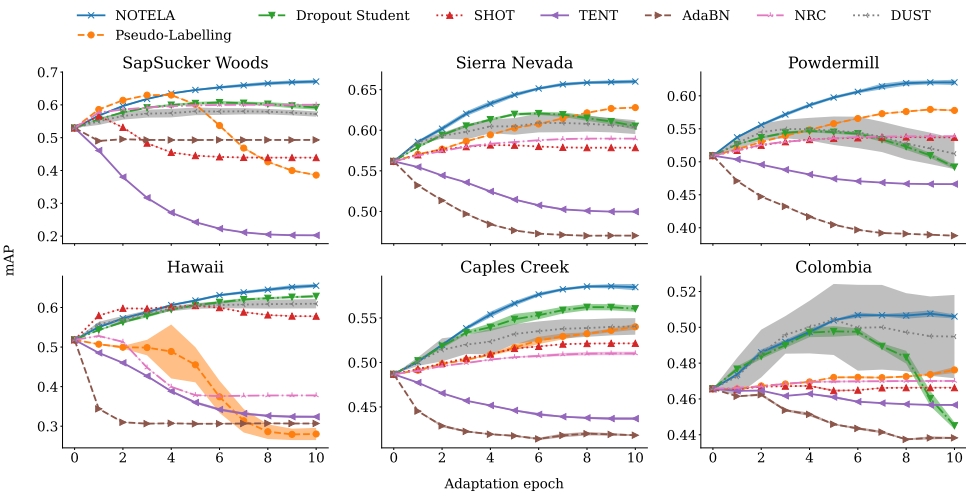

8.In Search for a Generalizable Method for Source Free Domain Adaptation

作者探讨了源自由域自适应(SFDA)在生物声学领域中的应用。

SFDA使用仅未标注数据适配预先存在模型到新域,非常吸引人。作者将现有SFDA技术应用于生物声学中具有挑战性的自然分布转移,这与计算机视觉中常见的转移很不同。作者发现现有方法相对于彼此的表现不同于视觉基准中观察到的,有时甚至表现比不进行域自适应还差。

作者提出了一个新的简单方法,在新分布转移上优于现有方法,同时在一系列视觉数据集上展现强大的性能。研究结果表明,现有SFDA方法的泛化能力可能没有人们预期的那么强,考虑不同模态可以成为设计更健壮模型的有用途径。

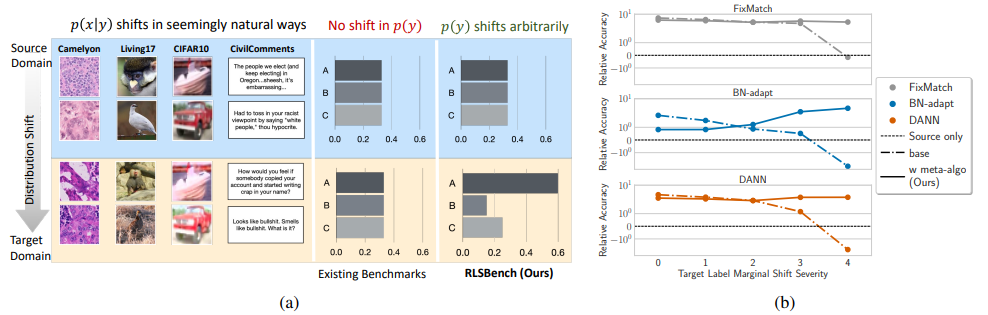

9.RLSbench: Domain Adaptation Under Relaxed Label Shift

这篇论文介绍了一个大规模基准RLSbench用于研究relaxed label shift(变化的标签比例)。

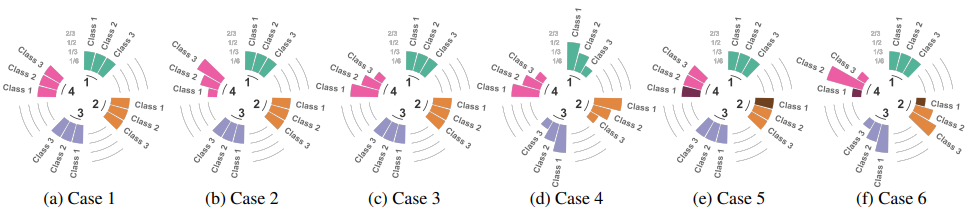

作者研究了当前域自适应方法在标签分布变化下的效果,发现许多方法在标签比例变化时表现较差,于是构建了包含超过500个分布变换对的RLSbench基准,跨视觉、表格和语言模式,标签比例变化不同。基准集不仅关注p(x|y)的变化,也关注标签边缘分布的变化。

作者提出一个通用的两步元算法改进现有域自适应启发式方法:i) 每个epoch pseudo-balance数据 ii) 用目标标签分布估计调整最终分类器。该元算法大幅提高了存在大标签比例变化情况下的域自适应性能,同时对标签比例不变情况影响很小。

RLSbench填补了relaxed label shift评估的空白,鼓励未来研究在该设置下评估方法。

关注下方《学姐带你玩AI》🚀🚀🚀

回复“域自适应”免费领取论文原文+代码合集

码字不易,欢迎大家点赞评论收藏!

文章汇总了9篇在ICML会议上关于域自适应和域泛化的论文,涉及无源域适应、反事实风险最小化、环境无关不变性学习、分类法结构的域自适应、对比学习的泛化分析等领域。这些研究旨在提高模型的泛化能力和鲁棒性,应对现实世界中的分布变化和未知目标域挑战。

文章汇总了9篇在ICML会议上关于域自适应和域泛化的论文,涉及无源域适应、反事实风险最小化、环境无关不变性学习、分类法结构的域自适应、对比学习的泛化分析等领域。这些研究旨在提高模型的泛化能力和鲁棒性,应对现实世界中的分布变化和未知目标域挑战。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?