这里只针对情感分析这一个下游任务进行分析:

BART、ELMO 都是生成模型,只能与一定数目固定的标签做细粒度情感分析

BART 是通过 NSP 预训练任务,将标签作为下句,判断上句和下句是否存在关系,进而判断这个标签是否属于这句话,缺点是假如有60个标签,那就需要判断60次,运行速度堪忧。

ELMO 则是通过 MLM 预训练任务,给句子结尾进行 Mask

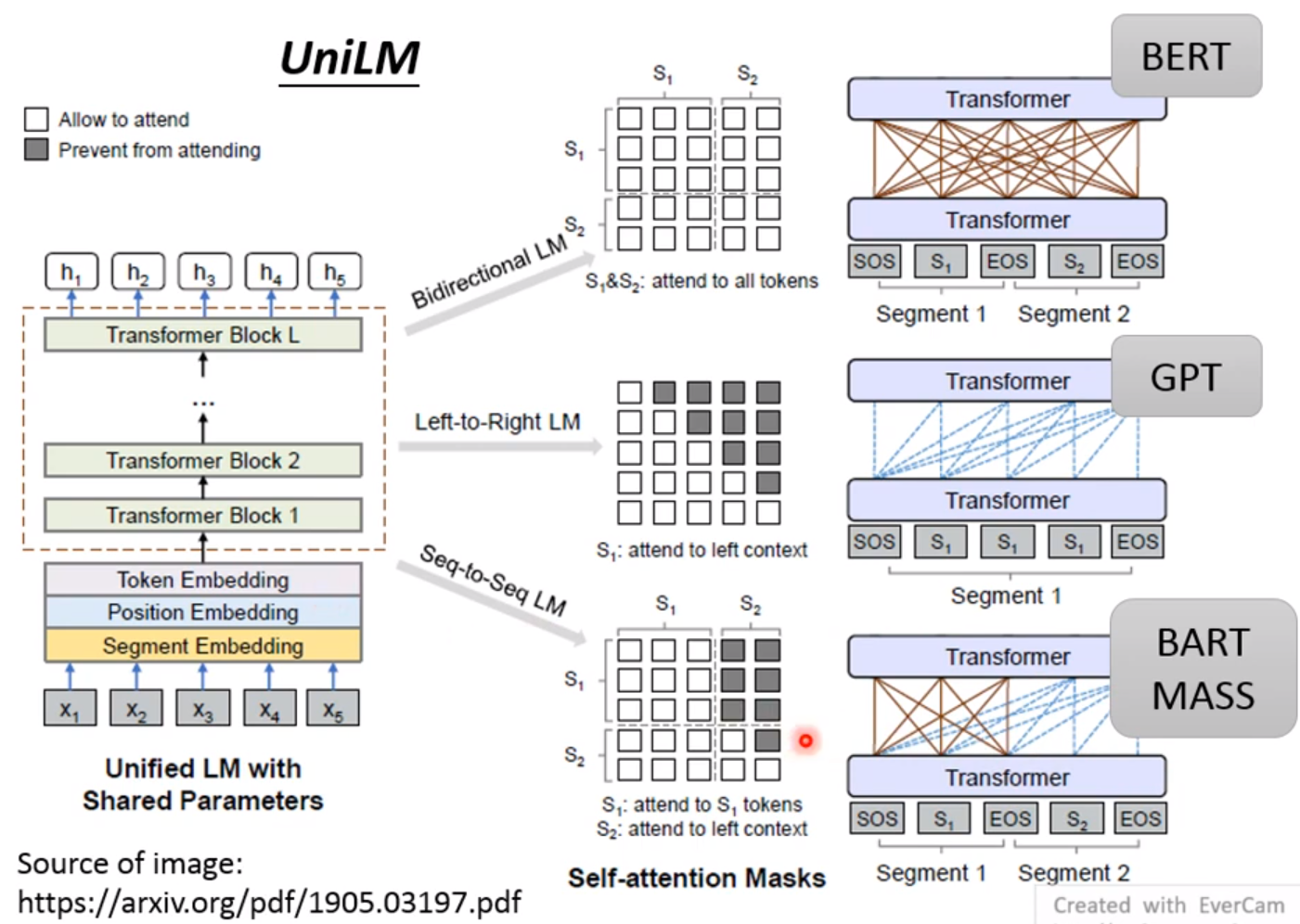

或者看下李宏毅老师这个图

BERT 的transformer之间全连接,看上下文,没法用做生成式任务,因为在前面就看到后面的了

BART 是看前面预测后面

GPT 是前一个词生后一个词

360

360

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?