大家好,我是微学AI,今天给大家介绍一下人工智能基础部分15-自然语言处理中的数据处理上采样、下采样、负采样是什么?在自然语言处理中,上采样、下采样、负采样都是用于处理数据不平衡问题的技术,目的是为了优化模型的训练效果和训练速度。

一、负采样(Negative Sampling)

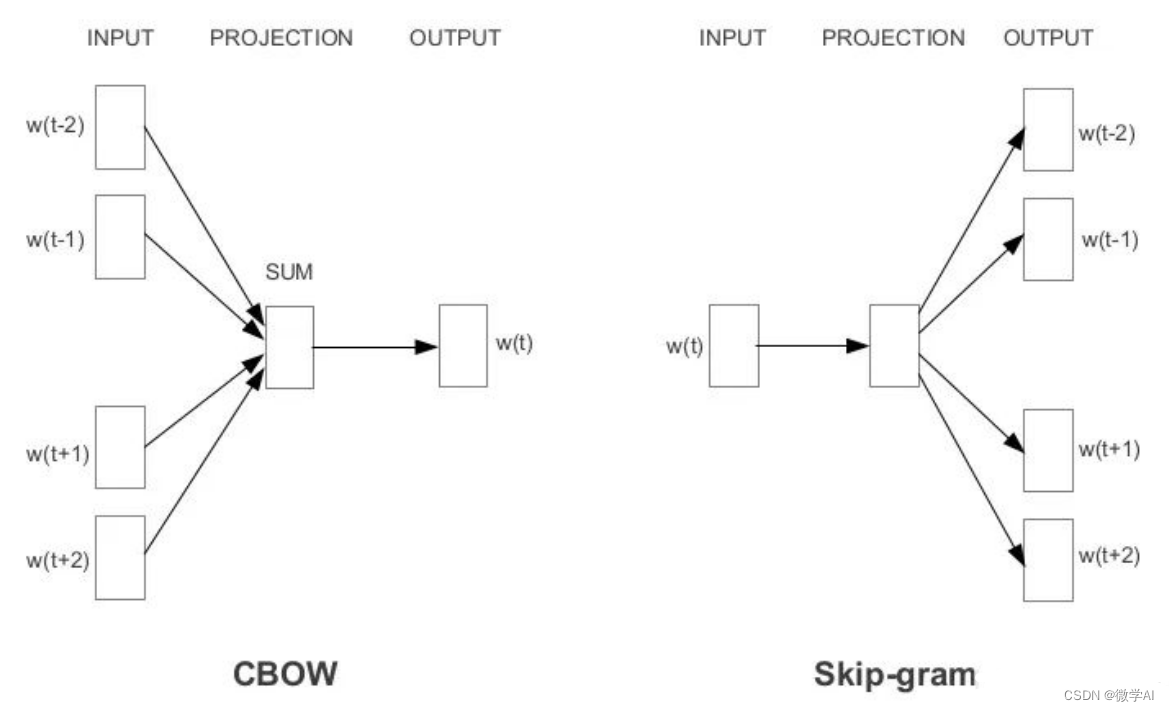

负采样是一种针对skip-gram、CBOW向量模型的优化技术,用于提高训练速度和效果。skip-gram是已知一个词去预测上下文。

Skip-Gram模型:以一个词作为输入,尝试预测上下文的词。

CBOW模型:以一组词(上下文词)作为输入,预测其中一个中心词的出现概率。

在Word2Vec模型中,负采样可以有效地解决softmax计算时的速度问题。负采样的基本思想是对于每个正样本,随机从词典中选择若干个负面样本,使得它们的概率尽可能地小。这样可以加速模型训练过程,同时还可以避免训练过程中出现梯度爆炸和消失的问题。

具体来说,对于每个正样本(即一个单词及其上下文环境),我们从整个词汇表中随机抽取若干个负样本,并将它们作为上下文预测词的负例。这样,我们只需要计算少量的正负样本的概率,就可以更新模型参数。这样既可以减少计算时间,同时也能够使得模型更加关注那些重要的词汇。

二、上采样(Upsampling)

在自然语言处理中&#x

订阅专栏 解锁全文

订阅专栏 解锁全文

4876

4876

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?