基于CycleGAN的山水风格画迁移

1、简介

1.1 研究背景及意义

绘画是人类重要的一种艺术形式,其中中国的山水画源远流长,具有丰富的美学内涵,沉淀着中国人的情思。游山玩水的大陆文化意识,以山为德、水为性的内在修为意识,咫尺天涯的视错觉意识,一直成为山水画演绎的中轴主线。从山水画中,我们可以集中体味中国画的意境、格调、气韵和色调。

随着互联网行业的发展,社交媒体逐渐兴起,人们经常在抖音、快手、微博等软件发布短视频或图片。发布图片前,人们一般要对视频或图片进行一些美化,最常见的就是添加一些滤镜。随着计算机视觉和硬件技术的发展使得基于机器生成具有较高逼真度的滤镜效果成为了可能。基于深度学习的对抗生成网络(GAN)技术及其扩展,可以让用户自己拍摄的图片带有艺术作品的风格,达到风格迁移的效果。

利用GANs技术设计生成的自主学习模型机,可以在大量的同类别的数据集中寻找到人眼难以发现的规律,并加以学习,生成以分析得到的规律为基础的新图像。对抗生成网络(GAN)由判别器和生成器组成。首先,生成器生成噪声图片,让判别器使用风格图片和噪声进行训练。判别器在训练后具备鉴别图片是否为该风格的功能。然后用训练完成的判别器来对生成器进行图片,直到生成器能够生成所需风格的图片且让判别器无法判别(判别结果分布为1:1)为止。利用生成器和鉴别器进行互相对抗学习,逐步完善。该技术在数据集充裕的情况下,可以对数据进行预测,对人眼难以发现的特征进行提取,对大数据进行整合等功能,有着很大的应用前景。

由GAN扩展而成的CycleGAN模型,特点为有两对判别器和生成器,以及进行内容到图片、图片到内容的双向训练。与过去的GAN模型如pix2pix对比,CycleGAN的优势在于不需要训练数据是成对的形式,从而能够有更广泛的应用。然而,中国画具有独特的绘画风格,通过大量训练集对模型进行训练才能够使得模型学习到相应的绘画风格,从而能够对任意一张环境图像实现中国山水画风格的迁移。除了社交媒体,风格迁移在其他领域也有广阔的应用前景和强烈的需求。导航软件可以用风格迁移的方式将卫星照片转换成地图的形式;在刑侦领域,可以用风格迁移的方式将嫌疑犯的手绘画像转移成有参考价值的照片。除此之外,还有生成字体,高分辨率重建等应用方向。

项目主要研究任务为基于CycleGAN将既有内容图片转换为中国山水画风格,通过CycleGAN强大的特征提取能力,得到不同图像间的特征信息,从而能够学习到中国山水画风格。通过大量的训练数据对CycleGAN网络进行不断的训练,提高CycleGAN画风迁移的准确率。此外,我们还对原始CycleGAN进一步进行了改进,将CycleGAN与自注意力机制相结合,从而提高生成图像的逼真度。

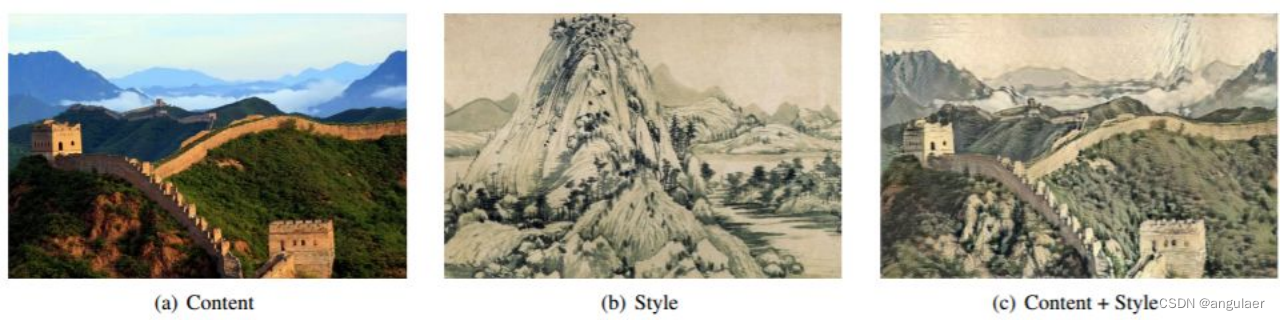

图1-1 山水画风格迁移实例

Figure 1-1 An example of image style transfer

3、CycleGAN算法原理及其改进措施

3.1 图像风格迁移数据集

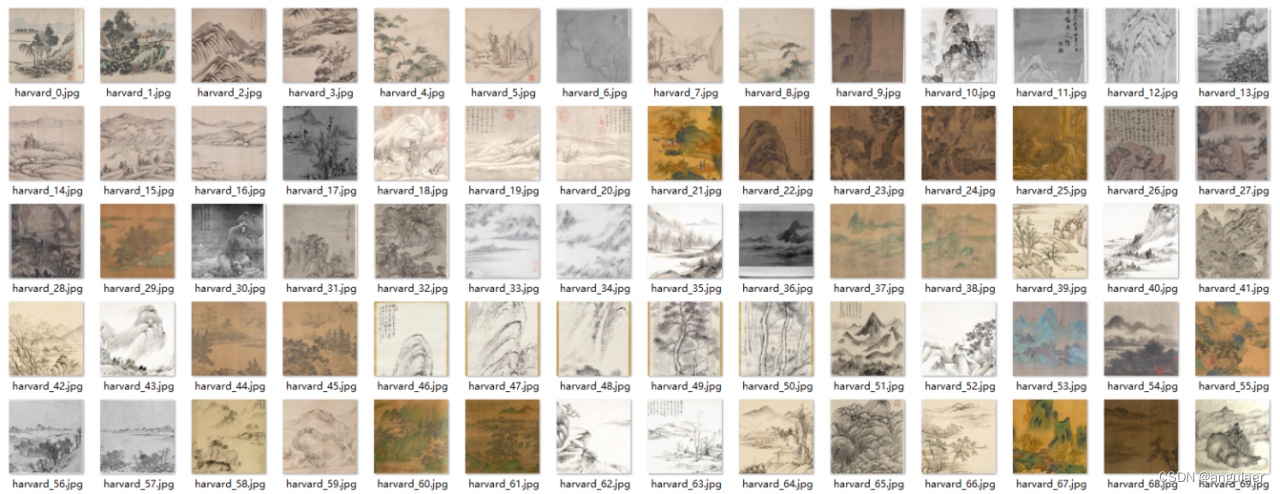

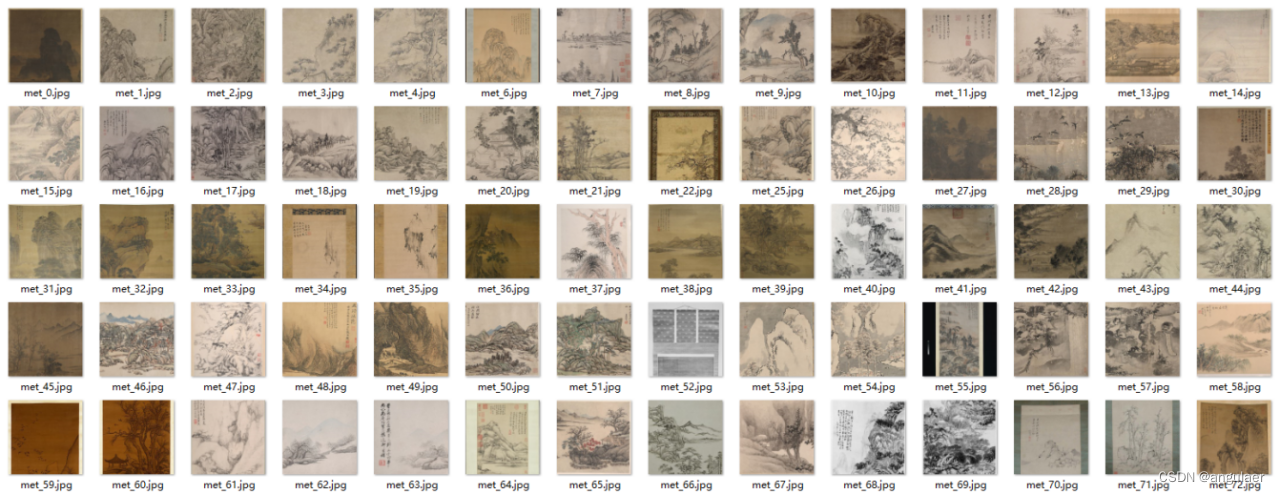

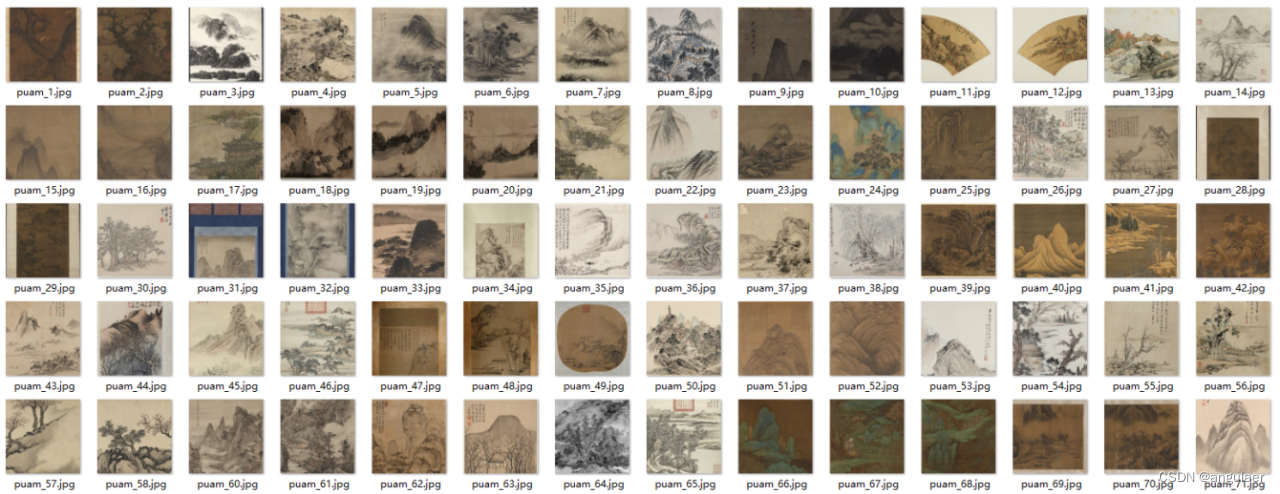

数据集的质量和数量会影响模型的泛化性和生成图像的质量,为了能够实现不同画家风格的迁移工作,通过爬虫和寻找公开数据集的方式进行数据收集。在我们的任务中,我们将要实现中国山水风格画的迁移工作,因此,我们主要搜寻具有中国山水画风格的图像形成模型训练所需的数据集。数据集从四个不同的美术馆和画廊收集得到。中国风格数据集共2192张,其中362张图片收集自普林斯顿大学美术馆,101张图片收集自哈佛大学美术馆,428张图片收集自大都会艺术博物馆,1301张图片收集自史密森尼弗里尔艺术画廊。不同美术馆和画廊收集到的部分图像示例分别如图3-1(a)到3-1(d)所示。

(a) 哈佛大学美术馆收集图像示例

(b) 普林斯顿大学美术馆收集图像示例

© 大都会艺术博物馆收集图像示例

(d) 史密森尼弗里尔艺术画廊收集图像示例

图3-1 中国画风数据集

Figure 3-1 Example of Chinese style images

3.2 CycleGAN算法原理

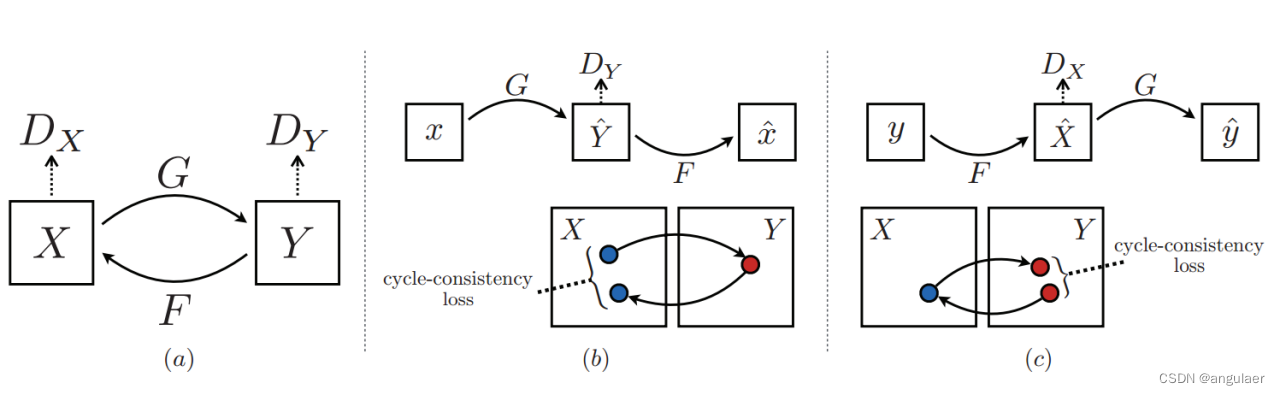

为了能够生成新的图像,需要将源域中的图像通过变换转移到目标域。通过跨域转换能够将已有图像生成接近真实的图像。不同于其他图像风格转换算法,CycleGAN是传统GAN的特殊变体,与GAN相比,CycleGAN也可以创建新的数据样本,并且CycleGAN不需要成对的数据对模型进行训练。为了确保学习到的映射不将输入的不同对象x1、x2映射为同一个生成结果y,CycleGAN引入了Cycle概念,即将y映射回A,产生x1,并判断x1是否同x1近似,用这样的方式来确保模型真正能学习到一对一的映射而不是一对多。CycleGAN包括前向循环和反向训练两部分,如图3-2所示。其中前向循环用来训练生成器,通过仅利用源域中的图像x和目标域中的图像y来进行无监督的学习。不同于其他图像生成算法,CycleGAN对图像生成过程施加了循环一致性约束,循环一致性约束可以确保从伪造的目标数据集中重建出真实的源数据。在CycleGAN模型中,使用平均绝对误差损失作为循环一致性约束,可以减少图像的重建模糊。CycleGAN为对称性结构,具有与前向循环相同的反向循环,但是目标数据和源数据相反,同样生成器和判别器的作用也相反,对于反向循环,判别器作为生成器,而生成器用于恢复输入数据。通过对抗性训练使得生成器可以学习到如何欺骗判别器。CycleGAN的最终目的是让生成器学习到如何能够生成逼真的伪造数据用来欺骗判别器。具体来说,在模型中定义两个变换G、F,分别表示从输入域X到目标域Y的变换和逆变换,并且使用Dx和Dy来分辨判断F和G的效果,在使用Dx和Dy的同时,引入两个Cycle过程,第一个cycle过程(图3-2中b),是指使用真实的x产生一个估计的y,再使用这个估计的y进行逆变换产生一个估计的x,此时评价真实的x和这个估计的x的差别,同样的Y到X的过程也引入这样的Cycle过程(图3-2中c)。

图3-2 CycleGAN模型原理

Figure 3-2 CycleGAN model algorithm

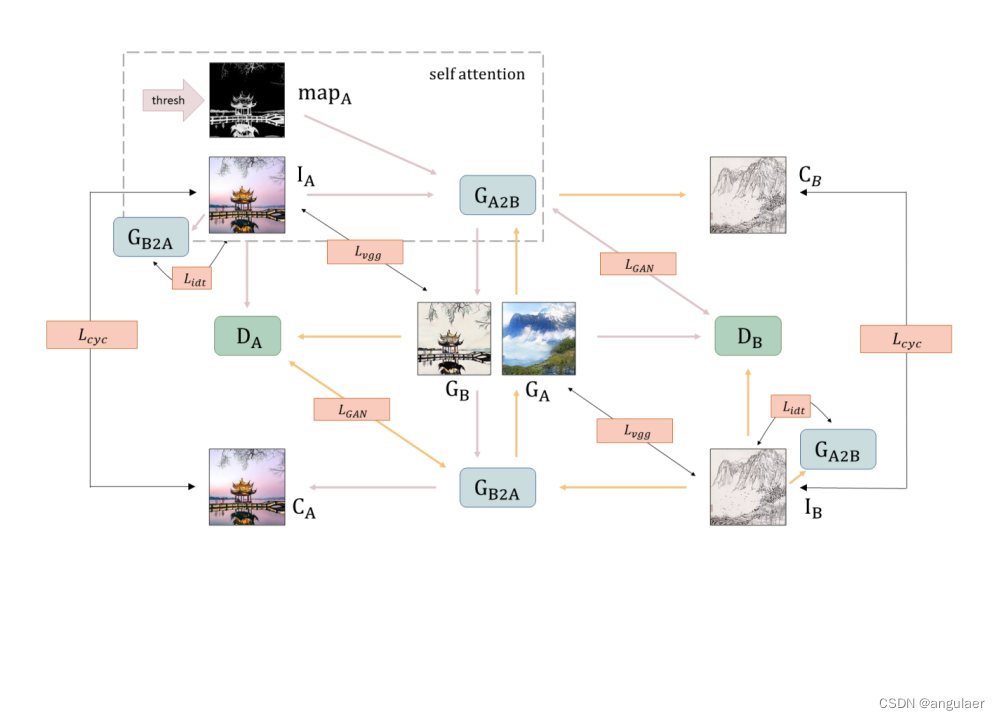

3.3 基于CycleGAN模型的改进算法

针对原始CycleGAN模型对产生较大几何形变情况下生成效果差的问题,通过增加VGG损失和自注意力机制使得在产生较大几何形变情况下也能够生成质量较好的图像。具体操作为增加VGG损失的目的是对特征层生成的特征进行约束,增加自注意力机制的目的是将图像的亮度信息纳入到模型的生成结果中,改进模型框架如图3-3所示。

图3-3 改进CycleGAN模型结构

Figure 3-1 Improved CycleGAN model structure

接下来,将分别对增加VGG损失项和引入自注意力机制的目的进行说明。对于增加VGG损失项,模型使用VGG16网络分别对输入图像和生成图像进行特征提取,通过计算输入图像和生成图像之间的损失来减少输入图像和生成图像之间特征层的变化,保证图像内容的不变,进行保留输入图像的语义信息。

对于增加注意力机制,由于在对原始CycleGAN模型进行测试过程中发现,在不同画家的图像中,由于天空部分颜色相比于图像中的其他部分更亮,并且颜色分布较为分散,因此会产生不同程度的伪影。为了消除生成图像中的伪影,在图像输入生成器之前首先对图像不同部分的光照强度进行评估。由于画家在绘画过程中会将在图像中设置不同的关注区域,具有主次之分,特别是对于轮廓等部分将会 投入更多的笔墨,因此可以通过在轮廓区域增加注意力机制,从而可以生成更加逼真的效果,而对于天空等平面部位,也可以消除生成图像带来的伪影。

4、基于改进CycleGAN的图像风格迁移及软件设计

4.1 实验数据集及实验环境

4.1.1 环境配置

本文利用Anaconda集成平台,基于Python语言进行程序的开发,Python语言是开源语言,生态完善,对于多数深度学习框架都提供了调用接口,用户可以在任何计算机上免费安装和使用相关数据库。此外,Python语言易于学习,语法简单,代码维护简单,拥有丰富的扩展库,可以轻易的完成各种高级任务。

首先需要在Anaconda官网下载Anaconda软件进行安装,并进行环境变量的配置。安装结果如图4-1所示。软件安装完毕后,新建虚拟环境,并进行python 3.8和相关依赖库的安装,相关依赖库包括Pytorch、opencv-python等。

图4-1 软件安装结果

Figure 4-1 Anaconda install

本文开发的实验环境为Windows系统,GPU型号为Nvidia 2080,为了能够充分的对模型进行训练,对于每个图像迁移模型均训练80000个epoch。

4.1.2 实验数据集

利用第三章所示收集的中国山水风格数据集对模型进行训练。将所有数据均分为训练集和验证集,其中训练集和验证集均包括A和B两部分,数据集组织形式如图4-2所示。

图4-2 数据集组织形式

Figure 4-2 The structure of dataset

4.2 界面设计实现及测试

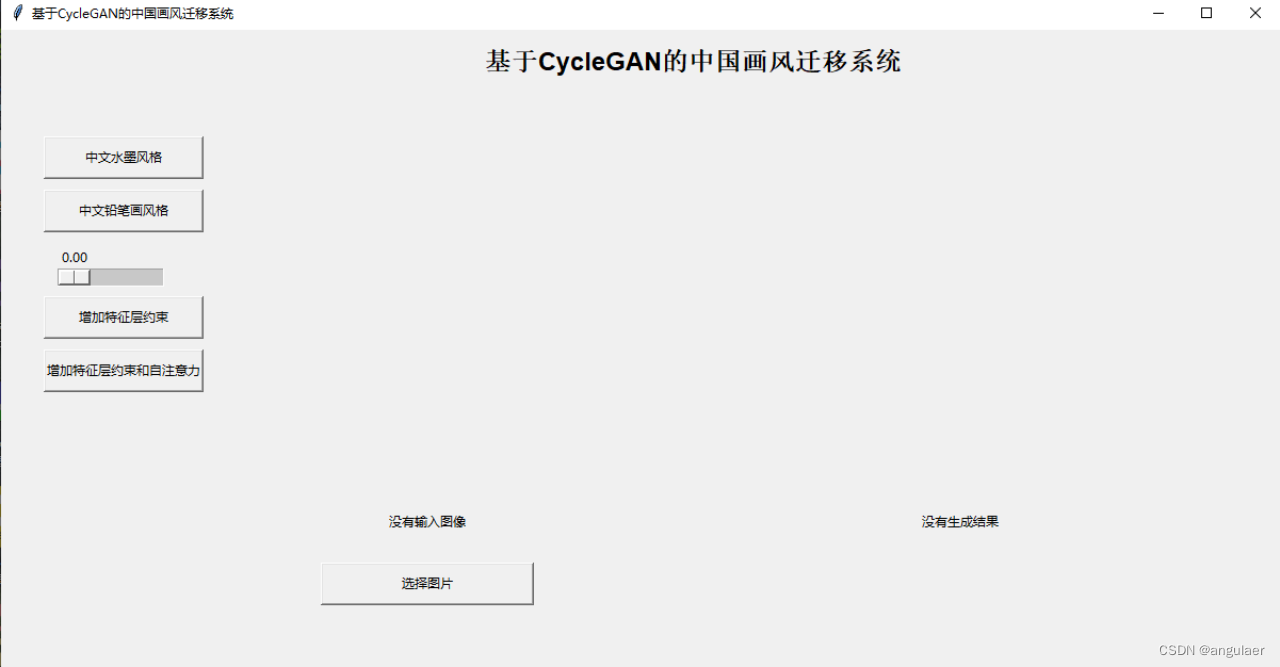

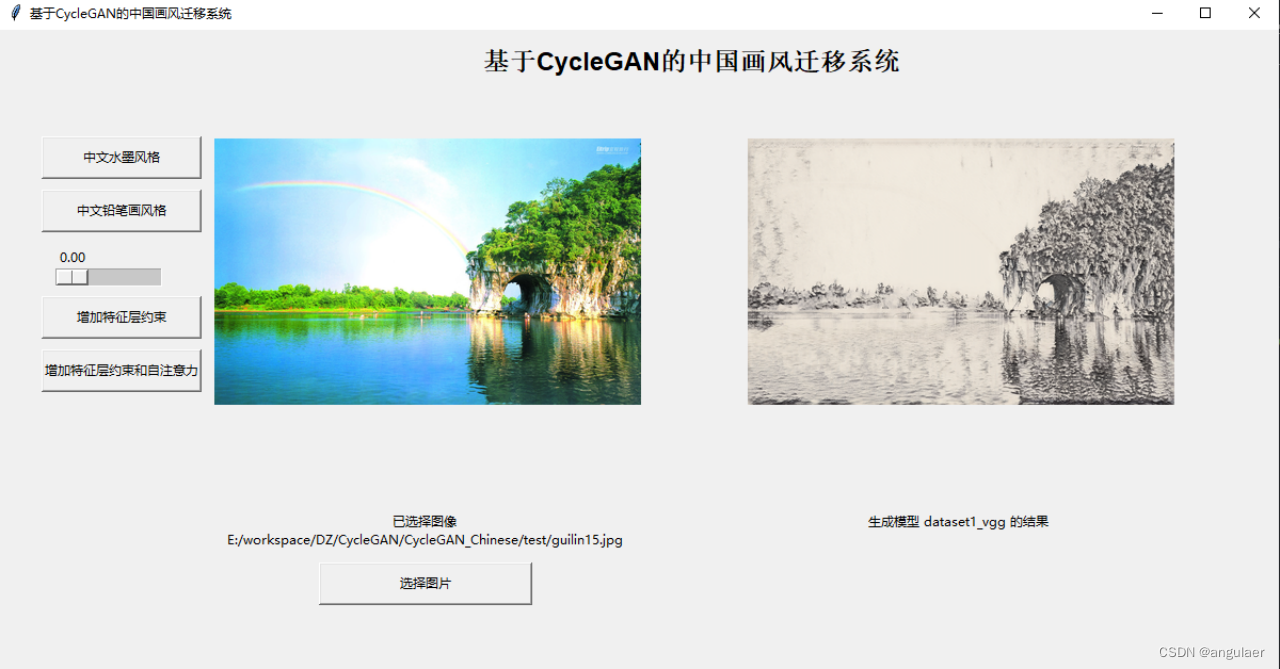

模型训练完成后,为了增加交互性能,我们设计了如图4-3所示的交互界面,交互界面包括图像选择,图像风格转换结果展示,以及待转换的不同图像风格,不同图像风格包括中文水墨风格、中文铅笔画风格。除了可以进行风格的选择以外,还分别增加了改进模型情况下图像的显示方式,包括单独增加特征层约束和同时增加特征层约束和自注意力两种方式。最后,我们还可以通过手动的方式调节亮度的约束,当阈值减小时,此时模型将降低图像较亮区域的注意力。

图4-3 基于CycleGAN的中国画风迁移交互系统

Figure 4-3 Main GUI of image transfer based on CycleGAN

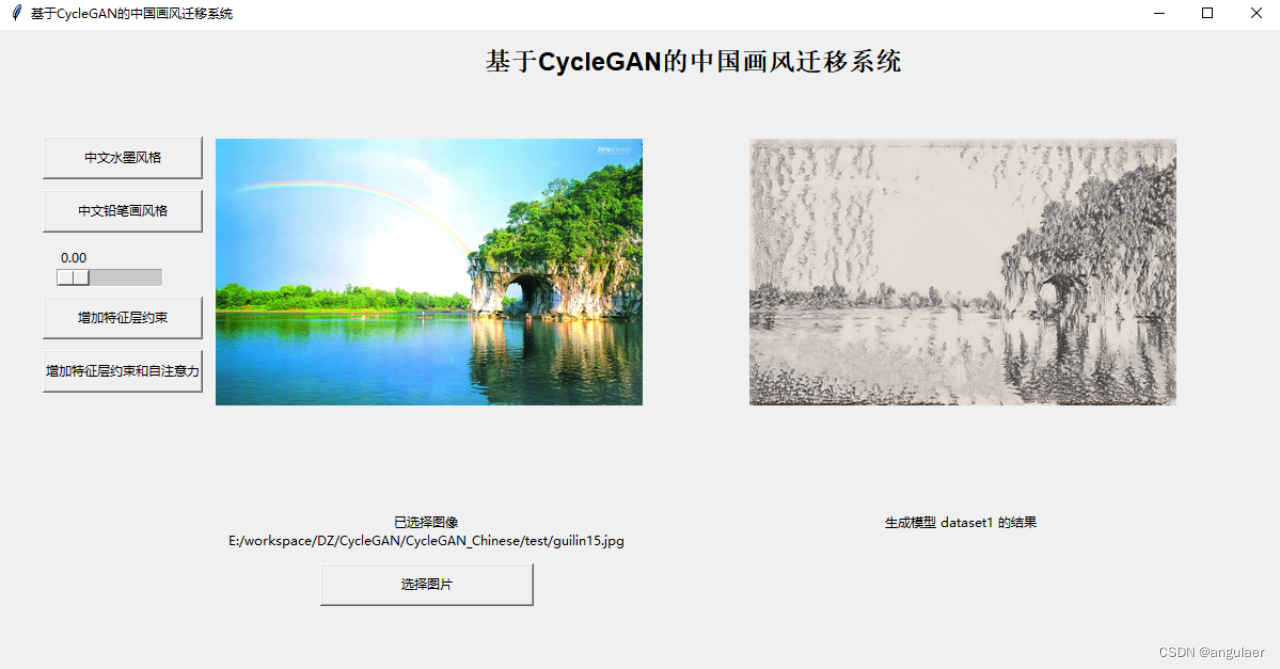

选择图像进行图像风格迁移,图像选择界面如图4-4所示。

图4-4 基于CycleGAN的图像风格迁移系统选择界面

Figure 4-4 Main GUI of image transfer based on CycleGAN

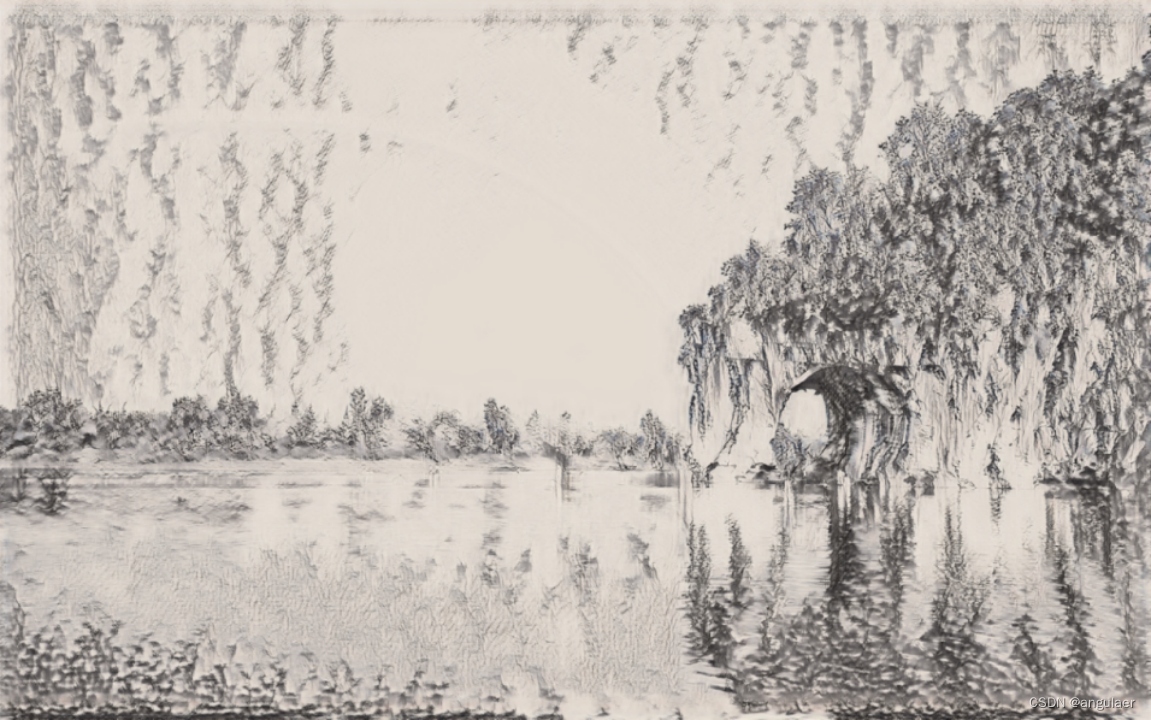

基于选择后的图像进行图像风格迁移的原始图像和可视化结果分别如图4-5和图4-6所示。

图4-5 原始风格图像

Figure 4-5 Original Image

图4-6 图像风格迁移结果

Figure 4-6 Image transfer results

系统可同时显示待进行图像风格迁移的图像和图像风格迁移后的结果图像,此外,界面中还可以显示选择图像的路径以及通过调节阈值控制注意力机制对图像亮度的关注情况,实时进行调整。

4.3 图像风格迁移结果验证

接下来我们将展示不同图像进行图像风格迁移后的结果,图像风格迁移结果如图4-7(a)-4-7©所示。

(a) 水墨画风格结果

(b) 增加特征层约束结果

© 增加特征层约束和自注意力结果结果

图4-7 不同风格生成结果

Figure 4-7 Different transfer images result

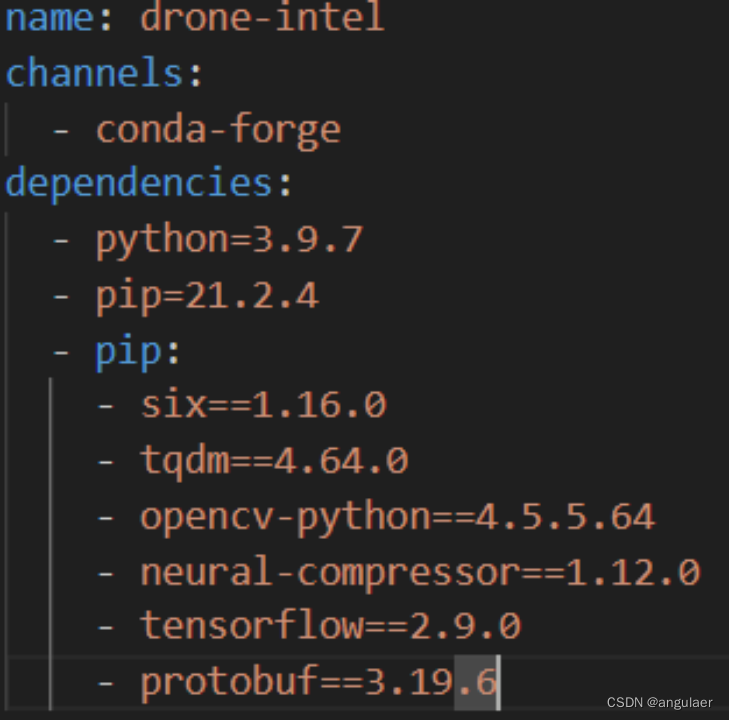

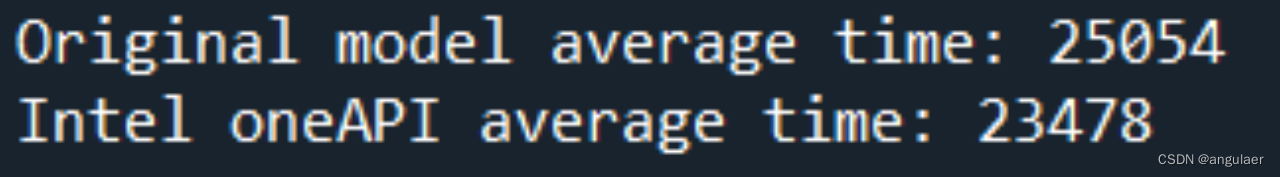

最后,采用Intel oneAPI AI组件实现端到端的模型优化,使用的工具为英特尔神经压缩器1.12,采用如下图所示的环境配置。

对模型优化后的模型平均训练时间进行分析可以发现,经过优化后的模型平均训练时间更短。

文章探讨了如何利用CycleGAN技术将普通图片转换为中国山水画风格,介绍了数据集的收集与处理,CycleGAN的原理与改进措施,以及基于此技术的图像风格迁移软件设计。通过增强VGG损失和自注意力机制,提高了图像生成的逼真度和适应性。

文章探讨了如何利用CycleGAN技术将普通图片转换为中国山水画风格,介绍了数据集的收集与处理,CycleGAN的原理与改进措施,以及基于此技术的图像风格迁移软件设计。通过增强VGG损失和自注意力机制,提高了图像生成的逼真度和适应性。

1221

1221

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?