文章目录

- 2021

- A Study on Paddy Field Segmentation and Rice Seedling Detection from UAV Images

- Cotton Stand Counting from Unmanned Aerial System Imagery Using MobileNet and CenterNet Deep Learning Models

- A UAV Open Dataset of Rice Paddies for Deep Learning Practice

- Automatic UAV-based counting of seedlings in sugar-beet field and extension to maize and strawberry(Computers and Electronics in Agriculture)

- 2022

- Detection and Counting of Maize Leaves Based on Two-Stage Deep Learning with UAV-Based RGB Image(Remote sensing)

- Quick and accurate monitoring peanut seedlings emergence rate through UAV video and deep learning(Computers and Electronics in Agriculture)

- Field rice panicle detection and counting based on deep learning(Frontiers in Plant Science,IF=6.6)

- A fast and robust method for plant count in sunfower and maize at diferent seedling stages using high‑resolution UAV RGB imagery

- TasselNetV3: Explainable Plant Counting With Guided Upsampling and Background Suppression

- 2023

- Self-Supervised Plant Phenotyping by Combining Domain Adaptation with 3D Plant Model Simulations: Application to Wheat Leaf Counting at Seedling Stage

- A Tea Buds Counting Method Based on YOLOv5 and Kalman Filter Tracking Algorithm

- Quantitative Evaluation of Maize Emergence Using UAV Imagery and Deep Learning(Remote sensing)

2021

A Study on Paddy Field Segmentation and Rice Seedling Detection from UAV Images

code: https://github.com/hsinyy02/Paddy-Field-Segmentation

摘要:近年来,由于人口老龄化,台湾农业面临严重的劳动力短缺。为了减少农业生产作业的数量,从而减少对劳动力的需求,利用物联网、传感元件、大数据分析等技术的智慧农业在台湾得到了大力推广。其中,航空相机结合图像数据分析为农民提供了更便捷的作物生长监测方式,农业应用需求日益增加。

在本研究中,对于早稻幼苗的空映射,提出的方法是在分割图像中检测稻田。此外,该方法还可以根据检测到的秧苗对稻田进行标记,完成相邻图像与多幅图像之间的秧苗对齐。本研究主要分为四个部分进行实验:(1)稻田图像分割,(2)秧苗检测,(3)秧苗标记,(4)秧苗比对。在第一部分中,使用三种图像分割算法将输入图像划分为不同的子区域,然后使用分类数据集将每个子区域划分为稻田或非稻田。最后,结合稻田子区域,得到稻田区域的掩模图像。第二部分利用不同的植被指数对第一部分得到的水田进行预处理图像和斑点检测,检测结果为幼苗。在这一部分中,设计了一个系统的流程,从而可以自动确定各个预处理方法的检测参数。在第三部分中,通过幼苗的坐标确定并标记输入图像到马赛克坐标平面的转换。最后,第四部分提出了一种基于幼苗的图像拼接方法,完成相邻图像之间的幼苗对齐,进而扩展到多幅图像之间的幼苗对齐。

从研究结果来看,第一部分使用的三种图像分割算法的F测量值在最终的水田分割结果中均可达到95%以上,其中Felzenszwalb算法的F测量值为97.04%是最好的。第二部分的幼苗检测结果证明,使用植被指数对检测结果有积极的影响,而使用TGI的平均检测结果最好,可以达到平均F测量值93.84%,平均准确率为96.15%,平均召回率为91.96%。对于第三部分标记苗所在的稻田面积,平均标记准确率可达99.2%。在第四部分相邻图像间的幼苗比对中,采用该方法获得的幼苗对数比原方法平均增加26.17%。

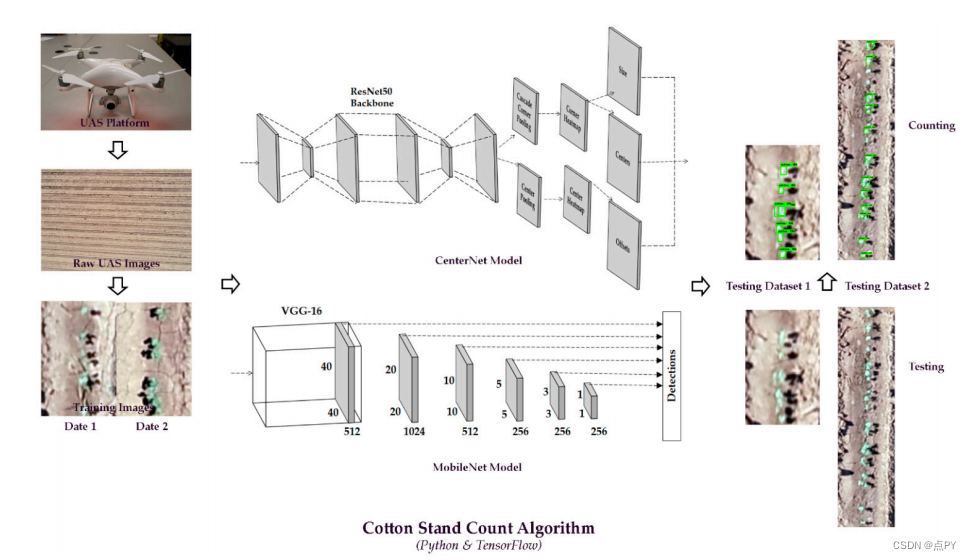

Cotton Stand Counting from Unmanned Aerial System Imagery Using MobileNet and CenterNet Deep Learning Models

摘要: 准确的林分数是确定出苗率、评估幼苗活力、促进现场管理实现最佳作物生产的先决条件。传统的人工林分评估方法对于大规模育种或田间生产来说是劳动密集型和耗时的。本研究旨在应用移动网络和中心网络两种深度学习模型,利用无人机系统(UAS)图像对苗期棉花植株进行检测和计数。这些模型是用两个包含400张和900张随植物大小和土壤背景亮度变化的图像的数据集进行训练的。采用两个不同维度的测试数据集,测试数据集1300乘400像素,测试数据集2250乘1200像素。模型验证结果显示,CenterNet模型的平均平均精度(mAP)和平均召回率(AR)分别为79%和73%,具有900张训练图像的移动eNet模型的平均召回率(AR)分别为86%和72%。测试数据集1对CenterNet和移动net模型的棉花植株检测和计数精度均较高。结果表明,CenterNet模型对900张训练图像的棉花植株检测和计数具有更好的整体性能。结果还表明,对训练数据集的不同维图像应用目标检测模型,需要更多的训练图像。对具有900张训练图像的CenterNet模型的平均绝对百分比误差(MAPE)、决定系数(R2)和均方根误差(RMSE)值分别为0.07%、0.98和0.37。移动网和中心网模型都具有基于苗期高分辨率UAS图像准确、及时地检测和计数棉花植株的潜力。本研究为为农业应用中的目标检测项目选择正确的深度学习工具和适当数量的训练图像提供了有价值的信息。

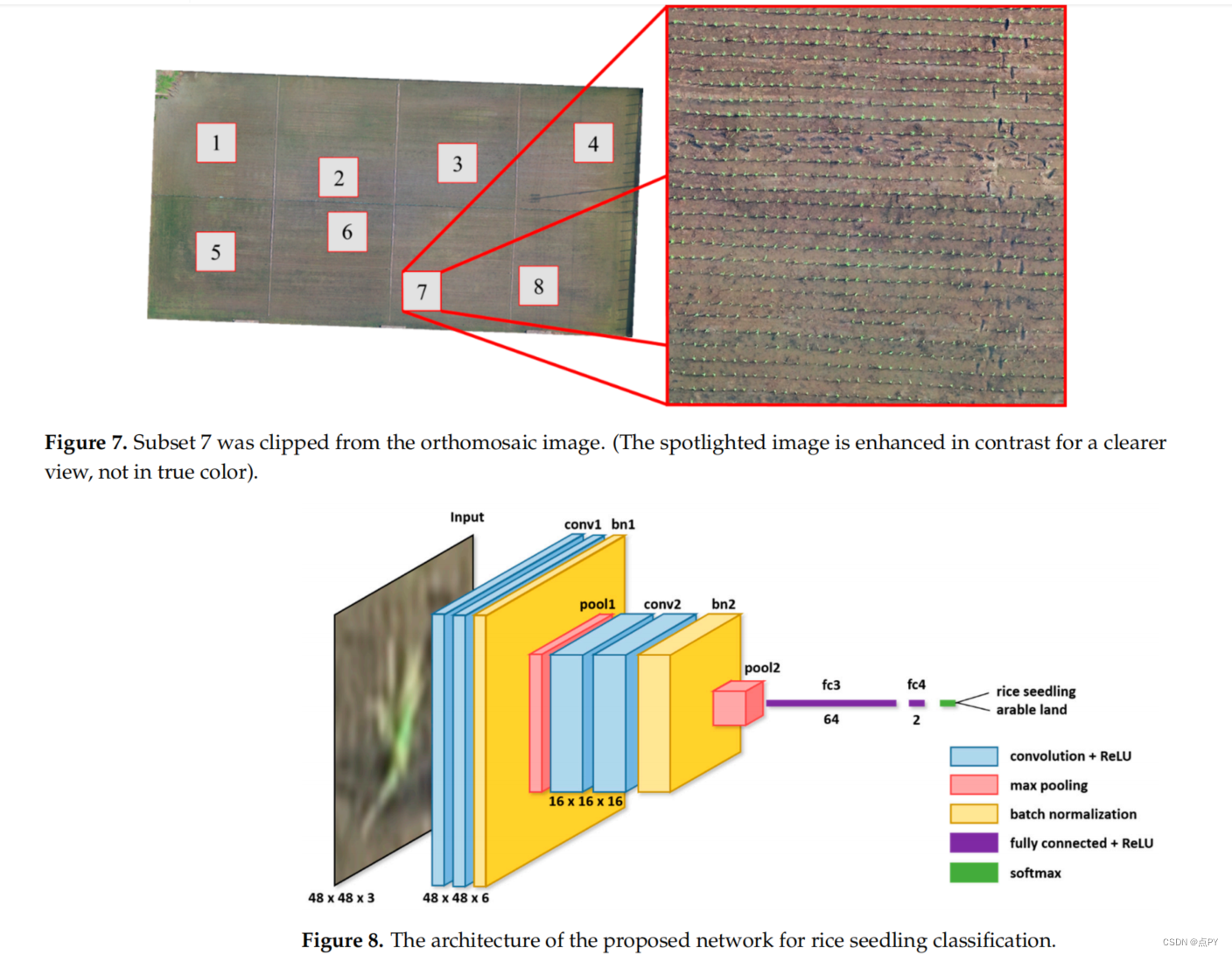

A UAV Open Dataset of Rice Paddies for Deep Learning Practice

code: https://github.com/aipal-nchu/RiceSeedlingDataset#2-dataset-of-rice-seedling-classification

摘要: 近年来,无人机(uav)已被广泛应用于遥感领域。对于大量的无人机图像,深度学习得到重新活力,并在农业应用中取得了许多成果。用于深度学习模型训练的流行图像数据集是为通用用途而生成的,其中的对象、视图和应用程序都是用于普通场景的。然而,无人机图像具有不同的图像模式,大多是从一个视角向下看。本文提供了一个经过验证的无人机图像标注数据集,描述了数据采集、数据预处理和CNN分类的展示。数据集收集包括一个多旋翼无人机平台,通过飞行一个计划中的侦察常规在稻田上。本文介绍了一种基于ExGR指数的半自动标注方法来生成水稻幼苗的训练数据。为了演示,本研究修改了经典的CNN架构VGG-16,以运行基于贴片的水稻幼苗检测。采用k-fold交叉验证,获得训练/测试数据的80/20分比。网络的精度随着epoch的增加而增加,交叉验证数据集的所有划分精度均达到0.99。水稻幼苗数据集提供了训练验证数据集、基于斑块的检测样本和田间的正交镶嵌图像。

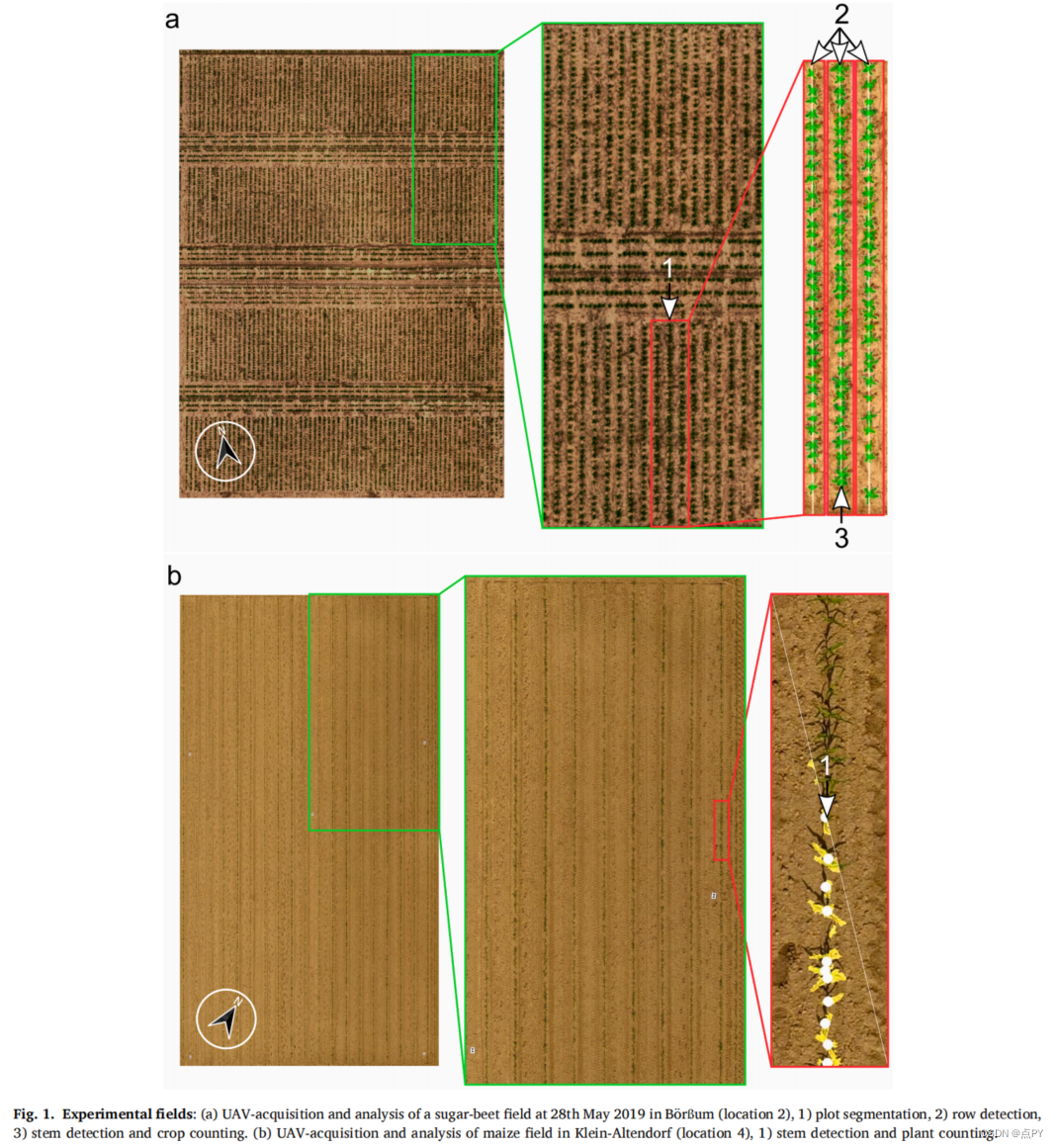

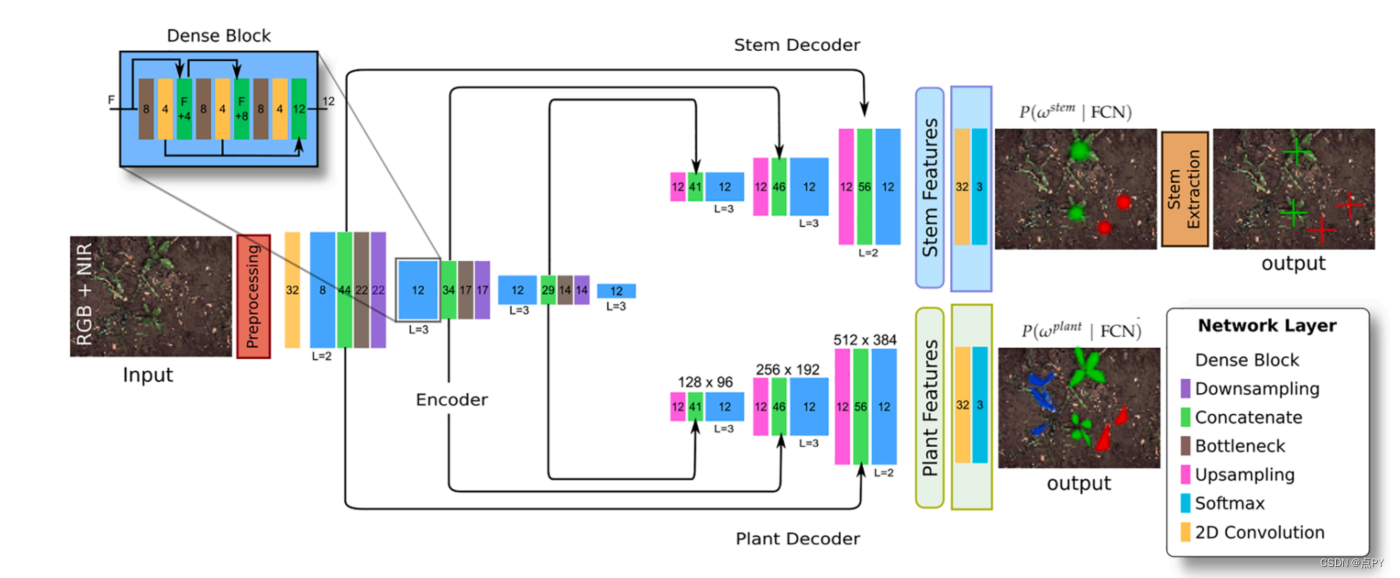

Automatic UAV-based counting of seedlings in sugar-beet field and extension to maize and strawberry(Computers and Electronics in Agriculture)

摘要:作物幼苗计数是一项需要时间的活动,涉及多种农业实践,如植物种植、实验试验、植物育种程序和杂草控制。携带RGB摄像机的无人机(uav)是一种新的现场自动作图工具,利用深度学习方法对无人机图像进行分析,可以提供相关的农艺信息。本研究实现了基于无人机的摄像机系统和深度学习图像分析管道,用于甜菜、玉米和草莓田的全自动植物计数。在不同的生长阶段监测了5个地点,并利用全卷积网络(FCN)管道自动预测每个小区的作物数量。我们基于FCN的方法是一个单一的模型,用于联合确定作物和杂草植物的确切茎部位置,以及考虑作物、杂草和土壤的像素级植物分类。为了确定该方法的性能,我们将预测的作物计数与视觉评估的地面真实数据进行了比较。结果表明,基于无人机的甜菜植株计数的预测误差低于4.6%,影响性能的主要因素与行内距离和生长阶段有关。该管道扩展到其他作物是可能的;在玉米和草莓田的实际田间条件下,预测的误差低于4%。本工作强调了作物自动计数的可行性,这可以减少农民的体力劳动。

2022

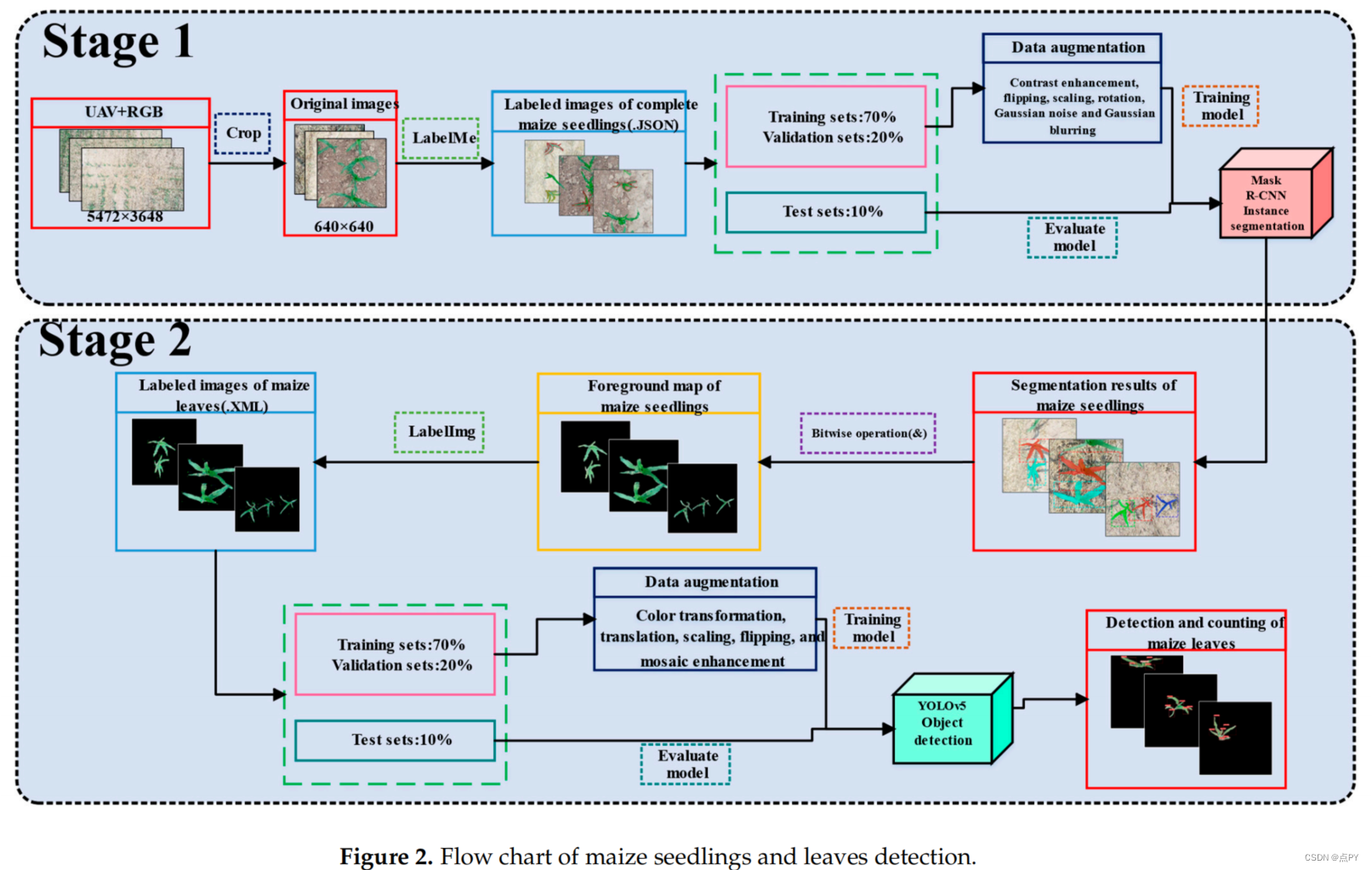

Detection and Counting of Maize Leaves Based on Two-Stage Deep Learning with UAV-Based RGB Image(Remote sensing)

摘要: 叶龄是玉米(玉米)生长过程中的一个重要性状。通过对玉米叶片进行计数来估算玉米的种子活性和产量具有重要意义。由于田间场景的复杂性和相邻幼苗叶片的交叉覆盖,对田间玉米叶片的检测和计数非常困难。本研究提出了一种基于利用无人机(uav)采集的RGB图像进行深度学习的玉米叶片检测和计数方法。利用Mask R-CNN从复杂的背景中分离出完整的玉米幼苗,以减少杂草对叶片计数的影响。为了提高模型的分割性能,我们提出了一种新的损失函数SmoothLR来提高模型的分割性能。然后,利用YOLOv5对玉米幼苗分段后的个体叶片进行检测和计数。将1005张田间幼苗图像随机分为训练、验证和测试集,比例为7:2:1。结果表明,Resnet50和SmoothLR的Mask R-CNN的分割性能优于LI Loss的方法。边界框(Bbox)和掩码(Mask)的平均精度分别为96.9%和95.2%。单幅图像检测和分割的推断时间分别为0.05 s和0.07 s。YOLOv5在叶片检测方面比R-CNN和SSD表现得更好。参数最大的YOLOv5x的检测性能最好。全展开叶片和新出现叶片的检测精度分别为92.0%和68.8%,召回率分别为84.4%和50.0%。平均精度(AP)分别为89.6%和54.0%。新出现叶片和完全未展开叶片的计数准确率分别为75.3%和72.9%。实验结果表明,目前基于无人机图像的大田作物叶片计数研究具有可能。

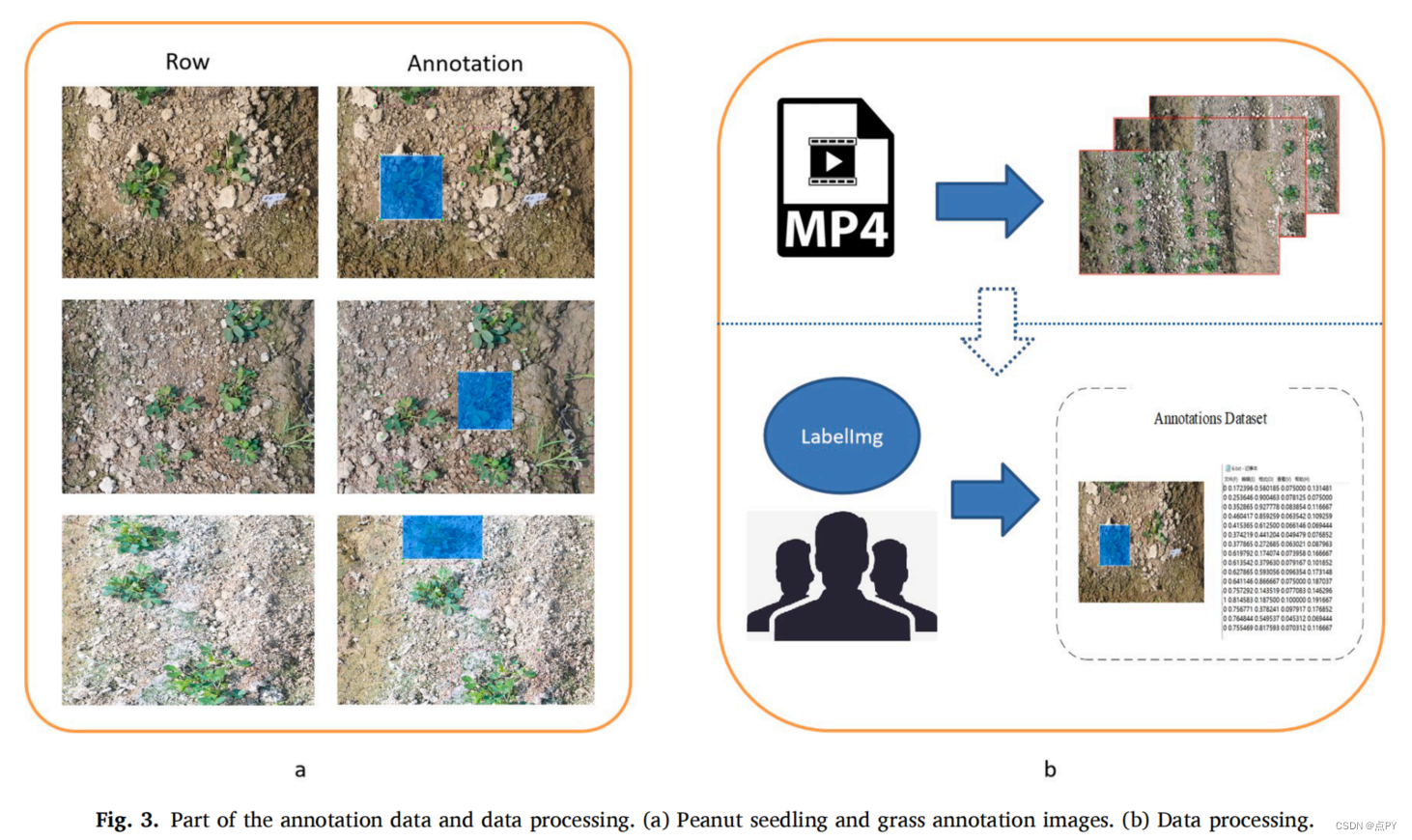

Quick and accurate monitoring peanut seedlings emergence rate through UAV video and deep learning(Computers and Electronics in Agriculture)

摘要: 在苗期,种子萌发的实时监测和检测对种子质量检测、农田管理和产量估算具有重要意义。然而,由于传统的人工苗率监测效率较低,调查方法已逐渐被无人机(uav)和实时花生视频计数模型所取代。在本研究中,我们提出了一种高效、快速的实时花生视频计数模型(结合改进的YOLOV5s、DeepSort和OpenCV程序)来准确区分花生幼苗和杂草,并基于视频对花生幼苗进行计数。改进后的YOLOV5s结合了一个视觉变压器和CSNet,以取代原来的CSNet主干网。现场实验结果表明,实时花生视频计数模型计数能力接近人类,准确率为98.08%;然而,幼苗计算模型只需要进行人类检测所需时间的五分之一。因此,基于视频的模型优于基于图像的目标检测算法,更适合在花生生产的实际发芽率调查中的应用。

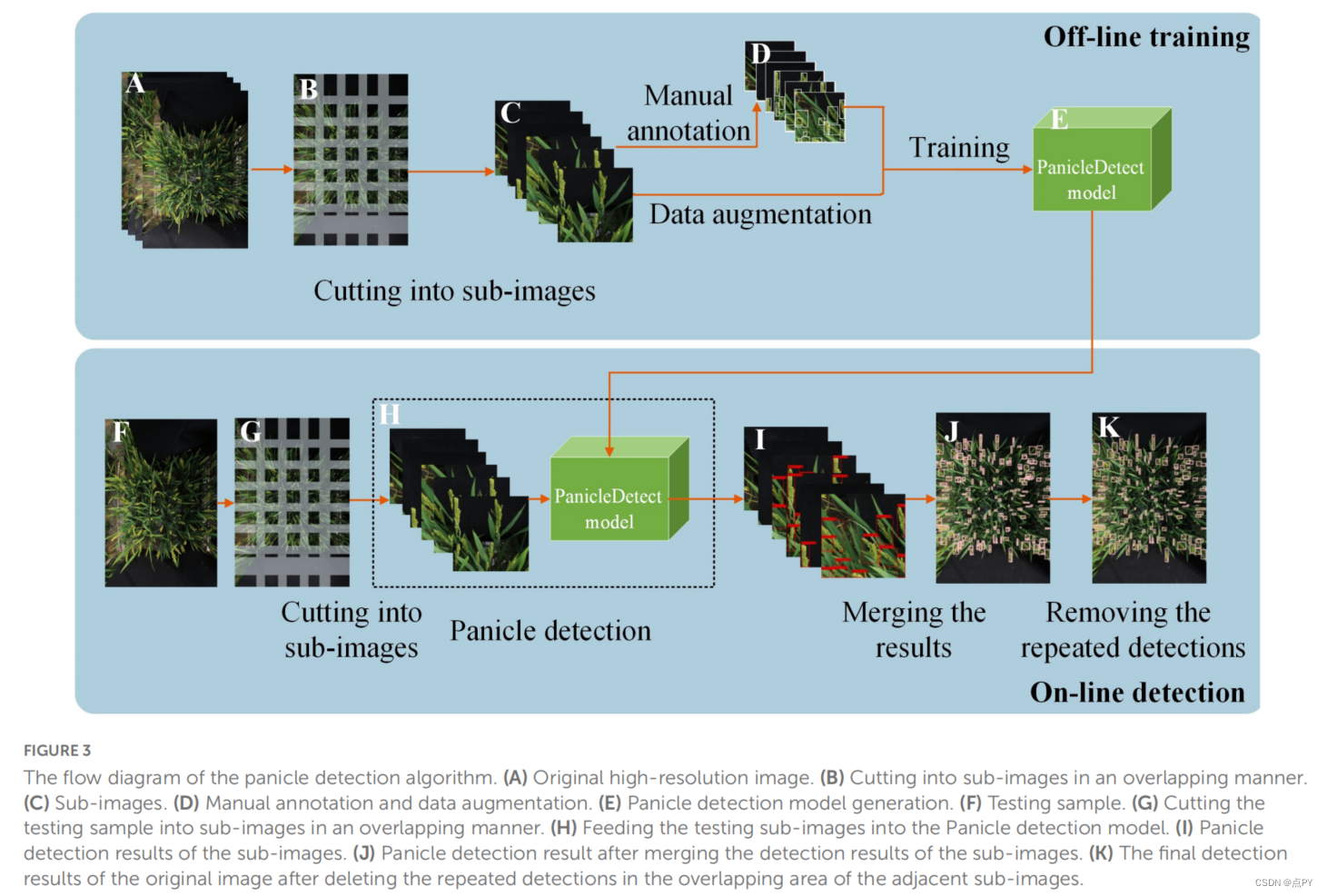

Field rice panicle detection and counting based on deep learning(Frontiers in Plant Science,IF=6.6)

摘要:穗数与水稻产量直接相关,因此穗数检测和计数一直是水稻产量最重要的科研课题之一。由于高密度、高咬合、大小、形状、姿势变化较大等因素,穗数计数是一项具有挑战性的任务。深度学习提供了最先进的目标检测和计数性能。一般来说,大的图像需要调整大小,以适应视频内存。然而,如果原始田间水稻图像的图像大小非常大,就会遗漏小圆穗。本文提出了一种基于深度学习的水稻穗检测计数方法,专门用于大尺寸稻田图像中水稻穗的检测。比较不同的目标探测器,选择YOLOv5,MAPE为3.44%,准确率为92.77%。具体来说,我们提出了一种新的去除重复检测的方法,并证明了该方法优于现有的NMS方法。研究结果表明,该方法对不同光照下、水稻品种和图像输入大小的田间水稻图像的穗数计数具有一定的鲁棒性和准确性。此外,该方法在无人机图像上表现良好。此外,还为水稻研究人员开发了一个开放访问和用户友好的门户网站,以方便地使用所提出的方法。

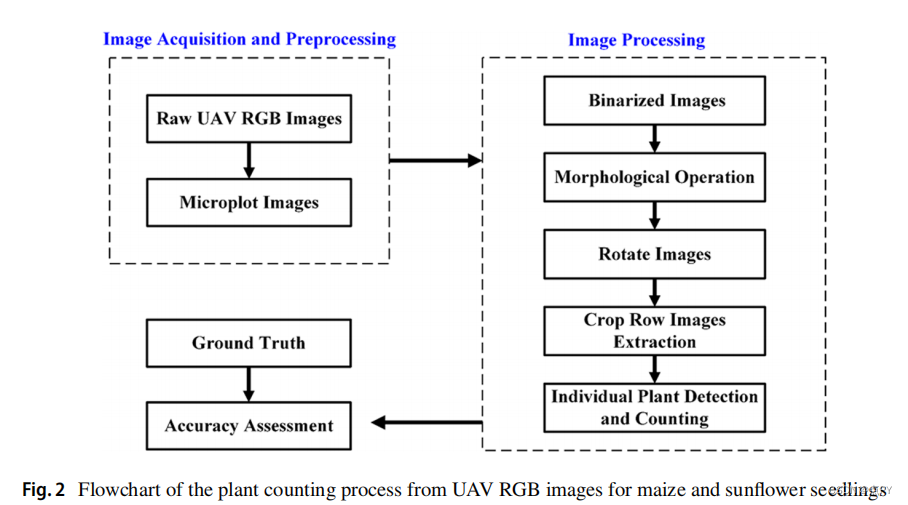

A fast and robust method for plant count in sunfower and maize at diferent seedling stages using high‑resolution UAV RGB imagery

摘要:获取作物植株数量是提高苗期田间决策的关键。使用无人机(uav)进行遥感提供了一种准确和有效的方法来估计工厂数量。然而,目前还缺乏一种快速、稳健的方法来计算等间距和重叠作物中的植物。此外,以往的研究只关注单一作物类型的植物数量。因此,本研究开发了一种利用高分辨率无人机图像快速、无损地计数工厂数量的方法。采用基于计算机视觉的峰值检测算法对作物行和植物幼苗进行定位。为了验证该方法的稳健性,它被用来估计两种不同的作物类型(玉米和阳光作物),在三个不同的区域,在两个不同的生长阶段,以及在不同的分辨率的图像上。选择玉米和向日葵来代表叶片形状和形态特征不同的等距作物。对于玉米数据集(具有不同的区域和生长阶段),该方法的r2为0.76,相对均方根误差(RRMSE)为4.44%。对于日落数据集,该方法得到的r2和RRMSE分别为0.89和4.29%。结果表明,该方法优于流域法(玉米r2为0.48,日照r2为0.82),并能较好地估计苗期高重叠植株的植株数。同时,该方法在两个研究地点的玉米苗期(2-4片叶片)的准确率均高于流域法,r2分别为0.78和0.91,RRMSE分别为2.69%和4.17%。当玉米和日照的图像分辨率分别低于1.16 cm和3.84 cm时,植株数量的RMSE显著增加。总体上所述,该方法可以基于无人机遥感图像准确地计算田间作物的株数。

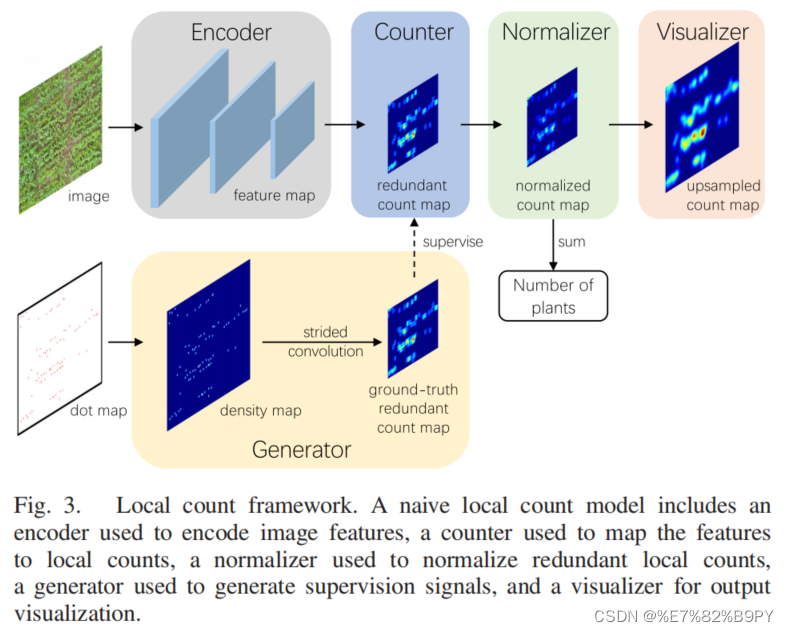

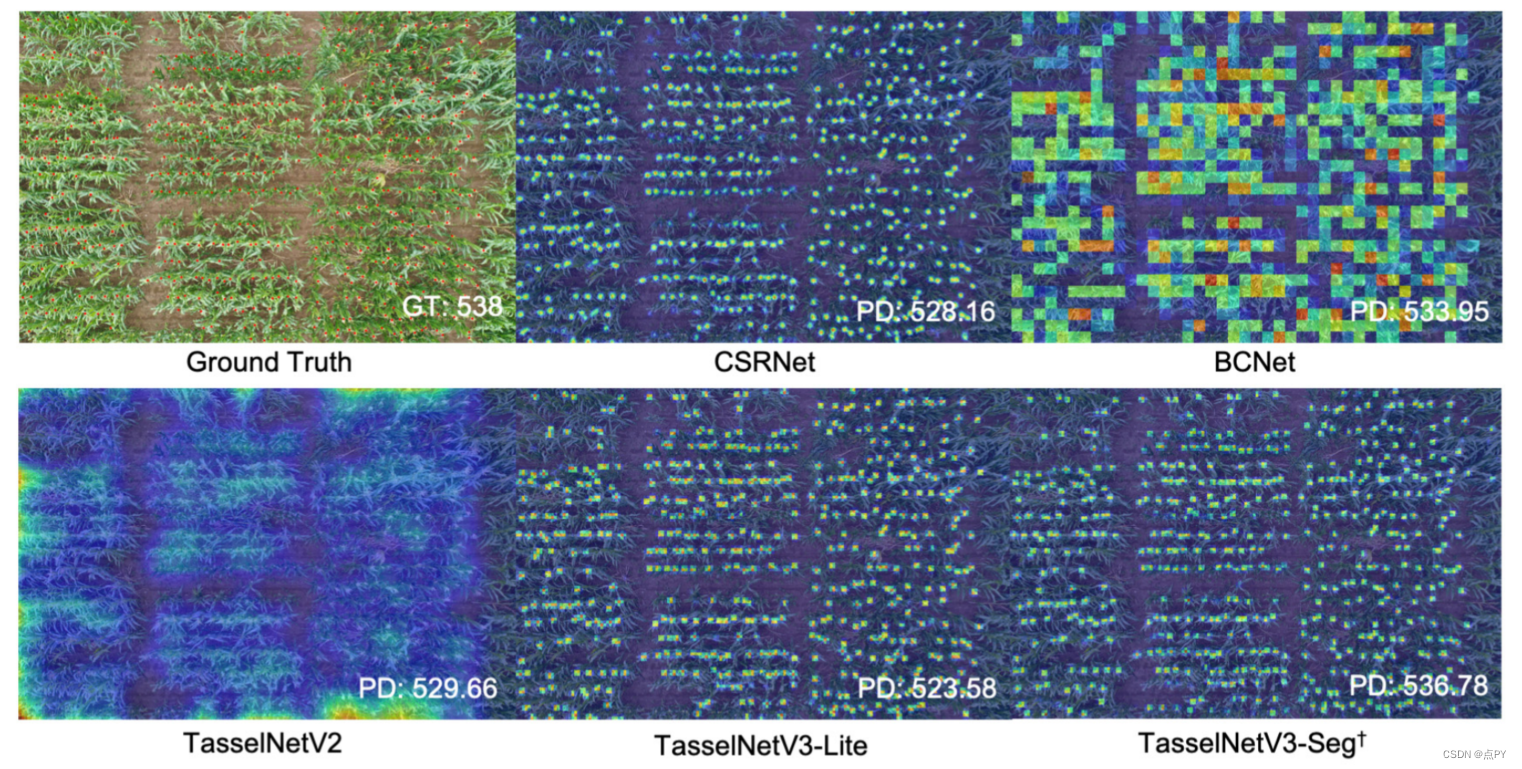

TasselNetV3: Explainable Plant Counting With Guided Upsampling and Background Suppression

code: https://github.com/poppinace/mtc-uav

摘要: 快速、准确的植物计数工具影响着现代农业的革命。然而,农业从业者期望这些工具的输出不仅准确,而且可以解释。这种可解释性通常是指推断出哪个实例被计数的能力。一种直观的方法是为每个实例生成一个边界框。然而,与通过检测计数相比,植物计数可以在本地计数框架中更直接地推断出来,而再现这个范式的一件事是它对输出可视化的可解释性很差。特别地,我们发现较差的可解释性成为了限制计数性能的瓶颈。为了解决这个问题,我们探索了引导上采样和背景抑制的思想,其中提出了一种新的上采样算子来允许计数再分配,并分别研究了具有不同融合策略的分割解码器来抑制背景。通过将它们集成到我们之前的计数模型塔塞elNetV2中,我们引入了塔塞尔NetV3系列:塔塞尔NetV3-Lite和塔塞尔NetV3-Seg。我们在三个公共植物计数数据集和一个新的基于无人机(UAV)的数据集上验证了TasselNetV3系列,包括玉米穗穗计数、小麦穗计数和水稻植株计数。大量的结果表明,引导上采样和背景抑制不仅提高了计数性能,而且使可解释的可视化。除了最先进的性能,我们有几个有趣的观察: 1)在大多数情况下,有限接受域计数器优于大接受域计数器;2)从虚线注释中生成经验分割掩模就足够了;3)中间融合是整合前景背景知识的好选择;4)解耦计数和分割问题的学习。

2023

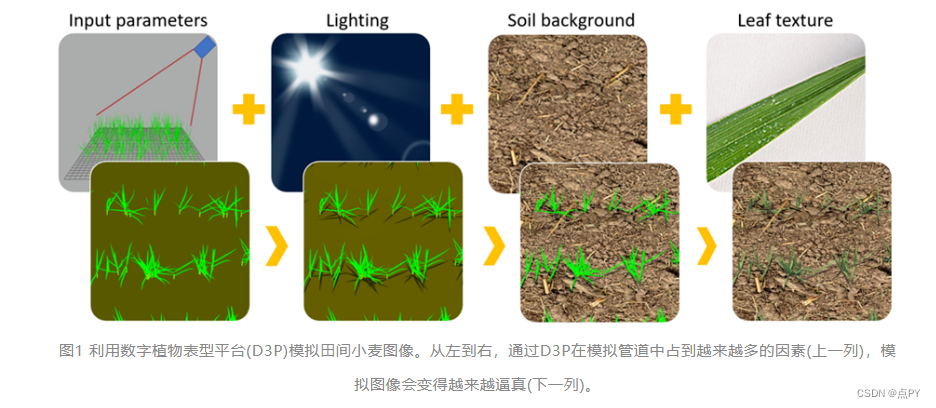

Self-Supervised Plant Phenotyping by Combining Domain Adaptation with 3D Plant Model Simulations: Application to Wheat Leaf Counting at Seedling Stage

摘要:给定时间内叶片的数量对植物生长发育的特征很重要。在这项工作中,开发了一种通过检测RGB图像中的叶尖来计算叶片数量的高通量方法。数字植物表型平台用于模拟小麦幼苗阶段的大量不同的RGB图像和相应的叶尖标签数据集(15万张图像,超过200万个标签)。然后在训练深度学习模型之前,使用域适应方法提高图像的真实感。结果证明了在不同的测试数据集上评估所提出方法的效率,收集了来自五个国家的测量数据,在不同的环境、生长阶段和不同的相机(450张图像,超过2162个标签)的光照条件下获得的测量结果。在深度学习模型与领域自适应技术的6种组合中,采用CycleGAN自适应技术的Faster-RCNN模型表现最佳(R2 = 0.94, RMSE = 8.7)。补充研究表明,在应用域自适应技术之前,模拟具有足够真实感的图像(背景、叶子纹理、光照条件)是至关重要的。此外,叶尖识别的空间分辨率应优于0.6 mm/像素。该方法声称是自监督的,因为模型训练不需要手动标记。这里开发的自我监督表型方法为解决广泛的植物表型问题提供了巨大的潜力。

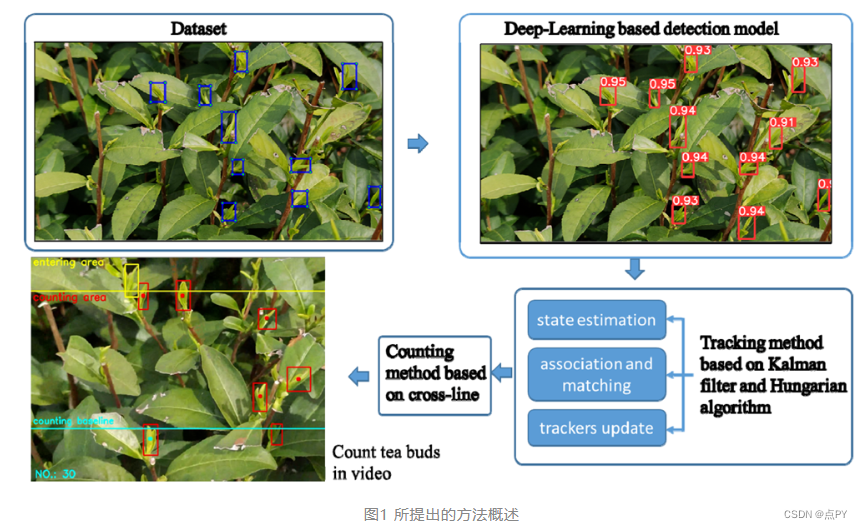

A Tea Buds Counting Method Based on YOLOv5 and Kalman Filter Tracking Algorithm

摘要:茶叶产量估算为收获时间和数量提供信息支持,为农民管理和采摘提供决策依据。但人工计数茶芽比较麻烦,效率低。为了提高茶叶产量估算的效率,本研究提出了一种基于深度学习的方法,通过使用增强的YOLOv5模型和压缩与激励网络(Squeeze and Excitation Network,SENet)来高效估算茶叶产量,如图1和图5。本研究使用的所有图像和视频均采集自中国农业科学院茶叶研究所嵊州综合实验基地,如图2,数据集的组成、处理和数据增强如图3和4。所提出的方法结合了匈牙利匹配和卡尔曼滤波算法,如图6,实现了准确可靠的茶芽计数(图7-9)。该模型在测试数据集上的平均精密度为91.88%,表明该模型具有较高的茶芽检测精度。模型在茶芽计数试验中的应用表明,测试视频计数结果与人工计数结果高度相关(R2 = 0.98,图10),表明该计数方法具有较高的准确性和有效性。综上所述,该方法可实现自然光下的茶芽检测和计数,为快速获取茶芽提供数据和技术支持。

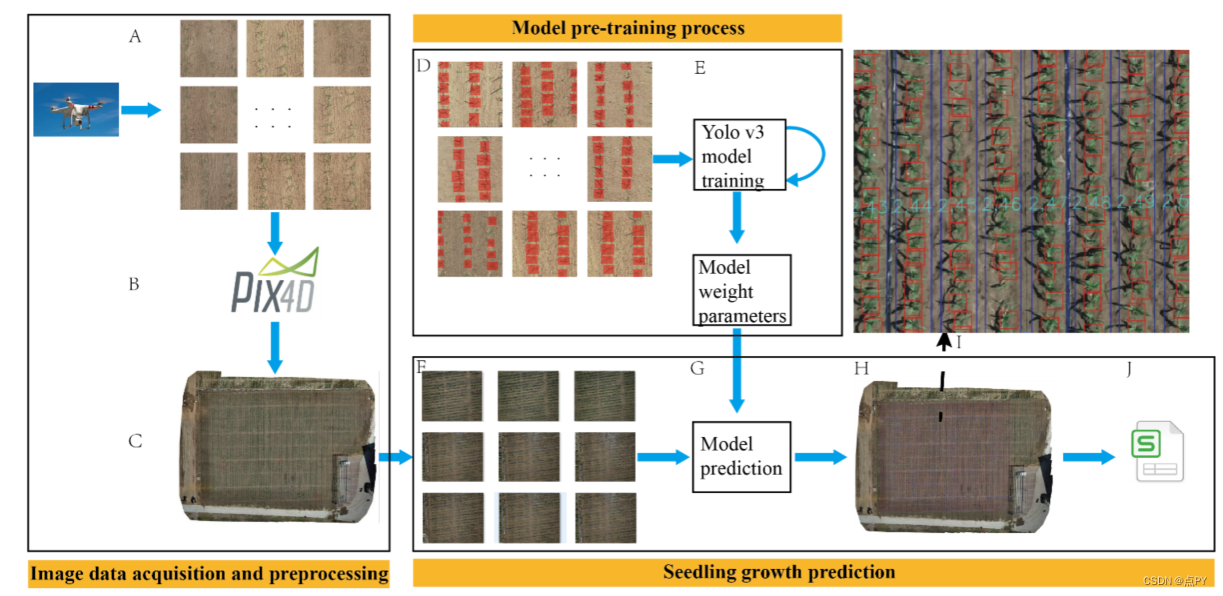

Quantitative Evaluation of Maize Emergence Using UAV Imagery and Deep Learning(Remote sensing)

摘要: 对作物出苗率的准确评估有助于育种者选择合适的作物基因型,农民及时做出田间管理决策,以提高玉米产量。作物出苗通常通过人工计算来量化幼苗的数量和大小,这既费力、低效、不可靠,不能可视化幼苗的空间分布和均匀性。基于遥感的表型技术可以对作物生长早期的出苗率进行高通量评估。本研究开发了一种基于深度学习算法的玉米出苗率快速估计系统。利用无人机(UAV)采集的RGB图像,建立了识别幼苗位置、间距和大小的最优模型,并在2021-2022年的三个观测站对系统的预测性能进行了评估。通过案例研究,展示了对玉米幼苗系统的评价,并结合TOPSIS(与理想解相似的偏好排序技术)分析。结果表明,该系统对玉米苗数的预测性能良好,平均r2值为0.96,准确率为92%,但阴影和种植密度影响其精度。当种植密度超过9万株/公顷时,预测精度显著降低。根据幼苗间距、苗期面积和苗长的平均值和变异系数,计算出幼苗出苗和生长的分布特征。估计精度的幼苗间距,幼苗间距变异系数,幼苗面积平均值,幼苗面积变异系数和平均值的幼苗长度分别为87.52、87.55、82.69、84.51和90.32%。综上所述,该系统可以快速分析试验田的玉米播种生长和均匀性特征,定位玉米出苗不良的小区。

529

529

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?