目录

顾名思义,深度残差收缩网络是由“残差网络”和“收缩”两个部分所组成的,是“残差网络”的一种改进算法。

其中,残差网络在2016年获得了ImageNet图像识别竞赛的冠军,目前已成为深度学习领域的基础网络;“收缩”就是“软阈值化”,是许多信号降噪方法的核心步骤。

深度残差收缩网络也是一种“注意力机制”下的深度学习算法。其软阈值化所需要的阈值,本质上是在注意力机制下设置的。

1. 相关基础

1.1 残差网络

详细请看:残差网络(Residual Network),残差连接(skip-connect)_马鹏森的博客-CSDN博客

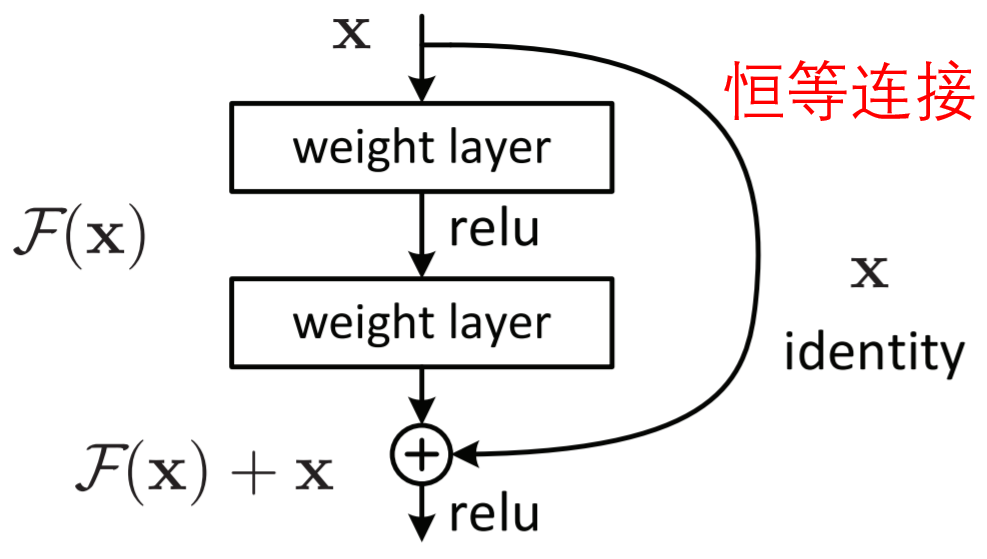

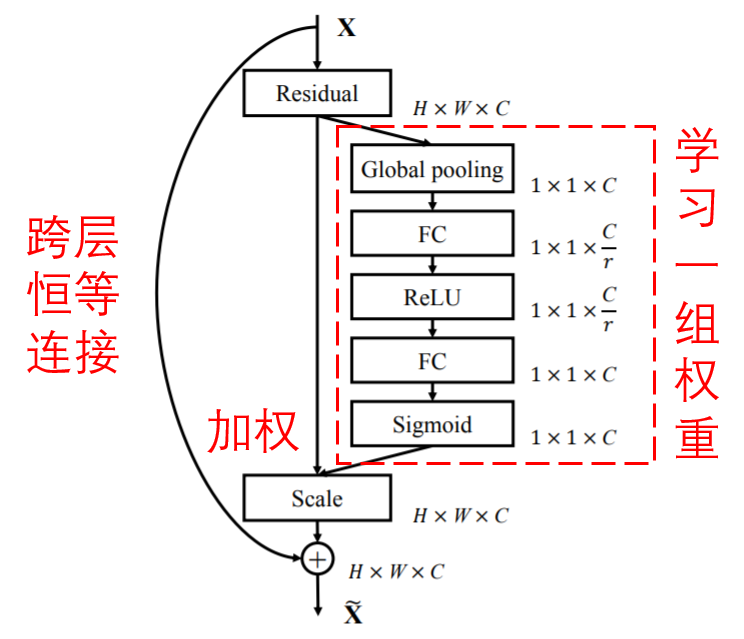

残差网络(或称深度残差网络、深度残差学习,英文ResNet)属于一种卷积神经网络。相较于普通的卷积神经网络,残差网络采用了跨层恒等连接,避免梯度消失和网络退化,以减轻深层卷积神经网络的训练难度。残差网络的一种基本模块如图1所示。

1.2 软阈值化

软阈值化是许多信号降噪方法的核心步骤。

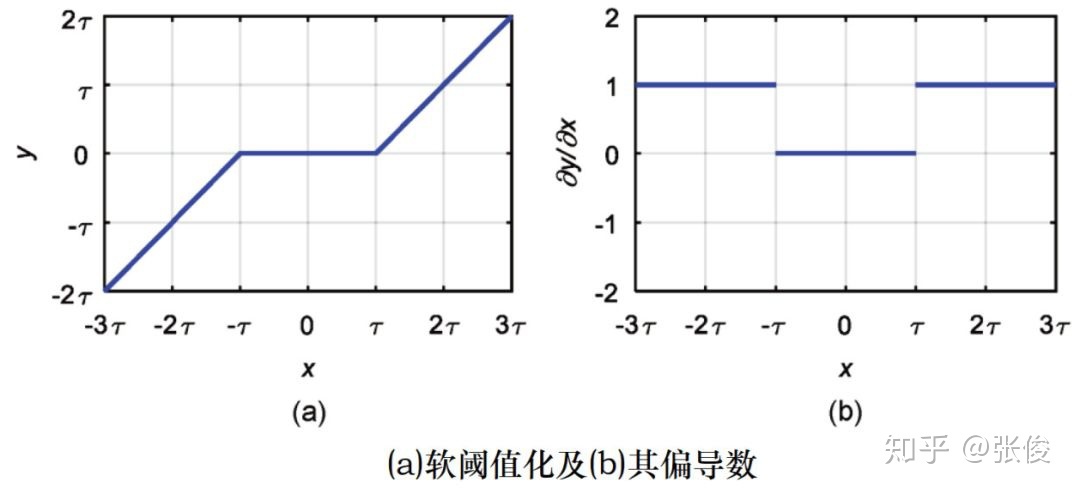

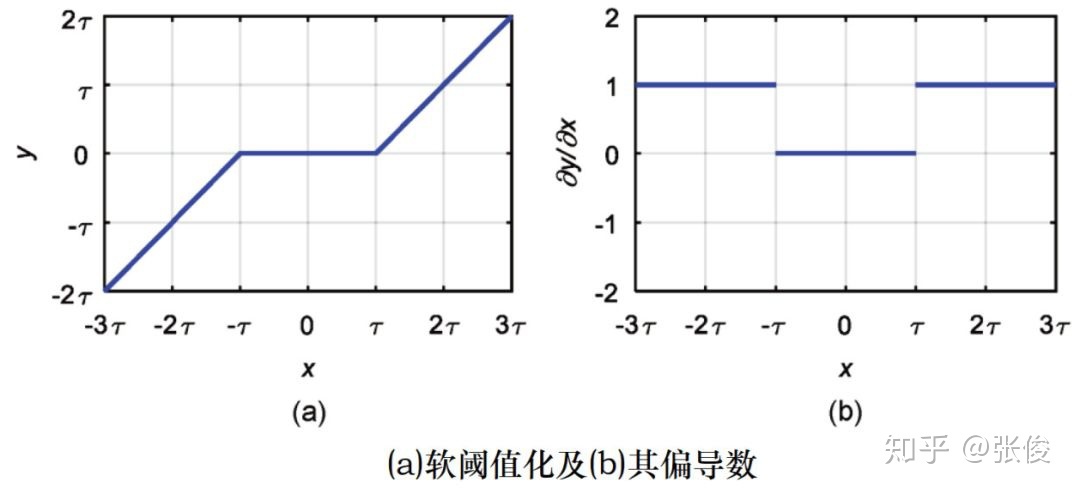

首先,我们需要设置一个正数阈值。该阈值不能太大,即不能大于输入数据绝对值的最大值,否则输出会全部为零。(即将输入数据的绝对值低于某个阈值的特征置为零),将其他的特征也朝着零进行调整,也就是收缩。在这里,阈值是一个需要预先设置的参数,其取值大小对于降噪的结果有着直接的影响。软阈值化的输入与输出之间的关系如图所示。

从图2可以看出,软阈值化是一种非线性变换,有着与ReLU激活函数非常相似的性质:梯度要么是0,要么是1。因此,软阈值化也能够作为神经网络的激活函数。事实上,一些神经网络已经将软阈值函数作为激活函数进行了使用。

值得注意的是,阈值的选取对软阈值函数的结果有着直接的影响,至今仍是一个难题。

1.3 注意力机制

注意力机制就是将注意力集中于局部关键信息的机制,可以分成两步:

第一,通过全局扫描,发现局部有用信息;

第二,增强有用信息并抑制冗余信息。

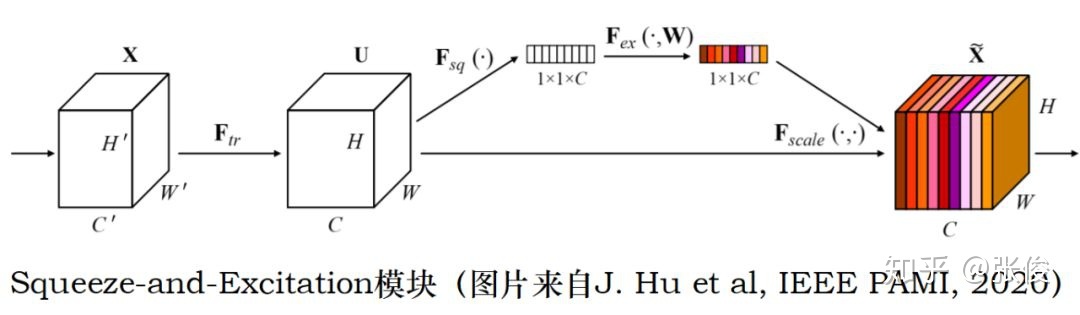

如下图所示,SENet 通过一个小型网络学习得到一组权值系数,用于各个特征通道的加权。这其实是一种注意力机制:首先评估各个特征通道的重要程度,然后根据其重要程度赋予各个特征通道合适的权重。

Squeeze-and-Excitation Network是一种非常经典的注意力机制下的深度学习方法。它可以通过一个小型的子网络,自动学习得到一组权重,对特征图的各个通道进行加权。其含义在于,某些特征通道是较为重要的,而另一些特征通道是信息冗余的;那么,我们就可以通过这种方式增强有用特征通道、削弱冗余特征通道。Squeeze-and-Excitation Network的一种基本模块如下图所示。

值得指出的是,通过这种方式,每个样本都可以有自己独特的一组权重,可以根据样本自身的特点,进行独特的特征通道加权调整。例如,样本A的第一特征通道是重要的,第二特征通道是不重要的;而样本B的第一特征通道是不重要的,第二特征通道是重要的;通过这种方式,样本A可以有自己的一组权重,以加强第一特征通道,削弱第二特征通道;同样地,样本B可以有自己的一组权重,以削弱第一特征通道,加强第二特征通道。

2. 深度残差收缩网络理论

2.1 动机

- 首先,现实世界中的数据,或多或少都含有一些冗余信息(任何与当前模式识别任务无关的信息,都可以被认为是噪声或者冗余信息。这些噪声或者冗余信息很可能会对当前的模式识别任务造成不利的影响)。那么我们就可以尝试将软阈值化嵌入残差网络中,以进行冗余信息的消除。

- 其次,对于任意的两个样本,各个样本中冗余信息含量经常是不同的。那么我们就可以借助注意力机制,使算法根据各个样本的情况、特点,自适应地给各个样本设置不同的阈值。

在上述两点的驱动下,我们能不能将传统信号降噪算法中的软阈值函数引入深度残差网络之中呢?软阈值函数中的阈值应该怎样选取呢?深度残差收缩网络就给出了一种答案。

2.2 算法实现

深度残差收缩网络融合了深度残差网络、SENet 和软阈值函数。

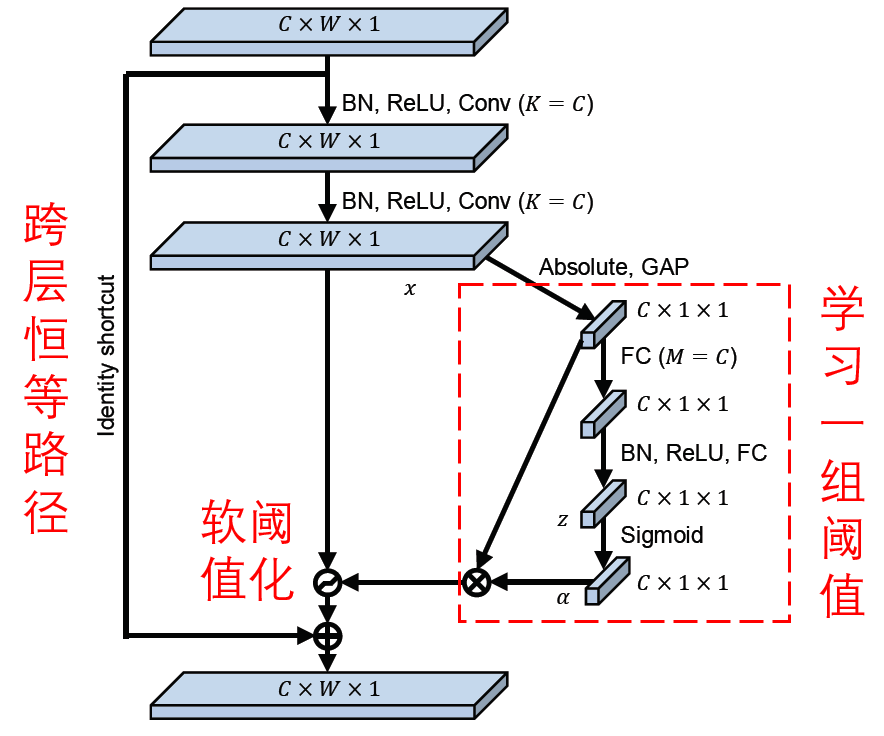

与残差网络和Squeeze-and-Excitation Network相似,如下图所示,深度残差收缩网络就是将残差模式下的 SENet 中的“重新加权”替换成了“软阈值化”。在 SENet 中,所嵌入的小型网络是用于获取一组权值系数;在深度残差收缩网络中,该小型网络则是用于获取一组阈值。深度残差收缩网络也是由许多基本模块堆叠而成的。每个基本模块都有一个子网络,用于自动学习得到一组阈值,用于特征图的软阈值化。值得指出的是,通过这种方式,每个样本都有着自己独特的一组阈值。深度残差收缩网络的一种基本模块如下图所示。

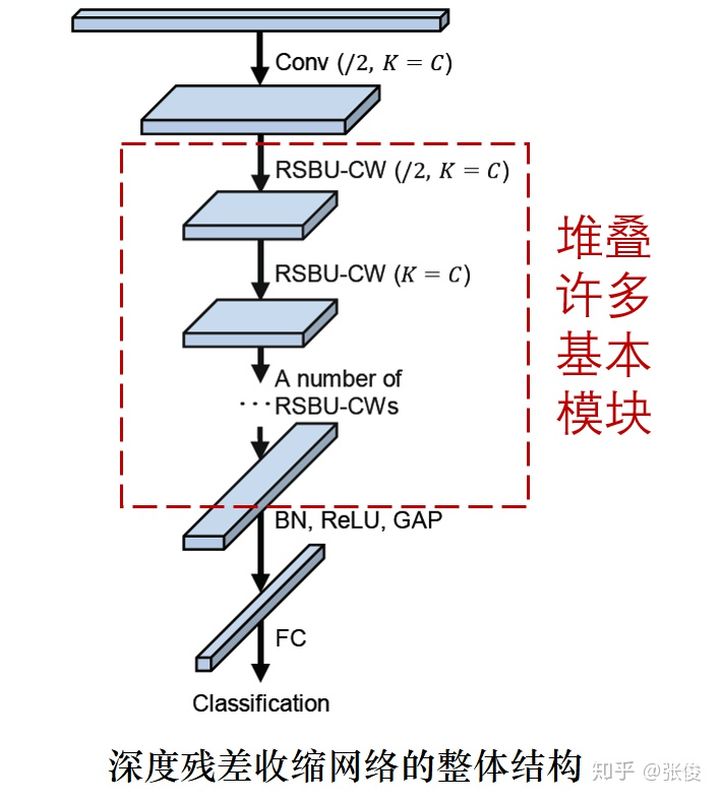

如下图所示,深度残差收缩网络的整体结构与普通的深度残差网络是一致的,包含了输入层、刚开始的卷积层、一系列的基本模块以及最后的全局均值池化和全连接输出层等。

为了获得合适的阈值,相较于原始的 SENet,深度残差收缩网络里面的小型网络的结构也进行了调整。具体而言,该小型网络所输出的阈值,是(各个特征通道的绝对值的平均值)×(一组 0 和 1 之间的系数)。通过这种方式,深度残差收缩网络不仅确保了所有阈值都为正数,而且阈值不会太大(不会使所有输出都为 0)。

2.3 优势

首先,软阈值函数所需要的阈值,是通过一个小型网络自动设置的,避免了人工设置阈值所需要的专业知识。

然后,深度残差收缩网络确保了软阈值函数的阈值为正数,而且在合适的取值范围之内,避免了输出全部为零的情况。

同时,每个样本都有自己独特的一组阈值,使得深度残差收缩网络适用于各个样本的噪声含量不同的情况。

结论

在论文中,深度残差收缩网络是应用于基于振动信号的旋转机械故障诊断。但是从原理上来讲,深度残差收缩网络面向的是数据集含有冗余信息的情况,而冗余信息是无处不在的。例如,在图像识别的时候,图像中总会包含一些与标签无关的区域;在语音识别的时候,音频中经常会含有各种形式的噪声。因此,深度残差收缩网络,或者说这种“注意力机制”+“软阈值化”的思路,有着较为广泛的研究价值和应用前景。

rreference:注意力机制+软阈值化=深度残差收缩网络(深度学习) - davidxiong - 博客园

1698

1698

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?