3D机器学习(5):6种激活函数、基于均方差的梯度下降法

最新推荐文章于 2023-09-15 15:16:52 发布

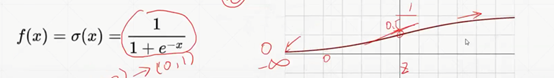

1.三种激活函数torch.sigmoi=F.sigmoidtorch.tannh=F.tanhtorch.relu=Frelu2.典型的loss函数:mean squire errorMSE=mean squire error=均方差:∑(y-y预测 )^2,这里norm会开根号,所以需要平方回去。F.mse_loss(y,y预测)函数可建立此类loss函数。当需要求导...

1.三种激活函数torch.sigmoi=F.sigmoidtorch.tannh=F.tanhtorch.relu=Frelu2.典型的loss函数:mean squire errorMSE=mean squire error=均方差:∑(y-y预测 )^2,这里norm会开根号,所以需要平方回去。F.mse_loss(y,y预测)函数可建立此类loss函数。当需要求导...

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?