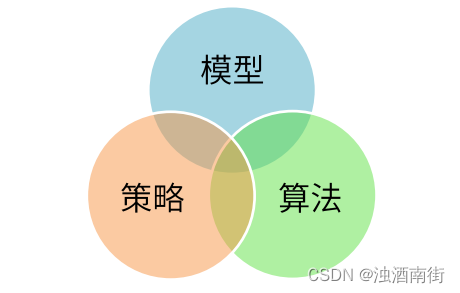

监督学习三要素

模型(model):总结数据的内在规律,用数学函数描述的系统

算法(algorithm):选取最优模型的具体方法

策略(strategy):选取最优模型的评价准则

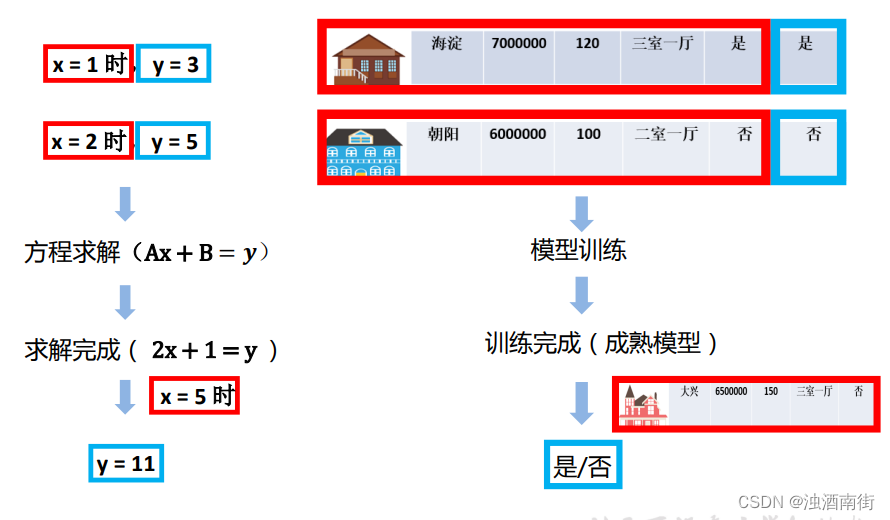

监督学习实现步骤

1.得到一个有限的训练数据集

2.确定包含所有学习模型的集合

3.确定模型选择的准则,也就是学习策略

4.实现求解最优模型的算法,也就是学习算法

5.通过学习算法选择最优模型

6.利用得到的最优模型,对新数据进行预测或分析

监督学习过程示例

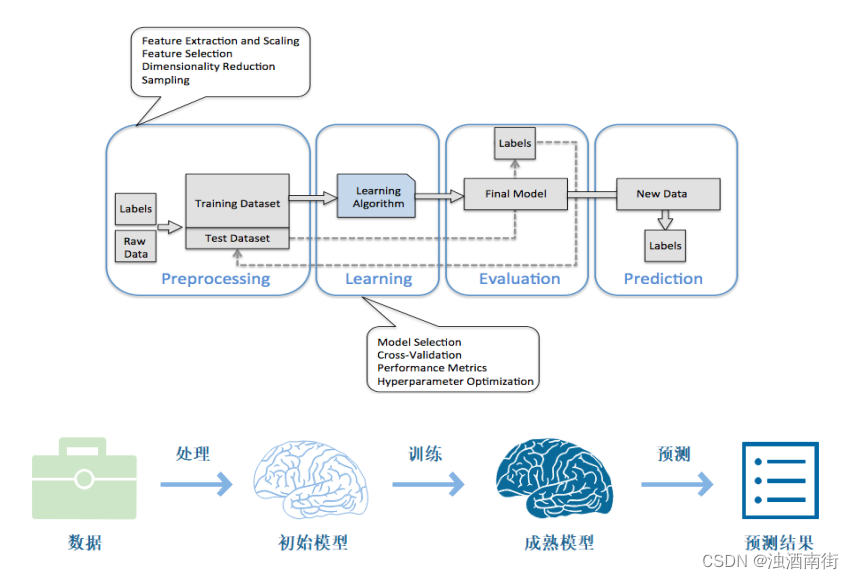

监督学习模型评估策略

模型评估:

训练集和测试集

我们将数据输入到模型中训练出了对应的模型,但是模型的效果好不好呢?我们需要对模型的好坏进行评估;

我们将用来训练模型的数据称为训练集,将用来预测模型好坏的集合称为测试集;

训练集:输入到模型中对模型进行训练的数据集合

测试集:模型训练完成后测试训练效果的数据集合

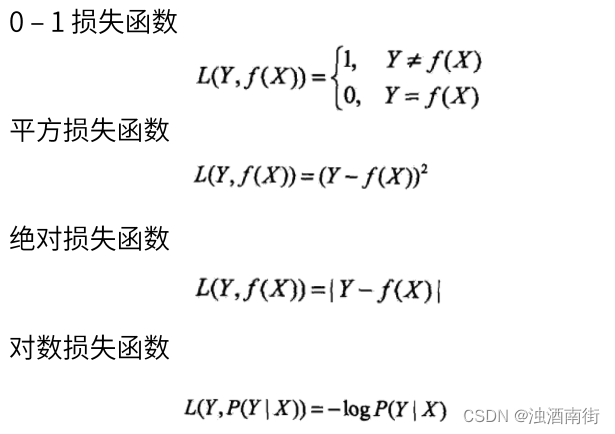

损失函数和经验风险

损失函数用来衡量模型预测误差的大小

定义:选取模型f为决策函数,对于给定的输入参数x,f(x)为预测结果,Y为真实结果;f(x)和Y之间可能会有偏差,我们急用一个损失函数(loss function)来度量预测偏差的程度,记作L(Y,f(x))

损失函数是系数的函数,损失函数值越小,模型就越好

损失函数:

经验风险

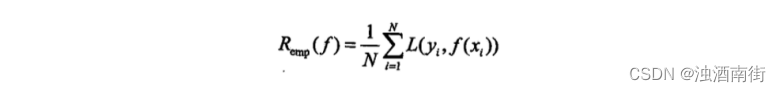

经验风险:模型 f(X) 关于训练数据集的平均损失称为经验风险(empirial risk),记作 Remp

经验风险最小化(Empirical Risk Minimization,ERM)

训练误差和测试误差

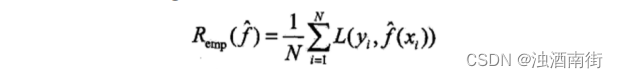

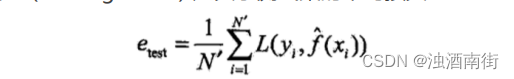

训练误差:训练误差(training error)是关于训练集的平均损失。

测试误差:测试误差(testing error)是关于测试集的平均损失。

测试误差真正反映了模型对未知数据的预测能力,这种能力一般被称为泛化能力

模型选择

过拟合和欠拟合

欠拟合:模型没有很好的捕捉到数据特征,特征集过小,导致模型不能很好地拟合数据,称之为欠拟合(under-fitting)

欠拟合的本质是对数据的特征学习得不够;

过拟合:把训练数据学习的太彻底,以至于把噪声数据的特征也学习到了,特征集过大,这样就会导致在后期测试的时候不能够很好地识别数据,即不能正确的分类,模型泛华能力太差,称之为过拟合(over-fitting);

模型的选择:

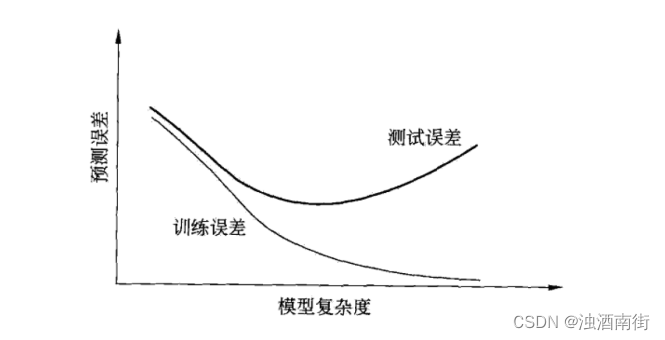

当模型复杂度增大时,训练误差会逐渐减小并趋向于0;而测试误差会先减小,达到最小值之后再增大;

当模型复杂度过大时,就会发生过拟合,所以模型复杂度应适当

正则化和交叉验证

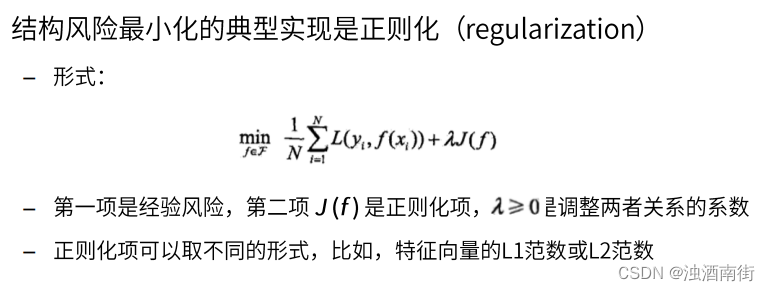

结构风险最小化(Structural Risk Minimization SRM)

在ERM基础上,为了防止过拟合而提出的策略

在经验风险上加上表是模型复杂度的正则化项(regularizer),或者叫惩罚项

正则化项一般是模型复杂度的单调递增函数,即模型越复杂,正则化值越大

奥卡姆剃刀

奥卡姆剃刀原理:如无必要,勿增实体

正则化符合奥卡姆剃刀原理。它的思想是:在所有坑选择的模型中,我们应该选择能够很好地解释一致数据并且十分简单的模型;

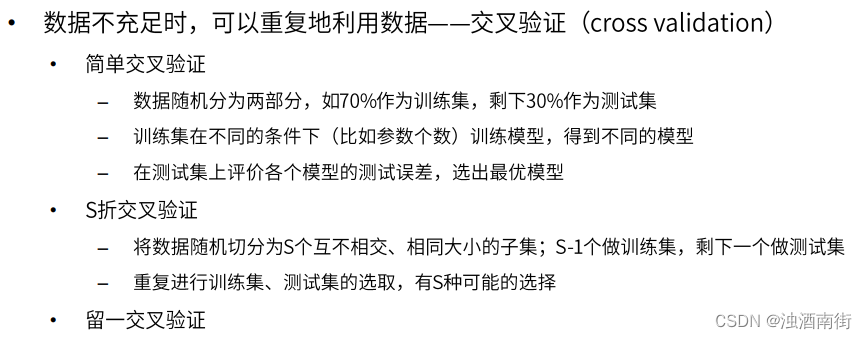

交叉验证

数据集划分

如果样本数据充足,一种简单方法是随机将数据集切成三部分:训练集(training set)、验证集(validation set)、测试集(test set)

训练集用于训练模型,验证集用于模型选择,测试集用于学习方法评估

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?