1.重新梳理两个事件的独立性

在上一小节中,我们引入了条件概率 P ( A ∣ B ) P(A|B) P(A∣B)这个重要概念,何谓条件概率?条件概率的核心就是刻画了事件 B B B的发生给事件 A A A是否发生所带来的额外信息。

在所有的条件概率情况当中,我们注意到一个有趣且重要的特殊情况,那就是事件 B B B的发生并没有给事件 A A A的发生带来什么新的额外信息。换言之,事件 B B B的发生与否,并没有影响到事件 A A A发生的概率,换句话说就是 P ( A ∣ B ) = P ( A ) P(A|B)=P(A) P(A∣B)=P(A)所表达的意思。

此时,我们称事件 A A A是独立于事件 B B B的,并由条件概率公式 P ( A ∣ B ) = P ( A ∩ B ) P ( B ) P(A|B)=\frac{P(A\cap B)}{P(B)} P(A∣B)=P(B)P(A∩B)可以进一步推导出等价的表达式: P ( A ∩ B ) = P ( A ) P ( B ) P(A\cap B)=P(A)P(B) P(A∩B)=P(A)P(B)。

到这里,就是我们所回顾的上一节中谈论到的两个事件相互独立的核心概念。

2.不相容与独立性

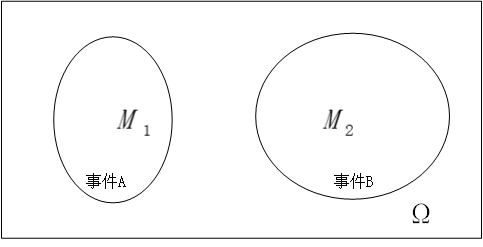

我们首先看看下面这幅图中所描述的情况:

在图中,表示事件 A A A和事件 B B B的两个圆圈互不相交,即意味着两个事件不相容,你会不会直观的感觉到,事件 A A A和事件 B B B二者看上去没啥关系,二者就是相互独立的?

这个说法看似很有道理,然而事实上却恰巧相反,若事件 A A A和事件 B B B互不相容,并且像图中所描述的,能够保证两个事件发生的概率: P ( A ) > 0 P(A)>0 P(A)>0且 P ( B ) > 0 P(B)>0 P(B)>0成立,则他们永远不会相互独立。

这是为什么呢?我们直接抠定义就好了,这是因为:首先有 A ∩ B = ϕ A\cap B=\phi A∩B=ϕ,那么显然有联合概率 P ( A ∩ B ) = 0 P(A\cap B)=0 P(A∩B)=0,而由于 P ( A ) P(A) P(A)和 P ( B ) P(B) P(B)均大于 0 0 0,则有 P ( A ) P ( B ) ≠ 0 P(A)P(B)\neq0 P(A)P(B)=0 。因此,从 P ( A ∩ B ) ≠ P ( A ) P ( B ) P(A\cap B) \neq P(A)P(B) P(A∩B)=P(A)P(B)的结果来看,并不满足事件 A A A和事件 B B B相互独立的基本条件。

其实,这个结果从常理上来说我们也很好理解,由于事件 A A A和事件 B B B不相容,从图中可以看出,如果事件 B B B发生,则意味着事件 A A A一定不会发生,那么这就实际上说明了:事件 B B B的发生就给事件 A A A的发生引入了额外的信息,那么,二者显然就不是互相独立的了。

3.条件独立

3.1.条件独立的直观感受

我们在前面讨论了条件概率的内容,自然的直觉告诉我们,我们也应该在条件概率的框架之下来讨论事件之间的独立性,即探讨条件独立的概念。

条件独立的概念其实和独立的概念在本质上并没有太大的区别,无非是在进行事件 A A A和事件 B B B讨论的基础上,引入了另外一个前提条件:事件 C C C。即在给定事件 C C C发生的前提条件之下,若事件 A A A和事件 B B B满足等式: P ( A ∩ B ∣ C ) = P ( A ∣ C ) P ( B ∣ C ) P(A\cap B|C)=P(A|C)P(B|C) P(A∩B∣C)=P(A∣C)P(B∣C)成立,我们就说事件 A A A和事件 B B B在给定事件 C C C的前提之下条件独立。大家发现这是不是和独立性的定义基本上差不多呢?

3.2.条件独立的表达式

同样的,我们先对 P ( A ∩ B ∣ C ) P(A\cap B|C) P(A∩B∣C)这个式子进行简单的变形处理:

P ( A ∩ B ∣ C ) = P ( A ∩ B ∩ C ) P ( C ) = P ( C ) P ( B ∣ C ) P ( A ∣ B ∩ C ) P ( C ) = P ( B ∣ C ) P ( A ∣ B ∩ C ) P(A\cap B|C)=\frac{P(A\cap B\cap C)}{P(C)}=\frac{P(C)P(B|C)P(A|B\cap C)}{P(C)}=P(B|C)P(A|B\cap C) P(A∩B∣C)=P(C)P(A∩B∩C)=P(C)P(C)P(B∣C)P(A∣B∩C)=P(B∣C)P(A∣B∩C)

其实,在短短这几步的推导里面,涉及到了不少的知识内涵,我们下面来一一解析:

首先,我们依照条件概率的定义,可以得到第一步推导结果:

P ( A ∩ B ∣ C ) = P ( A ∩ B ∩ C ) P ( C ) P(A\cap B|C)=\frac{P(A\cap B\cap C)}{P(C)} P(A∩B∣C)=P(C)P(A∩B∩C)

而第二个推导的等式,则是在条件概率应用领域当中使用非常广泛的链式法则:

P ( A ∩ B ∩ C ) = P ( B ∩ C ) P ( A ∣ B ∩ C ) = P ( C ) P ( B ∣ C ) P ( A ∣ B ∩ C ) P(A\cap B\cap C)=P(B\cap C)P(A|B\cap C)=P(C)P(B|C)P(A|B\cap C) P(A∩B∩C)=P(B∩C)P(A∣B∩C)=P(C)P(B∣C)P(A∣B∩C)

最后,我们结合 P ( A ∩ B ∣ C ) = P ( B ∣ C ) P ( A ∣ B ∩ C ) P(A\cap B|C)=P(B|C)P(A|B\cap C) P(A∩B∣C)=P(B∣C)P(A∣B∩C)这个等式和条件独立的定义式 P ( A ∩ B ∣ C ) = P ( A ∣ C ) P ( B ∣ C ) P(A\cap B|C)=P(A|C)P(B|C) P(A∩B∣C)=P(A∣C)P(B∣C),会发现他们拥有相同的等式左侧,因此将两个等式的右侧划上等号,就可以得到: P ( B ∣ C ) P ( A ∣ B ∩ C ) = P ( A ∣ C ) P ( B ∣ C ) P(B|C)P(A|B\cap C)=P(A|C)P(B|C) P(B∣C)P(A∣B∩C)=P(A∣C)P(B∣C)

最终我们就获得了这么一个等式: P ( A ∣ B ∩ C ) = P ( A ∣ C ) P(A|B\cap C)=P(A|C) P(A∣B∩C)=P(A∣C)

这个等式是条件独立的另一个等价定义,也是非常直观的一个等式,这个等式说明了在给定事件 C C C发生的前提条件下,进一步假定此时如果事件 B B B也发生,并不会影响事件 A A A的发生概率(当然这里是指在事件 C C C发生前提下,事件 A A A发生的条件概率)。

简单点说,就是在事件 C C C发生的总的前提条件下,事件 B B B是否发生,不影响事件 A A A发生的概率。其实这就又回到了条件概率定义的源头上去了。

3.3.独立与条件独立

这里,我们停下来仔细思考一个重要的概念问题,就是事件 A A A和事件 B B B相互独立和在事件 C C C发生的基础上条件独立是不是等价的呢?直观上看觉得似乎应该能,但是事实上呢?我们看看下面这个例子:

我们举一个非常简单的例子:

假设依次抛掷两枚均匀的硬币,事件 A A A表示第一枚硬币正面向上,事件 B B B表示第二枚硬币正面向上。

首先,事件 A A A和事件 B B B肯定是相互独立的。那我们此时引入一个条件事件 C C C,事件 C C C表示两次试验的结果不同。那么显然,概率 P ( A ∩ B ∣ C ) = 0 P(A\cap B|C)=0 P(A∩B∣C)=0,因为在两次试验结果不同的前提条件下,压根不可能发生两次都是正面的情况。

而另一方面呢?显然两个单独的条件概率 P ( A ∣ C ) ≠ 0 P(A|C) \neq0 P(A∣C)=0, P ( B ∣ C ) ≠ 0 P(B|C)\neq0 P(B∣C)=0,因此 P ( A ∩ B ∣ C ) ≠ P ( A ∣ C ) P ( B ∣ C ) P(A\cap B|C)\neq P(A|C)P(B|C) P(A∩B∣C)=P(A∣C)P(B∣C),也就是说事件 A A A和事件 B B B不满足事件 C C C发生下的条件独立的要求。

这个例子非常明确的说明了,独立和条件独立并不等价。

4.一组事件的独立性

最后,我们将两个事件相互独立的概念进一步推广到多个事件之间的相互独立性。为了方便我们直观理解,这里我们先将多个事件约定为 3 3 3个,讨论清楚了 3 3 3个事件独立的情况之后,其他的情况自然而然就迎刃而解了。

关于事件 A 1 A_1 A1 , A 2 A_2 A2 , A 3 A_3 A3,这 3 3 3个事件满足相互独立的条件归结为以下 4 4 4条:

P

(

A

1

∩

A

2

)

=

P

(

A

1

)

P

(

A

2

)

P(A_1\cap A_2)=P(A_1)P(A_2)

P(A1∩A2)=P(A1)P(A2)

P

(

A

1

∩

A

3

)

=

P

(

A

1

)

P

(

A

3

)

P(A_1\cap A_3)=P(A_1)P(A_3)

P(A1∩A3)=P(A1)P(A3)

P

(

A

2

∩

A

3

)

=

P

(

A

2

)

P

(

A

3

)

P(A_2\cap A_3)=P(A_2)P(A_3)

P(A2∩A3)=P(A2)P(A3)

P

(

A

1

∩

A

2

∩

A

3

)

=

P

(

A

1

)

P

(

A

2

)

P

(

A

3

)

P(A_1\cap A_2\cap A_3)=P(A_1)P(A_2)P(A_3)

P(A1∩A2∩A3)=P(A1)P(A2)P(A3)

首先我们看到,前面的三个等式说明了任意两个事件之间是相互独立的,这种性质称之为两两独立,但是这并没有结束,第四个条件也是必要的,他并不是前面三个等式的推论,他无法仅仅通过前面三个条件成立就能得到。反过来,第四个条件成立也不能推导出前面三个条件的成立。

简单点说吧,就是上面这四个条件必须全部检验、全部满足,才能够说这三个事件之间满足独立性。

还是用上面那个抛硬币的那个例子,事件 A A A表示第一枚硬币正面向上,事件 B B B表示第二枚硬币正面向上,事件 C C C表示两次试验的结果不同。

首先事件 A A A和事件 C C C显然满足: P ( C ) = P ( C ∣ A ) = 1 2 P(C)=P(C|A)=\frac{1}{2} P(C)=P(C∣A)=21,即事件 A A A和事件 C C C独立,同理可知事件 B B B和事件 C C C独立,同时我们知道事件 A A A和事件 B B B也满足独立性。

但是到目前为止,即便前三个条件都满足了,此时第四个等式仍然不能满足:即 P ( A ∩ B ∩ C ) = 0 P(A\cap B \cap C)=0 P(A∩B∩C)=0, P ( A ) P ( B ) P ( C ) = 1 8 P(A)P(B)P(C)=\frac{1}{8} P(A)P(B)P(C)=81,这两个等式并不相等。

最后由特殊到一般,我们来概况一下任意个数的一组事件之间相互独立应该满足的条件:

P ( ⋂ i ∈ S A i ) = ∏ i ∈ S P ( A i ) P(\bigcap_{i\in S}A_i)=\prod_{i\in S}P(A_i) P(⋂i∈SAi)=∏i∈SP(Ai)对 { 1 , 2 , . . . , n } \{1,2,...,n\} {1,2,...,n}的任意子集 S S S都成立,则称 A 1 , . . . , A n A_1,...,A_n A1,...,An为相互独立的事件。

脱离开上面形式化的公式,实际上,我们可以更加直观的来理解一组事件的独立性,通过对比,其实不难发现他的背景与两个事件的独立性是一样的。一组事件满足独立性意味着下面一个事实:我们把一组事件任意的分成两个小组,一个小组中的任意个数事件的出现与不出现,都不会给另一个小组中事件的发生与否带来任何额外的信息。

5.独立重复试验

在介绍完了事件独立性的基础上,我们再来简单的提一下大家耳熟能详的独立重复试验。

如果某一个试验由一系列独立并且相同的小试验组成,我们称这种试验为独立重复试验。当每个小试验只有两种可能结果的时候,就是我们最为常见的伯努利试验。

这里最简单的例子就是抛硬币。例如,连续 n n n次独立地抛掷硬币,每次抛掷的结果为正面的概率记作 p p p,这里的独立指得就是每次试验的事件 A 1 , A 2 , . . . , A n A_1,A_2,...,A_n A1,A2,...,An都是独立的,其中 A i A_i Ai表示第 i i i次抛掷的结果为正面。独立性就意味着不管前面的抛掷结果如何,每次抛掷得到正面的概率都是 p p p。

因此最终我们可以知道,在 n n n次试验中,有 k k k次试验结果为正面的概率为: p ( k ) = ( n k ) p k ( 1 − p ) n − k p(k)=\begin{pmatrix} n\\ k \end{pmatrix}p^k(1-p)^{n-k} p(k)=(nk)pk(1−p)n−k 。

当然这个例子本身非常简单,大家也都非常熟悉,这里只是为了再强调一下独立的含义,演示一个独立重复试验的过程。独立重复试验的概念和场景将在我们后面的课程内容中反复多次出现。

本文探讨了概率统计中的独立性概念,包括两个事件的独立性、不相容与独立性的关系,以及条件独立的定义和示例。通过对独立事件和条件独立的分析,展示了它们在事件组和独立重复试验中的应用,帮助深化对概率统计的理解。

本文探讨了概率统计中的独立性概念,包括两个事件的独立性、不相容与独立性的关系,以及条件独立的定义和示例。通过对独立事件和条件独立的分析,展示了它们在事件组和独立重复试验中的应用,帮助深化对概率统计的理解。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?