目录

4、GoogLeNet (Inception v1, 2014)

1、神经结构搜索 Neural Architecture Search (2016+)

7、MobileNet V1/V2/V3 (2017~2019)

3、Swin Transformer (ICCV 2021 best paper)

2、组合数据增强 AutoAugment & RandAugment

2、Relative Location (ICCV 2015)

4、Masked autoencoders (MAE, CVPR 2022)

一、引言

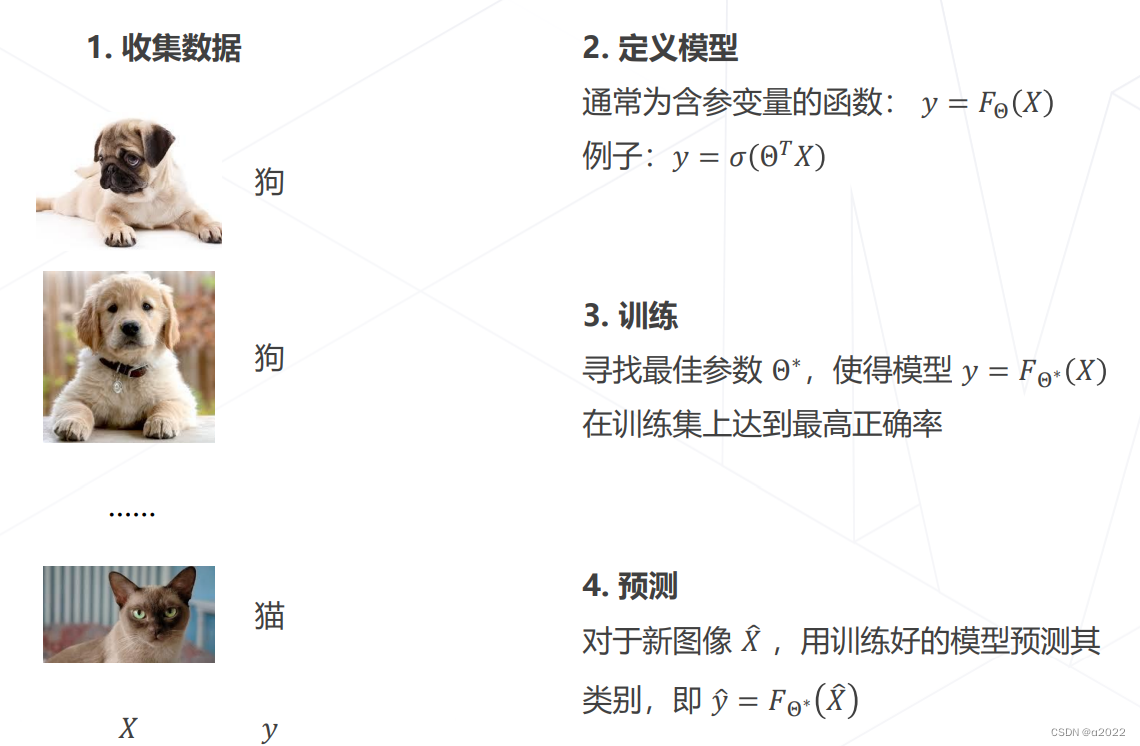

1、超越规则:让机器从数据中学习

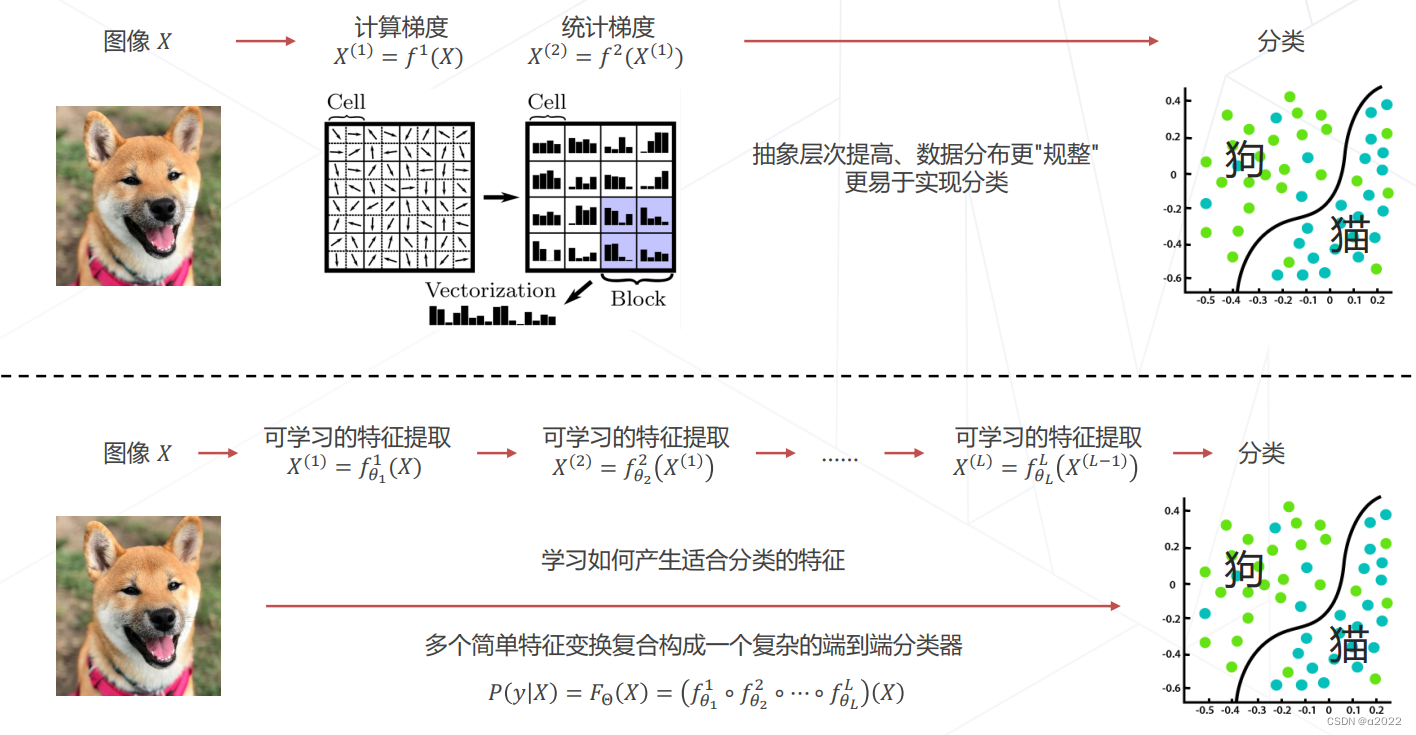

2、传统方法:设计图像特征 (1990s~2000s)

3、特征工程的天花板

4、从特征工程到特征学习

5、层次化特征的实现方式

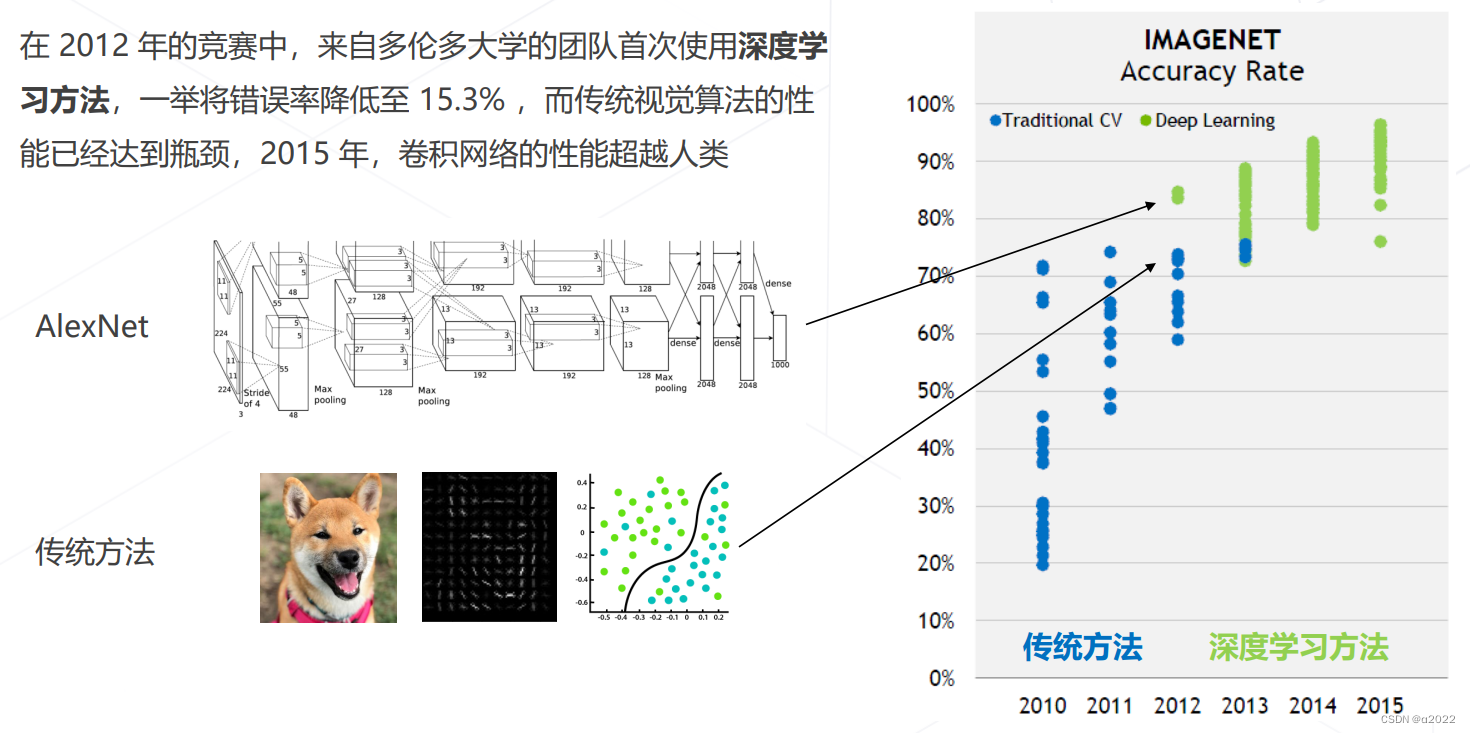

6、AlexNet 的诞生 & 深度学习时代的开始

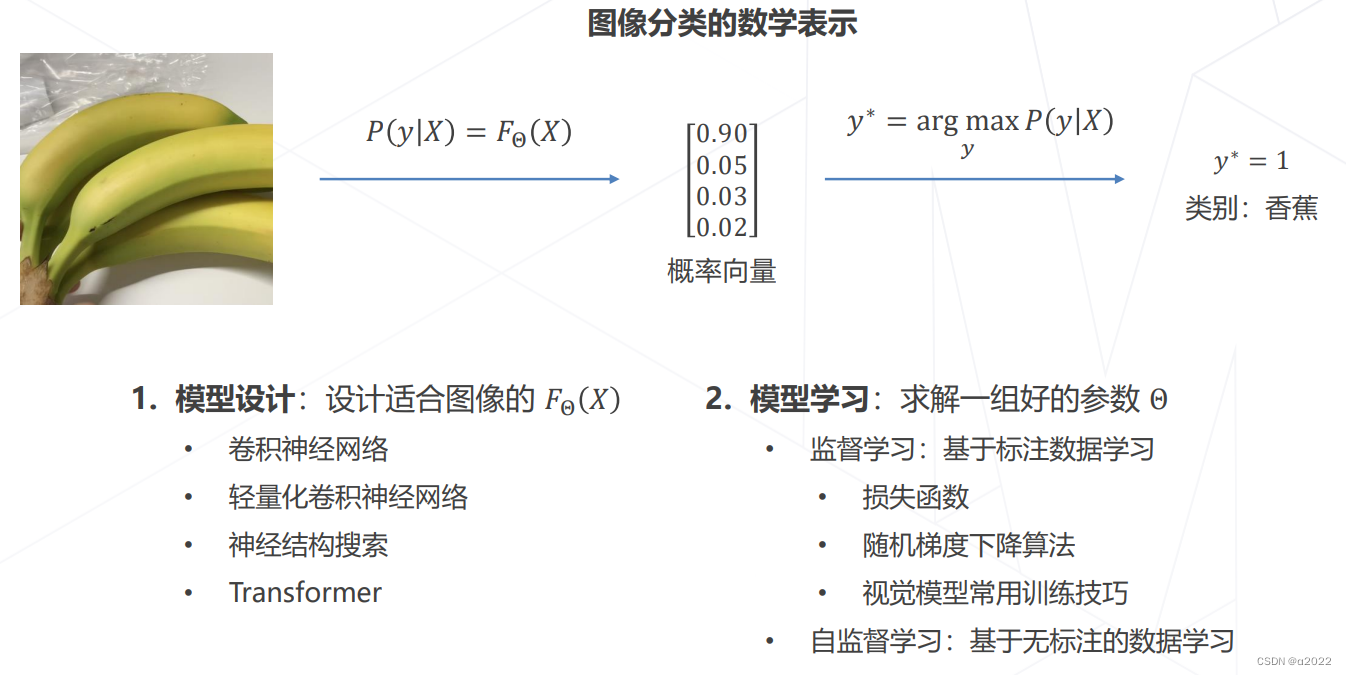

7、课程内容

二、卷积神经网络

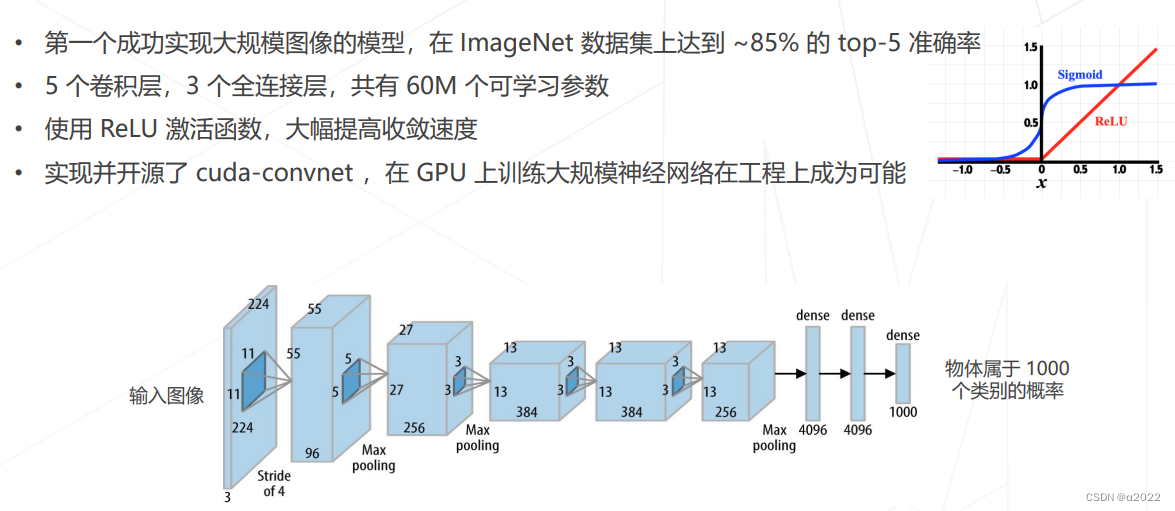

1、AlexNet (2012)

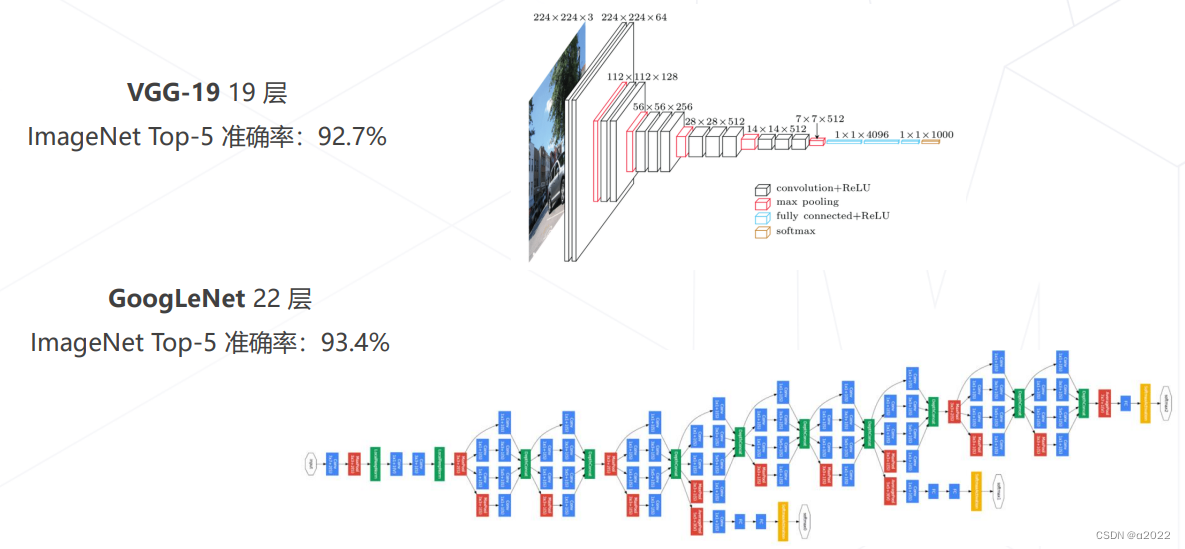

2、Going Deeper (2012~2014)

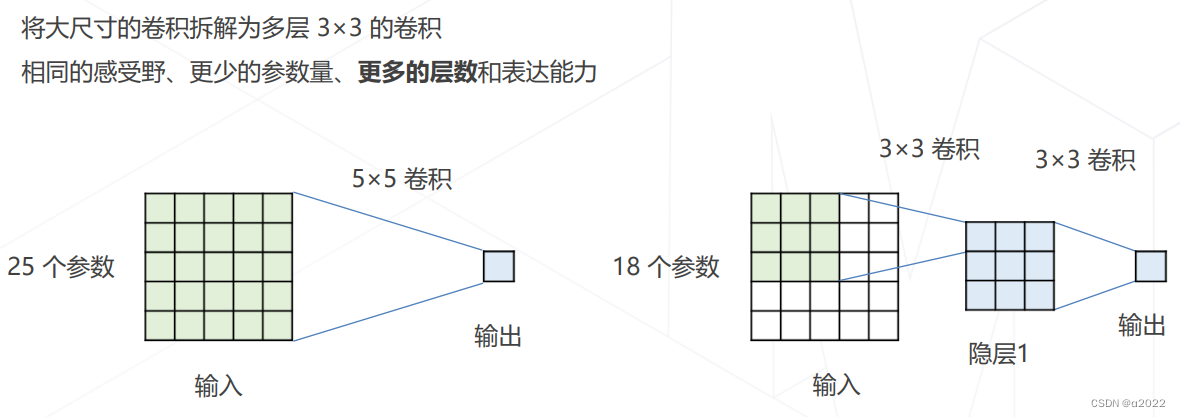

3、VGG (2014)

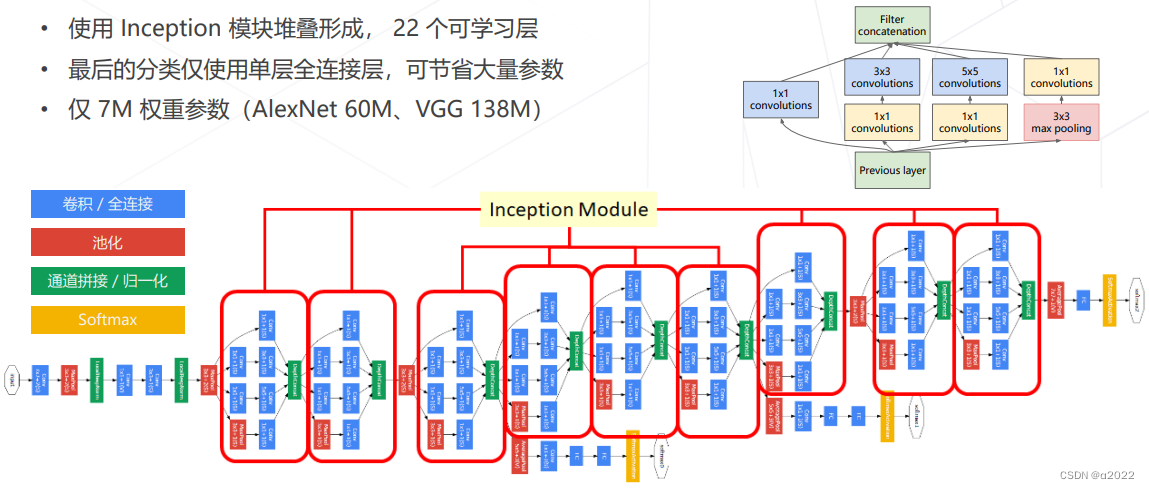

4、GoogLeNet (Inception v1, 2014)

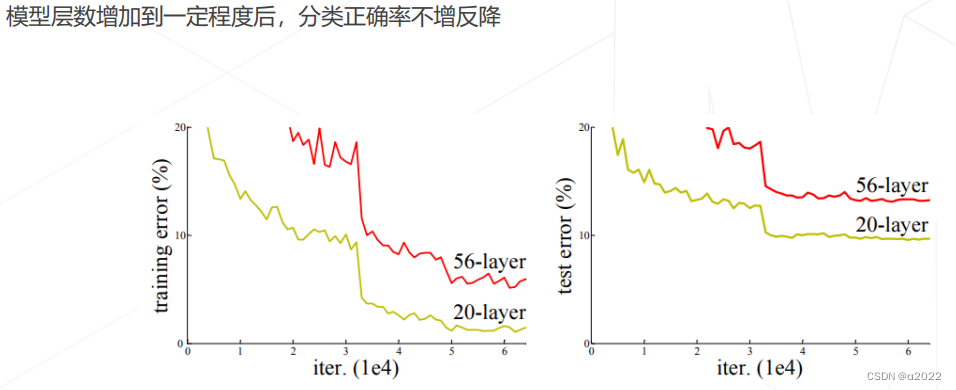

精度退化问题

实验的反直觉

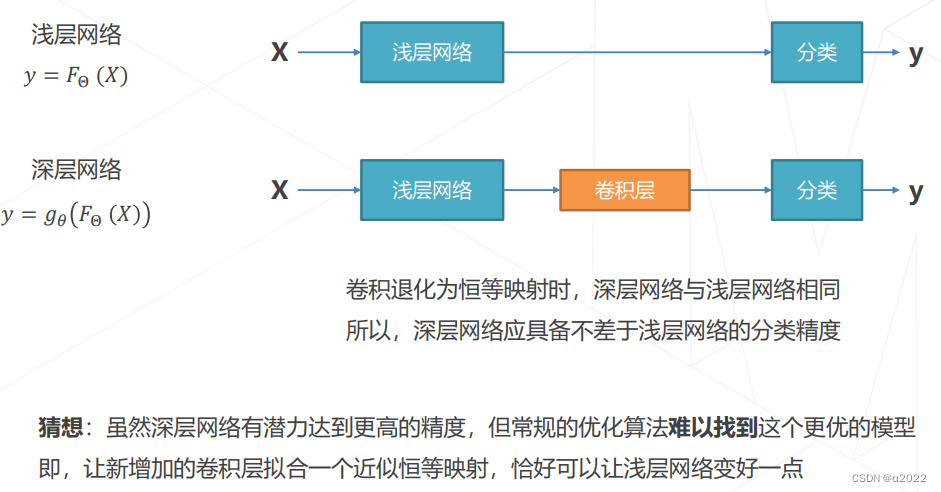

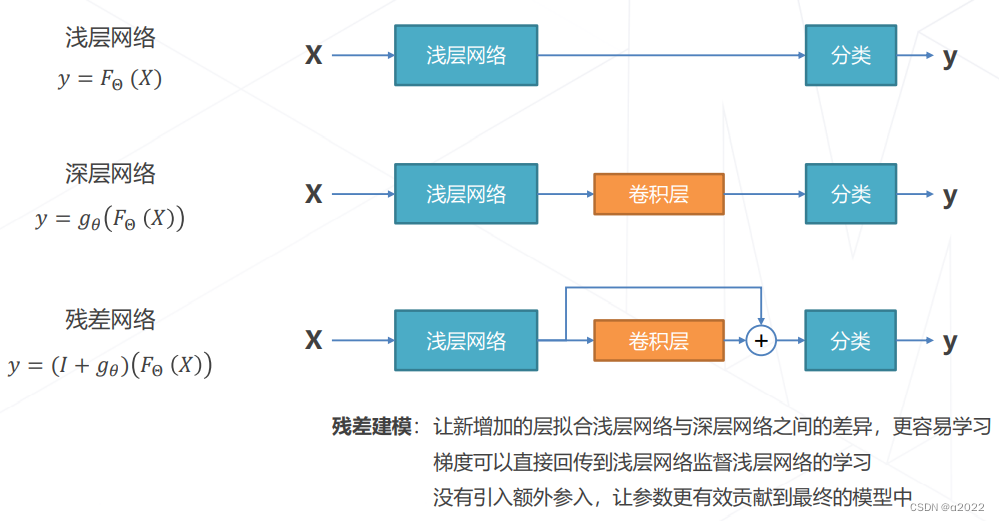

残差学习的基本思路

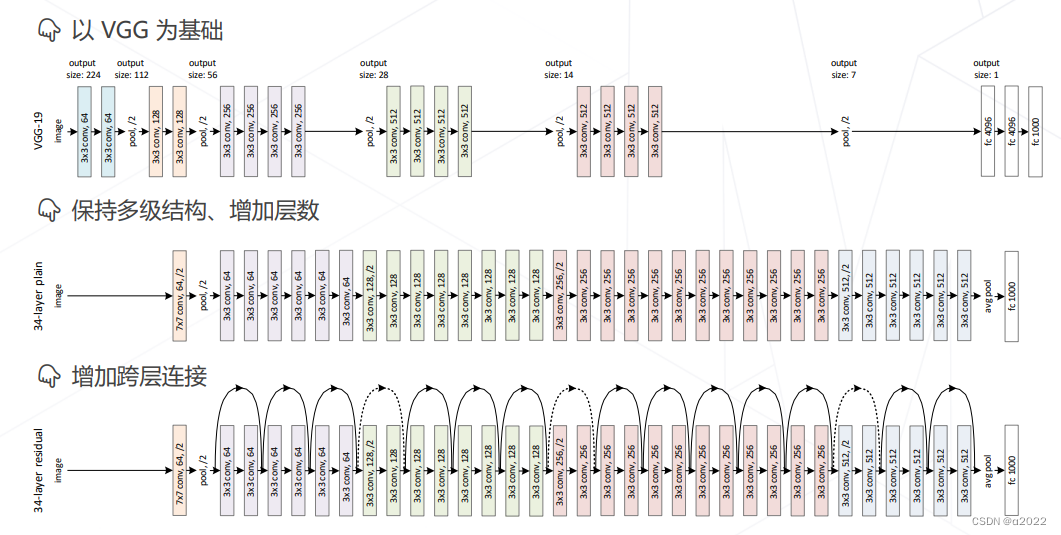

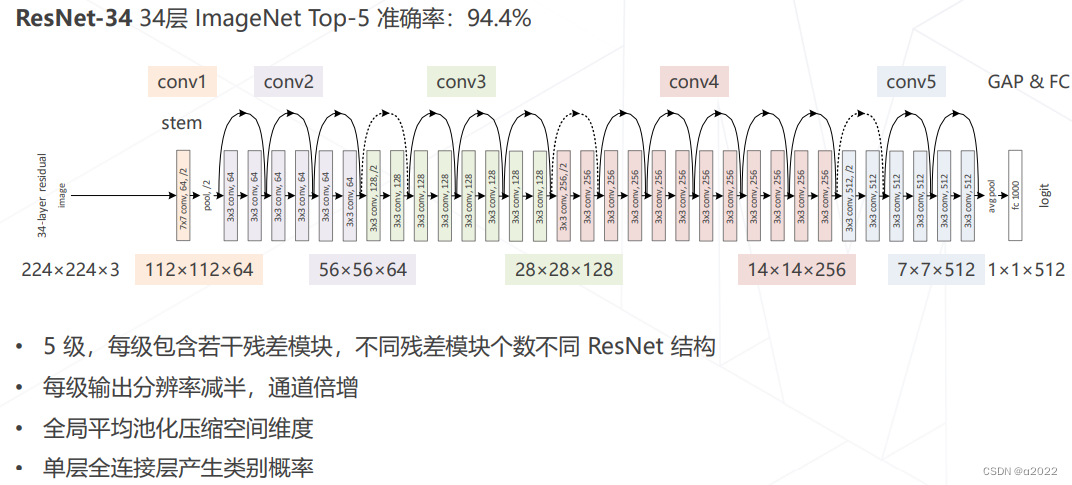

5、残差网络 ResNet (2015)

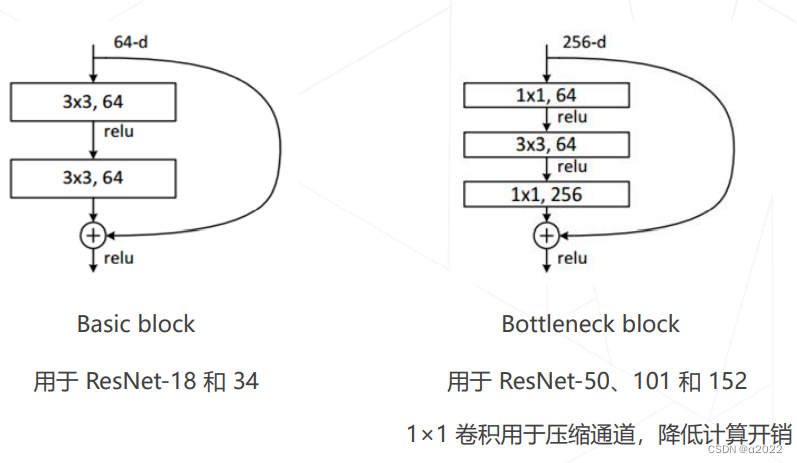

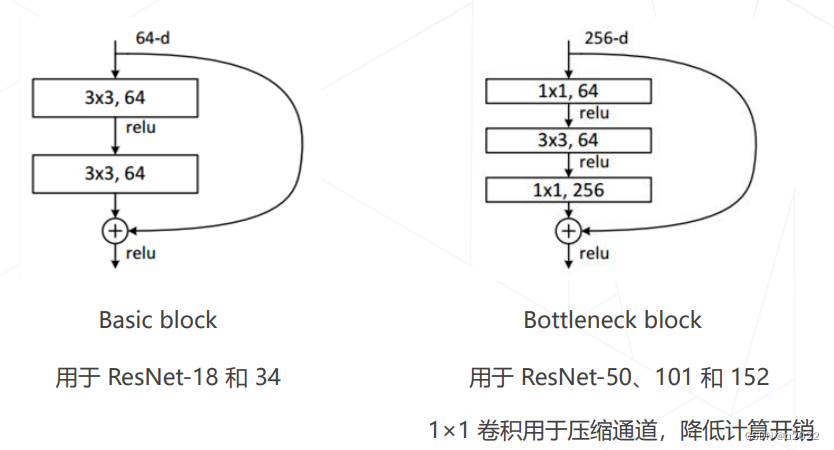

ResNet 中的两种残差模块

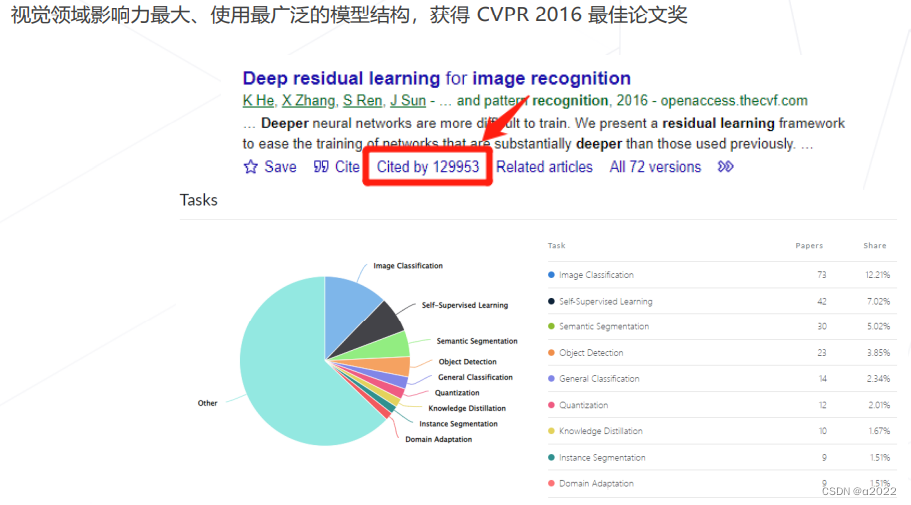

ResNet 的成就和影响力

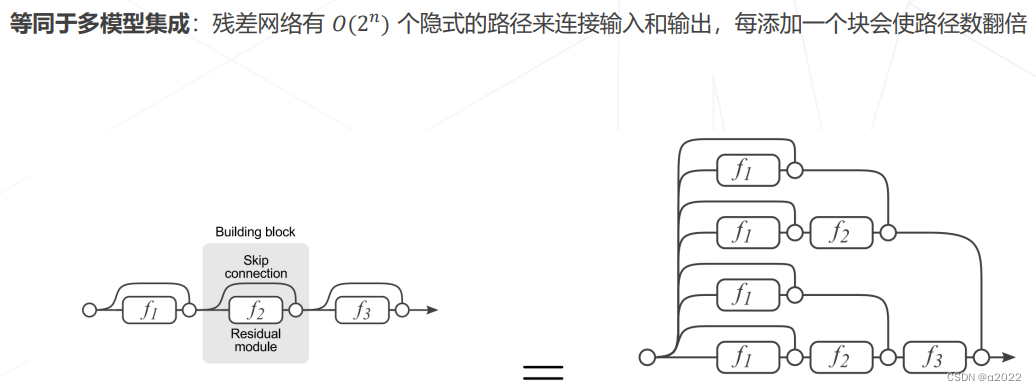

ResNet 是深浅模型的集成

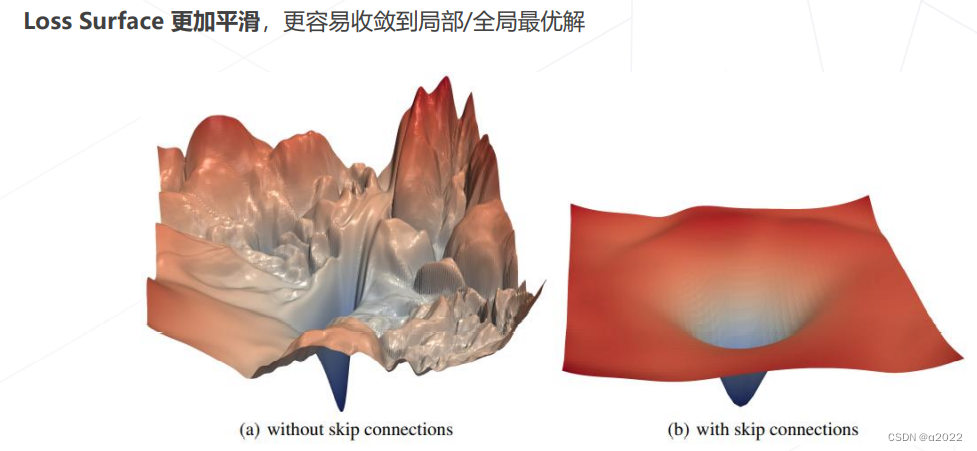

残差链接让损失曲面更平滑

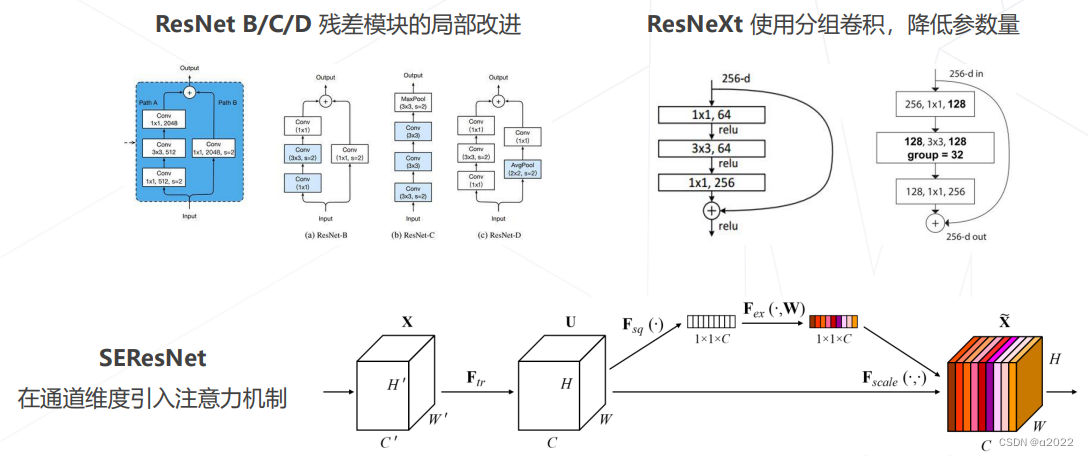

ResNet 的后续改进

三、更强的图像分类模型

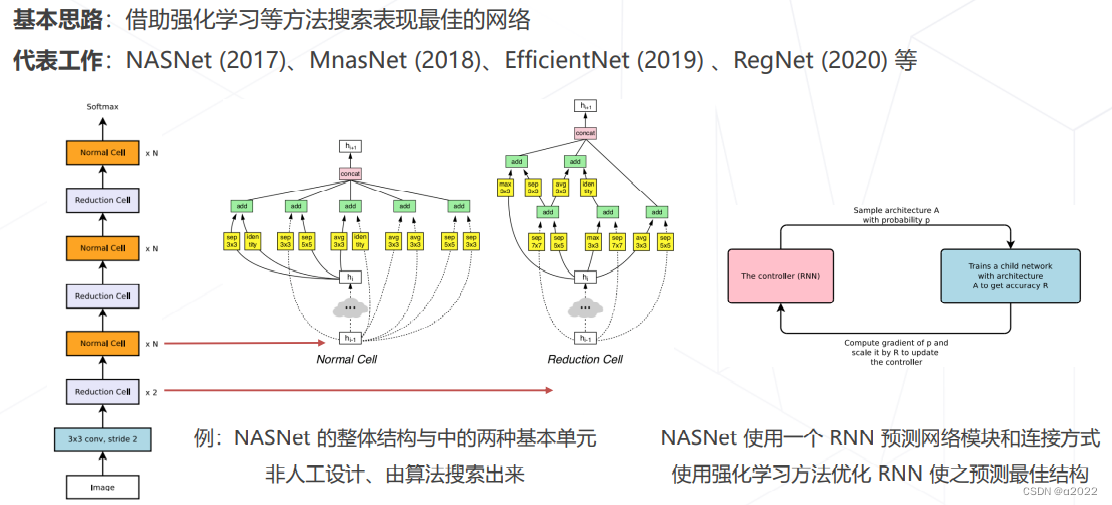

1、神经结构搜索 Neural Architecture Search (2016+)

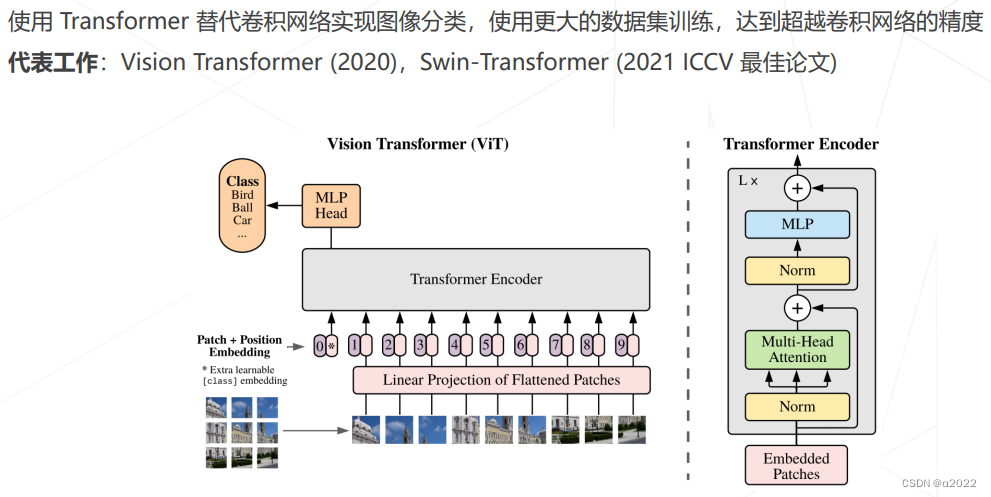

2、Vision Transformers (2020+)

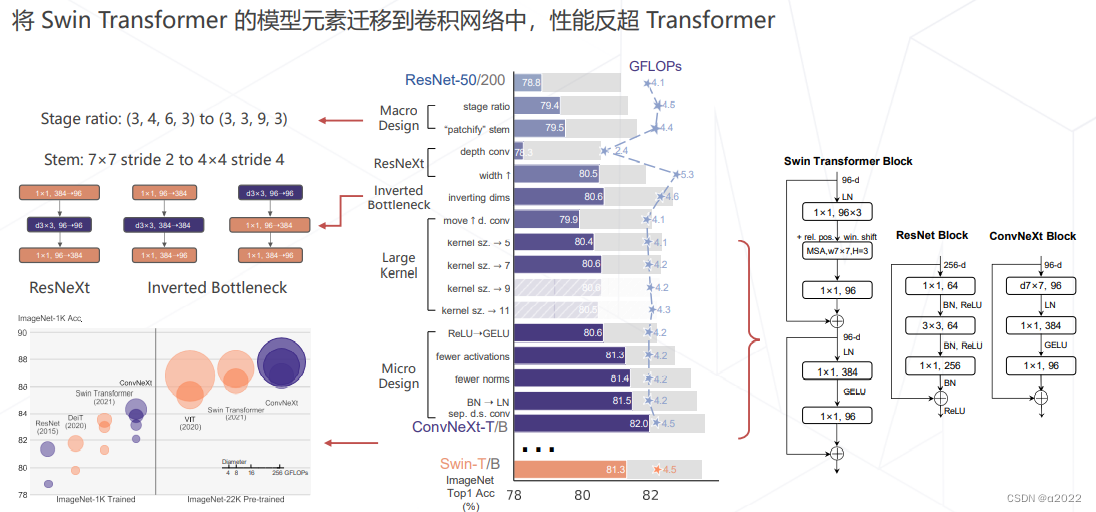

3、ConvNeXt (2022)

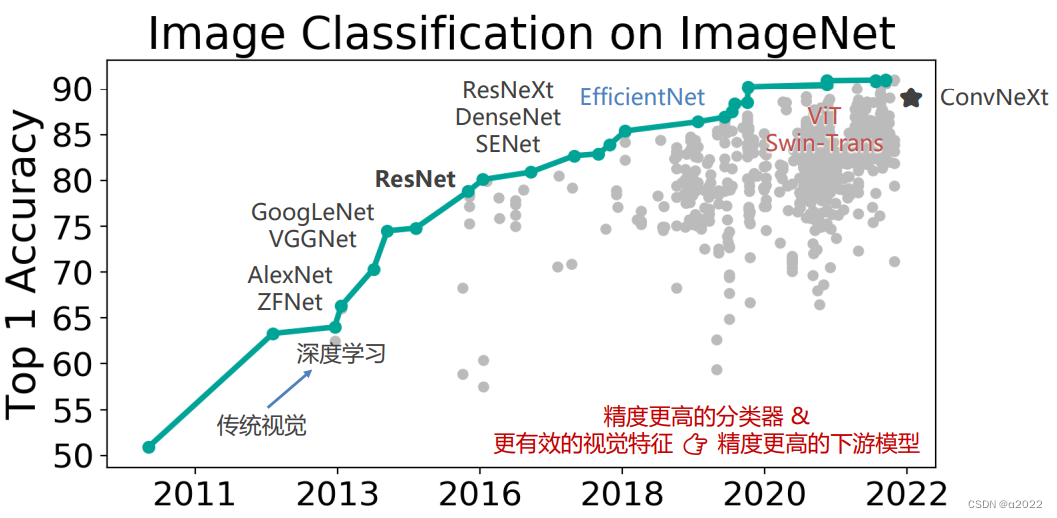

4、图像分类 & 视觉基础模型的发展

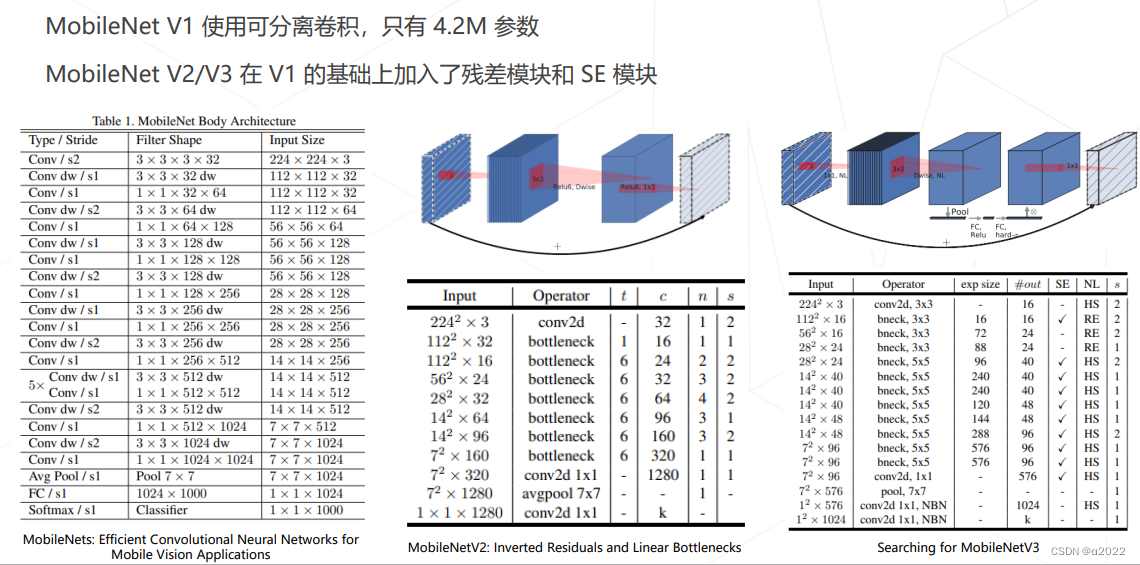

四、轻量化卷积神经网络

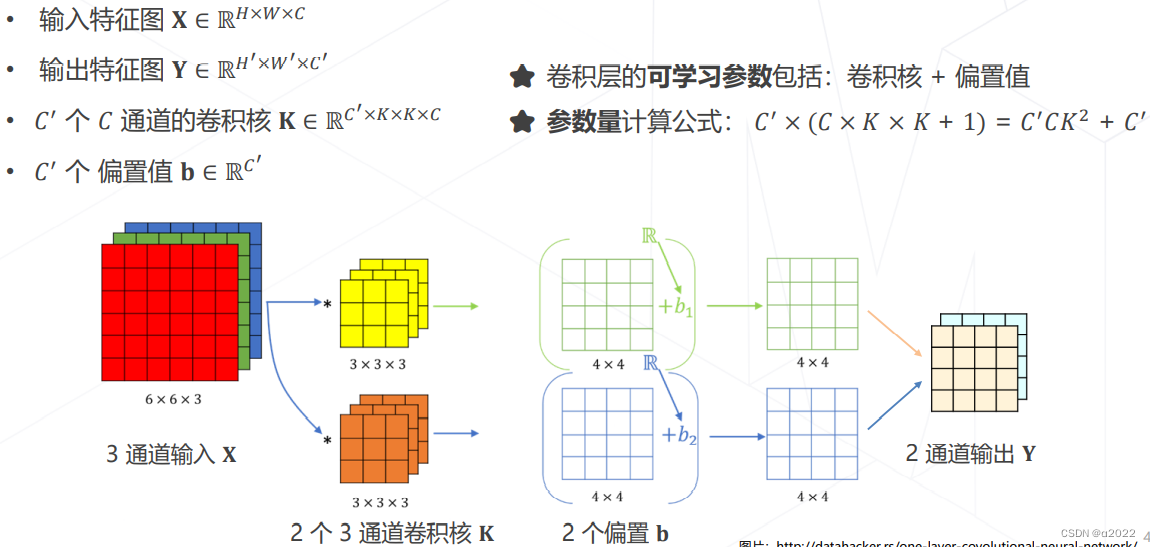

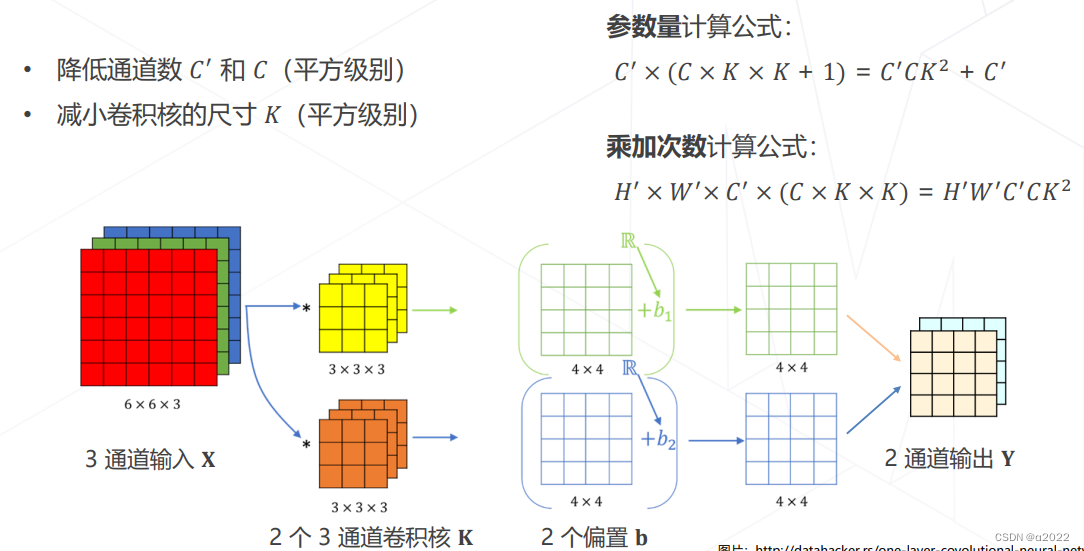

1、卷积的参数量

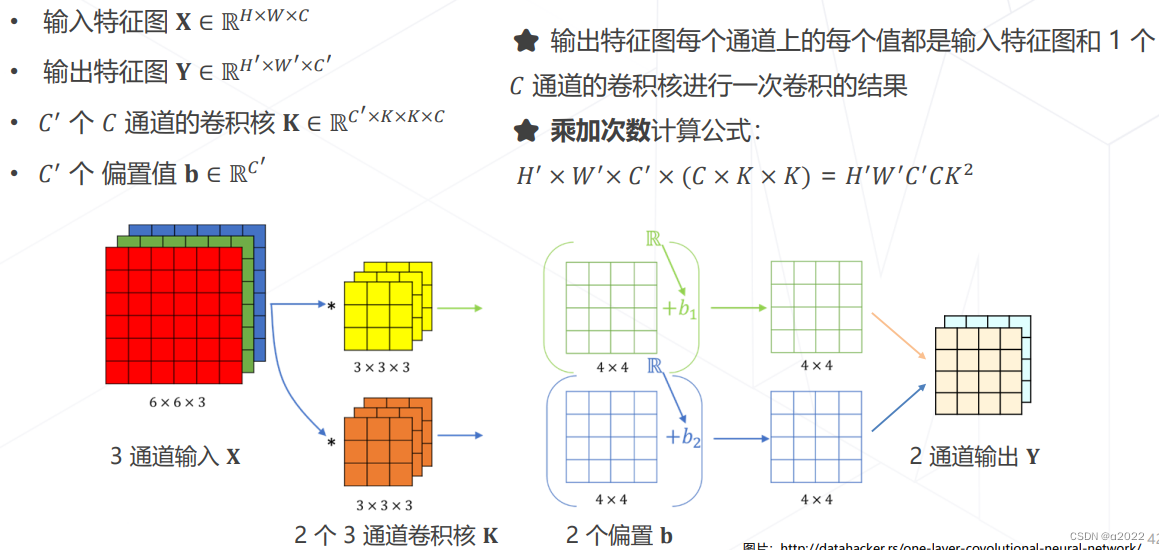

2、卷积的计算量(乘加次数)

3、降低模型参数量和计算量的方法

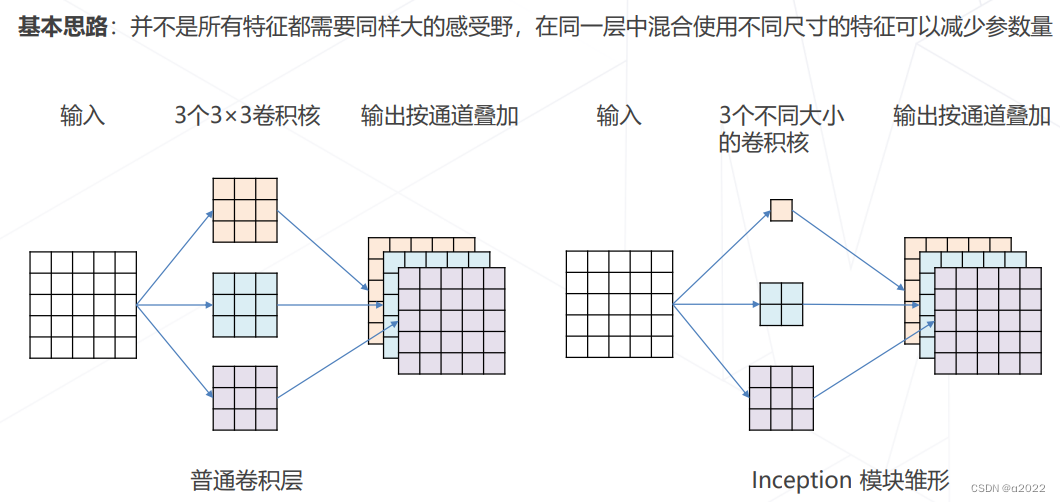

4、GoogLeNet 使用不同大小的卷积核

5、ResNet 使用1×1卷积压缩通道数

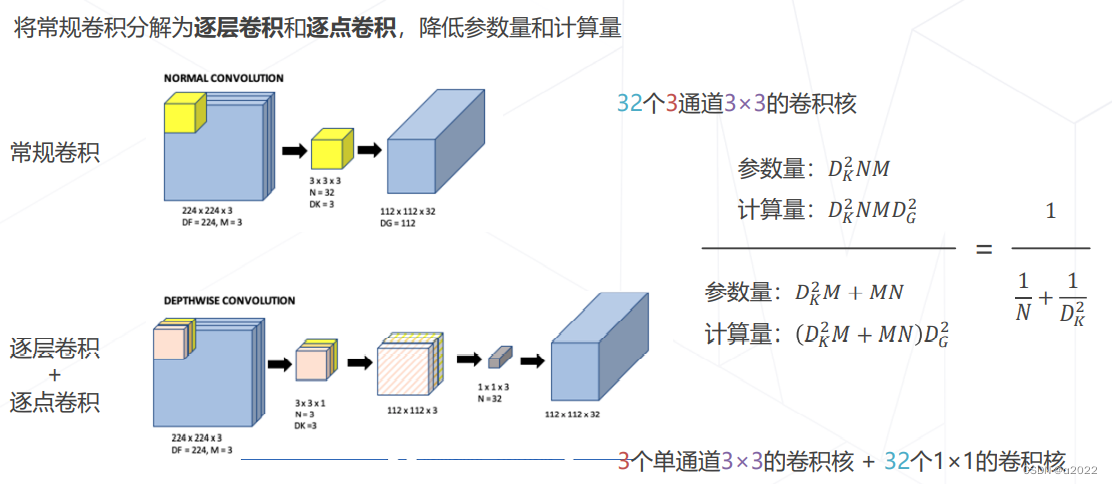

6、可分离卷积

7、MobileNet V1/V2/V3 (2017~2019)

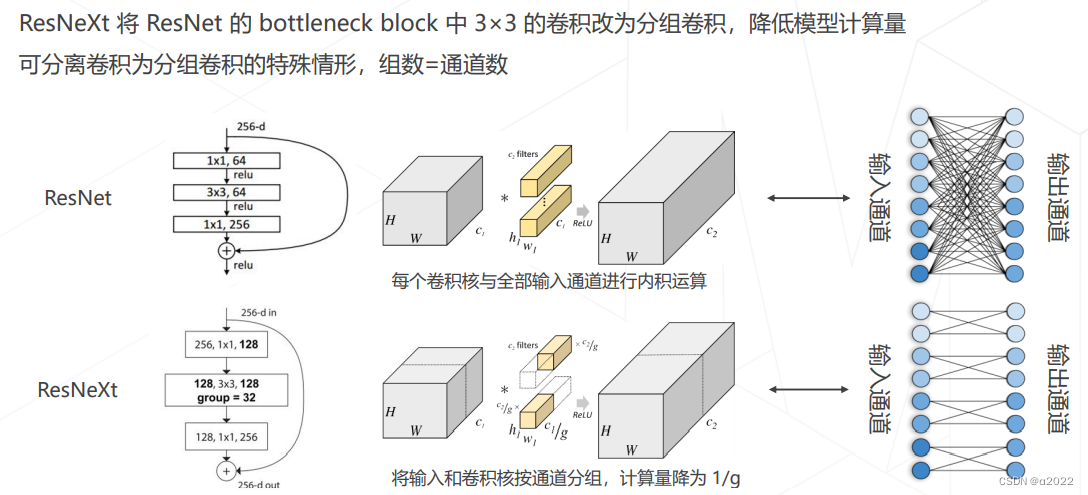

8、ResNeXt 中的分组卷积

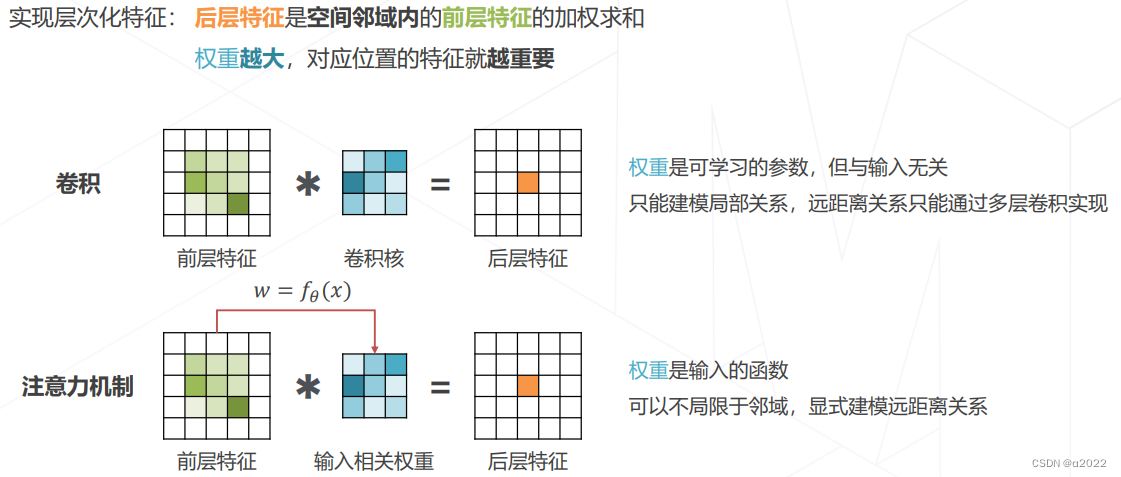

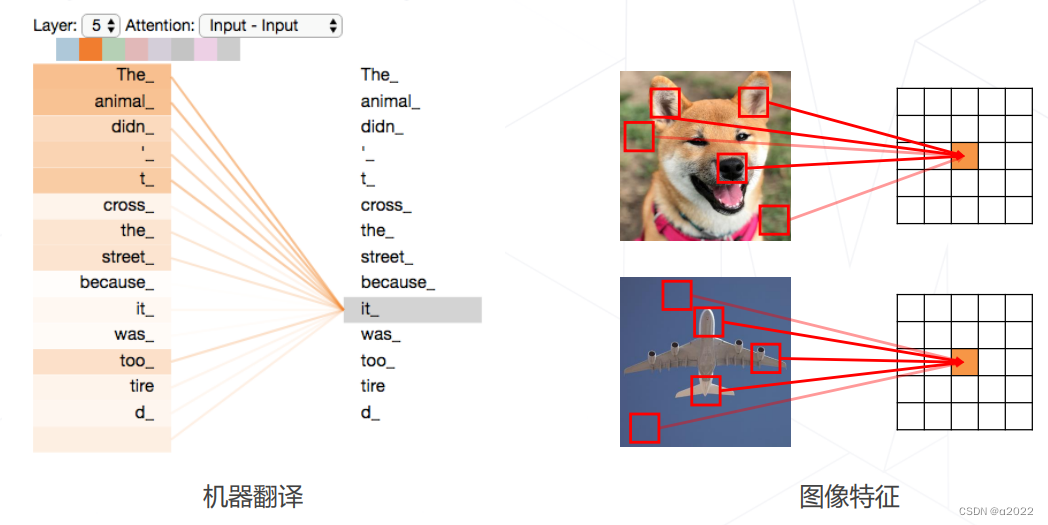

五、Vision Transformers

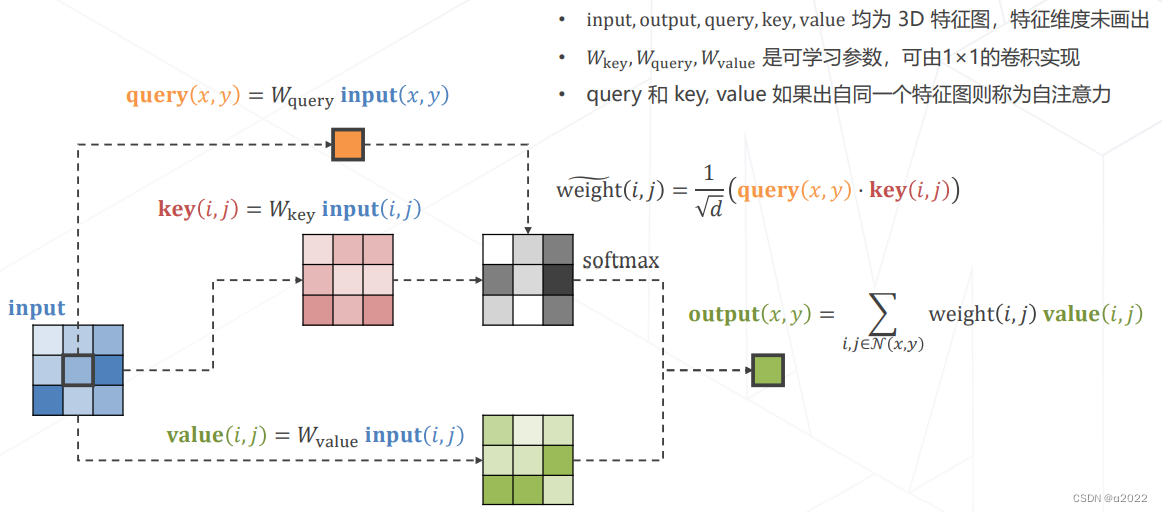

1、注意力机制 Attention Mechanism

Why Attention?

实现 Attention

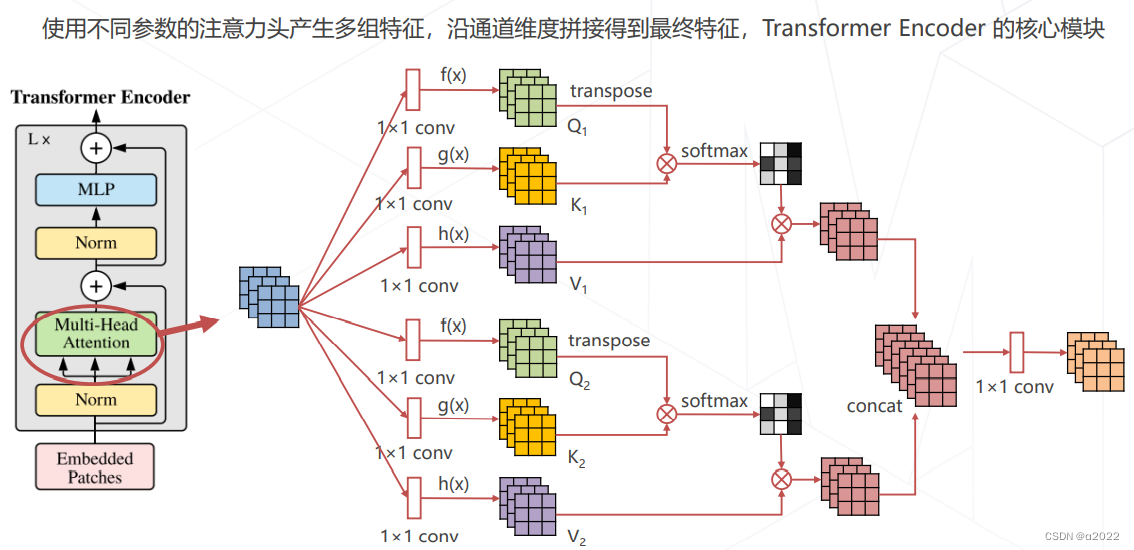

多头注意力 Multi-head (Self-)Attention

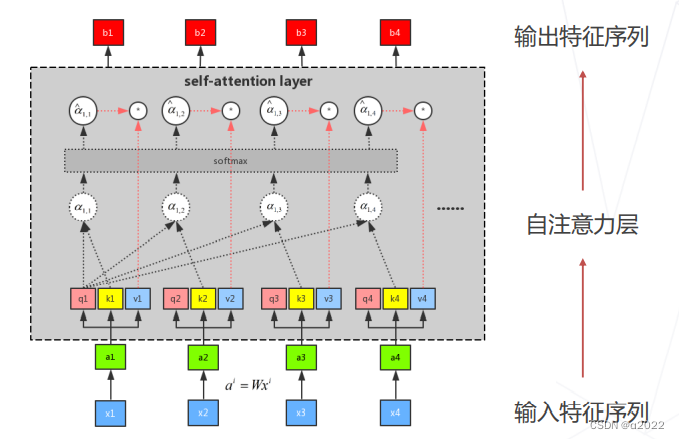

1D 数据上的 Attention

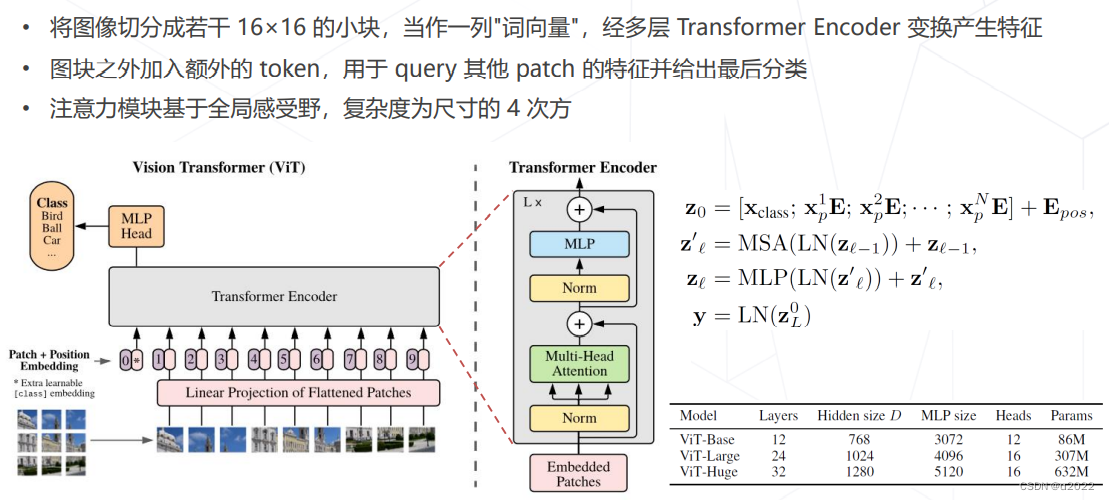

2、Vision Transformer (2020)

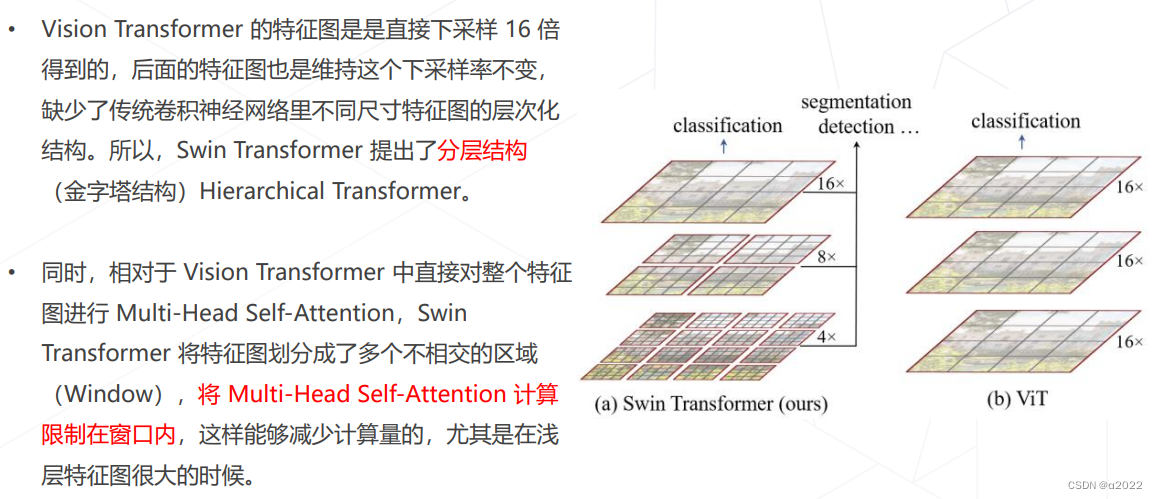

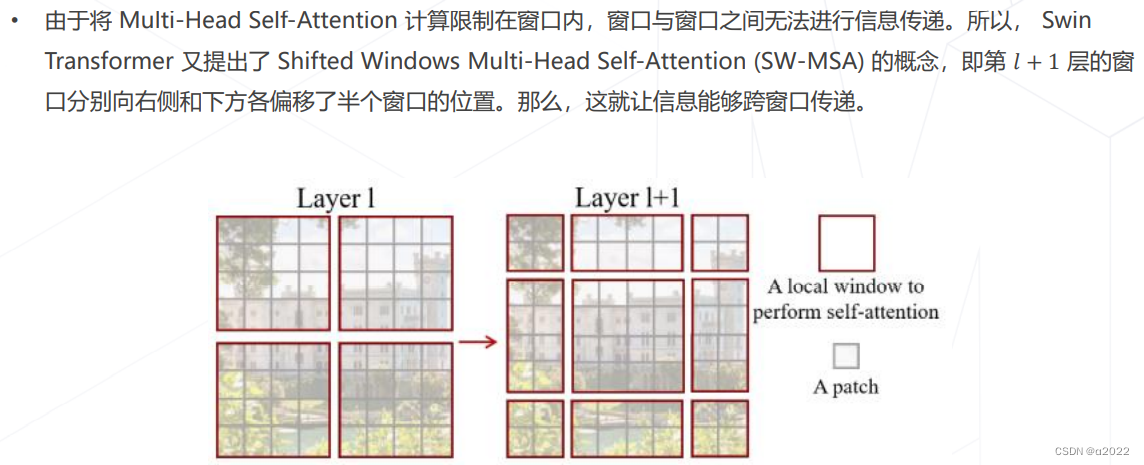

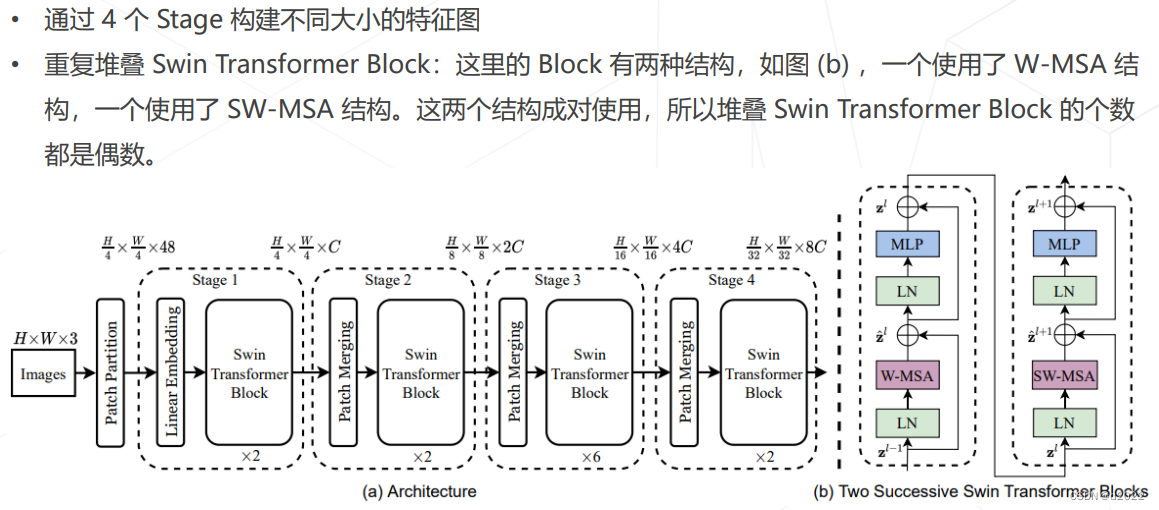

3、Swin Transformer (ICCV 2021 best paper)

六、模型学习

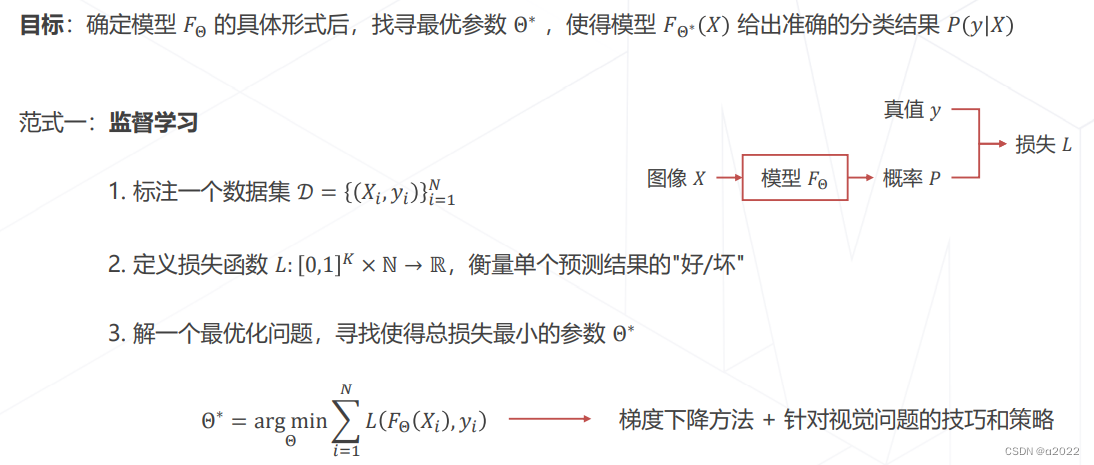

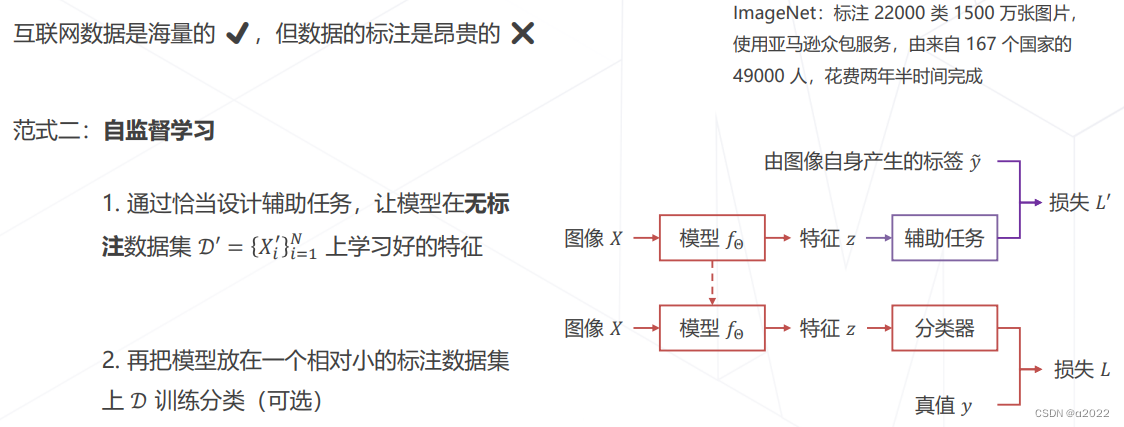

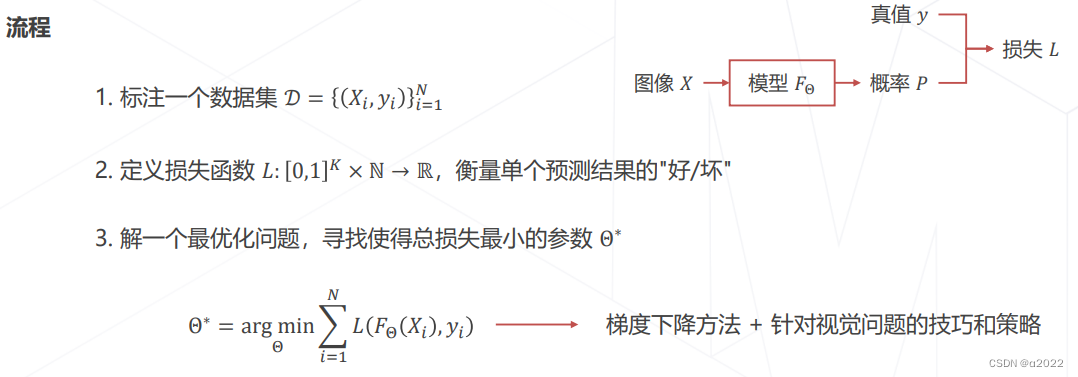

1、模型学习的范式

监督学习

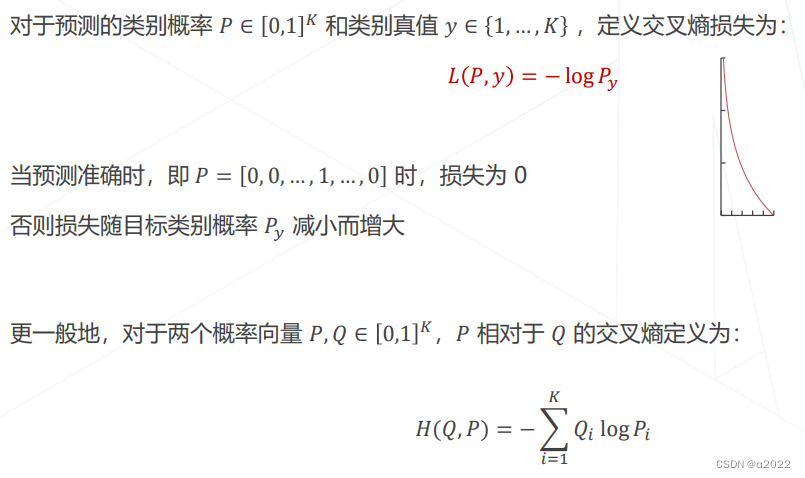

2、交叉熵损失 Cross-Entropy Loss

3、优化目标 & 随机梯度下降

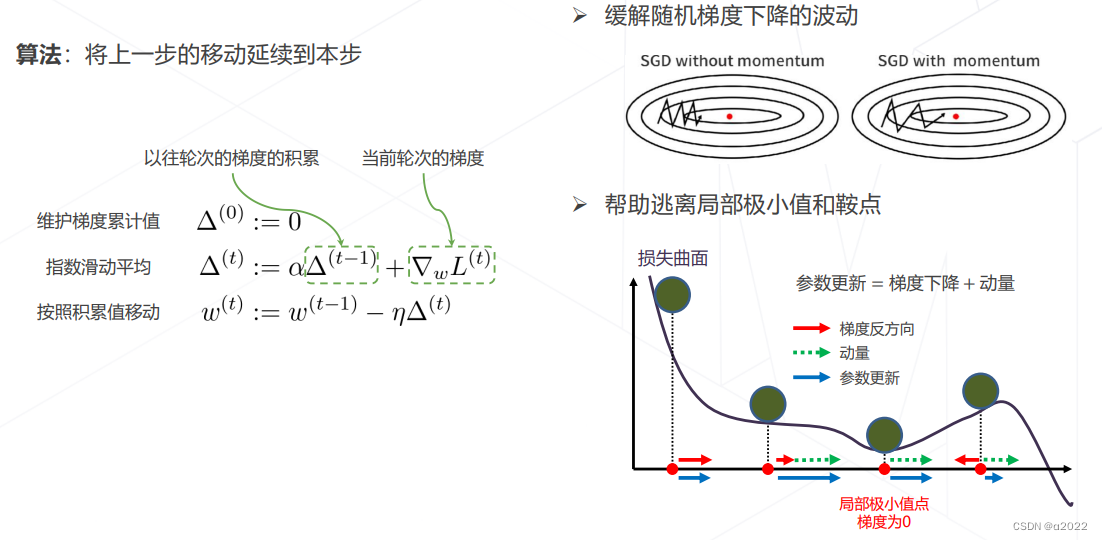

4、动量 Momentum SGD

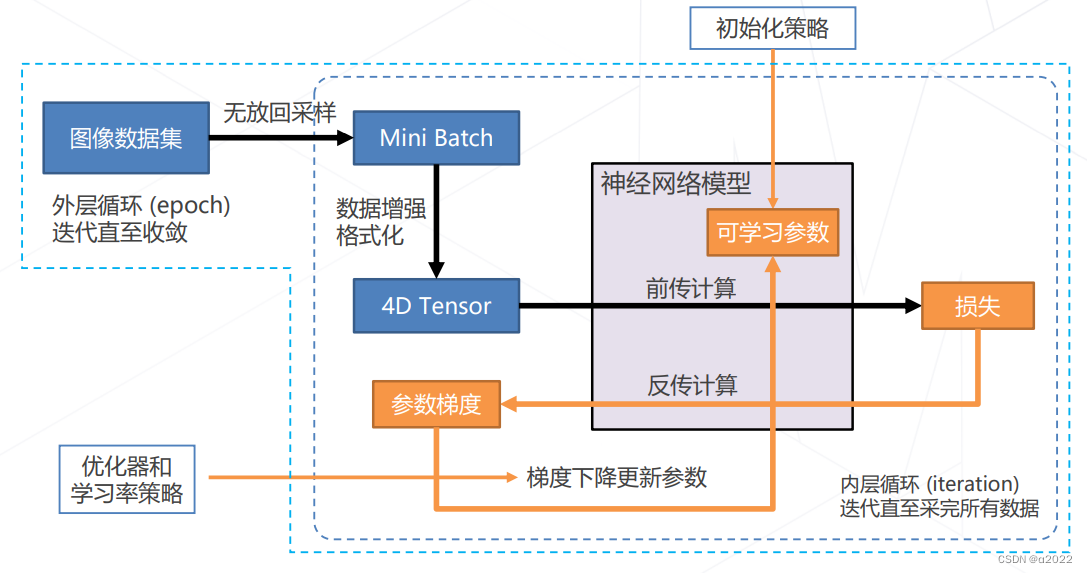

5、基于梯度下降训练神经网络的整体流程

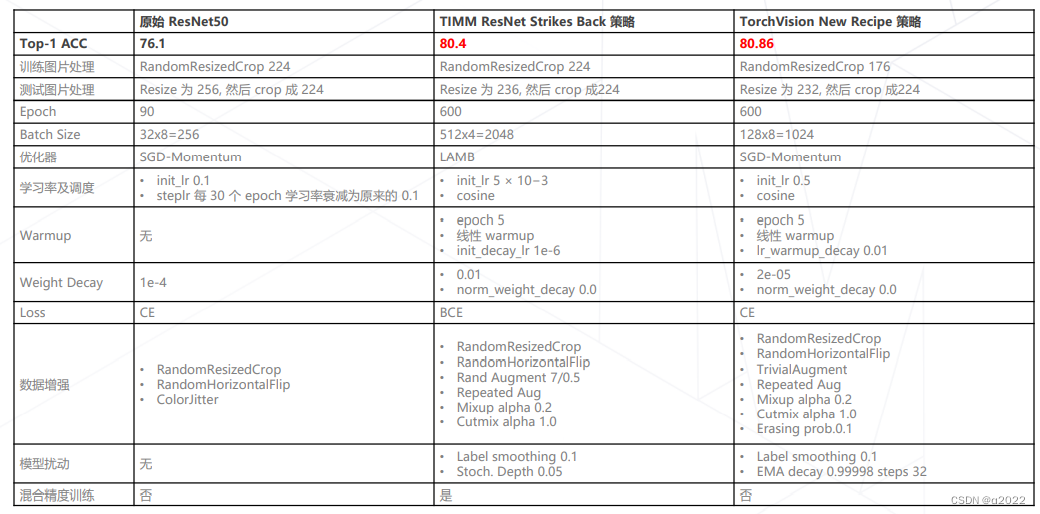

6、训练技巧的重要性

七、学习率与优化器策略

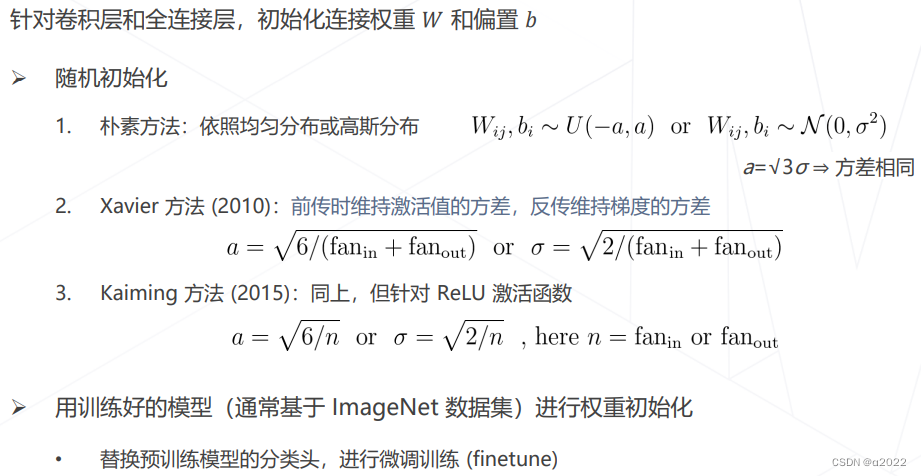

1、权重初始化

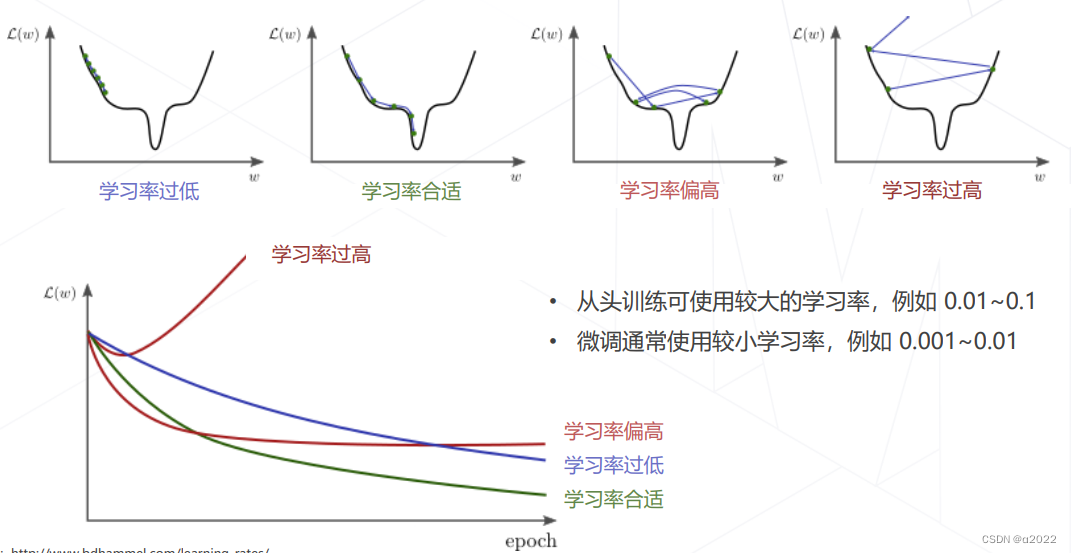

2、学习率对训练的影响

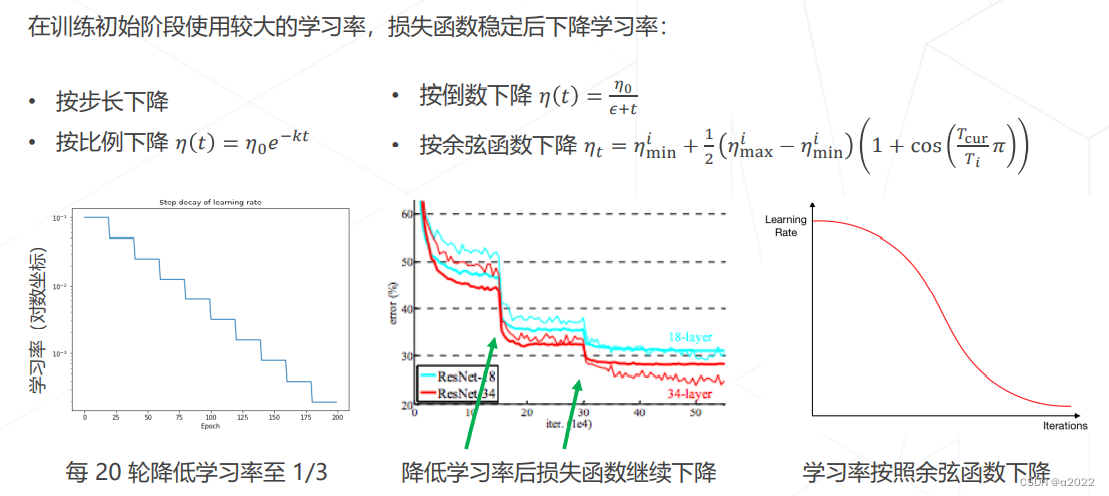

3、学习率策略:学习率退火 Annealing

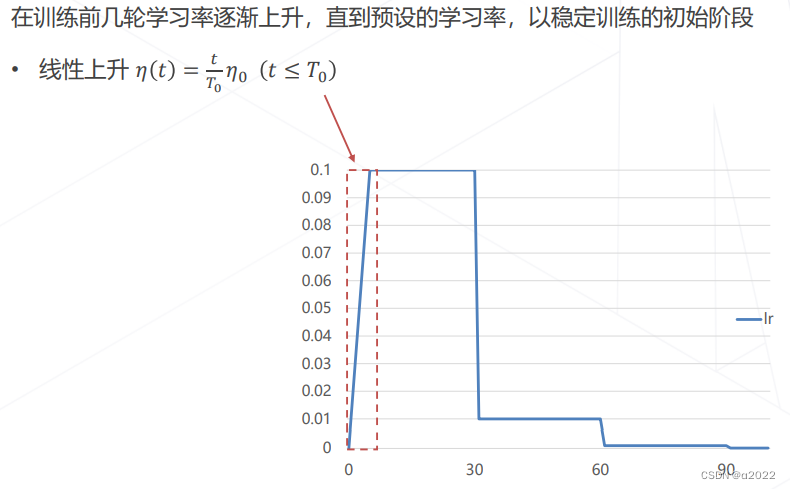

4、学习率策略:学习率升温 Warmup

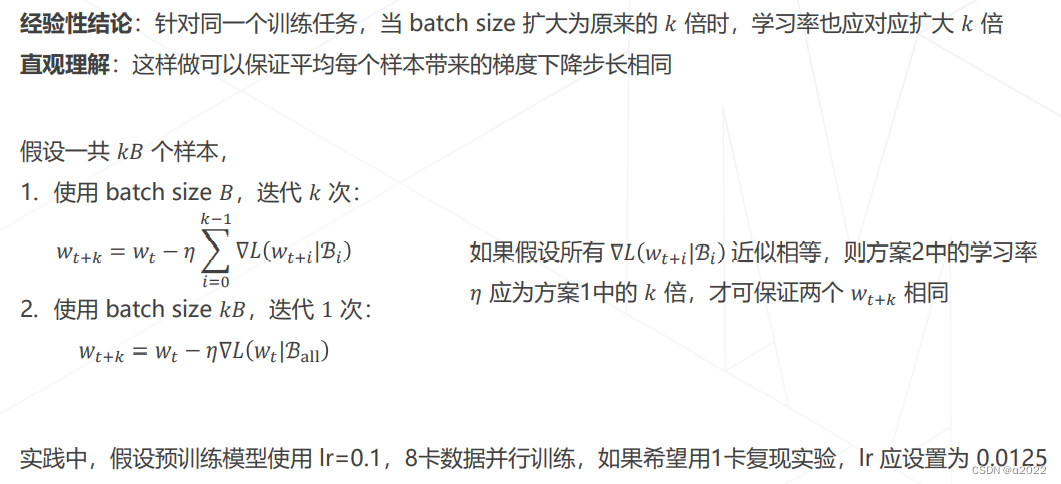

5、Linear Scaling Rule

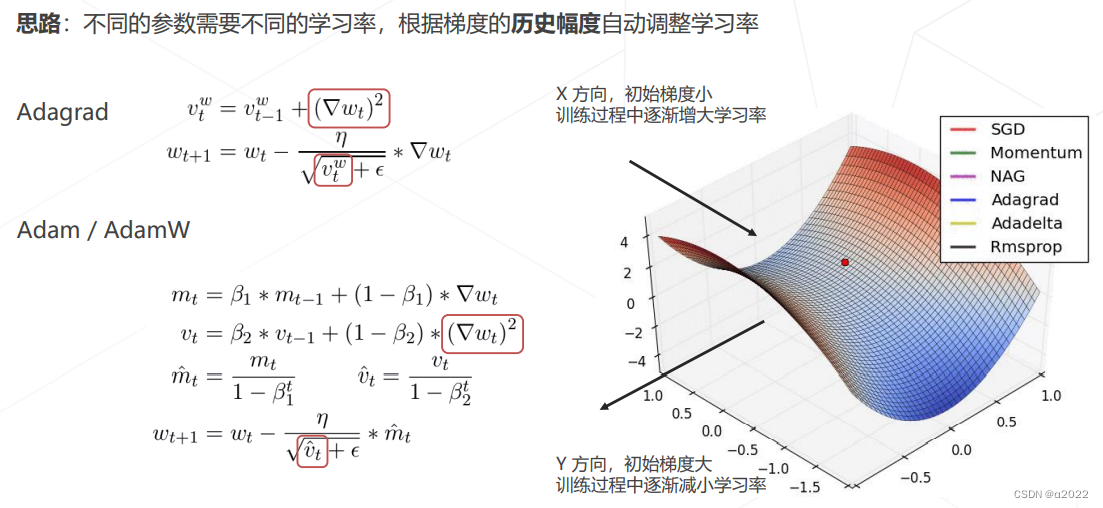

6、自适应梯度算法

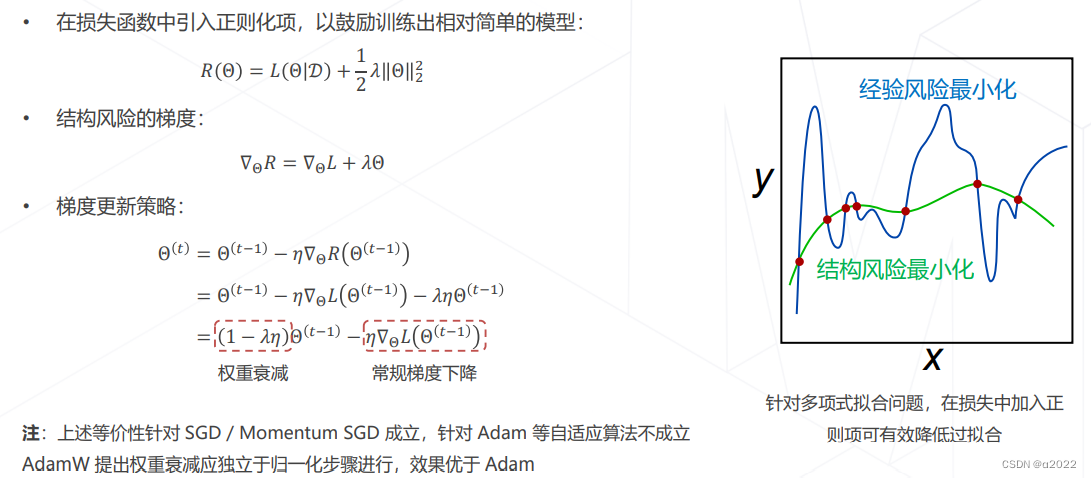

7、正则化与权重衰减 Weight Decay

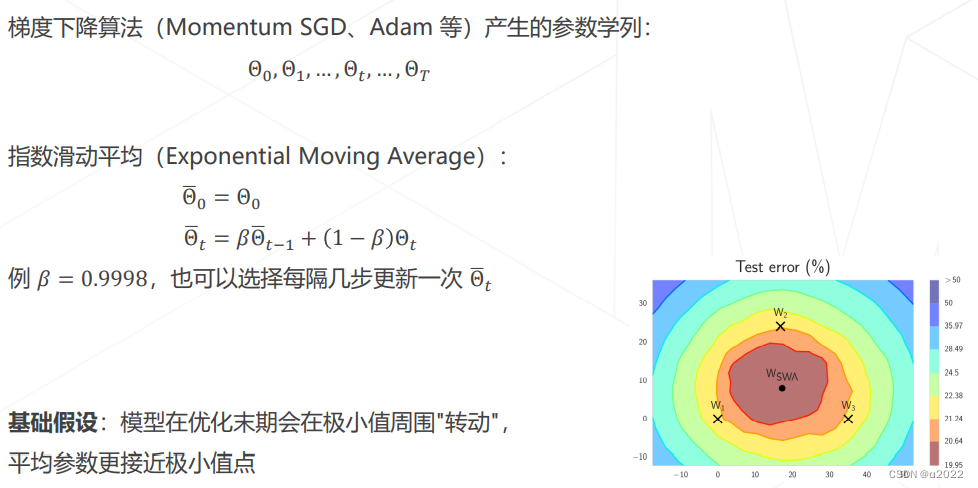

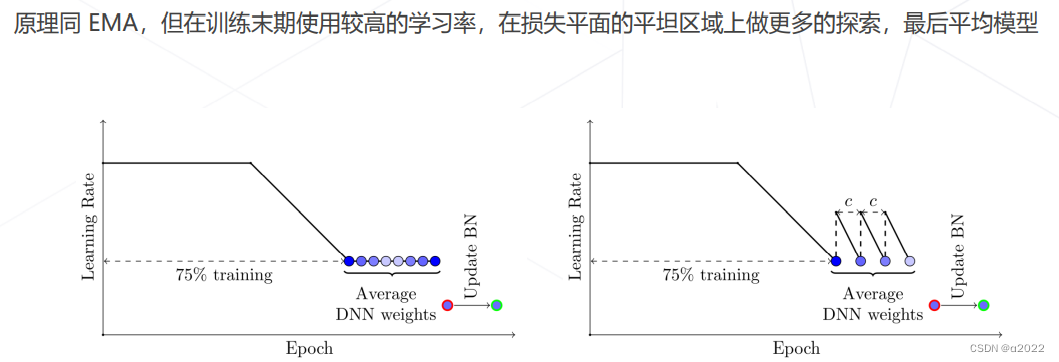

8、模型权重平均 EMA

八、数据增强

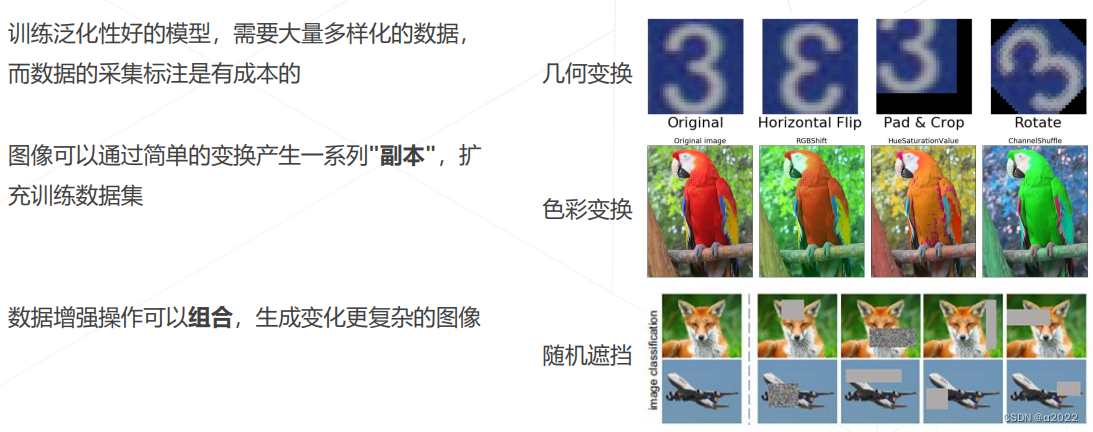

1、数据增强 Data Augmentation

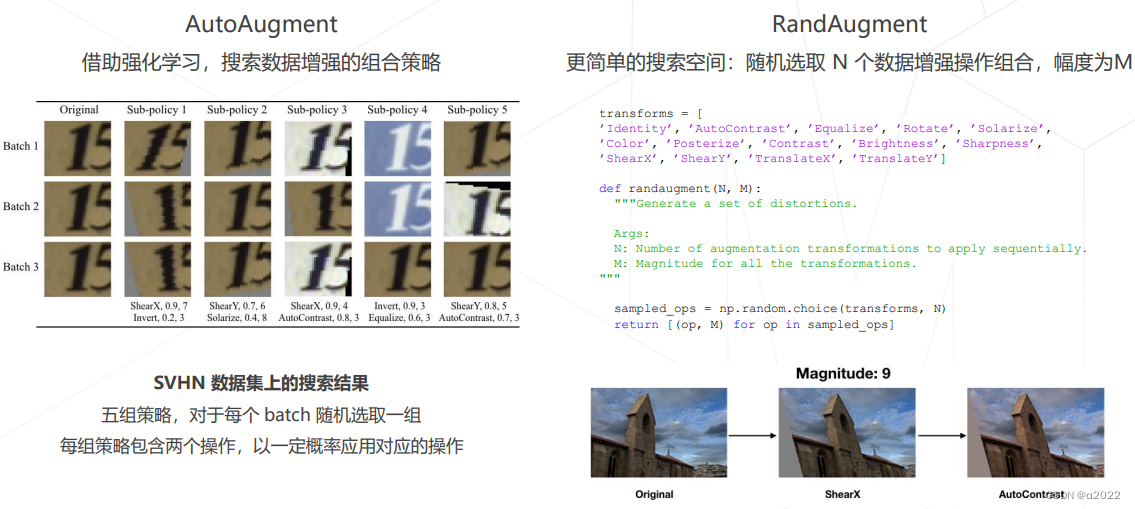

2、组合数据增强 AutoAugment & RandAugment

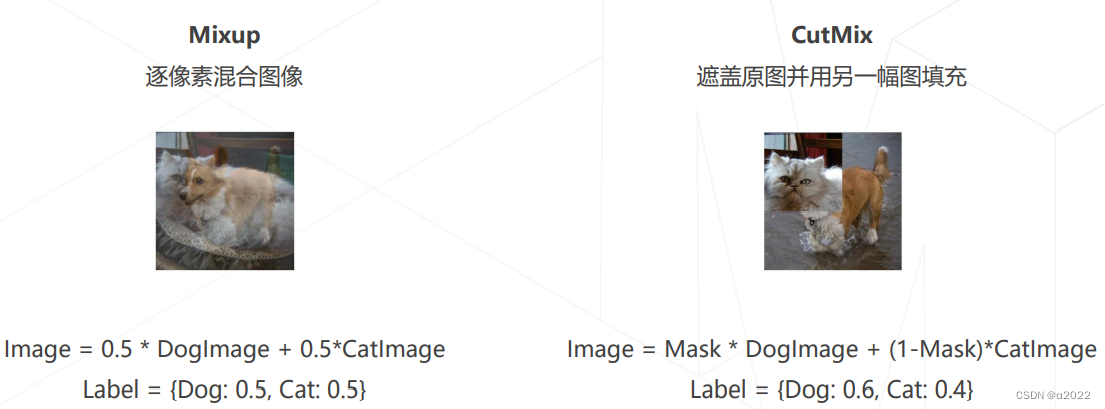

3、组合图像 Mixup & CutMix

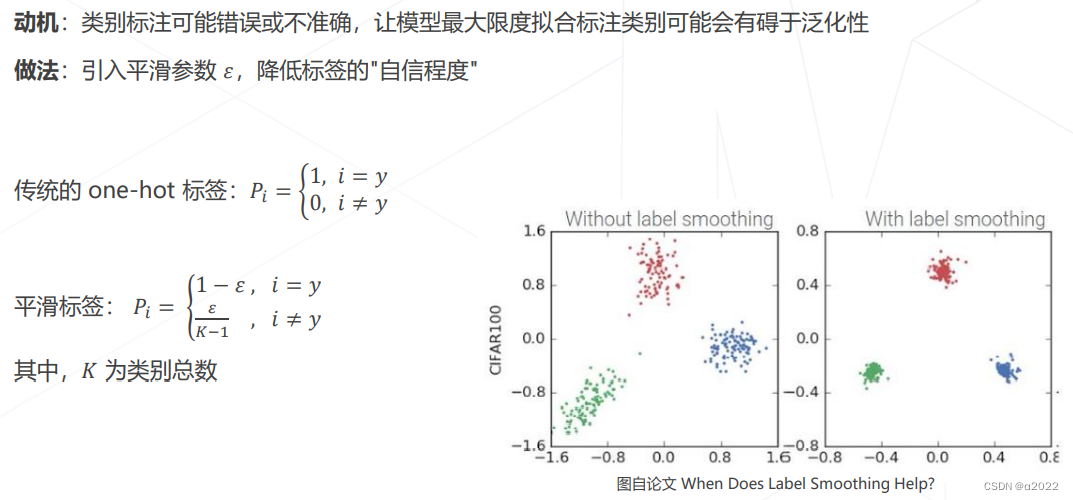

4、标签平滑 Label Smoothing

九、模型相关策略

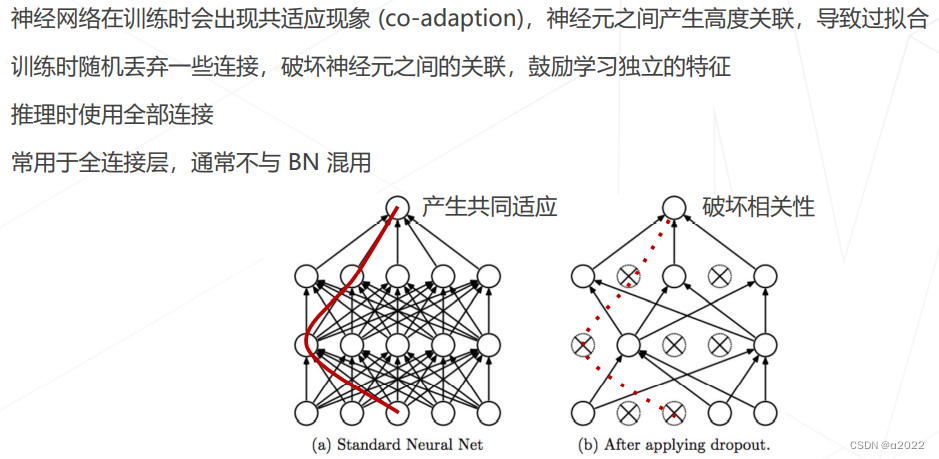

1、丢弃层 Dropout

2、随机深度 Stochastic Depth

十、自监督学习

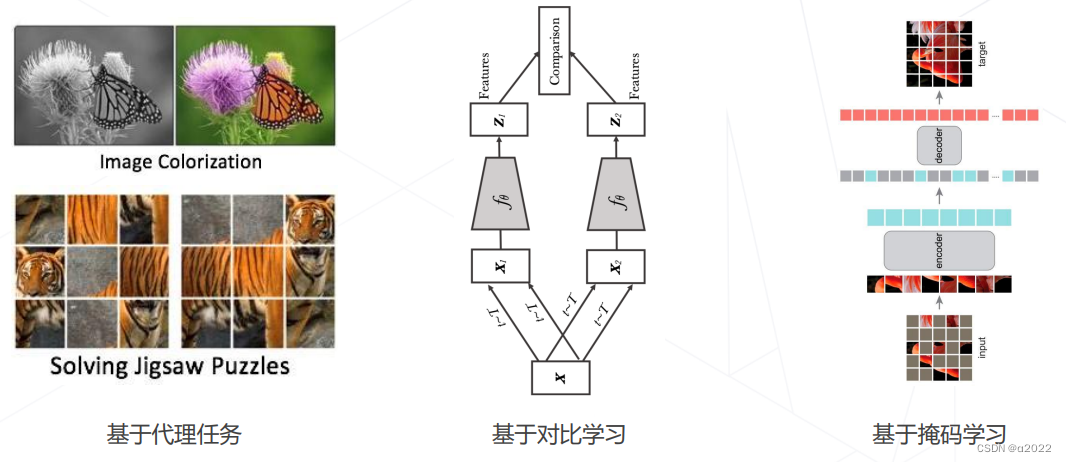

1、自监督学习的常见类型

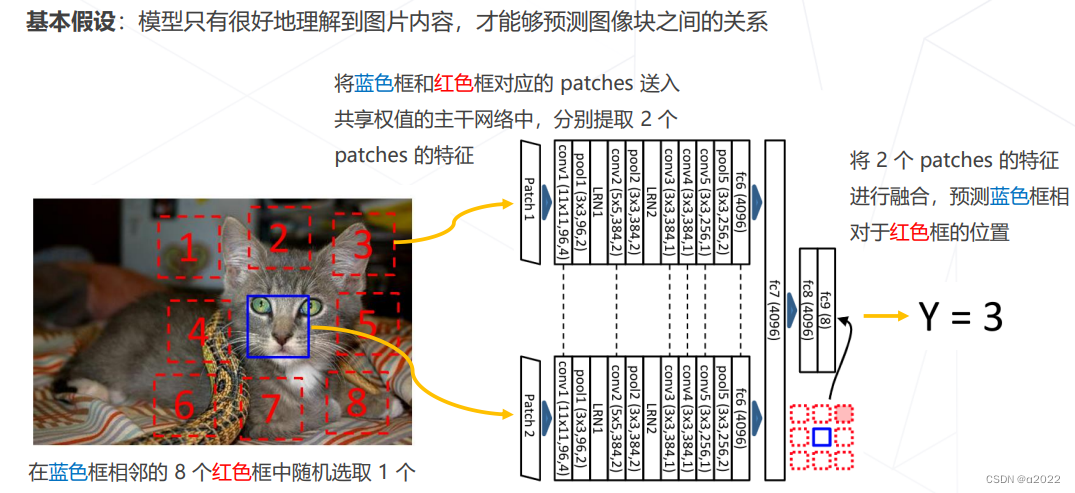

2、Relative Location (ICCV 2015)

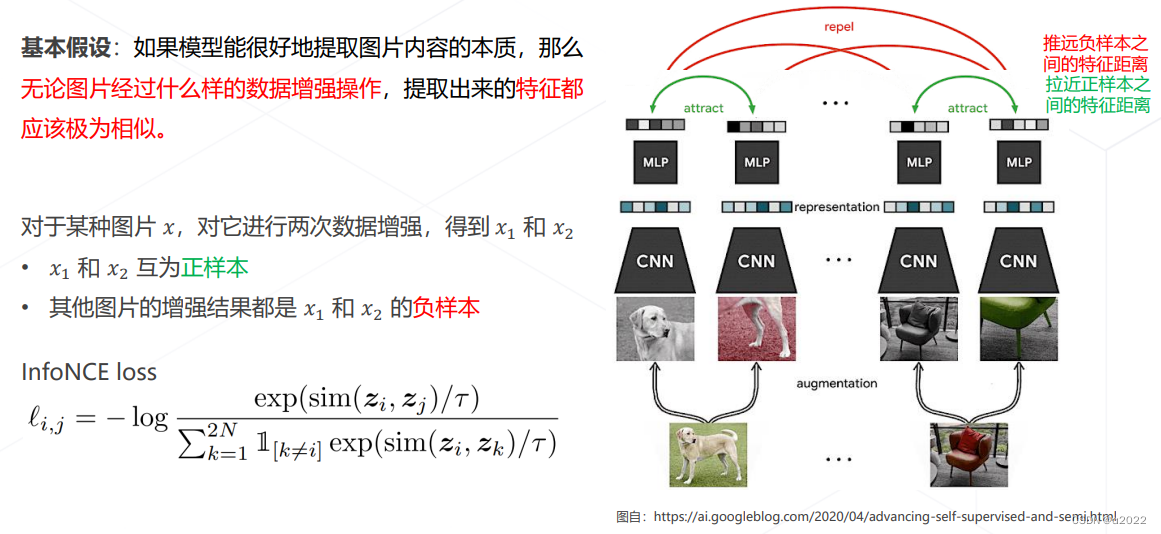

3、SimCLR (ICML 2020)

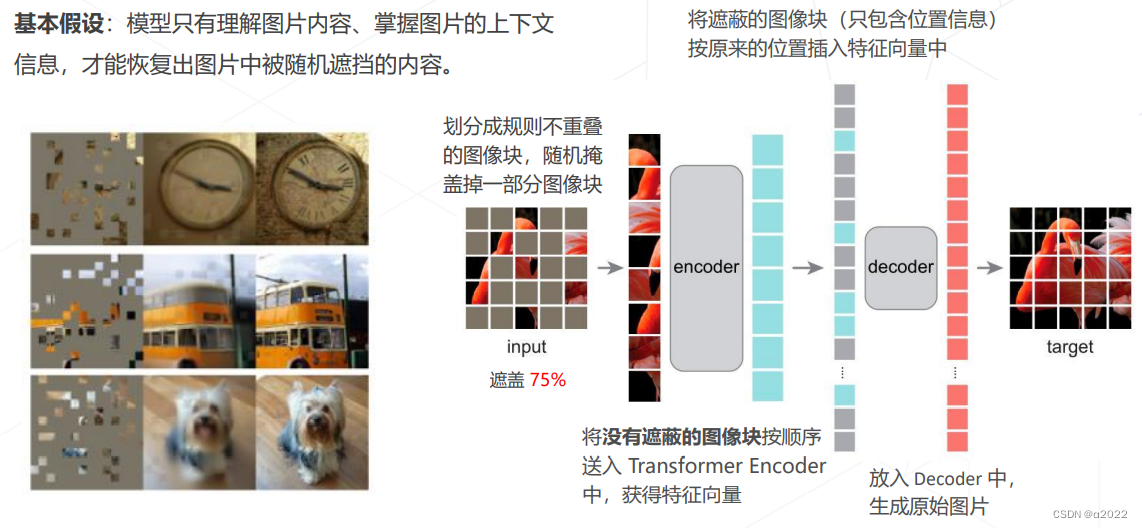

4、Masked autoencoders (MAE, CVPR 2022)

十一、总结

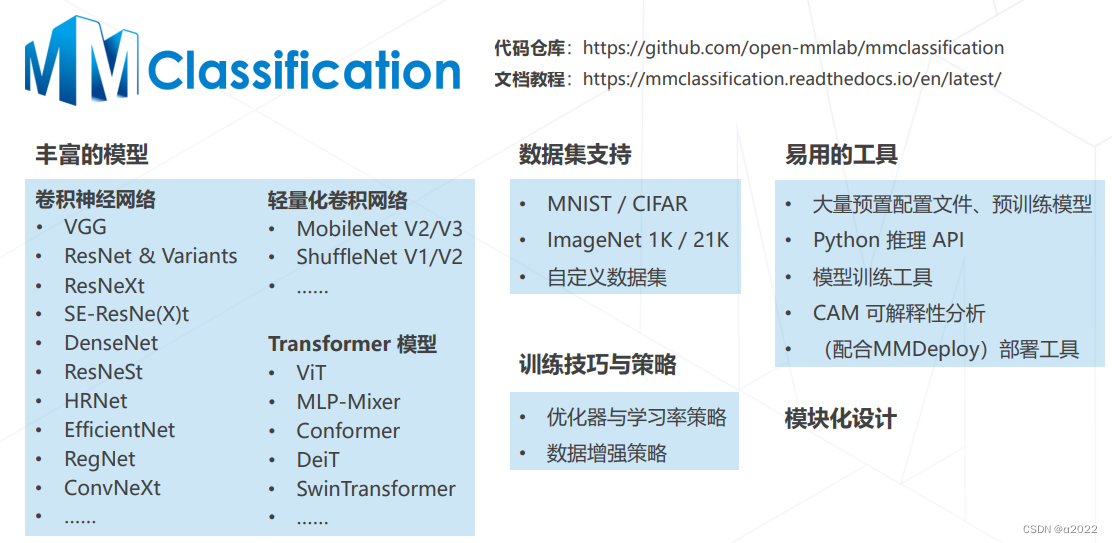

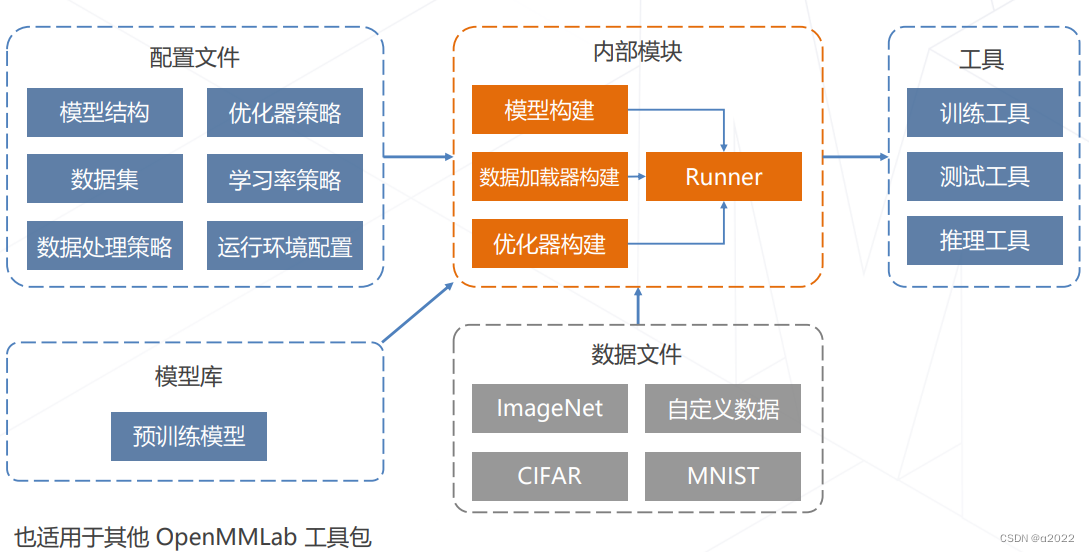

十二、MMClassification 介绍

代码仓库:https://github.com/open-mmlab/mmclassification

文档教程:https://mmclassification.readthedocs.io/en/latest/

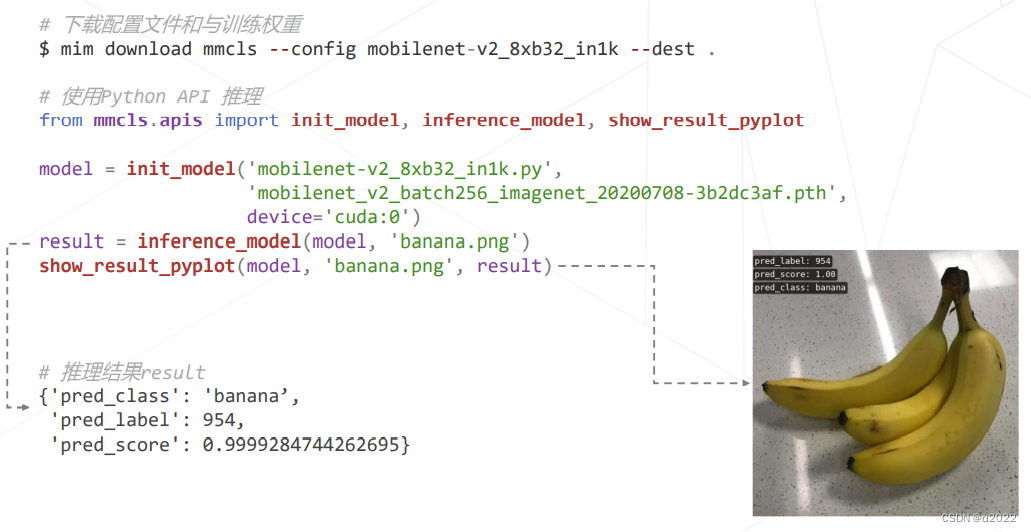

1、Python 推理 API

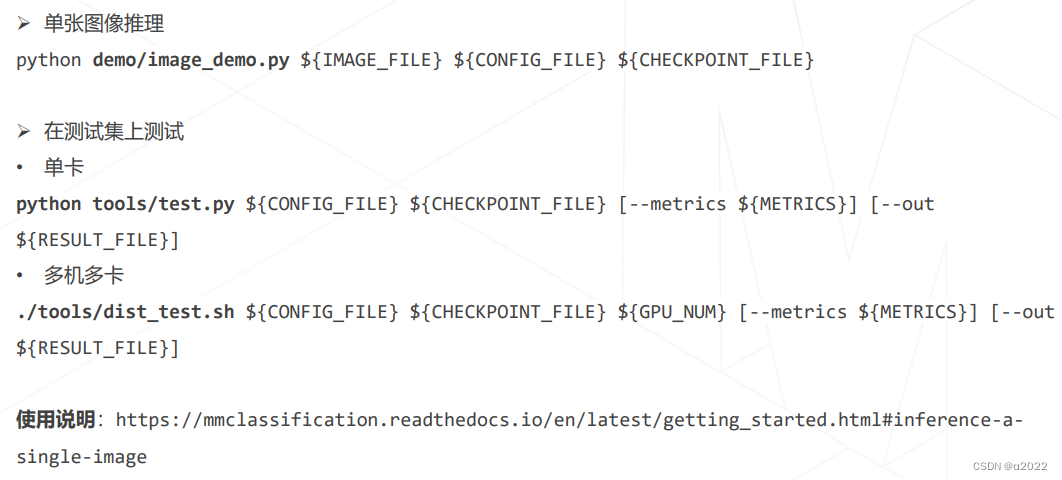

2、推理工具(需源码安装)

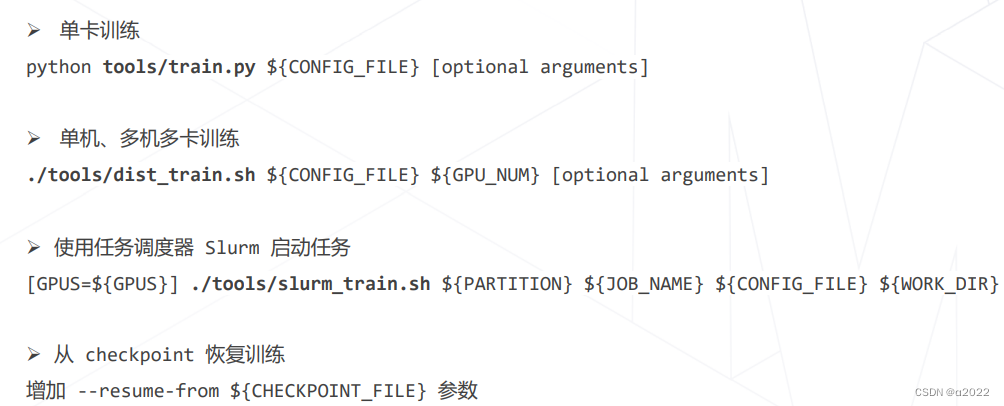

3、训练工具(需源码安装)

使用说明:https://mmclassification.readthedocs.io/en/latest/getting_started.html#train-a-model

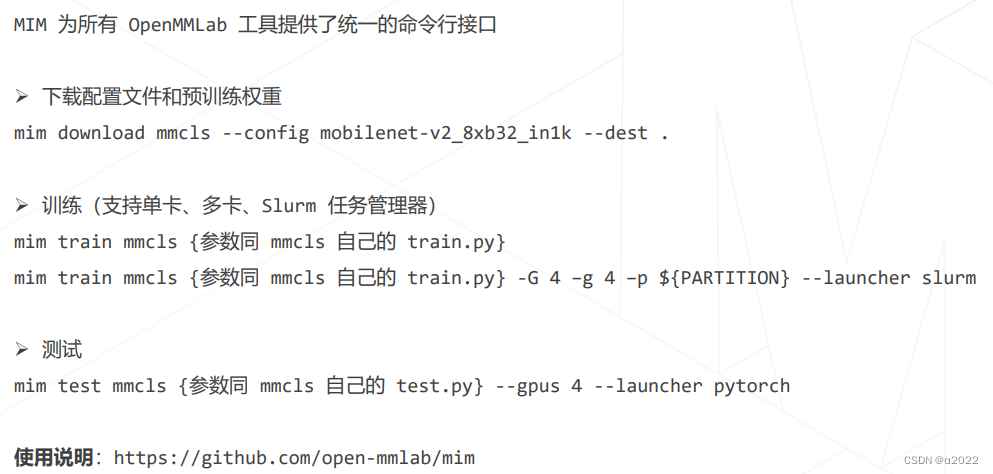

4、使用 MIM 工具实现训练和测试

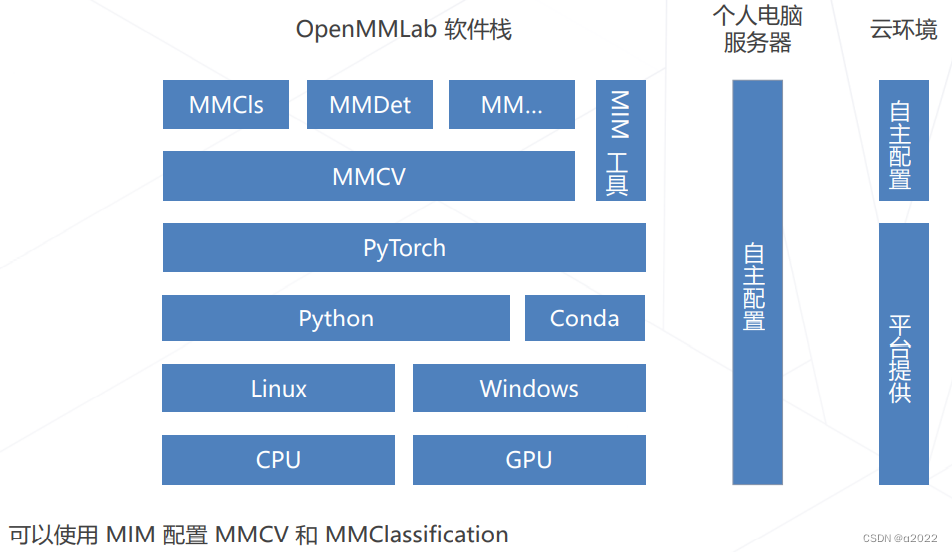

5、环境搭建

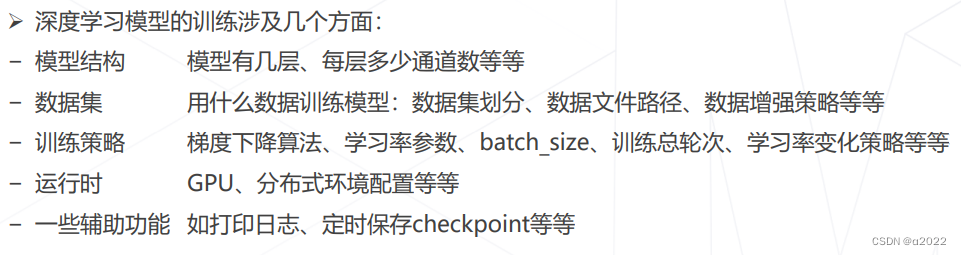

6、OpenMMLab 项目中的重要概念——配置文件

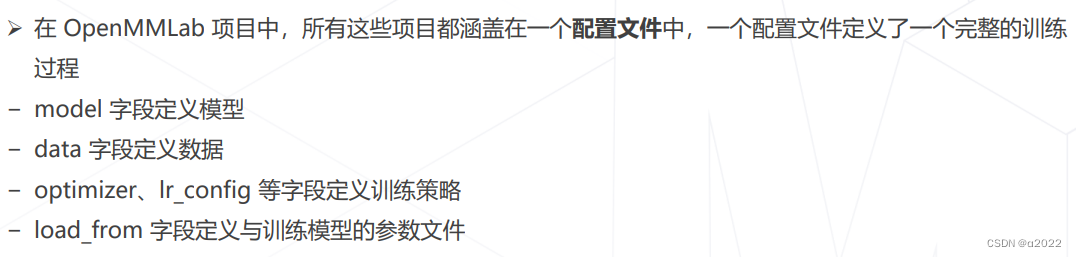

7、OpenMMLab 项目中的重要概念——配置文件

8、配置文件的运作方式

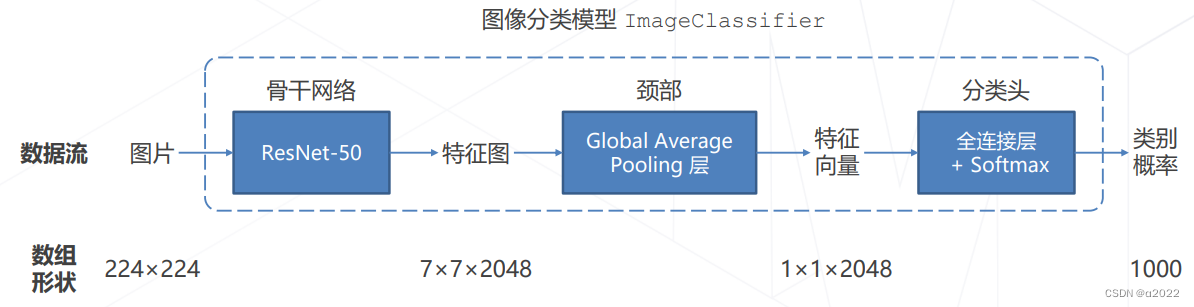

9、图像分类模型的构成

10、图像分类模型构建

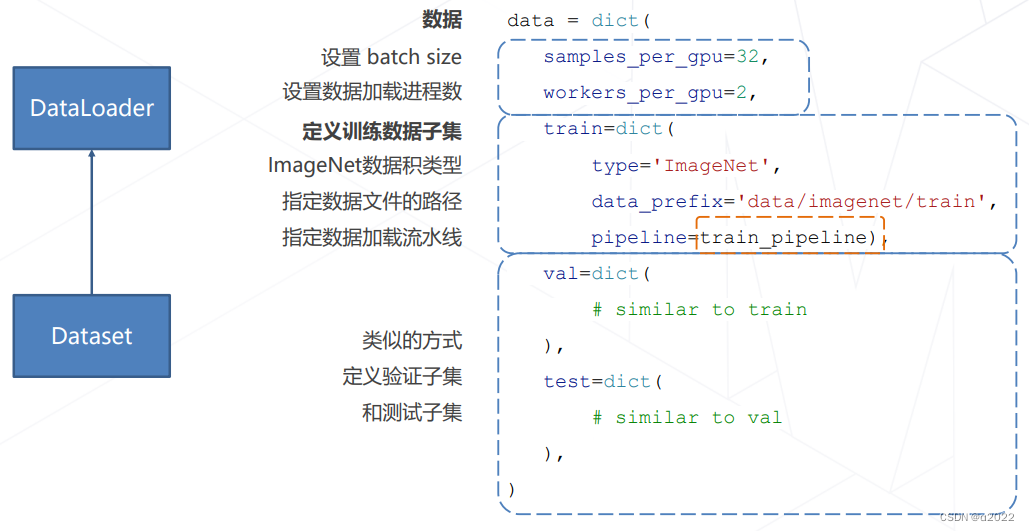

11、数据集构建

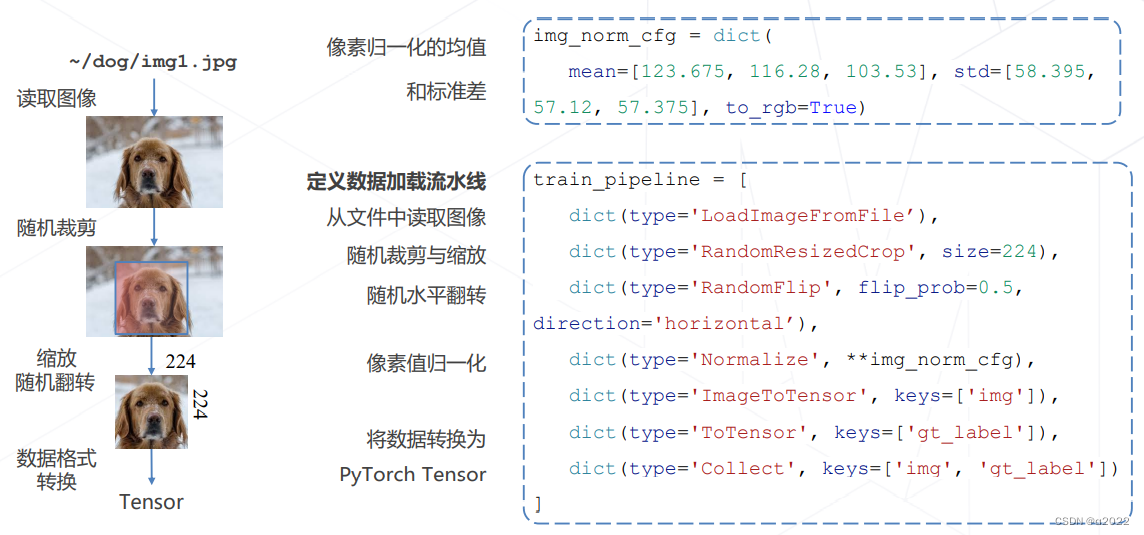

12、定义数据加载流水线

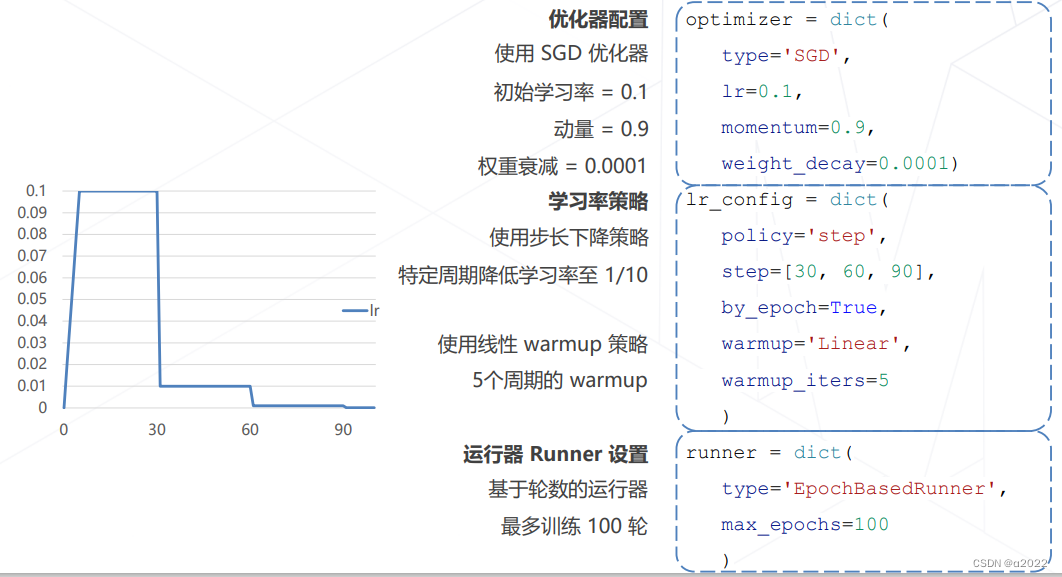

13、配置学习策略

3022

3022

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?