1 介绍

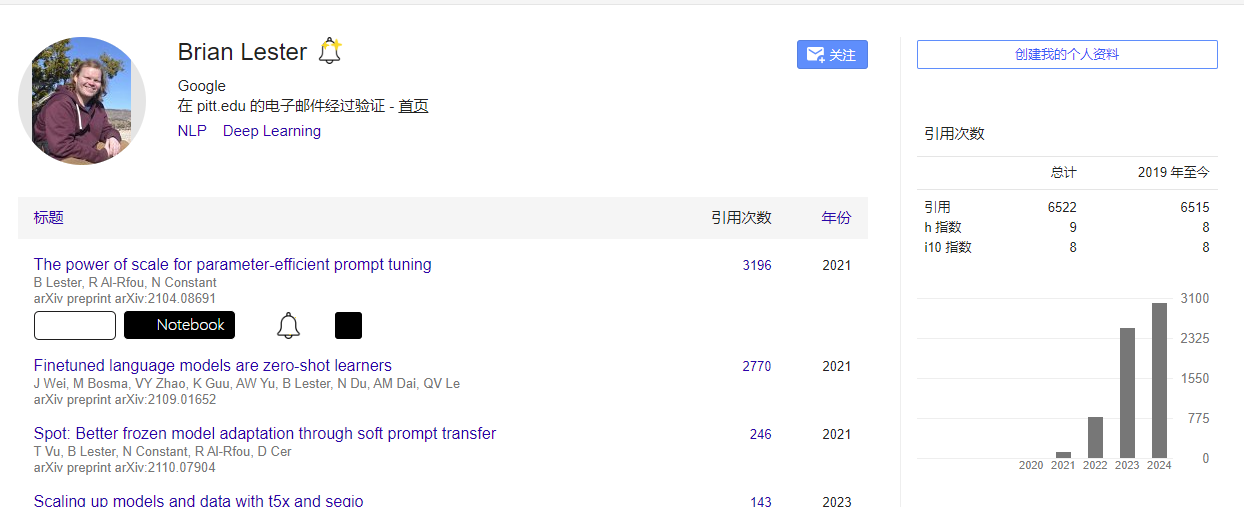

年份:2021

期刊: arXiv preprint

引用量:3196

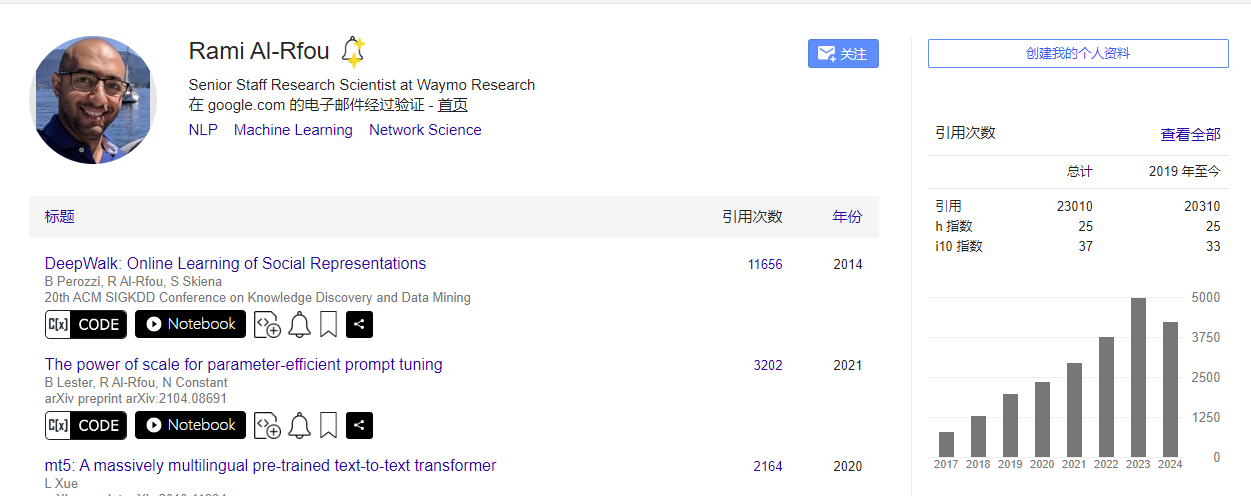

Lester B, Al-Rfou R, Constant N. The power of scale for parameter-efficient prompt tuning[J]. arXiv preprint arXiv:2104.08691, 2021.

本文介绍了一种名为“prompt tuning”的算法,它通过在学习过程中优化(调整)少量的“软提示”(soft prompts),来调整冻结的语言模型,使其能够执行特定的下游任务。这种方法在大规模模型上的效果与全模型微调(model tuning)相当,同时显著减少了需要调整的参数数量。

2 创新点

- Prompt Tuning方法:提出了一种新的参数高效的方法,通过学习“软提示”(soft prompts)来调整冻结的语言模型,使其能够适应特定的下游任务。

- 与模型规模的关联性:发现随着模型规模的增加,prompt tuning方法与全模型微调(model tuning)的性能差距逐渐缩小,特别是在大规模模型上,prompt tuning能够匹配甚至超越全模型微调的性能。

- Prompt Ensembling:提出了一种新的模型集成方法,通过训练多个不同的提示(prompts)来提高任务性能,这种方法比传统的模型集成更高效。

- 对域迁移的鲁棒性:展示了prompt tuning在域迁移问题上的优势,即在输入分布发生变化时,prompt tuning能够更好地保持性能,这表明它在避免过拟合特定数据集方面具有优势。

- 简化的实现:相比于其他需要调整模型中间层或输出层的方法,prompt tuning通过仅在输入层添加可训练的提示来实现任务适应,这种方法更简单,参数效率更高。

- 解释性分析:对学习到的软提示进行了解释性分析,发现这些提示能够学习到与任务相关的“词-like”表示,尽管它们在序列层面上不太可解释,但提供了对模型行为的一些洞察。

3 相关研究

- ELMo:提出了冻结预训练模型并在每一层学习任务特定权重的方法。

- Deep contextuali

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

7万+

7万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?