轻量化模型设计

1x1卷积

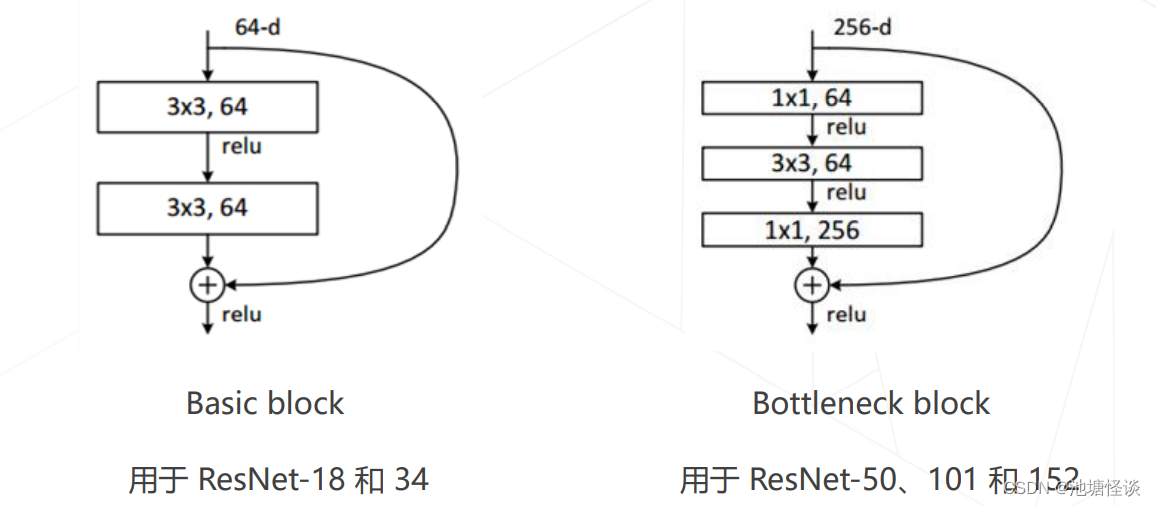

ResNet的BottleNeck block,先使用1x1卷积降低通道数(256->64),再使用3x3卷积,以此来减少计算开销。

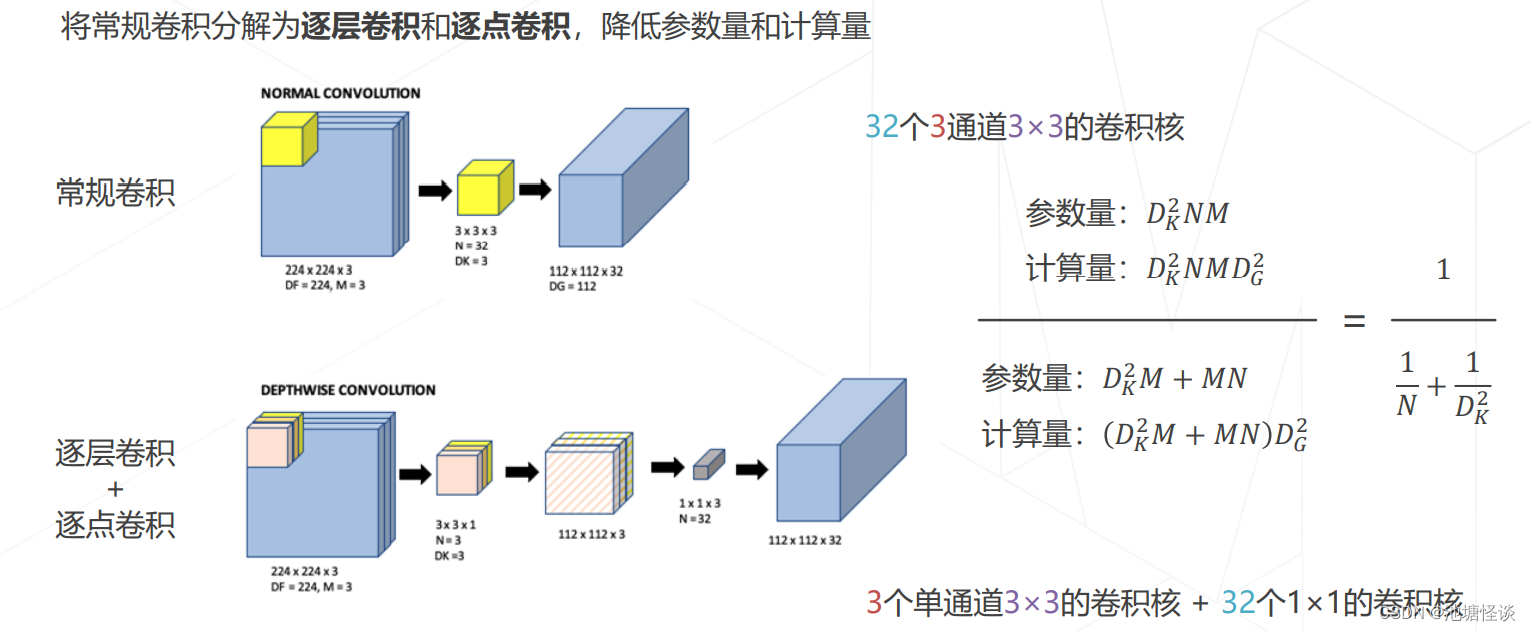

可分离卷积

将常规卷积分解为逐层卷积和逐点卷积两个步骤,可以降低参数量和计算量。先用通道数为1的卷积对每一个通道分开进行卷积,得到N通道互不关联的feature map,相当于对一本书的每一页做单独的卷积;之后再使用1x1的N通道卷积,进行逐点卷积,即对一本书的每一页的同一位置同时进行计算,来做通道之间的信息交互。

学习率对训练的影响

学习率的设置直接影响了模型的收敛速度和最后能达到的精度,从头训练可以使用较大的学习率,而fine-tune可以使用比较小的学习率。当我们想复现某些工作时,有时候无法满足原工作的训练配置,在调整显卡数量和bs的时候,也应当相应对lr做调整。当 batch size 扩大为原来的 𝑘 倍时,学习率也应该对应扩大 𝑘 倍,这样做可以保证平均每个样本带来的梯度下降步长相同。

eg:假设预训练模型使用 lr=0.1,8卡数据并行训练,如果希望用1卡复现实验,lr 应设置为 0.0125。

426

426

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?