卷积层实现

- 自定义张量 + tf.nn.函数()

- 实例化层类

1.自定义权值实现

x = tf.random.normal([2,5,5,3]) # 模拟输入,3 通道,高宽为 5 # 需要根据[k,k,cin,cout]格式创建 W 张量,4 个 3x3 大小卷积核

w = tf.random.normal([3,3,3,4])

# 步长为 1, padding 为 0,

out = tf.nn.conv2d(x,w,strides=1,padding=[[0,0],[0,0],[0,0],[0,0]])

特别地,通过设置参数 padding=‘SAME’、strides=1 可以直接得到输入、输出同大小的卷积层,其中 padding 的具体数量由 TensorFlow 自动计算并完成填充操作。

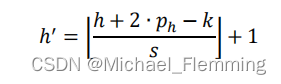

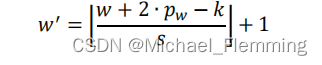

当𝑠 > 时,设置 padding='SAME’将使得输出高、宽将成1𝑠倍地减少。

x = tf.random.normal([2,5,5,3])

w = tf.random.normal([3,3,3,4])

# 高宽先 padding 成可以整除 3 的最小整数 6,然后 6 按 3 倍减少,得到 2x2

out = tf.nn.conv2d(x,w,strides=3,padding='SAME')

Out [4]:TensorShape([2, 2, 2, 4])

2.卷积层类实现

layer = layers.Conv2D(4,kernel_size=3,strides=1,padding='SAME')

如果卷积核高宽不等,步长行列方向不等,此时需要将 kernel_size 参数设计为 tuple格式(𝑘_ℎ, 𝑘_𝑤),strides 参数设计为(𝑠_ℎ, 𝑠_𝑤)。

layer = layers.Conv2D(4,kernel_

卷积层对象创建完成后,直接调用对象的__call__方法可以完成前向计算。

# 创建卷积层类

layer = layers.Conv2D(4,kernel_size=3,strides=1,padding='SAME')

out = layer(x) # 前向计算

out.shape # 输出张量的 shape

Out[5]:TensorShape([2, 5, 5, 4])

layer.trainable_variables属性返回待优化参数W和b。

layer.kernel返回待优化张量W。

layer.bias返回待优化张量b。

260

260

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?