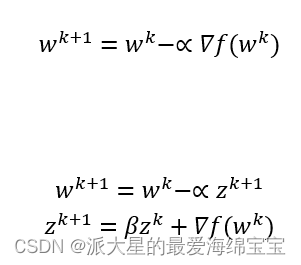

动量

可以理解为惯性,

减去一个梯度意味着往梯度的方向走,此时减去一个zk,意味着往zk的方向走

zk是某个叠加的算子,代表上一次梯度的方向▽w(k-1),

adam本身就是利用动量做的优化,不需要额外管理这个变量。

optimizer=torch.optim.SGD(model.parameters(),args.lr,

momentum=args.momentum,

weight_decay=args.weight_decay)

scheduler=ReduceLROnPlateau(optimizer,'min')

for epoch in xrange(args.start_epoch,args.epochs):

train(train_loader,model,criteon,optimizer,epoch)

result_avg,loss_val=

validate(val_loader,model,criteon,epoch)

scheduler.step(loss_val)

learning rate tunning学习率的衰减

我们会迫使学习率慢慢降为0

方案1:

scheduler=ReduceLROnPlateau(optimizer,'min')

loss下降后平缓,一条直线不再减少,就要减少lr。参数patience,patience次后,监听loss,发现loss没有减少,就会减少lr,每次lr成员减少因子(例如0.5或0.08).

scheduler.step(loss_val)

每调用一次就会监听一次loss,判断loss是否长时间不再减少,如果是,则按照规则减少lr,如果不是则什么也不做,只起记录的作用。

方案2:

规定每x个epoch,就会衰减一点lr。

scheduler=StepLR(optimizer,step_size=30,gamma=0.1)

每30个epoch,lr=lr*gamma

通常设置为1k

4110

4110

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?