目录

Logistic loss and cost function

motivations

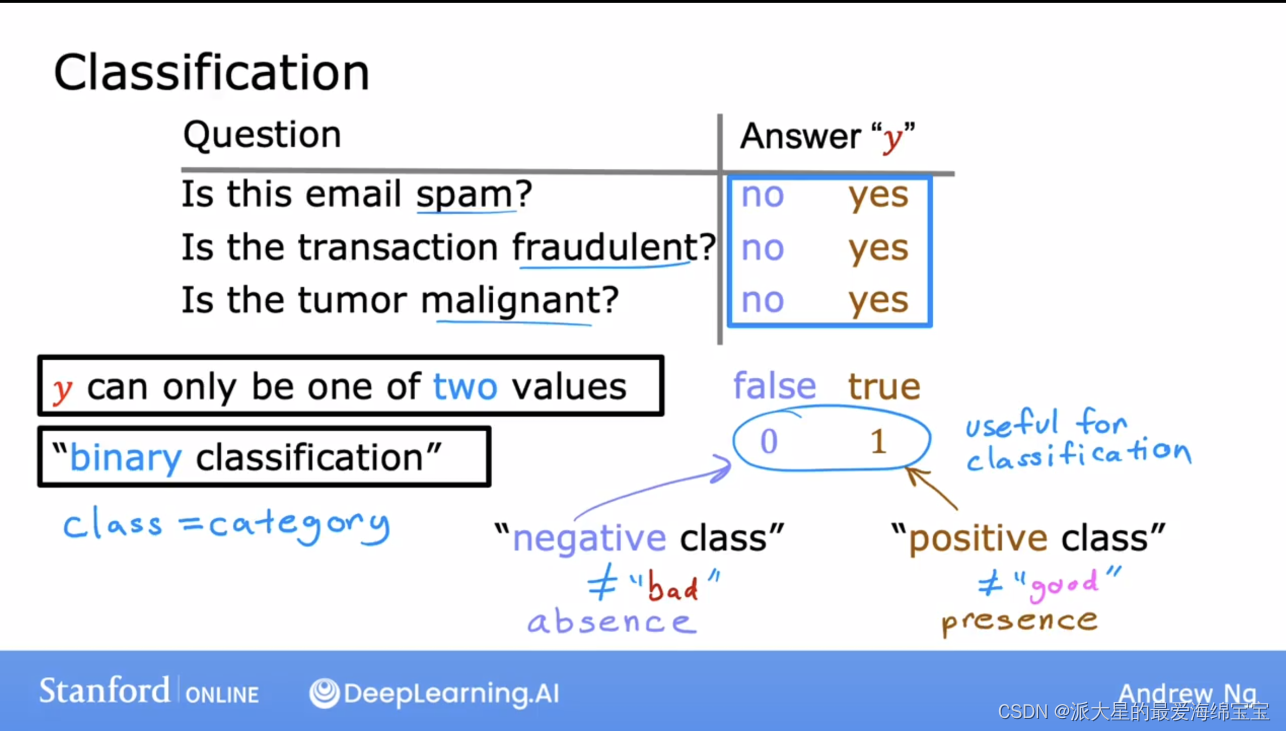

每一个问题,我们可以使用no与yes,或false与true,或0与1,这些词并不代表着bad或good,它们在不同的例子里有不同的含义。

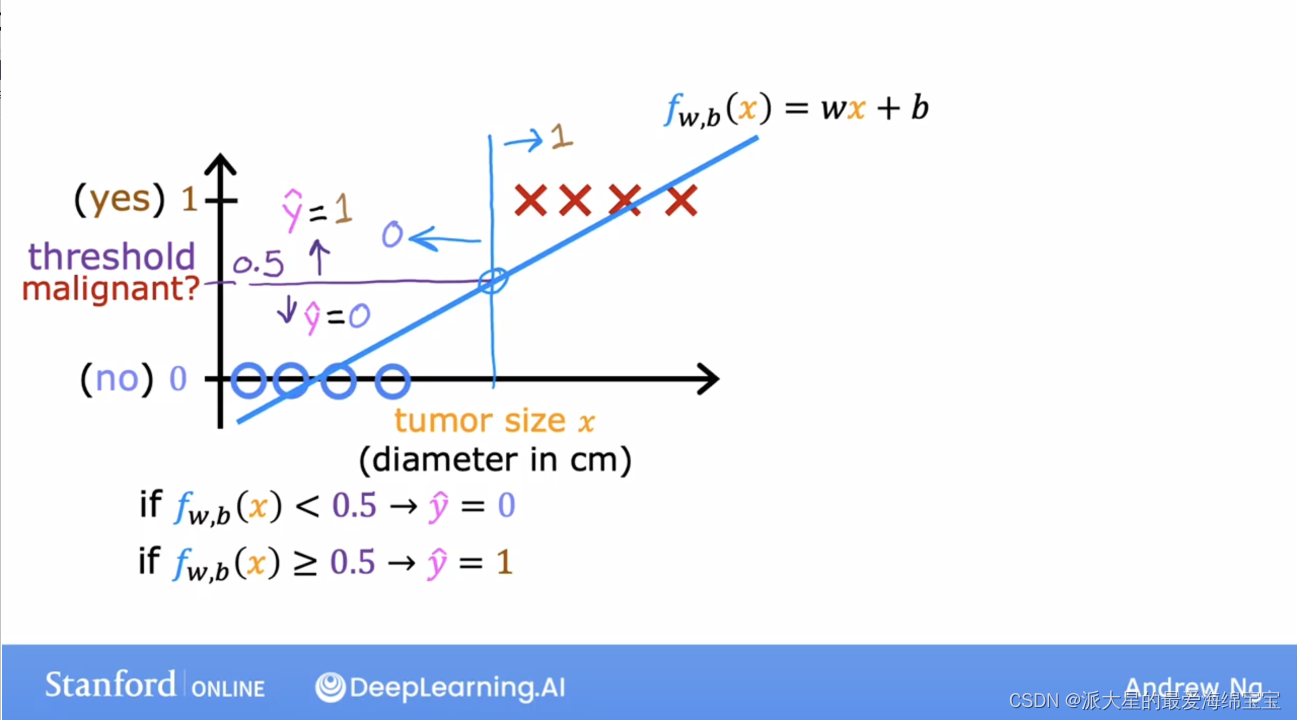

好的肿块是0,坏的是1,如果我们选择使用线性回归,那么设置一个阈值等于0.5,小于阈值的输出为0,大于阈值的输出为1。这也是一种合理的解释。

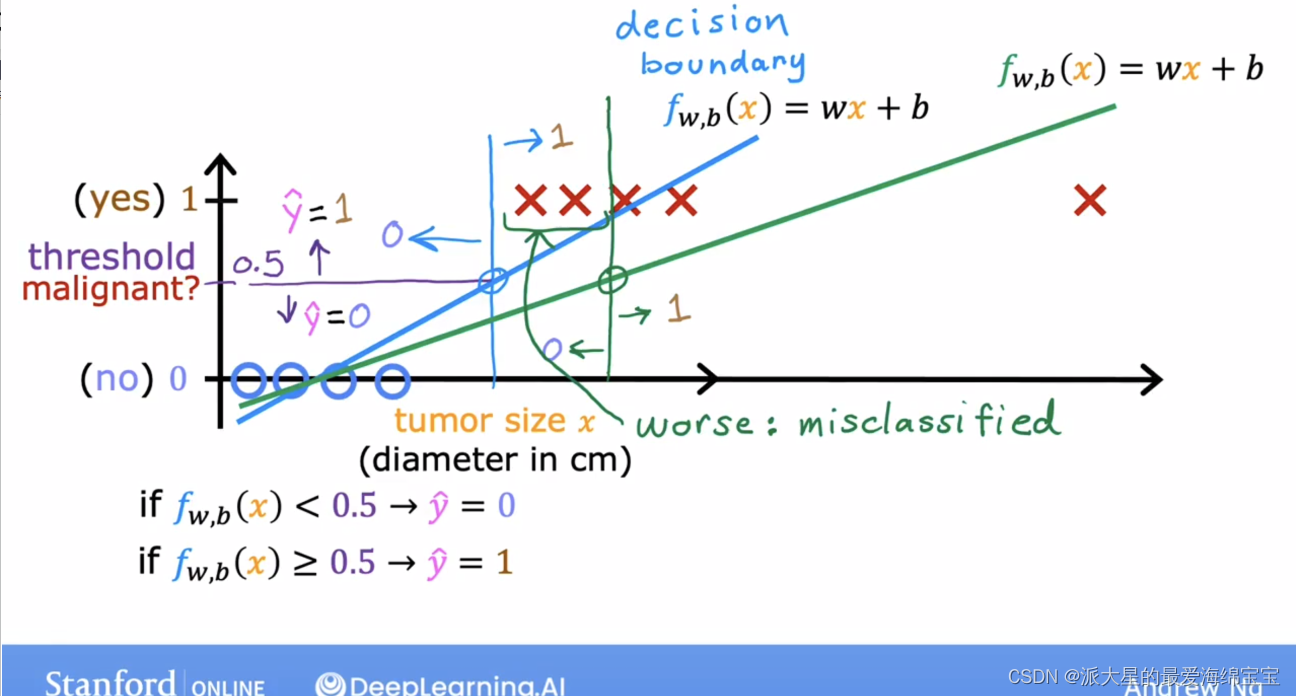

但是一旦数据集改为下面的,那么线性回归就会出错:

其中,我们划分的新绿色阈值可以称作decision boundary。

logistic regression逻辑回归

逻辑回归通常用于不带标签的二分类问题。

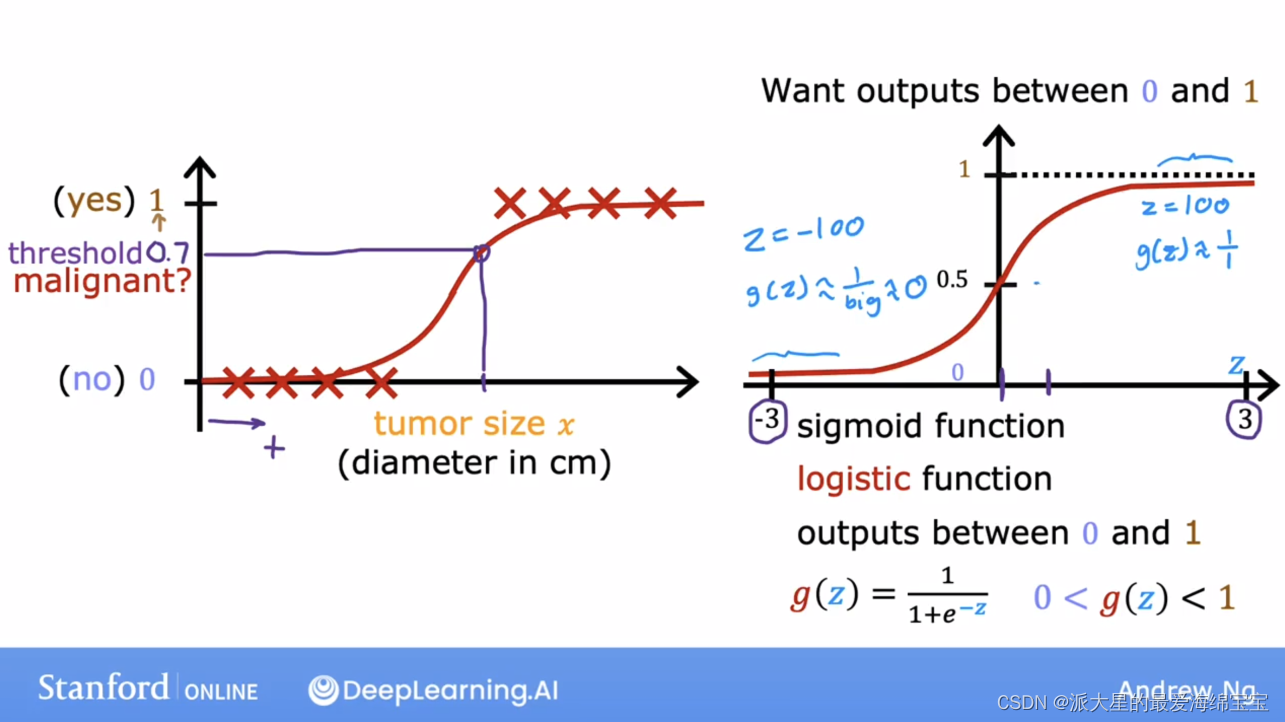

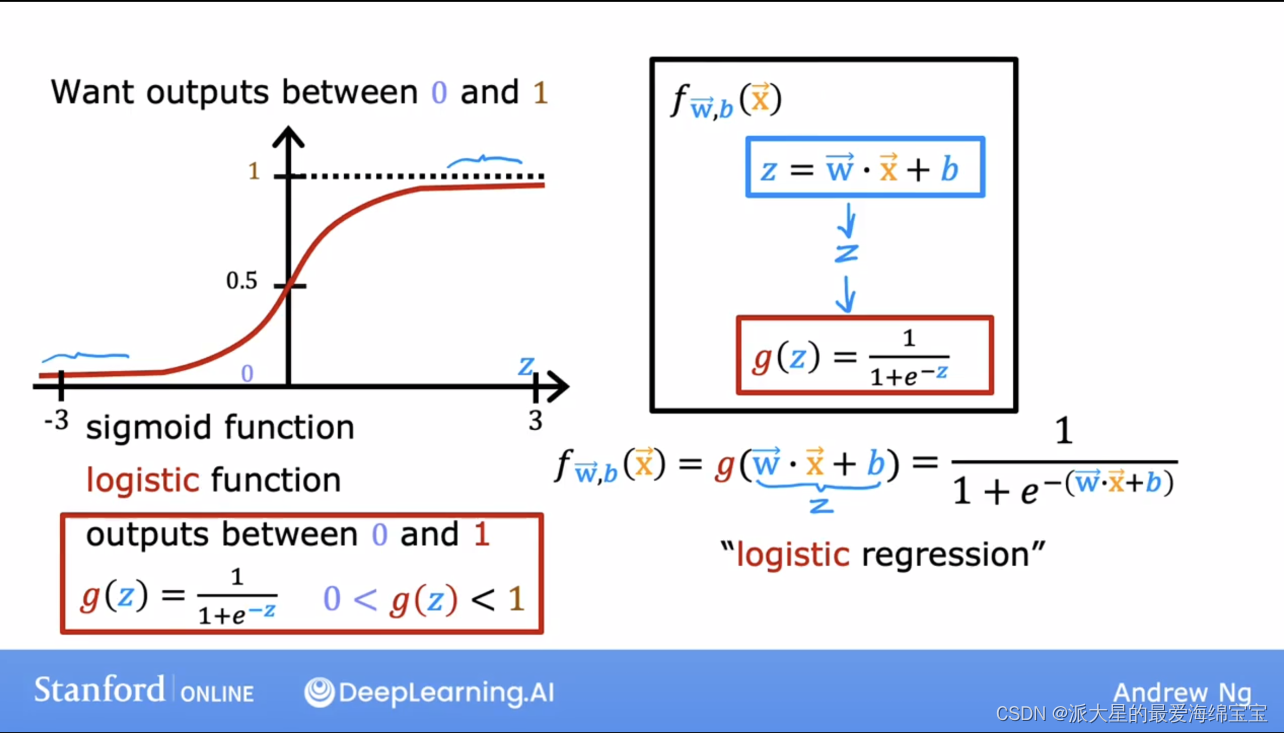

第一步,记住类似于线性回归函数的直线函数可以定义为wx+b的形式,第二步,把wx+b赋值给z,并将其传递给g(z)函数,该函数也叫做逻辑函数G。g(z)的输出在0到1之间,当z很大的时候,接近于1,当z很小的时候,接近于0。

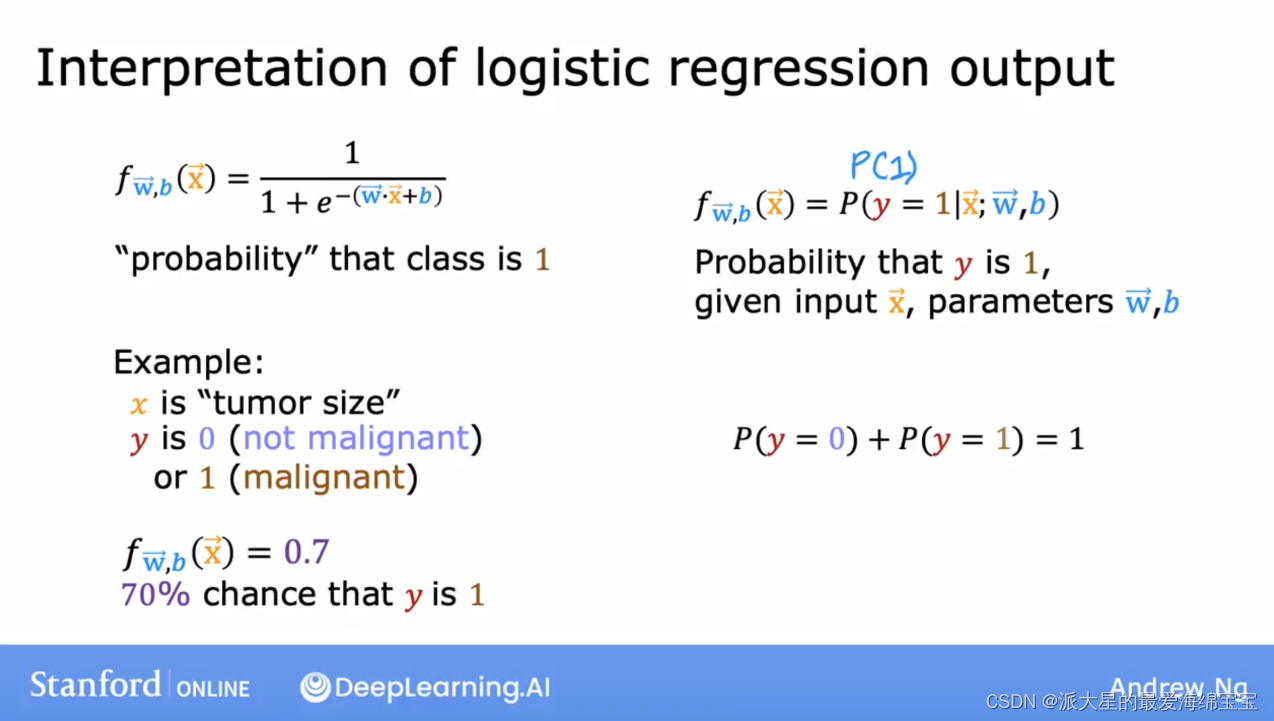

f输出为0.7时,不仅意味着是1的可能性为0.7,也意味着是0的可能性为0.3。

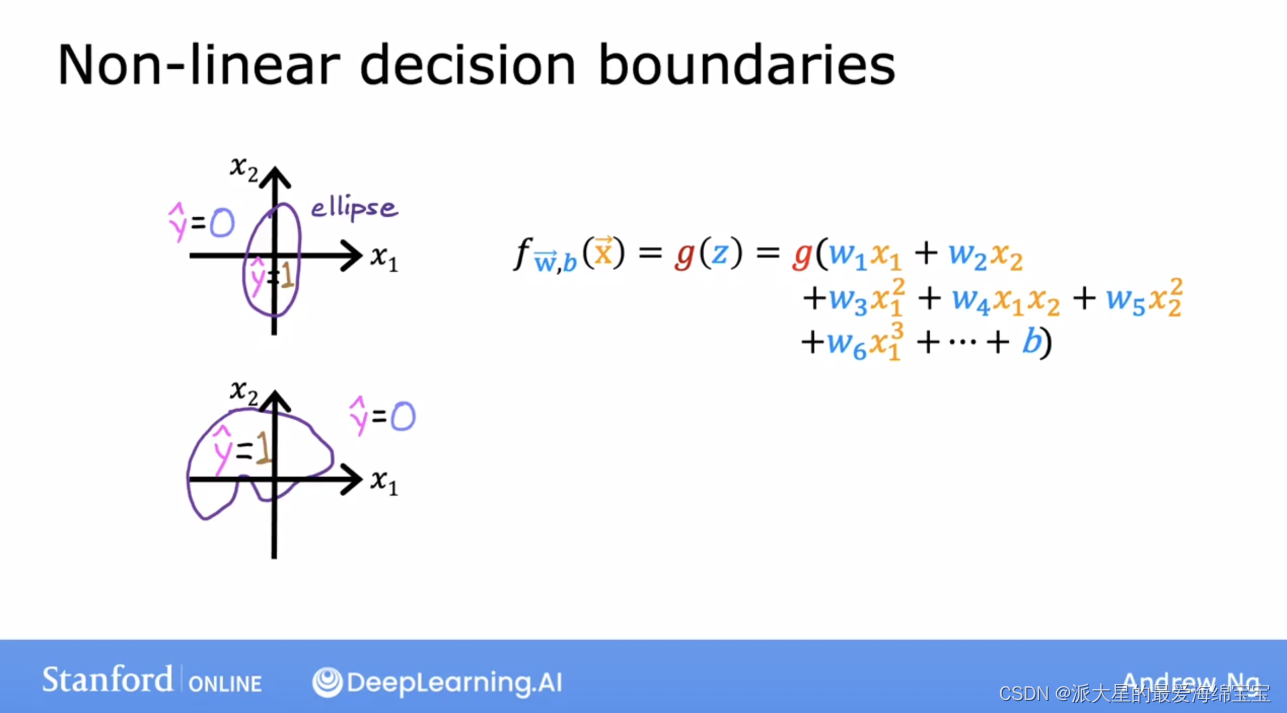

decision boundary决策边界

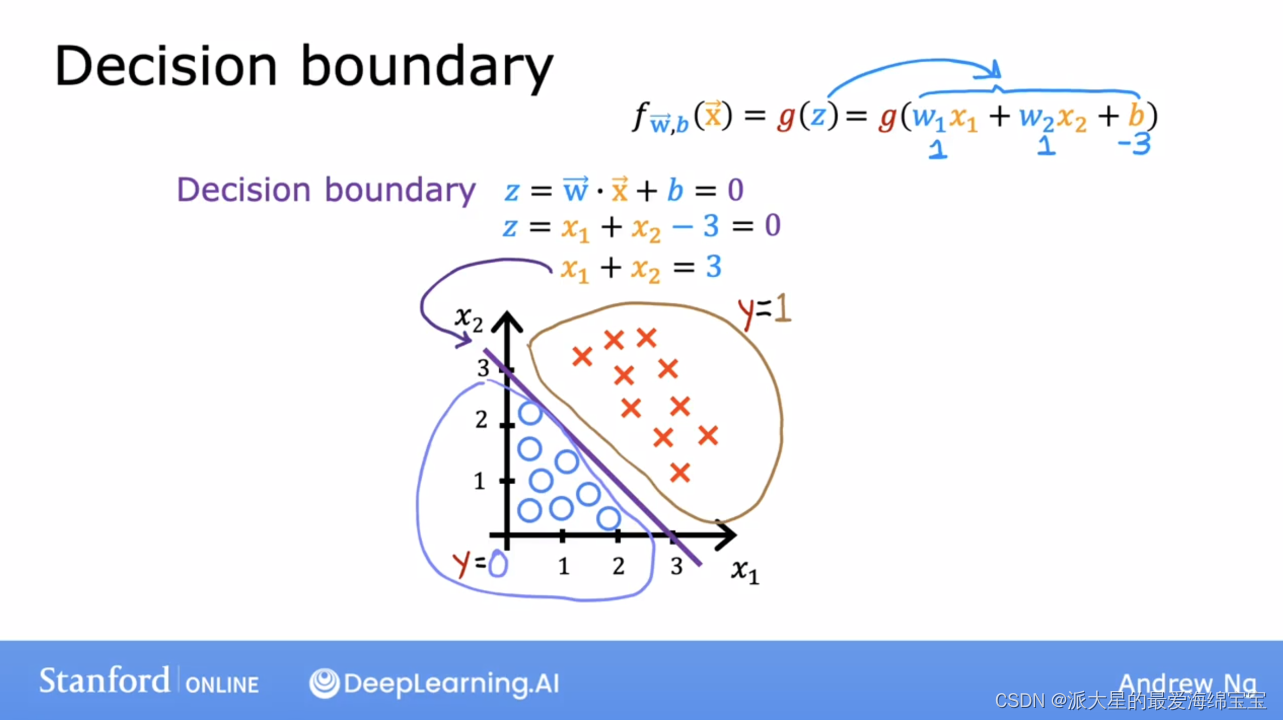

decision boundary决策边界就是先为参数赋值后,令z等于0得到的函数。

在这条线的左边,y会被预测为0,在这条线的右边,y会被预测为1。此时,我们通过为w1、w2和b分别赋值为了1、1、-3,可视化了决策边界,当我们选择其他值时,决策边界将会是不同的一条直线。

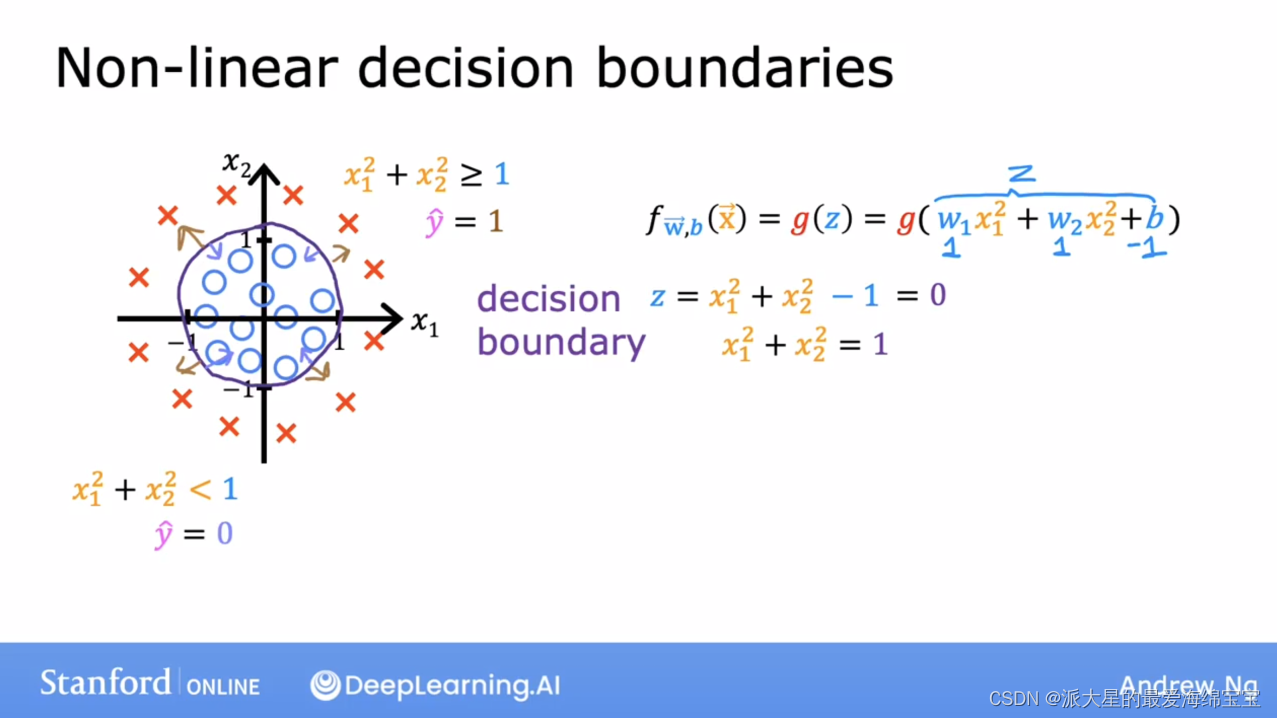

对于该特征比上一个更复杂一点,其决策边界也更加复杂一点,不再是线性的。

模型决定决策边界the model define desicion boundary。

对于这些多项式特征,我们可以得到很复杂的决策边界,即逻辑回归可以拟合很复杂的数据。

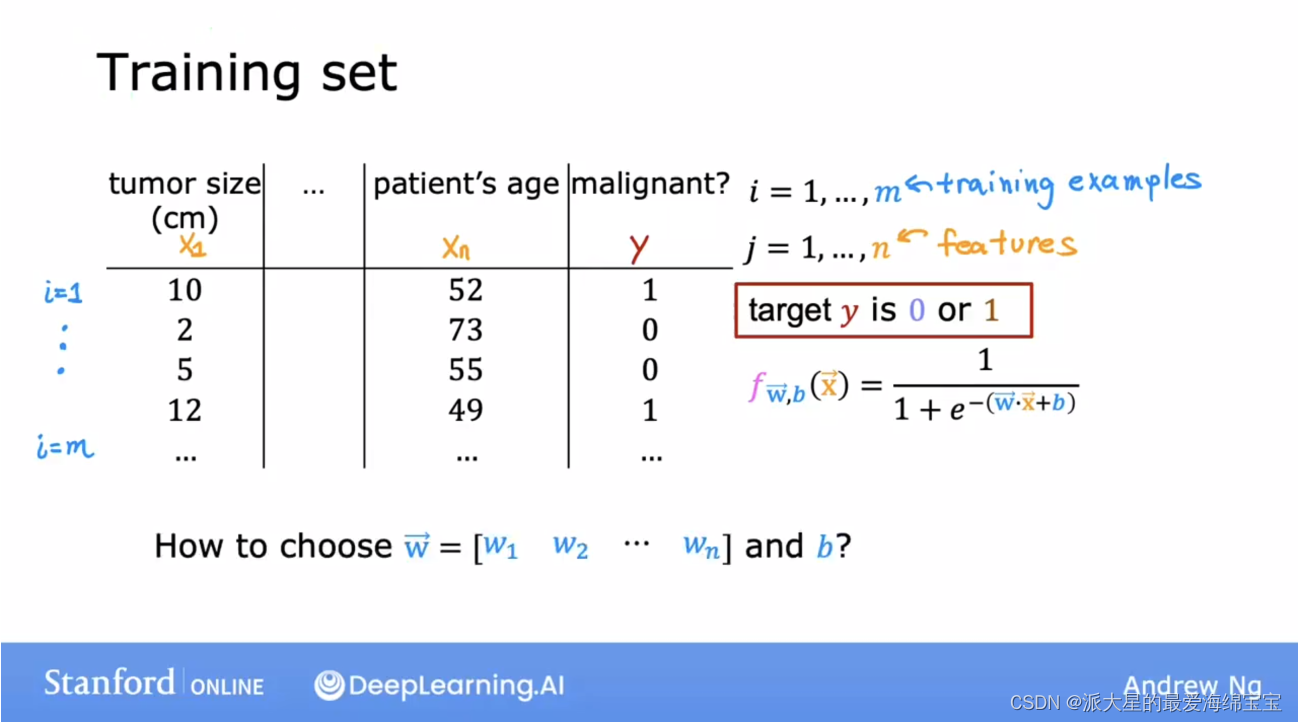

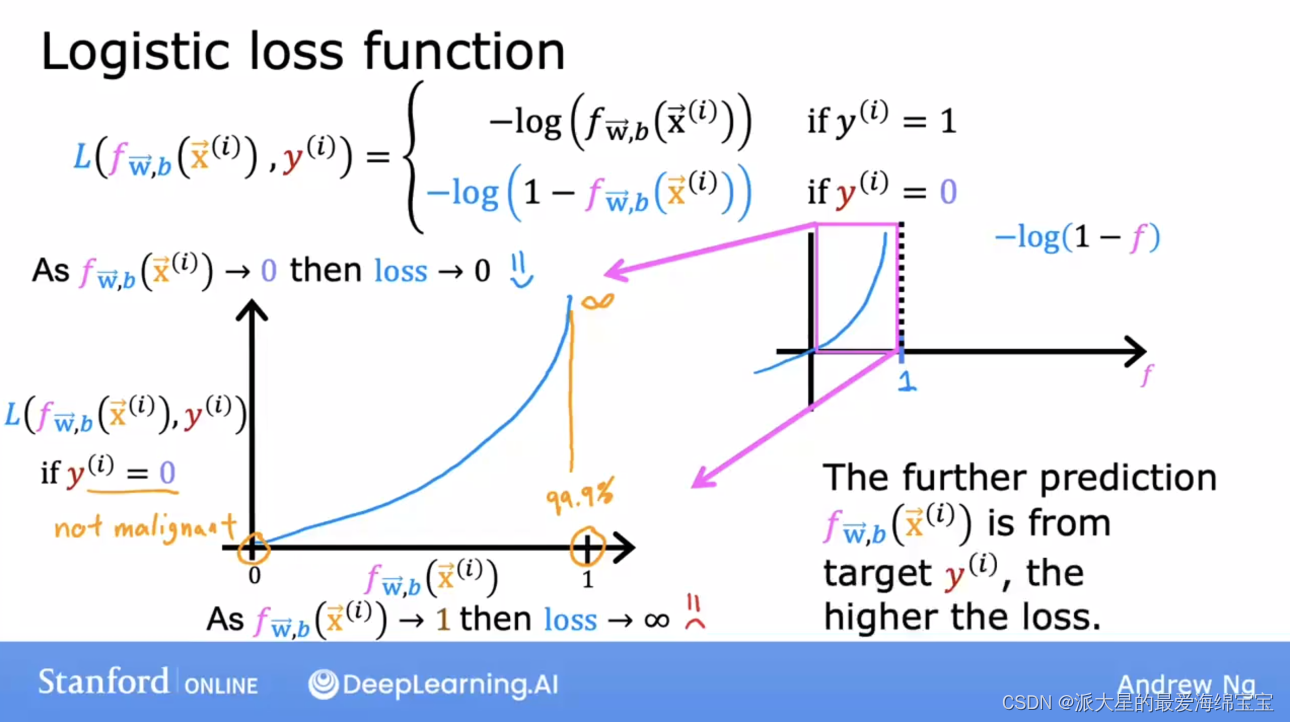

逻辑函数的损失函数

对于这样的一个数据集,我们应该如何选择参数的值?

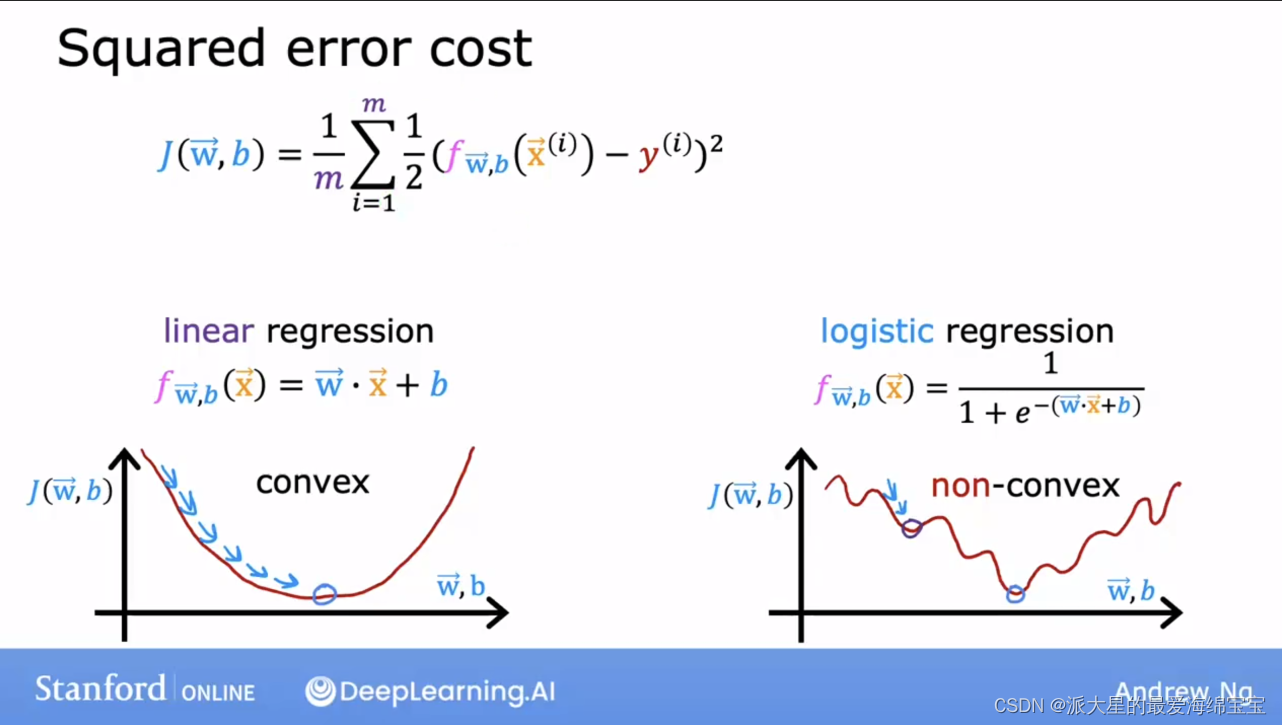

在线性回归时,我们采用squared error cost,梯度下降一步一步到达收敛点。但是对于采用相同方法的逻辑回归,我们梯度下降时可能会困在局部最小值点。所以适用于线性回归的squared error loss可能不适用于逻辑回归。

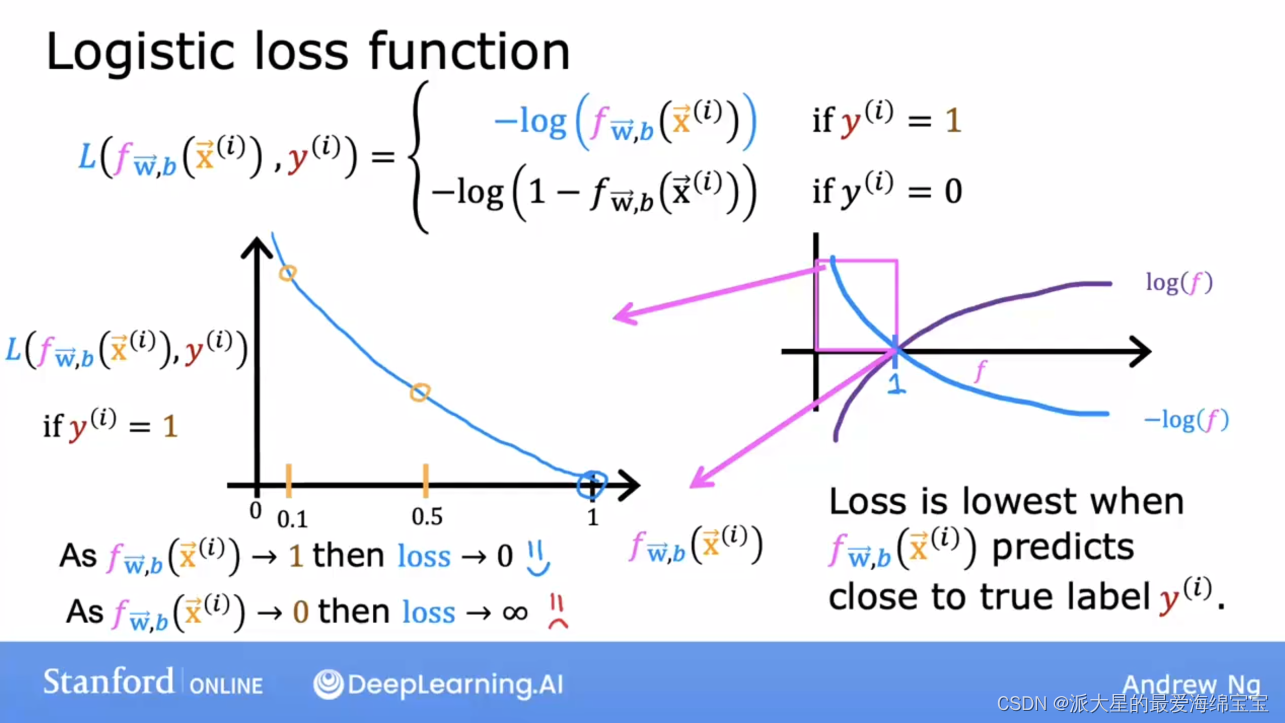

Logistic loss and cost function

loss function损失函数衡量我们在一个训练样本上的表现能力,通过由每个训练数据得到的损失loss的总和得到cost fuction,其衡量你在整个训练数据集上的表现能力。

当真实标签为1时,损失函数如图所示,当f接近于1时,损失接近于0,而当f趋近于0,-log(f)趋近于无穷大,此时loss趋近于无穷大。

当真实标签为0时,损失函数如图所示,当f接近于0时,损失接近于0,而当f趋近于1,-log(1-f)趋近于无穷大,此时loss趋近于无穷大。

此为逻辑回归的cost function。

我们学习了逻辑回归的损失函数,并分辨了cost function和loss function的区别。

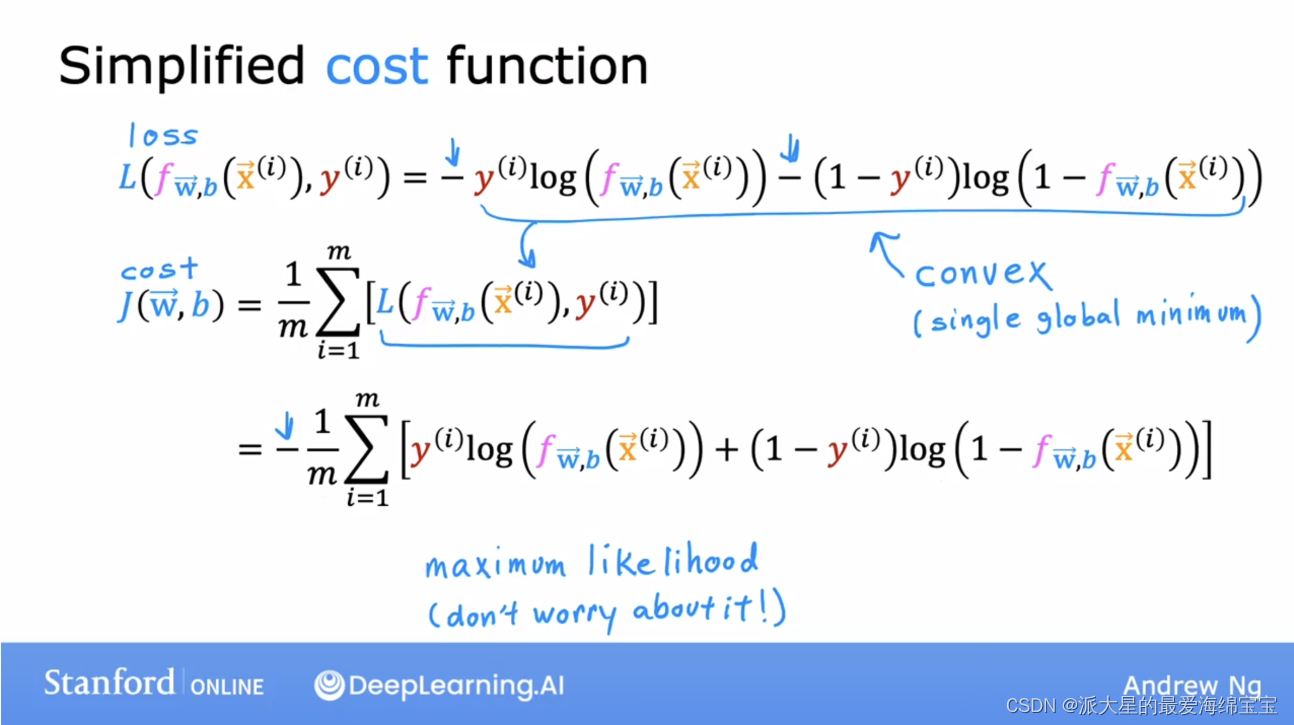

simplified cost function

对于上方的式子我们可以写成一行式子。

这就是逻辑回归的cost function。

该图片内容有一些源于统计学。

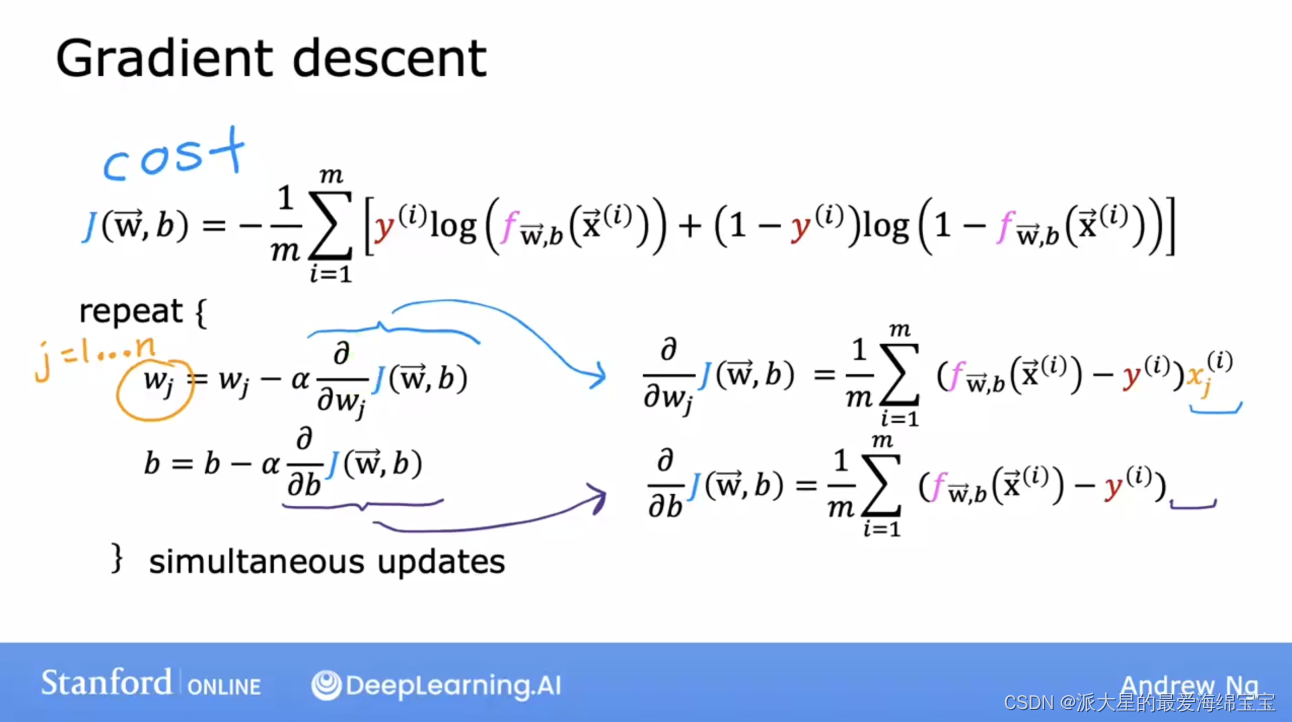

逻辑回归的梯度下降

即使这个式子与线性回归的很相似,但是因为F的定义改变了,所以两者是不同的。

对于线性回归的观察梯度下降、向量化操作和特征缩放,同样适用于逻辑回归,利于逻辑回归的加速收敛。

1167

1167

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?