《Forecast of Short-Term Passenger Flow in Multi-Level Rail Transit Network Based on a Multi-Task Learning Model》

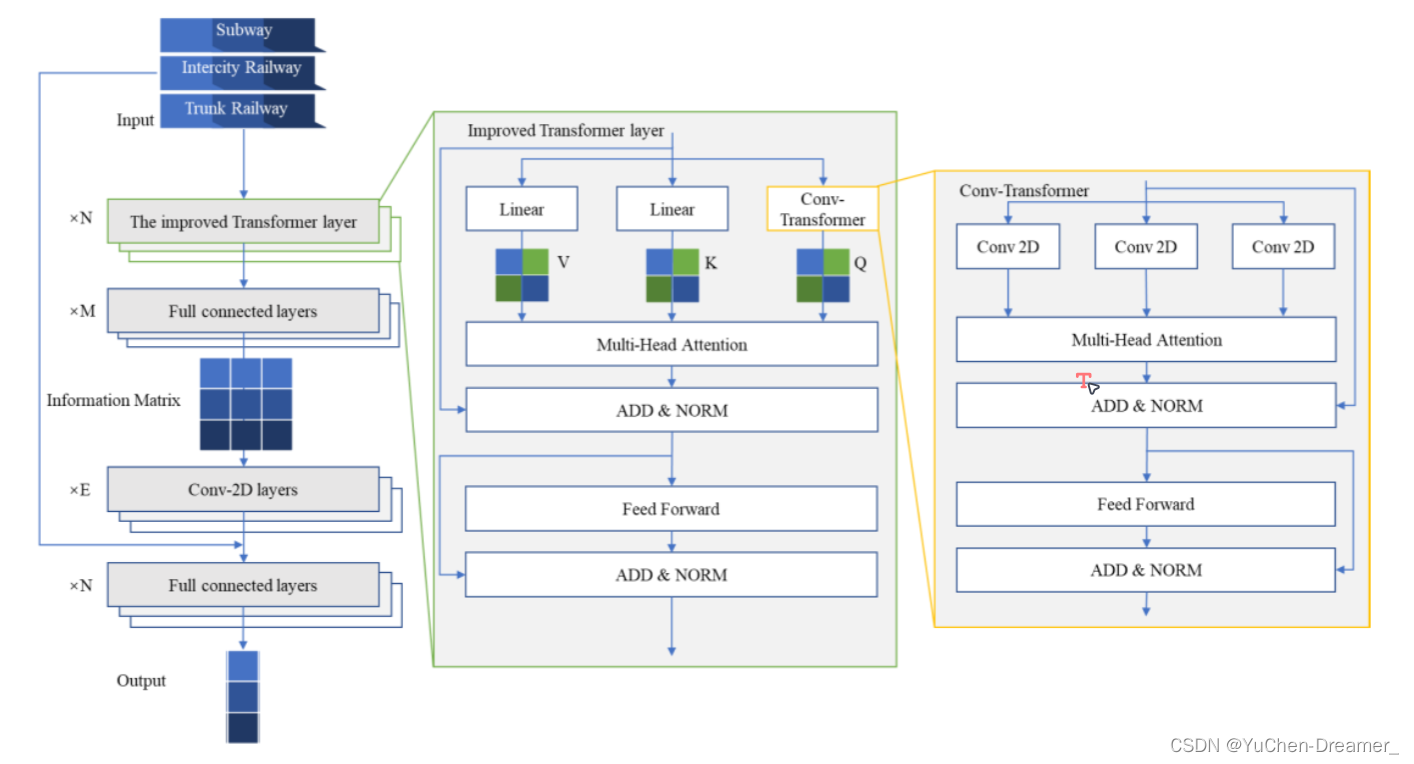

三个输入,为了探讨三个输入之间的相关性,作者提出了改进的transformer层,里面包含多头注意力机制。

为了计算Q作者使用卷积层代替线性层,从而可以充分计算不同轨道方式客流之间的相关系。

卷积层代替线性层作为Q这个点很新奇,好像图注意力机制就是类似的原理。

《基于多图时空注意力的轨道交通客流预测模型》

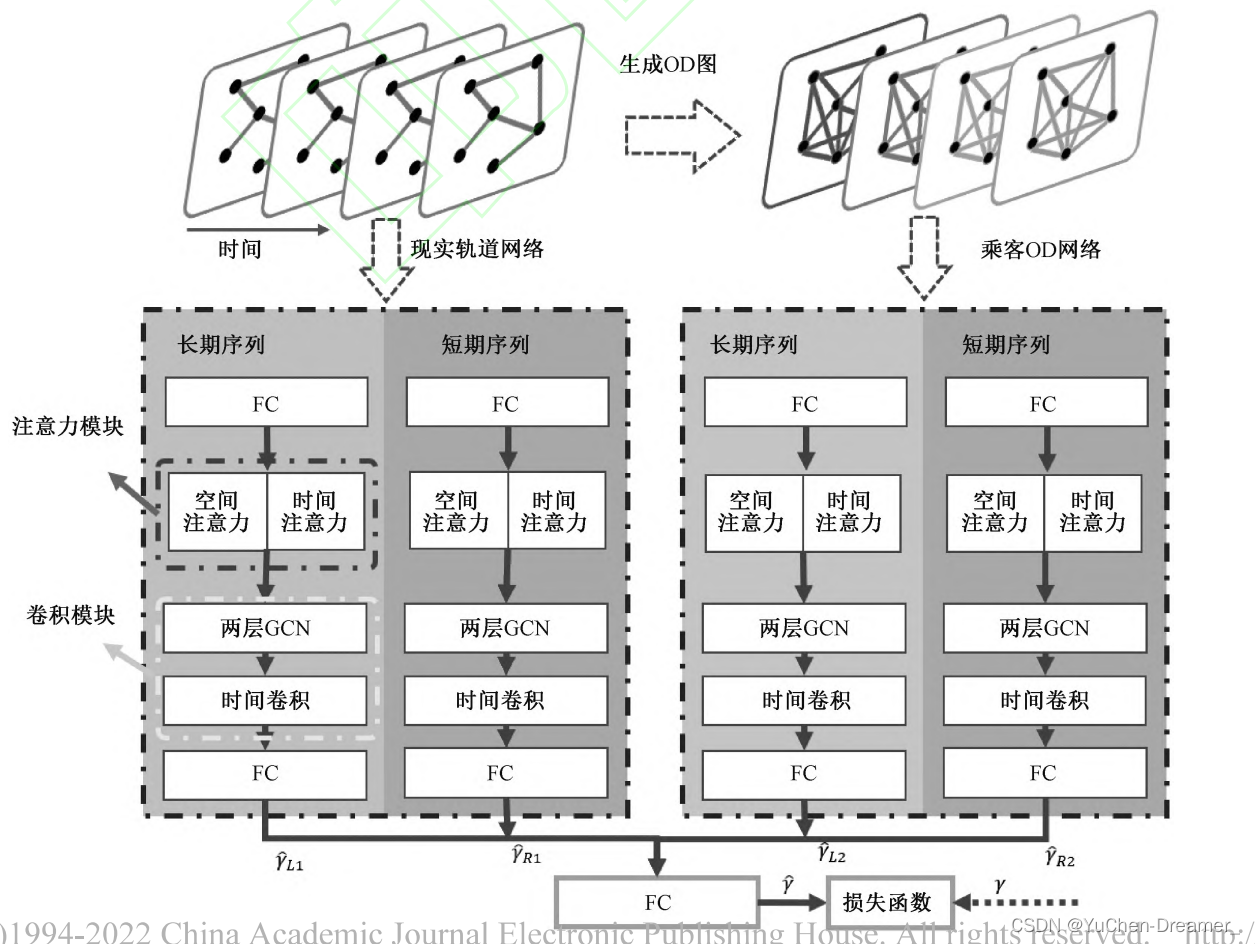

作者的多图是网络结构图和OD图,这个OD是在一点时间段内的OD量,不知道他这个一定时间段内是怎么定义的,这个真没找到。

按照文中所说的这个数据的输入形式应该是(batch_size,station,feature)还有adj领接矩阵,OD网络同理,其中feature的长度是time_step,作者有分为长期序列和短期序列,所以输入一共分为4个部分 网络-长期,网络-短期,OD-长期,OD-短期。

下面的注意力模块的目的是捕捉不同时间步和不同站点对预测结果的影响,因为不同站点不同时间段与外来客流的相关性不同。改变的是(station,feature),adj并没改变,

下面将adj与节点特征也即(station,feature)输入到GCN中,输出为维度为(station,feature)然后每个station进入一个TCN中最后输出(station,1),进入一个FC。

将4个部分的输出进行加权融合再经过一个FC最后输出。

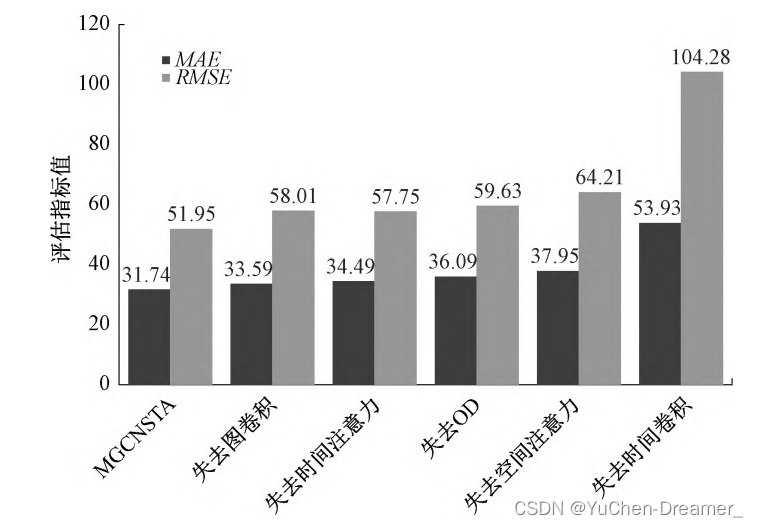

整个模型不复杂,上图是作者做的消融实验,可以看到失去空间注意力比失去图卷积性能下降更快,说明空间注意力比图卷积能够更好的提取网络的空间相关性;失去时间卷积直接性能大幅下降,这个其实就是一个类似于LSTM,捕捉时间序列的特征。

emmm这个空间注意力就是图注意力机制?好像是的。。

所以,如果要预测全网的轨道客流,首先GCN不能少

4062

4062

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?