一、引言

在智能交通系统(ITS)的快速发展中,对车辆进行精确的检测和跟踪是实现交通监控、流量分析和安全预警的关键技术。YOLOv8和DeepSORT的结合,为解决这一挑战提供了一种创新的解决方案。

本文将详细介绍YOLOv8+DeepSORT在多目标车辆跟踪中的应用,包括车辆检测、跟踪和计数。

二、YOLOv8:革命性的车辆检测

YOLOv8是目标检测领域的最新进展,它通过单次前向传播即可预测出图像中的目标位置和类别。与传统的两阶段检测器相比,YOLOv8在速度和准确性上都有显著提升。YOLOv8的特点包括:

- 实时性能:YOLOv8专为实时应用设计,能够在视频流中快速检测车辆。

- 高准确性:利用最新的卷积神经网络架构,YOLOv8在各种环境下都能保持高准确率。

- 易于集成:YOLOv8的输出可以直接用于后续的跟踪算法,无需复杂的预处理。

三、DeepSORT:先进的跟踪技术

DeepSORT是一种基于深度学习的特征表示方法,它通过提取目标的关键点特征来进行跟踪。DeepSORT的关键优势包括:

- 特征学习:DeepSORT利用深度卷积网络学习目标的特征表示,提高了目标区分能力。

- 多目标跟踪:DeepSORT能够有效处理视频中的多个目标,即使在目标重叠和遮挡的情况下也能保持稳定跟踪。

- 适应性:DeepSORT能够适应目标的外观变化,包括尺度变化、旋转和变形。

四、YOLOv8+DeepSORT:无缝集成

将YOLOv8用于车辆检测,其输出的边界框和车辆特征可以作为DeepSORT的输入。这种无缝集成的方式使得YOLOv8+DeepSORT系统在多目标车辆跟踪中表现出色:

- 快速检测与稳定跟踪:YOLOv8快速定位车辆,DeepSORT稳定跟踪每一辆车。

- 高精度的车辆计数:系统能够准确统计通过特定区域的车辆数量,适用于交通流量分析。

- 鲁棒性:即使在复杂的交通场景中,YOLOv8+DeepSORT也能保持稳定的跟踪性能。

五、车辆计数:智能交通管理的关键

在智能交通管理系统中,车辆计数是一个关键功能。通过YOLOv8+DeepSORT系统,我们不仅可以实时跟踪每一辆车的轨迹,还可以统计车流量,分析交通模式。这对于交通规划、拥堵管理和事故预防具有重要意义。

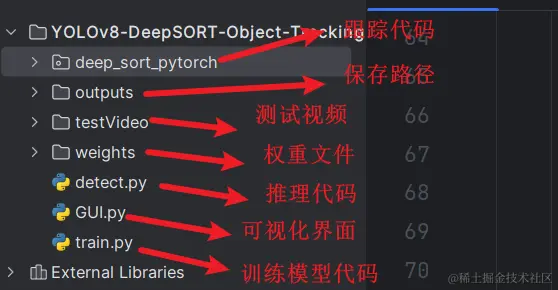

5.1 相关代码介绍

初始化跟踪器

def init_tracker():

"""

初始化目标跟踪器

"""

# 获取DeepSort的配置

cfg_deep = get_config()

cfg_deep.merge_from_file("deep_sort_pytorch/configs/deep_sort.yaml")

deepsort = DeepSort(model_path=cfg_deep.DEEPSORT.REID_CKPT,

max_dist=cfg_deep.DEEPSORT.MAX_DIST, min_confidence=cfg_deep.DEEPSORT.MIN_CONFIDENCE,

nms_max_overlap=cfg_deep.DEEPSORT.NMS_MAX_OVERLAP,

max_iou_distance=cfg_deep.DEEPSORT.MAX_IOU_DISTANCE,

max_age=cfg_deep.DEEPSORT.MAX_AGE, n_init=cfg_deep.DEEPSORT.N_INIT,

nn_budget=cfg_deep.DEEPSORT.NN_BUDGET,

use_cuda=True)

return deepsort

计算移动方向

def get_direction(point1, point2):

"""

根据两个点的相对位置计算出移动方向

"""

direction_str = ""

# 根据两个点在y轴上的相对位置,确定是向南还是向北移动

if point1[1] > point2[1]:

direction_str += "South"

elif point1[1] < point2[1]:

direction_str += "North"

else:

direction_str += ""

# 根据两个点在x轴上的相对位置,确定是向东还是向西移动

if point1[0] > point2[0]:

direction_str += "East"

elif point1[0] < point2[0]:

direction_str += "West"

else:

direction_str += ""

return direction_str

绘制计数信息

# 遍历向北移动的对象计数器中的条目,并在图像的右上角显示计数信息

for idx, (key, value) in enumerate(object_counter1.items()):

# 进入的车辆数量

cnt_str = str(key) + ":" + str(value)

cv2.line(img, (width - 500, 25), (width, 25), [85, 45, 255], 40)

cv2.putText(img, f'Number of Vehicles Entering', (width - 500, 35), 0, 1, [225, 255, 255], thickness=2,

lineType=cv2.LINE_AA)

# 绘制分隔线

cv2.line(img, (width - 150, 65 + (idx * 40)), (width, 65 + (idx * 40)), [85, 45, 255], 30)

# 绘制计数信息。

cv2.putText(img, cnt_str, (width - 150, 75 + (idx * 40)), 0, 1, [255, 255, 255], thickness=2,

lineType=cv2.LINE_AA)

# 遍历向南移动的对象计数器中的条目,并在图像的左上角显示计数信息

for idx, (key, value) in enumerate(object_counter.items()):

# 离开的车辆数量

cnt_str1 = str(key) + ":" + str(value)

cv2.line(img, (20, 25), (500, 25), [85, 45, 255], 40)

cv2.putText(img, f'Numbers of Vehicles Leaving', (11, 35), 0, 1, [225, 255, 255], thickness=2,

lineType=cv2.LINE_AA)

cv2.line(img, (20, 65 + (idx * 40)), (127, 65 + (idx * 40)), [85, 45, 255], 30)

cv2.putText(img, cnt_str1, (11, 75 + (idx * 40)), 0, 1, [225, 255, 255], thickness=2, lineType=cv2.LINE_AA)

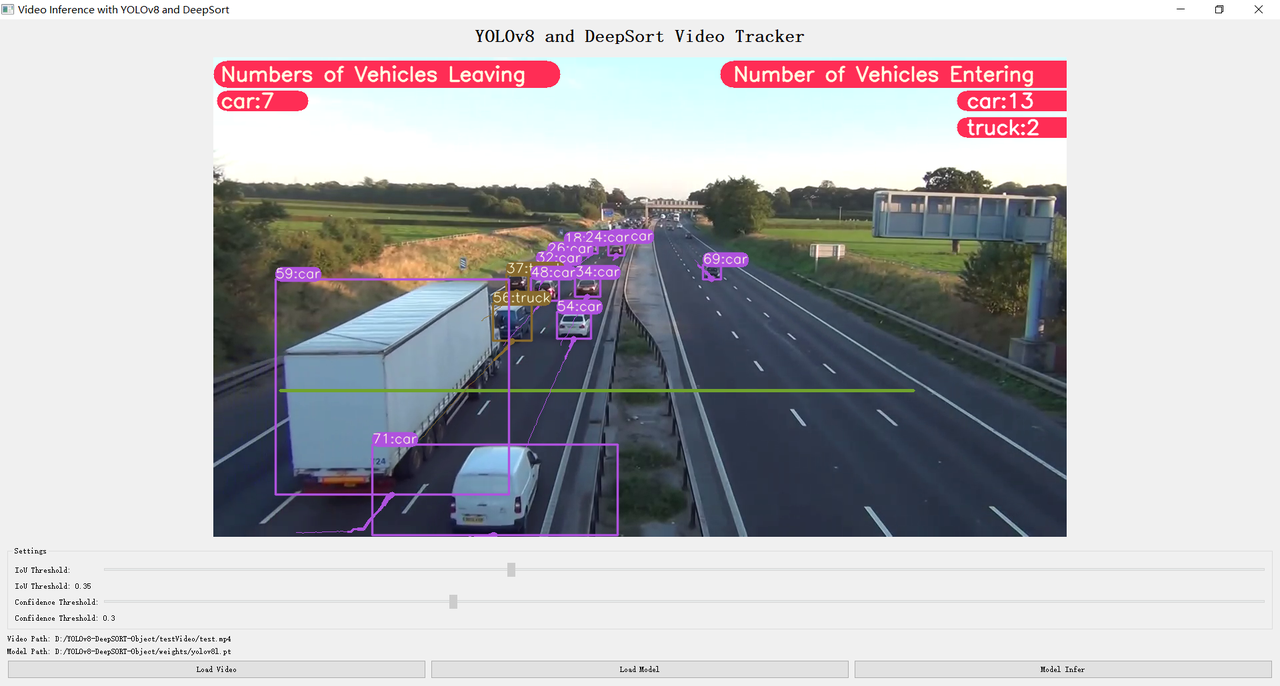

推理效果

YOLOv8+DeepSORT多目标车辆跟踪(车辆检测+跟踪+车辆计数) 视频效果

可视化界面

1409

1409

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?