第二节课的内容包括文本预处理、语言模型和循环神经网络基础。本人对这方面不是很精通,可能会有错误。

一、文本预处理

文本预处理主要包括四个步骤:读入文本、分词、建立字典、将词转化为索引

1.读入文本

import collections

import re

def read_time_machine():

with open('/home/kesci/input/timemachine7163/timemachine.txt', 'r') as f:

lines = [re.sub('[^a-z]+', ' ', line.strip().lower()) for line in f]

return lines

lines = read_time_machine()

print('# sentences %d' % len(lines))

首先引入collections模块和re模块。collections模块的主要功能是提供了一些特殊的容器,本节课用到的是counter类,能够支持方便快捷的计数;re模块主要提供正则表达式的功能,正则表达式是一个特殊的字符序列,它能帮助你方便的检查一个字符串是否与某种模式匹配。图中代码表示对得到的字符先进行去除空格、制表、换行符操作和大小写转换操作,最后对非小写英文字符构成的非空字符串替换为空格。

2.分词

我们对每个句子进行分词,也就是将一个句子划分成若干个词(token),转换为一个词的序列。

def tokenize(sentences, token='word'):

"""Split sentences into word or char tokens"""

if token == 'word':

return [sentence.split(' ') for sentence in sentences]

elif token == 'char':

return [list(sentence) for sentence in sentences]

else:

print('ERROR: unkown token type '+token)

tokens = tokenize(lines)

tokens[0:2]

分词操作将选择将句子分解为单词还是字符,如果是单词,则将句子按照空格划分为一个个单词,如果是字符,则直接转换为列表。

3.建立字典

为了方便模型处理,我们需要将字符串转换为数字。因此我们需要先构建一个字典(vocabulary),将每个词映射到一个唯一的索引编号。

class Vocab(object):

def __init__(self, tokens, min_freq=0, use_special_tokens=False):

'''

tokens:二维列表,语料库中所有的词

min_freq:阈值,将出现频率小于min_freq的词去除

use_special_tokens:是否使用特殊标志

'''

counter = count_corpus(tokens) # 记录词和词频的字典

self.token_freqs = list(counter.items()) # 将字典转换为列表

self.idx_to_token = []

if use_special_tokens:

# 引入四个特殊标志:padding(填充长度不足的句子), begin of sentence, end of sentence, unknown(未知字符)

self.pad, self.bos, self.eos, self.unk = (0, 1, 2, 3)

self.idx_to_token += ['<pad>', '<bos>', '<eos>', '<unk>']

else:

self.unk = 0

self.idx_to_token += ['<unk>']

self.idx_to_token += [token for token, freq in self.token_freqs

if freq >= min_freq and token not in self.idx_to_token]

self.token_to_idx = dict() #词与索引对应的字典

for idx, token in enumerate(self.idx_to_token):

self.token_to_idx[token] = idx

def __len__(self):

'''

返回字典大小

'''

return len(self.idx_to_token)

def __getitem__(self, tokens):

'''

词到索引的映射

'''

if not isinstance(tokens, (list, tuple)):

return self.token_to_idx.get(tokens, self.unk)

return [self.__getitem__(token) for token in tokens]

def to_tokens(self, indices):

'''

索引到值的映射

'''

if not isinstance(indices, (list, tuple)):

return self.idx_to_token[indices]

return [self.idx_to_token[index] for index in indices]

def count_corpus(sentences):

'''

利用collections模块的counter类返回一个字典,记录每个词的出现次数

'''

tokens = [tk for st in sentences for tk in st]

return collections.Counter(tokens)

建立字典的过程包括去除重复和词频过低的词,添加特殊的token,将每个token映射到唯一的索引,再把每一个索引映射到对应的token

4.将词转换为索引

vocab = Vocab(tokens)

for i in range(8, 10):

print('words:', tokens[i]) # 第i行进行分词后得到的单词序列

print('indices:', vocab[tokens[i]]) # 第i行对应的索引编号

5.用现有工具进行分词

我们前面介绍的分词方式非常简单,它至少有以下几个缺点:

1.标点符号通常可以提供语义信息,但是我们的方法直接将其丢弃了

2.类似“shouldn’t", “doesn’t"这样的词会被错误地处理

3.类似"Mr.”, "Dr."这样的词会被错误地处理

为此,可以利用现有工具进行分词,例如spacy和nltk

Spacy 可以用于进行分词,命名实体识别,词性识别。它提供了许多不同的模型 , 模型中包含了语言的信息词汇表,预训练的词向量,语法和实体。

import spacy

nlp = spacy.load('en_core_web_sm') # 加载默认的模型- english-core-web

doc = nlp(text)

print([token.text for token in doc])

nltk是一个python工具包, 用来处理与自然语言相关的东西. 包括分词(tokenize), 词性标注(POS), 文本分类等,是较为好用的现成工具。但是目前该工具包的分词模块,只支持英文分词,而不支持中文分词。

from nltk.tokenize import word_tokenize

from nltk import data

data.path.append('/home/kesci/input/nltk_data3784/nltk_data')

print(word_tokenize(text))

二、语言模型

1.语言模型

一段自然语言文本可以看作是一个离散时间序列,语言模型的目标就是评估该序列是否合理,即计算该序列的概率,本节我们介绍基于统计的语言模型,主要是n元语法

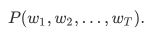

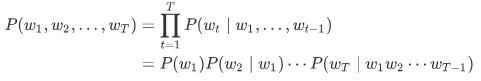

假设序列中的每个词是依次生成的,我们有:

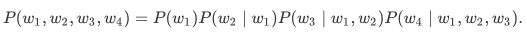

例如,一段含有4个词的文本序列的概率:

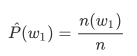

语言模型的参数就是词的概率以及给定前几个词情况下的条件概率。设训练数据集为一个大型文本语料库,如维基百科的所有条目,词的概率可以通过该词在训练数据集中的相对词频来计算,例如,w1的概率可以计算为:

其中n(w1)为语料库中以w1作为第一个词的文本的数量,n为语料库中文本的总数量。

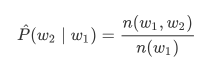

类似的,给定w1情况下,w2的条件概率可以计算为:

其中n(w1,w2)为语料库中以w1作为第一个词,w2作为第二个词的文本的数量。

2.n元语法

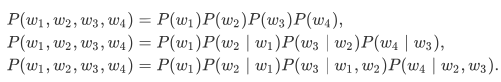

序列长度增加,计算和存储多个词共同出现的概率的复杂度会呈指数级增加。n元语法通过马尔可夫假设简化模型,马尔科夫假设是指一个词的出现只与前面n个词相关,即n阶马尔可夫链。n元语法是基于n-1阶马尔可夫链的概率语言模型。当n分别为1、2和3时,我们将其分别称作一元语法、二元语法和三元语法。例如,长度为4的序列w1,w2,w3,w4在一元语法、二元语法和三元语法中的概率分别为:

当n较小时,n元语法往往并不准确,然而,当n较大时,n元语法需要计算并存储大量的词频和多词相邻频率。n元语法存在参数空间过大和数据稀疏的问题,数据稀疏即数据出现的频率都不高,导致结果趋向于0.

3.语言模型数据集

读取数据集、建立字符索引

def load_data_jay_lyrics():

with open('/home/kesci/input/jaychou_lyrics4703/jaychou_lyrics.txt') as f:

corpus_chars = f.read()

corpus_chars = corpus_chars.replace('\n', ' ').replace('\r', ' ') # 将换行符和回车符替换为空格

corpus_chars = corpus_chars[0:10000]

idx_to_char = list(set(corpus_chars)) # 去重,得到索引到字符的映射

char_to_idx = dict([(char, i) for i, char in enumerate(idx_to_char)]) # 字符到索引的映射

vocab_size = len(char_to_idx)

corpus_indices = [char_to_idx[char] for char in corpus_chars] # 将每个字符转化为索引,得到一个索引的序列

return corpus_indices, char_to_idx, idx_to_char, vocab_size

时序数据的采样

如果序列的长度为T,时间步数即时序数据的一个样本通常包含连续的字符数为n,那么一共有T-n个合法的样本,但是这些样本有大量的重合,我们通常采用更加高效的采样方式。我们有两种方式对时序数据进行采样,分别是随机采样和相邻采样。

随机采样

下面的代码每次从数据里随机采样一个小批量。其中批量大小batch_size是每个小批量的样本数,num_steps是每个样本所包含的时间步数。 在随机采样中,每个样本是原始序列上任意截取的一段序列,相邻的两个随机小批量在原始序列上的位置不一定相毗邻。

import torch

import random

def data_iter_random(corpus_indices, batch_size, num_steps, device=None):

# 减1是因为对于长度为n的序列,X最多只有包含其中的前n - 1个字符

num_examples = (len(corpus_indices) - 1) // num_steps # 下取整,得到不重叠情况下的样本个数

example_indices = [i * num_steps for i in range(num_examples)] # 每个样本的第一个字符在corpus_indices中的下标

random.shuffle(example_indices)

def _data(i):

# 返回从i开始的长为num_steps的序列

return corpus_indices[i: i + num_steps]

if device is None:

device = torch.device('cuda' if torch.cuda.is_available() else 'cpu')

for i in range(0, num_examples, batch_size):

# 每次选出batch_size个随机样本

batch_indices = example_indices[i: i + batch_size] # 当前batch的各个样本的首字符的下标

X = [_data(j) for j in batch_indices]

Y = [_data(j + 1) for j in batch_indices]

yield torch.tensor(X, device=device), torch.tensor(Y, device=device)

相邻采样

在相邻采样中,相邻的两个随机小批量在原始序列上的位置相毗邻。

def data_iter_consecutive(corpus_indices, batch_size, num_steps, device=None):

if device is None:

device = torch.device('cuda' if torch.cuda.is_available() else 'cpu')

corpus_len = len(corpus_indices) // batch_size * batch_size # 保留下来的序列的长度

corpus_indices = corpus_indices[: corpus_len] # 仅保留前corpus_len个字符

indices = torch.tensor(corpus_indices, device=device)

indices = indices.view(batch_size, -1) # resize成(batch_size, )

batch_num = (indices.shape[1] - 1) // num_steps

for i in range(batch_num):

i = i * num_steps

X = indices[:, i: i + num_steps]

Y = indices[:, i + 1: i + num_steps + 1]

yield X, Y

三、循环神经网络基础

循环神经网络及其构造

循环神经网络的核心部分是一个有向图。有向图展开中以链式相连的元素被称为循环单元 。通常地,循环单元构成的链式连接可类比前馈神经网络中的隐含层。

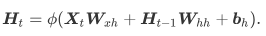

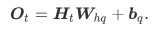

假设H代表隐藏层(即下图a),O代表输出层(即下图y),则循环神经网络的输出为:

其中w为权重,b为偏置,x为输入

Pytorch简洁代码实现

定义一个完整的基于循环神经网络的语言模型

import torch

import torch.nn as nn

import time

import math

import sys

import d2l_jay9460 as d2l

class RNNModel(nn.Module):

def __init__(self, rnn_layer, vocab_size):

super(RNNModel, self).__init__()

self.rnn = rnn_layer

self.hidden_size = rnn_layer.hidden_size * (2 if rnn_layer.bidirectional else 1)

self.vocab_size = vocab_size

self.dense = nn.Linear(self.hidden_size, vocab_size)

def forward(self, inputs, state):

# inputs.shape: (batch_size, num_steps)

X = to_onehot(inputs, vocab_size)

X = torch.stack(X) # X.shape: (num_steps, batch_size, vocab_size)

hiddens, state = self.rnn(X, state)

hiddens = hiddens.view(-1, hiddens.shape[-1]) # hiddens.shape: (num_steps * batch_size, hidden_size)

output = self.dense(hiddens)

return output, state

我们需要实现一个预测函数,与前面的区别在于前向计算和初始化隐藏状态

def predict_rnn_pytorch(prefix, num_chars, model, vocab_size, device, idx_to_char,

char_to_idx):

state = None

output = [char_to_idx[prefix[0]]] # output记录prefix加上预测的num_chars个字符

for t in range(num_chars + len(prefix) - 1):

X = torch.tensor([output[-1]], device=device).view(1, 1)

(Y, state) = model(X, state) # 前向计算不需要传入模型参数

if t < len(prefix) - 1:

output.append(char_to_idx[prefix[t + 1]])

else:

output.append(Y.argmax(dim=1).item())

return ''.join([idx_to_char[i] for i in output])

使用权重为随机值的模型来预测一次。

model = RNNModel(rnn_layer, vocab_size).to(device)

predict_rnn_pytorch('分开', 10, model, vocab_size, device, idx_to_char, char_to_idx)

实现训练函数,这里只使用了相邻采样。

def train_and_predict_rnn_pytorch(model, num_hiddens, vocab_size, device,

corpus_indices, idx_to_char, char_to_idx,

num_epochs, num_steps, lr, clipping_theta,

batch_size, pred_period, pred_len, prefixes):

loss = nn.CrossEntropyLoss()

optimizer = torch.optim.Adam(model.parameters(), lr=lr)

model.to(device)

for epoch in range(num_epochs):

l_sum, n, start = 0.0, 0, time.time()

data_iter = d2l.data_iter_consecutive(corpus_indices, batch_size, num_steps, device) # 相邻采样

state = None

for X, Y in data_iter:

if state is not None:

# 使用detach函数从计算图分离隐藏状态

if isinstance (state, tuple): # LSTM, state:(h, c)

state[0].detach_()

state[1].detach_()

else:

state.detach_()

(output, state) = model(X, state) # output.shape: (num_steps * batch_size, vocab_size)

y = torch.flatten(Y.T)

l = loss(output, y.long())

optimizer.zero_grad()

l.backward()

grad_clipping(model.parameters(), clipping_theta, device)

optimizer.step()

l_sum += l.item() * y.shape[0]

n += y.shape[0]

if (epoch + 1) % pred_period == 0:

print('epoch %d, perplexity %f, time %.2f sec' % (

epoch + 1, math.exp(l_sum / n), time.time() - start))

for prefix in prefixes:

print(' -', predict_rnn_pytorch(

prefix, pred_len, model, vocab_size, device, idx_to_char,

char_to_idx))

训练模型。

num_epochs, batch_size, lr, clipping_theta = 250, 32, 1e-3, 1e-2

pred_period, pred_len, prefixes = 50, 50, ['分开', '不分开']

train_and_predict_rnn_pytorch(model, num_hiddens, vocab_size, device,

corpus_indices, idx_to_char, char_to_idx,

num_epochs, num_steps, lr, clipping_theta,

batch_size, pred_period, pred_len, prefixes)

722

722

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?